Inferenzparameter

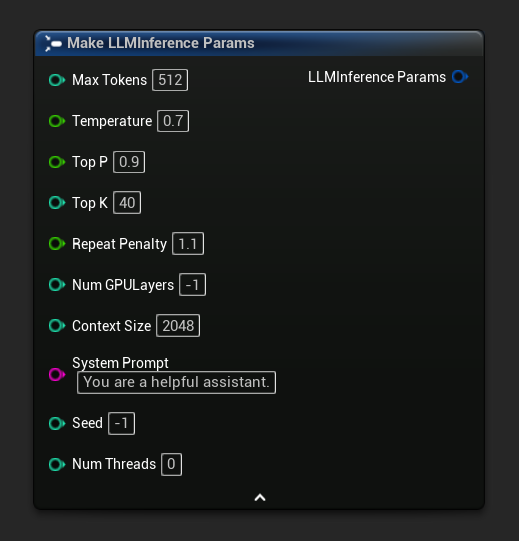

Die Struktur LLM Inference Parameters steuert, wie das Modell geladen wird und Text generiert. Diese Parameter übergeben Sie beim Laden eines Modells. Diese Seite beschreibt jeden Parameter und seine Auswirkungen.

Parameterreferenz

| Parameter | Typ | Standard | Bereich | Beschreibung |

|---|---|---|---|---|

| Max Tokens | int32 | 512 | 1–8192 | Maximale Anzahl an Tokens, die in einer einzigen Antwort generiert werden |

| Temperature | float | 0.7 | 0.0–2.0 | Steuert die Zufälligkeit. 0,0 = deterministisch. Höhere Werte = kreativere Ausgabe |

| Top P | float | 0.9 | 0.0–1.0 | Nucleus-Sampling. Nur Tokens, deren kumulative Wahrscheinlichkeit diesen Wert überschreitet, werden berücksichtigt |

| Top K | int32 | 40 | 0–200 | Beschränkt die Auswahl auf die K wahrscheinlichsten Tokens. 0 = deaktiviert |

| Repeat Penalty | float | 1.1 | 0,0–3,0 | Bestraft Tokens, die bereits in der Ausgabe vorkommen. 1,0 = keine Strafe |

| Num GPU Layers | int32 | -1 | -1–200 | Modell-Layer, die auf die GPU ausgelagert werden. -1 = automatisch. 0 = nur CPU |

| Context Size | int32 | 2048 | 128–131072 | Maximale Kontextfenstergröße in Tokens. Größere Werte verbrauchen mehr Speicher |

| System Prompt | FString | "Du bist ein hilfsbereiter Assistent." | — | Systemanweisung, die das Verhalten des Modells prägt |

| Seed | int32 | -1 | -1+ | Zufallsseed für reproduzierbare Ausgabe. -1 = zufällig |

| Num Threads | int32 | 0 | 0–128 | CPU-Threads für die Generierung. 0 = automatisch |

Verwendung

- Blueprint

- C++

Inferenzparameter erscheinen als Struct-Pin bei Load- und Async-Knoten. Verwenden Sie den Break-Struct-Knoten, um einzelne Werte festzulegen:

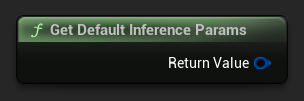

Um einen Standardparametersatz als Ausgangspunkt zu erhalten, verwenden Sie Get Default Inference Params:

```cpp

// Creative writing

FLLMInferenceParams CreativeParams;

CreativeParams.MaxTokens = 1024;

CreativeParams.Temperature = 1.2f;

CreativeParams.TopP = 0.95f;

CreativeParams.TopK = 80;

CreativeParams.RepeatPenalty = 1.2f;

CreativeParams.SystemPrompt = TEXT("You are a creative storyteller.");

// Factual / deterministic

FLLMInferenceParams FactualParams;

FactualParams.MaxTokens = 256;

FactualParams.Temperature = 0.1f;

FactualParams.TopP = 0.5f;

FactualParams.TopK = 10;

FactualParams.SystemPrompt = TEXT("Answer questions concisely and accurately.");

// Mobile-optimized

FLLMInferenceParams MobileParams;

MobileParams.MaxTokens = 128;

MobileParams.ContextSize = 1024;

MobileParams.NumGPULayers = 0;

MobileParams.NumThreads = 4;

MobileParams.SystemPrompt = TEXT("You are a helpful assistant. Keep responses brief.");

// Get defaults programmatically

FLLMInferenceParams DefaultParams = URuntimeLocalLLM::GetDefaultInferenceParams();

Plattform-Empfehlungen

Mobil / VR (Android, iOS, Meta Quest)

- Kontextgröße: 1024–2048

- Num GPU Layers: 0 (CPU only) es sei denn, das Gerät verfügt über bestätigte GPU-Compute-Unterstützung

- Max Tokens: unter 256 für reaktionsschnelle Interaktionen

- Num Threads: 2–4 je nach Gerät

Desktop (Windows, Mac, Linux)

- Kontextgröße: 2048–8192 für die meisten Unterhaltungen

- Num GPU Layers: -1 (auto) um GPU-Beschleunigung zu nutzen, wenn verfügbar

- Num Threads: 0 (auto)

- Max Tokens: 512–2048 für längere Antworten