Audio-Verarbeitungsleitfaden

Dieser Leitfaden behandelt die Einrichtung verschiedener Audioeingabemethoden, um Audiodaten an Ihre Lippen-Sync-Generatoren zu liefern. Stellen Sie sicher, dass Sie den Setup Guide abgeschlossen haben, bevor Sie fortfahren.

Audioeingabeverarbeitung

Sie müssen eine Methode zur Verarbeitung der Audioeingabe einrichten. Es gibt mehrere Möglichkeiten, je nach Ihrer Audioquelle.

- Mikrofon (Echtzeit)

- Mikrofon (Wiedergabe)

- Text-to-Speech (Lokal)

- Text-to-Speech (Externe APIs)

- Von Audio-Datei/Puffer

- Streaming Audio-Puffer

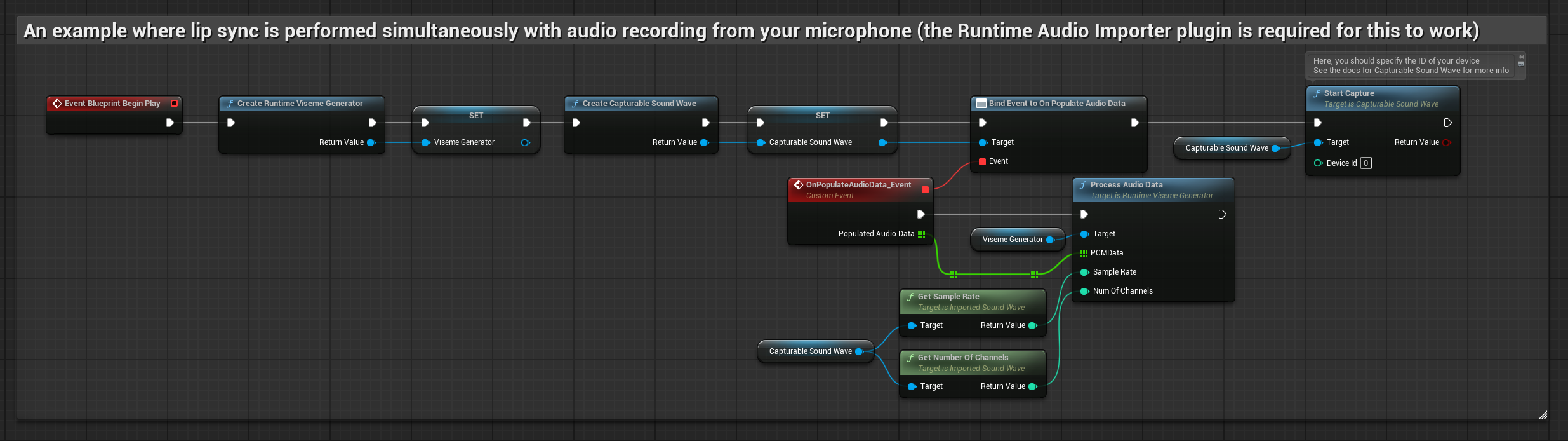

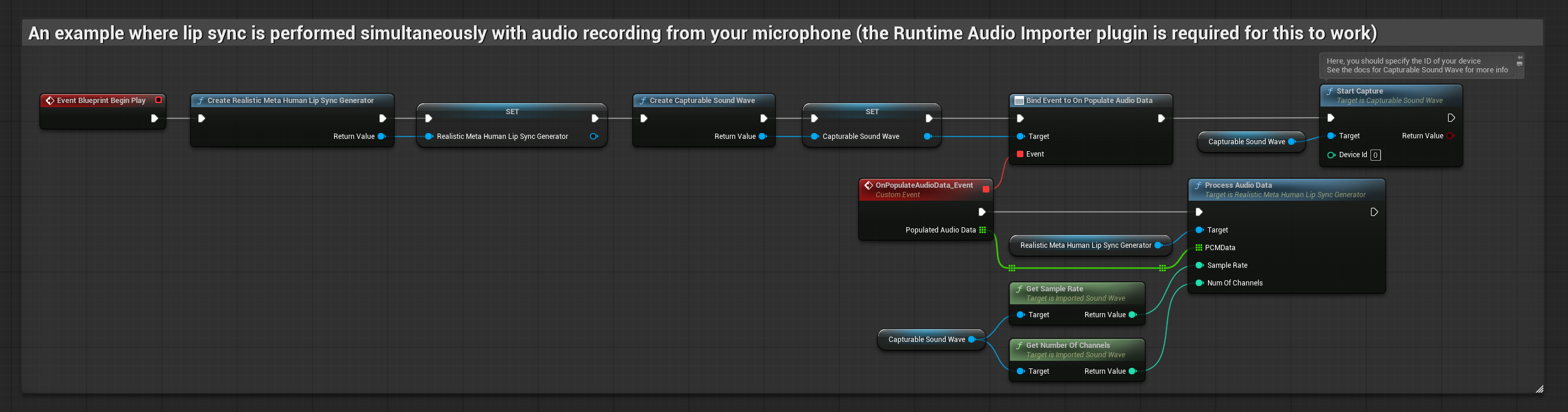

Dieser Ansatz führt den Lippen-Sync in Echtzeit durch, während Sie in das Mikrofon sprechen:

- Standard Model

- Realistic Model

- Mood-Enabled Realistic Model

- Erstellen Sie eine Capturable Sound Wave mit Runtime Audio Importer

- Für Linux mit Pixel Streaming verwenden Sie stattdessen Pixel Streaming Capturable Sound Wave

- Binden Sie sich an den

OnPopulateAudioData-Delegaten, bevor Sie mit der Audioaufnahme beginnen - Rufen Sie in der gebundenen Funktion

ProcessAudioDatavon Ihrem Runtime Viseme Generator auf - Starten Sie die Audioaufnahme vom Mikrofon

Das Realistic Model verwendet den gleichen Audioverarbeitungs-Workflow wie das Standard Model, jedoch mit der Variable RealisticLipSyncGenerator anstelle von VisemeGenerator.

Das Mood-Enabled Model verwendet den gleichen Audioverarbeitungs-Workflow, jedoch mit der Variable MoodMetaHumanLipSyncGenerator und zusätzlichen Mood-Konfigurationsmöglichkeiten.

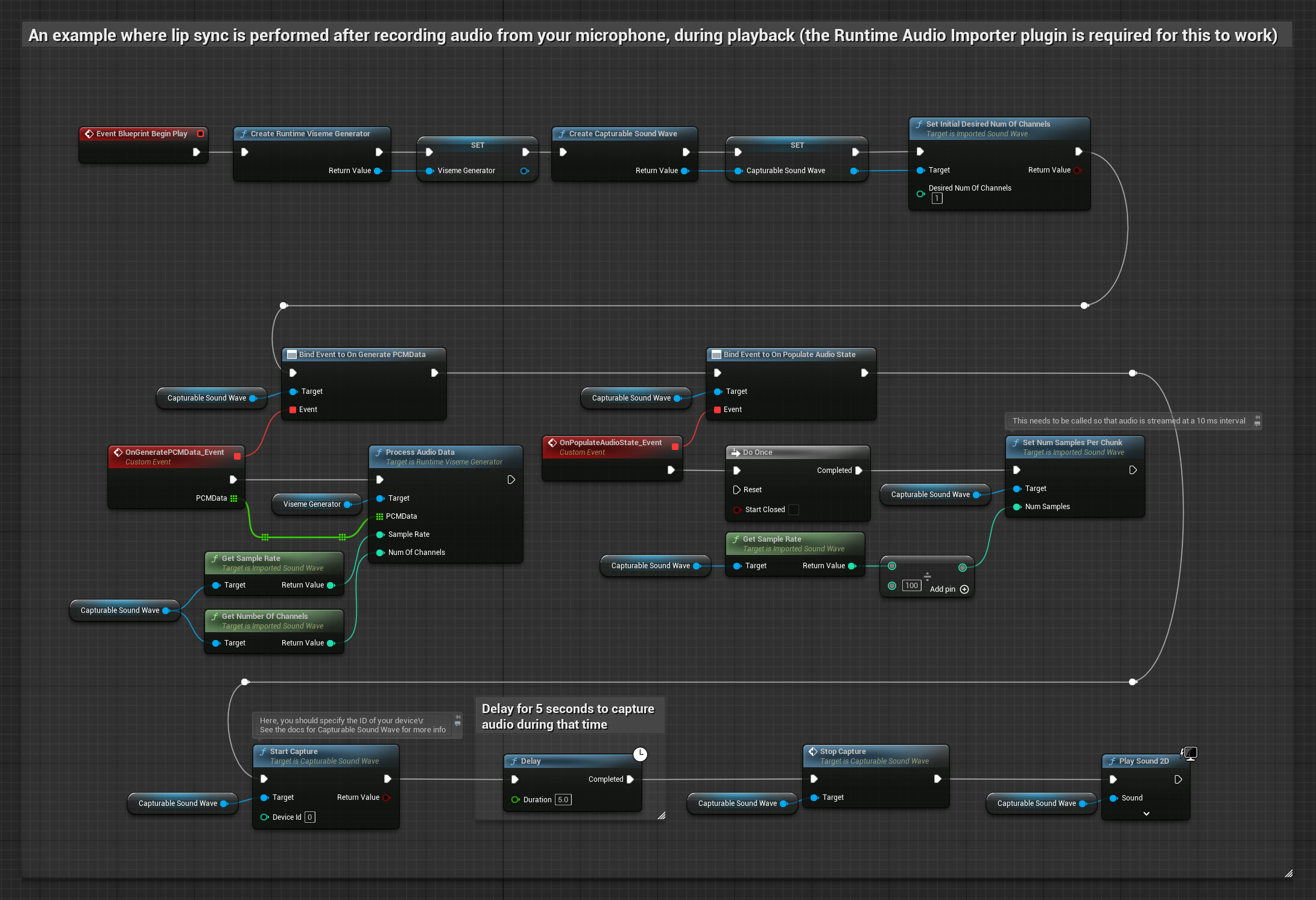

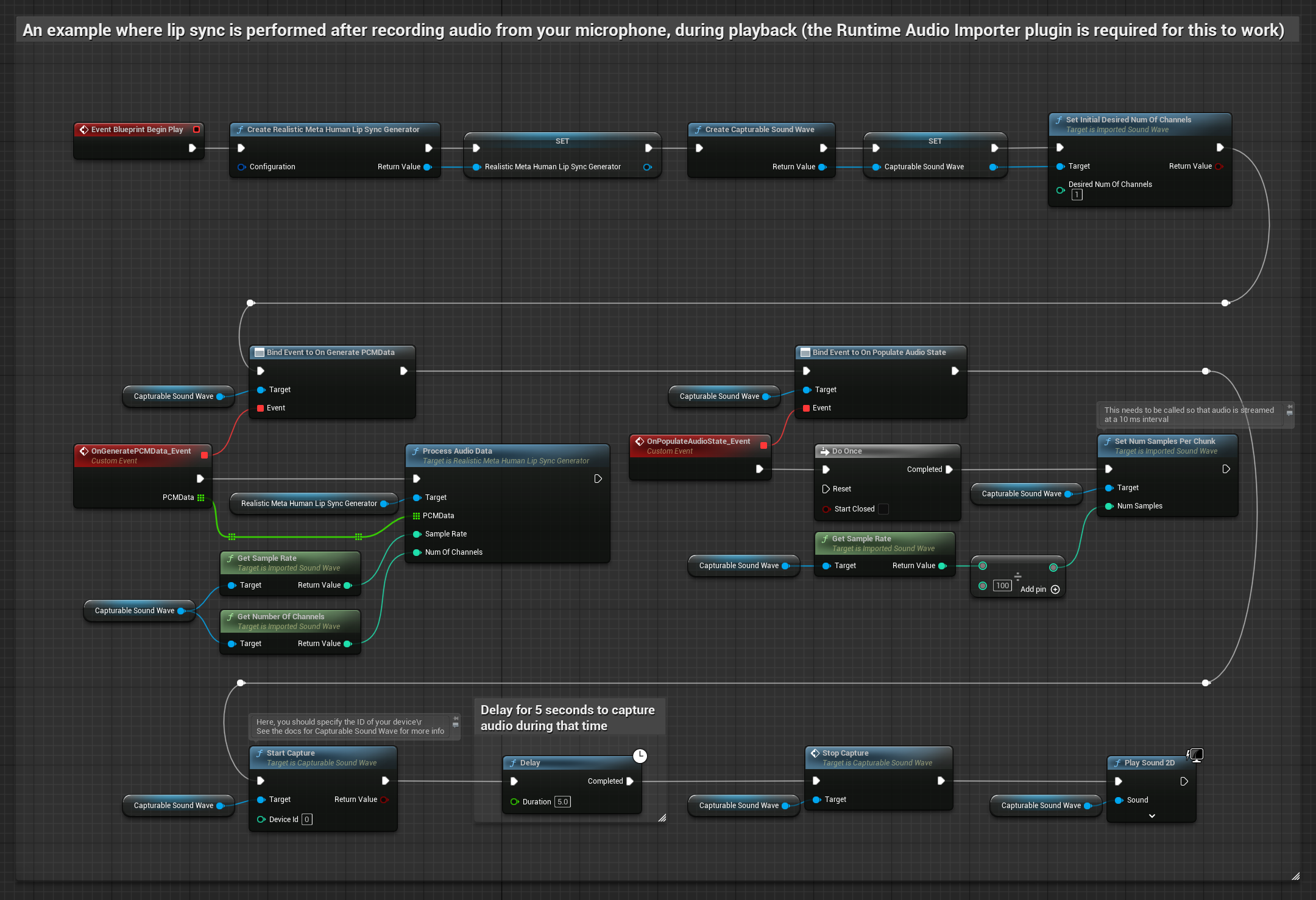

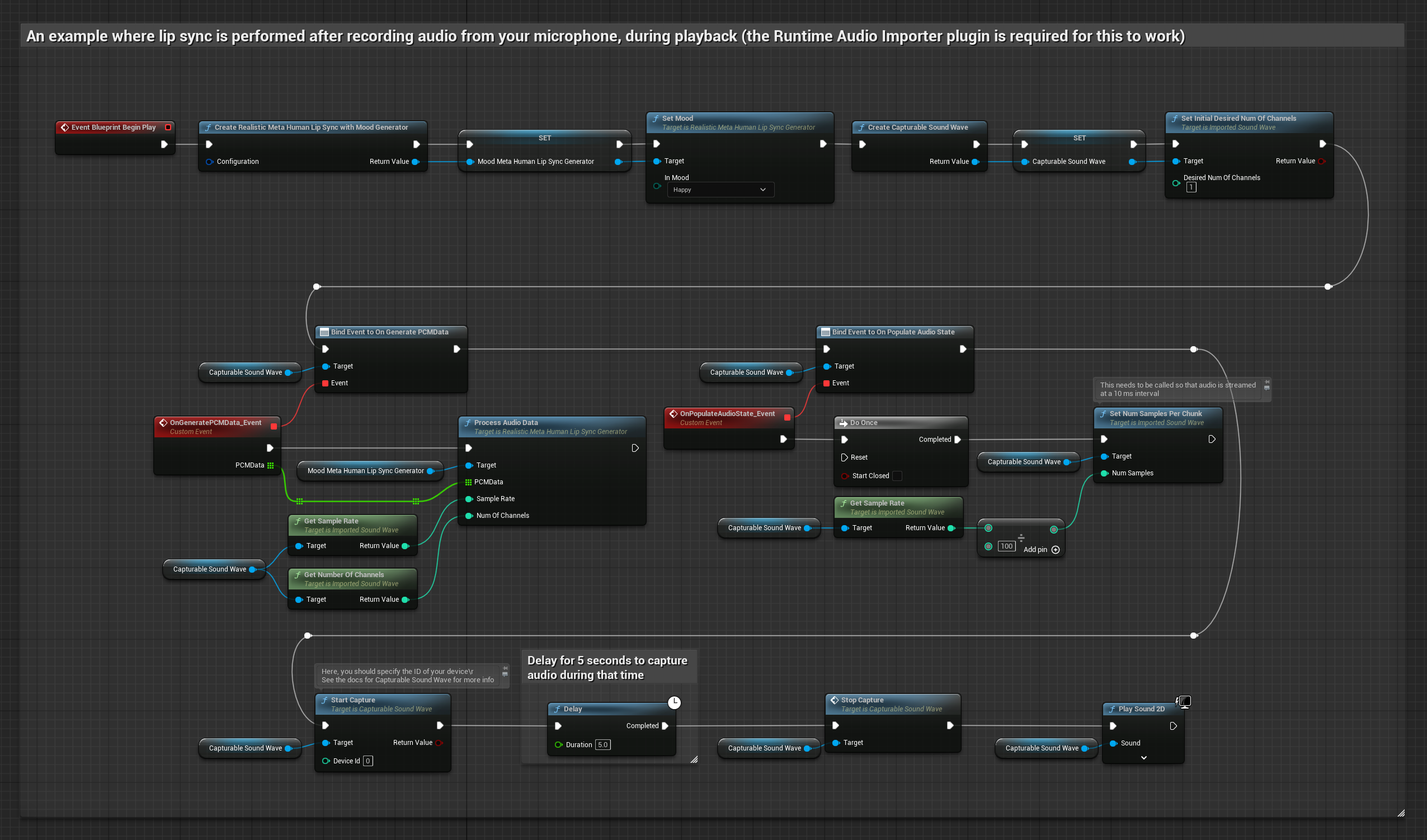

Dieser Ansatz nimmt Audio von einem Mikrofon auf und spielt es dann mit Lippen-Sync ab:

- Standard Model

- Realistic Model

- Mood-Enabled Realistic Model

- Erstellen Sie eine Capturable Sound Wave mit Runtime Audio Importer

- Für Linux mit Pixel Streaming verwenden Sie stattdessen Pixel Streaming Capturable Sound Wave

- Starten Sie die Audioaufnahme vom Mikrofon

- Binden Sie sich an den

OnGeneratePCMData-Delegaten der capturable sound wave, bevor Sie sie abspielen - Rufen Sie in der gebundenen Funktion

ProcessAudioDatavon Ihrem Runtime Viseme Generator auf

Das Realistic Model verwendet den gleichen Audioverarbeitungs-Workflow wie das Standard Model, jedoch mit der Variable RealisticLipSyncGenerator anstelle von VisemeGenerator.

Das Mood-Enabled Model verwendet den gleichen Audioverarbeitungs-Workflow, jedoch mit der Variable MoodMetaHumanLipSyncGenerator und zusätzlichen Mood-Konfigurationsmöglichkeiten.

- Regular

- Streaming

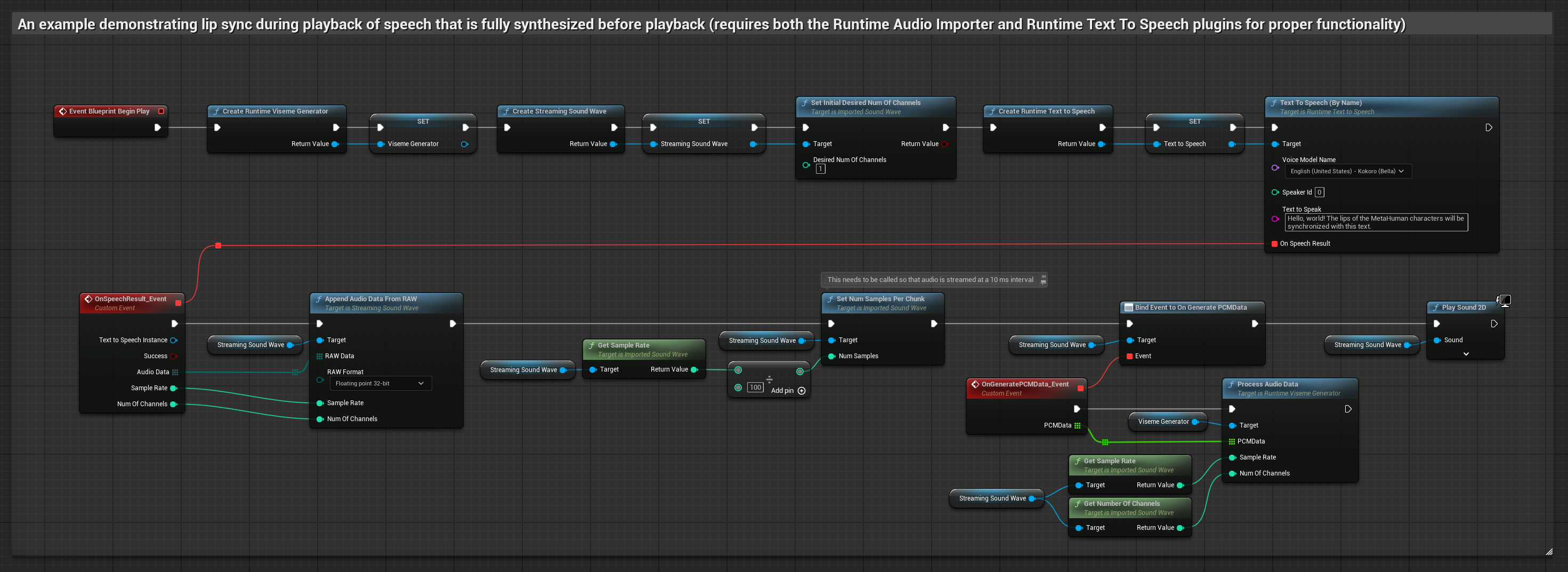

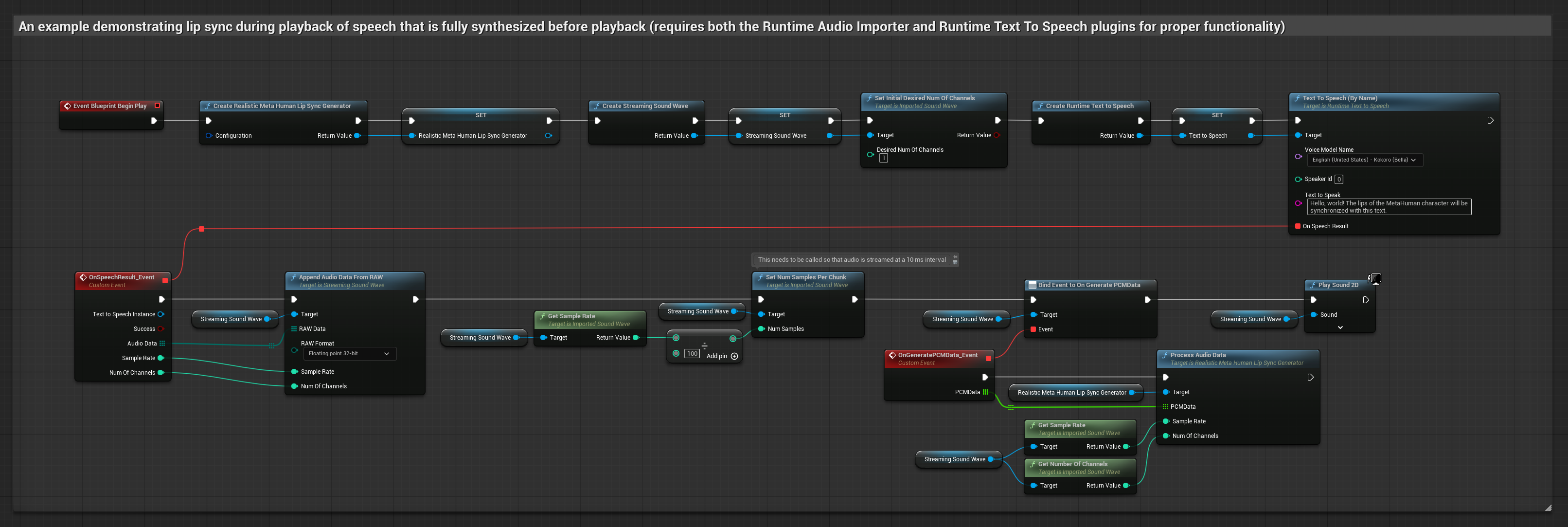

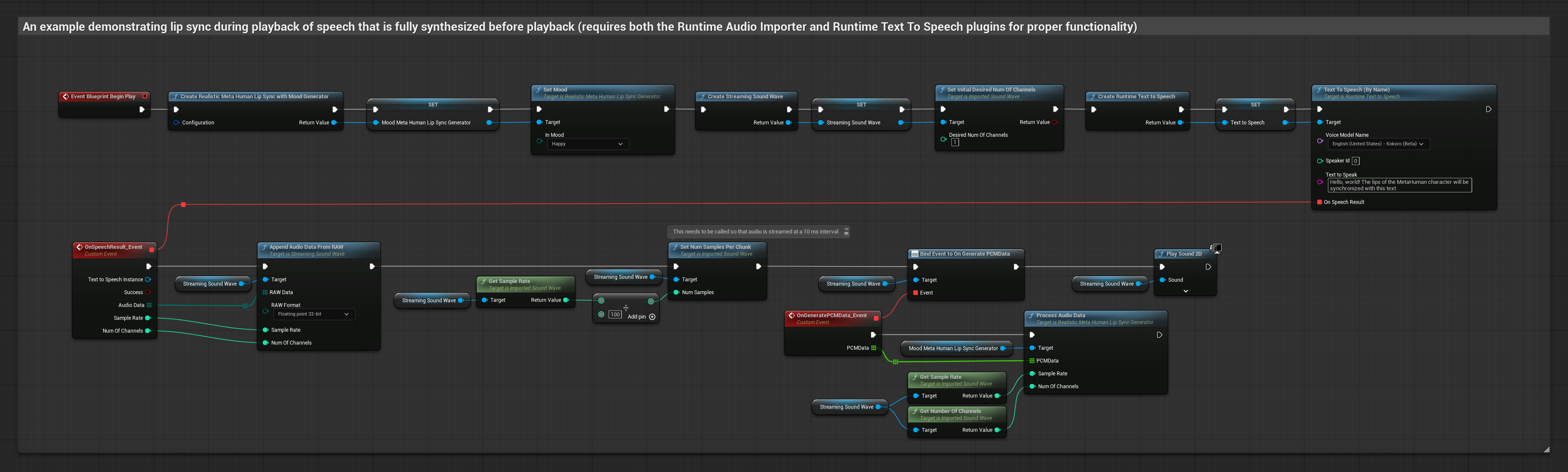

Dieser Ansatz synthetisiert Sprache aus Text mit lokalem TTS und führt Lippen-Sync durch:

- Standard Model

- Realistic Model

- Mood-Enabled Realistic Model

- Verwenden Sie Runtime Text To Speech, um Sprache aus Text zu generieren

- Verwenden Sie Runtime Audio Importer, um das synthetisierte Audio zu importieren

- Binden Sie sich an den

OnGeneratePCMData-Delegaten der importierten sound wave, bevor Sie sie abspielen - Rufen Sie in der gebundenen Funktion

ProcessAudioDatavon Ihrem Runtime Viseme Generator auf

Das Realistic Model verwendet den gleichen Audioverarbeitungs-Workflow wie das Standard Model, jedoch mit der Variable RealisticLipSyncGenerator anstelle von VisemeGenerator.

Das Mood-Enabled Model verwendet den gleichen Audioverarbeitungs-Workflow, jedoch mit der Variable MoodMetaHumanLipSyncGenerator und zusätzlichen Mood-Konfigurationsmöglichkeiten.

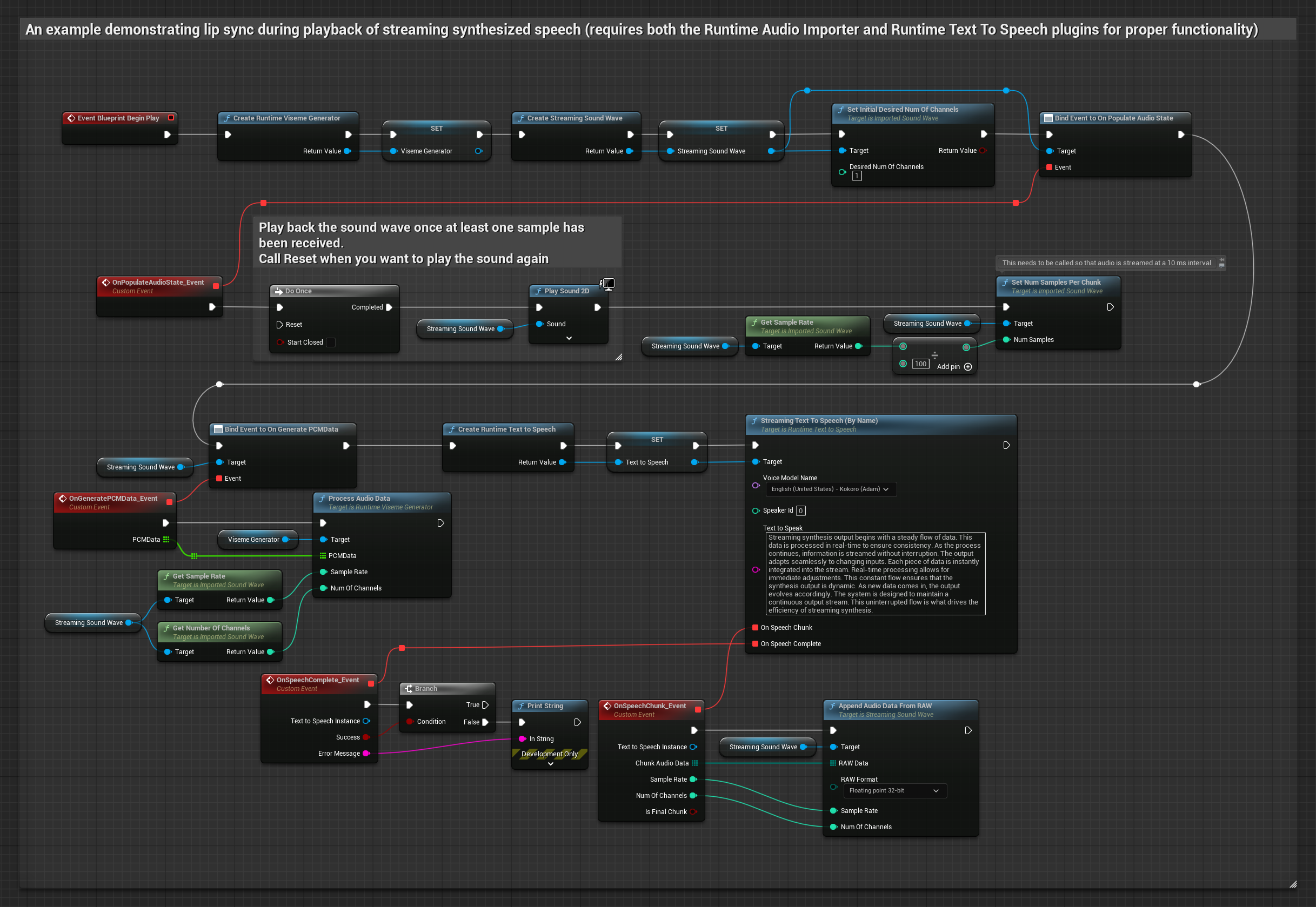

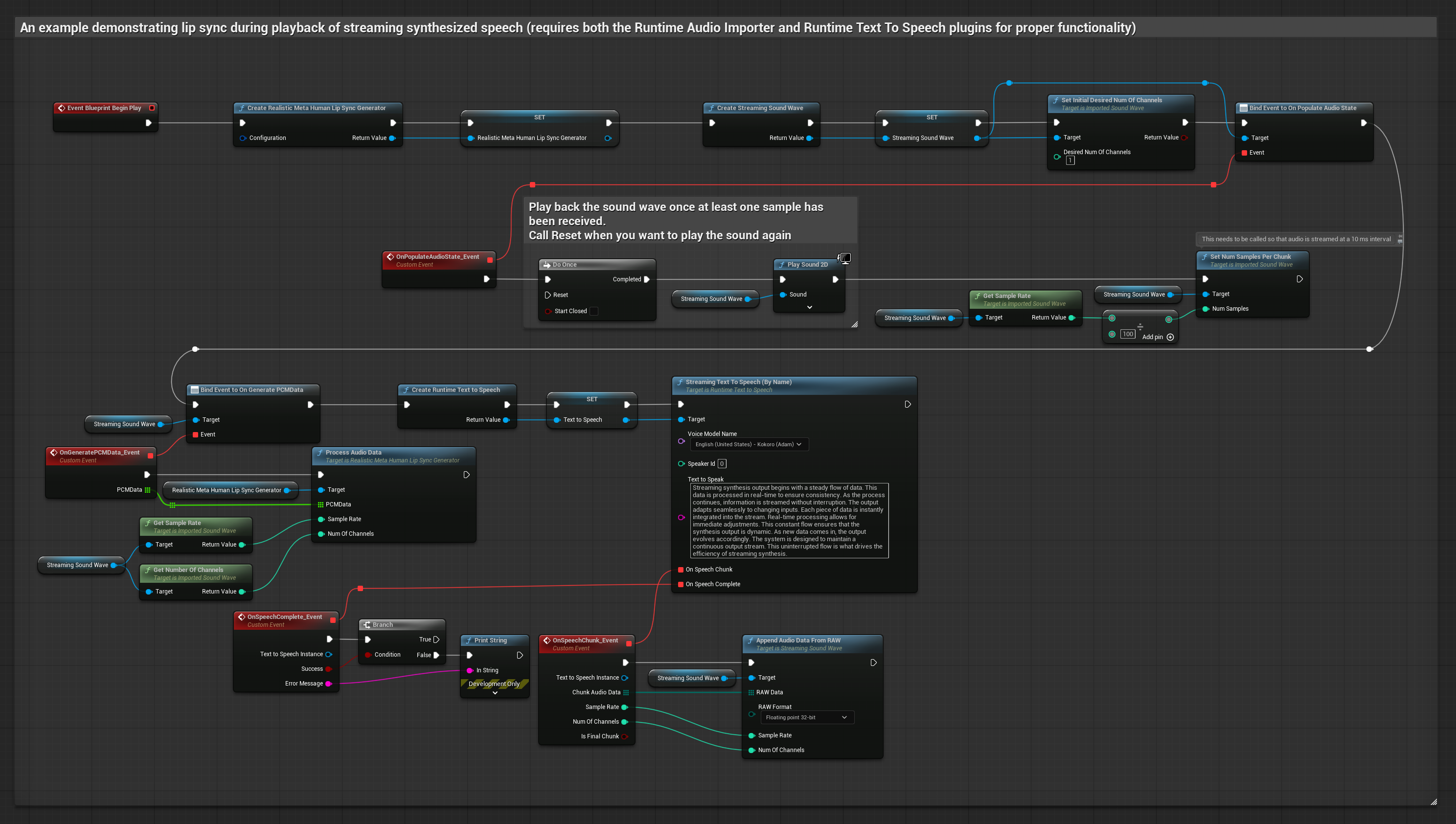

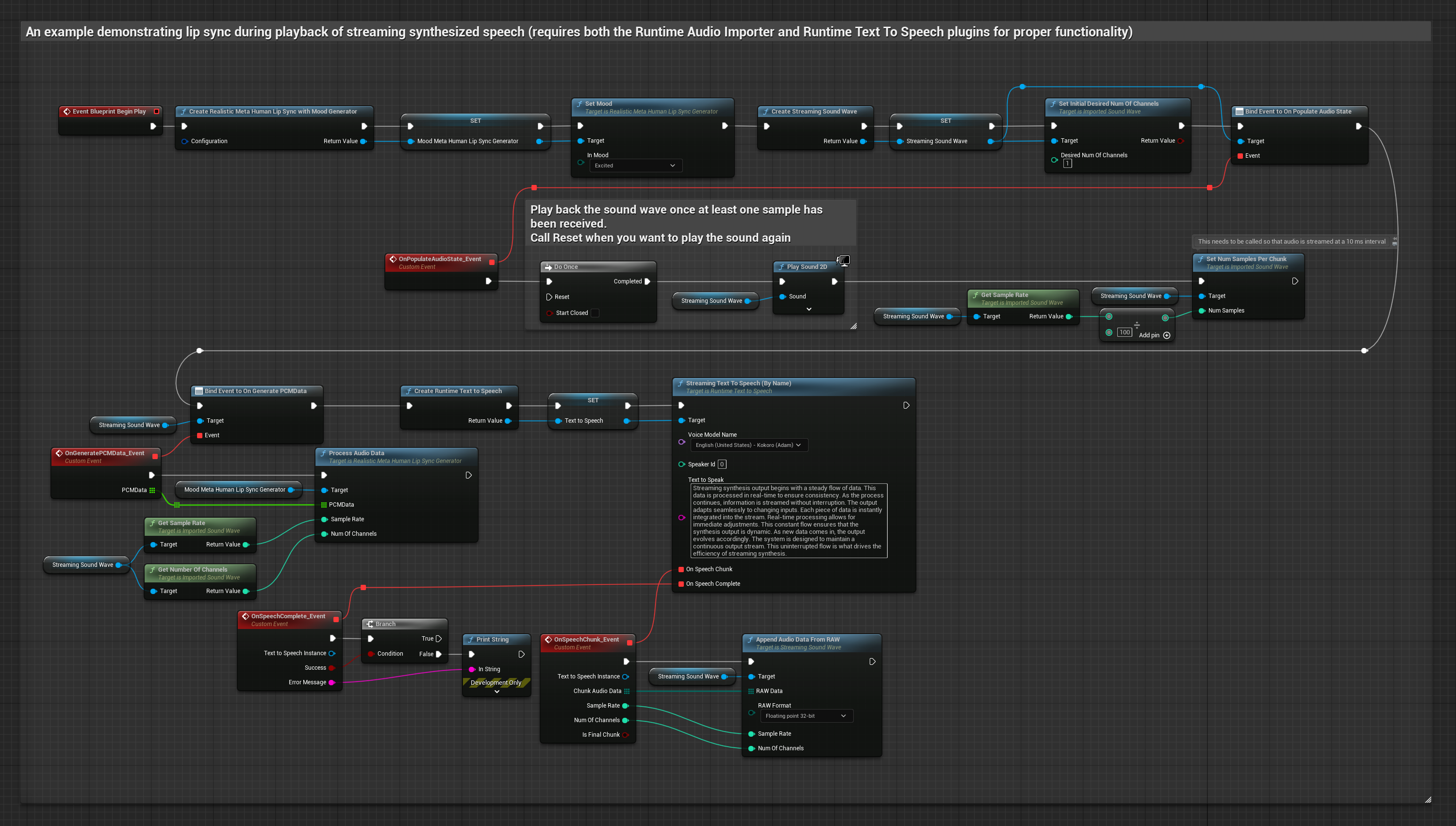

Dieser Ansatz verwendet Streaming-Text-to-Speech-Synthese mit Echtzeit-Lippen-Sync:

- Standard Model

- Realistic Model

- Mood-Enabled Realistic Model

- Verwenden Sie Runtime Text To Speech, um Streaming-Sprache aus Text zu generieren

- Verwenden Sie Runtime Audio Importer, um das synthetisierte Audio zu importieren

- Binden Sie sich an den

OnGeneratePCMData-Delegaten der streaming sound wave, bevor Sie sie abspielen - Rufen Sie in der gebundenen Funktion

ProcessAudioDatavon Ihrem Runtime Viseme Generator auf

Das Realistic Model verwendet den gleichen Audioverarbeitungs-Workflow wie das Standard Model, jedoch mit der Variable RealisticLipSyncGenerator anstelle von VisemeGenerator.

Das Mood-Enabled Model verwendet den gleichen Audioverarbeitungs-Workflow, jedoch mit der Variable MoodMetaHumanLipSyncGenerator und zusätzlichen Mood-Konfigurationsmöglichkeiten.

- Regular

- Streaming

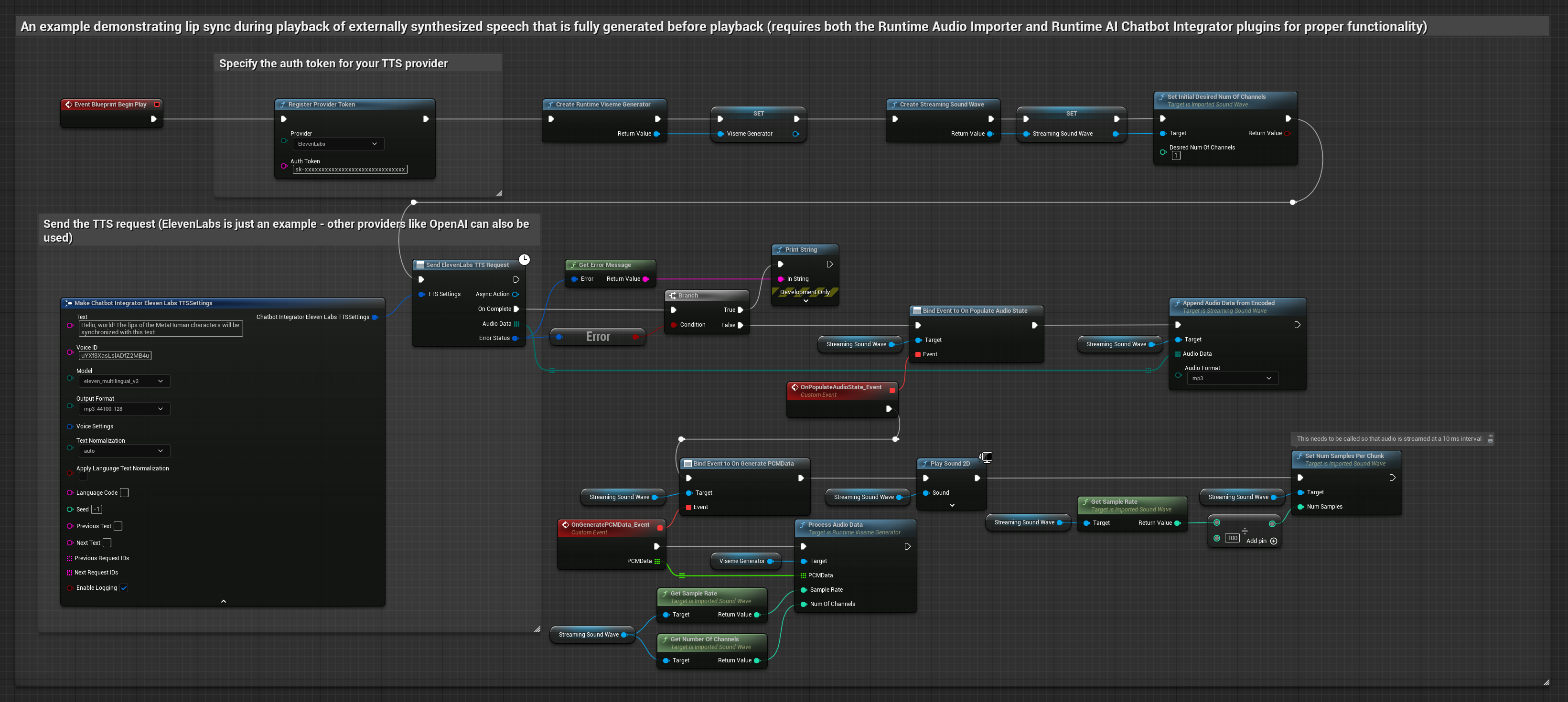

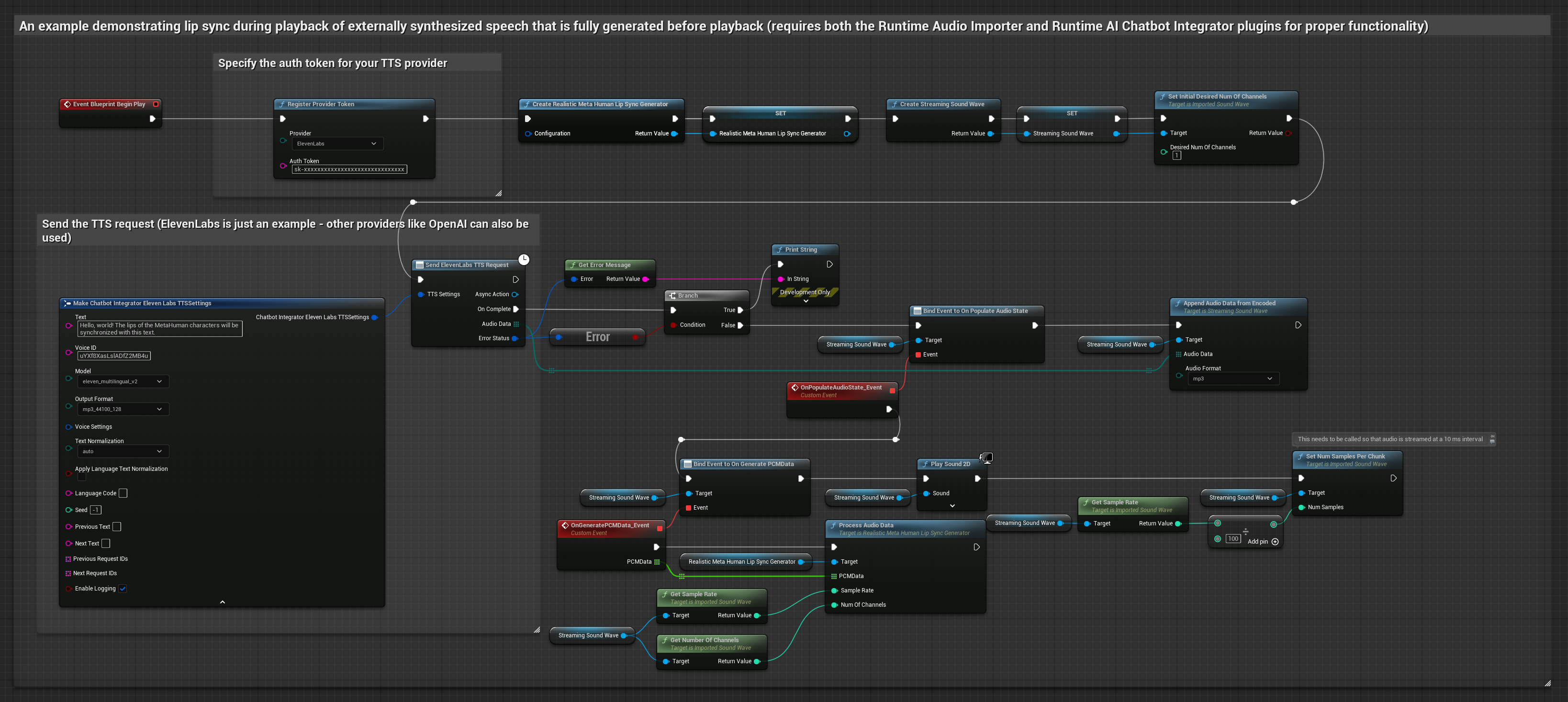

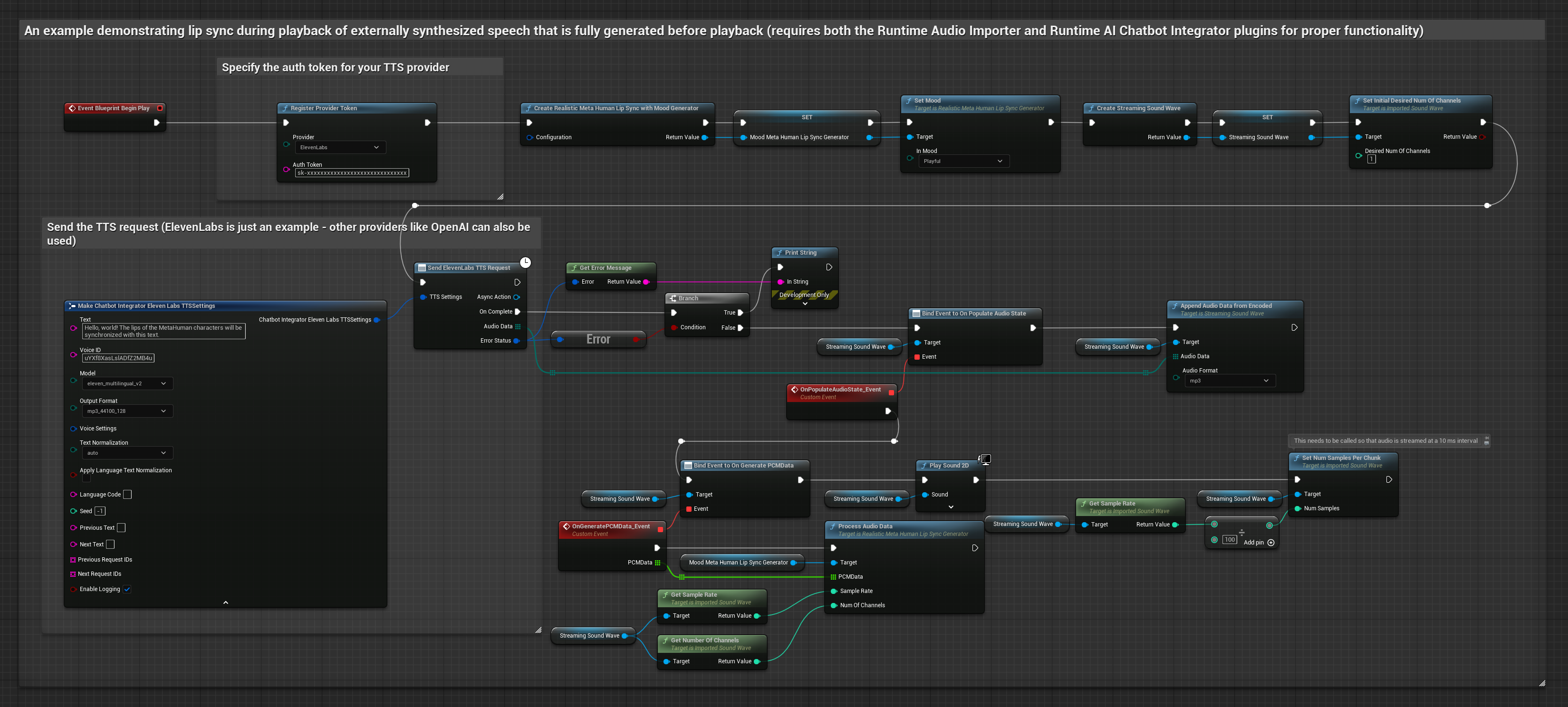

Dieser Ansatz verwendet das Runtime AI Chatbot Integrator-Plugin, um synthetisierte Sprache von KI-Diensten (OpenAI oder ElevenLabs) zu generieren und Lippen-Sync durchzuführen:

- Standard Model

- Realistic Model

- Mood-Enabled Realistic Model

- Verwenden Sie Runtime AI Chatbot Integrator, um Sprache aus Text mit externen APIs (OpenAI, ElevenLabs, etc.) zu generieren

- Verwenden Sie Runtime Audio Importer, um die synthetisierten Audiodaten zu importieren

- Binden Sie sich an den

OnGeneratePCMData-Delegaten der importierten sound wave, bevor Sie sie abspielen - Rufen Sie in der gebundenen Funktion

ProcessAudioDatavon Ihrem Runtime Viseme Generator auf

Das Realistic Model verwendet den gleichen Audioverarbeitungs-Workflow wie das Standard Model, jedoch mit der Variable RealisticLipSyncGenerator anstelle von VisemeGenerator.

Das Mood-Enabled Model verwendet den gleichen Audioverarbeitungs-Workflow, jedoch mit der Variable MoodMetaHumanLipSyncGenerator und zusätzlichen Mood-Konfigurationsmöglichkeiten.

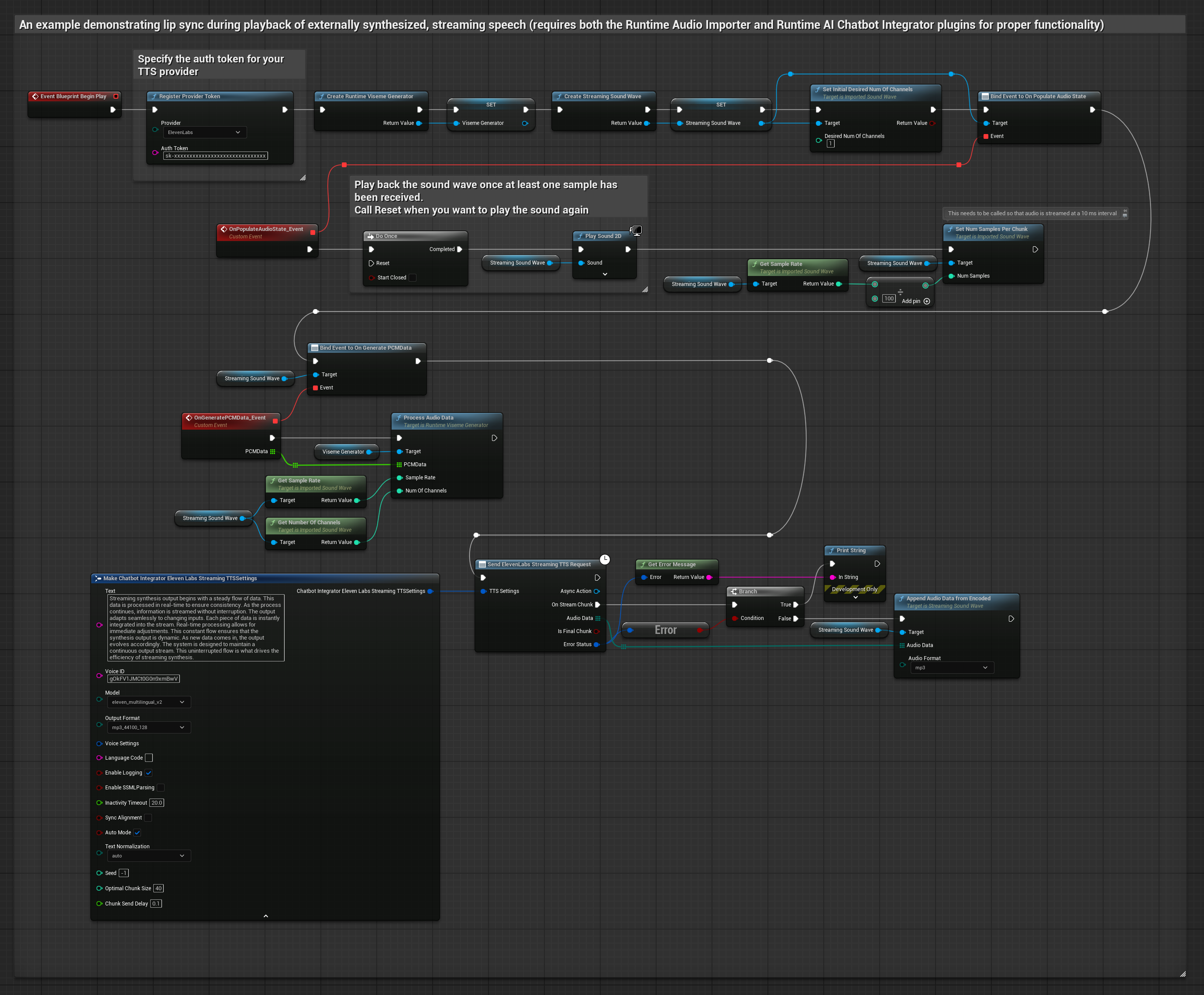

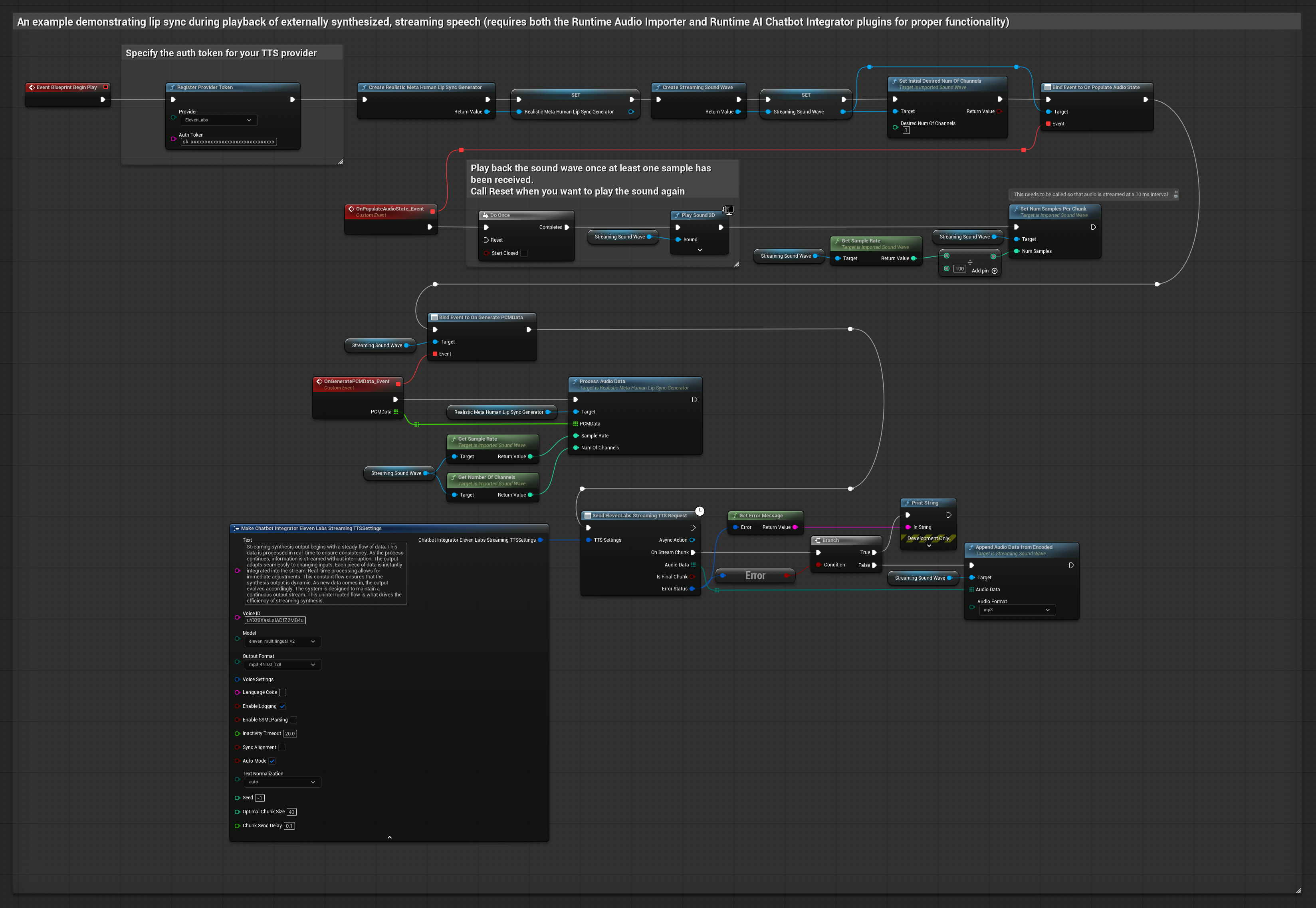

Dieser Ansatz verwendet das Runtime AI Chatbot Integrator-Plugin, um synthetisierte Streaming-Sprache von KI-Diensten (OpenAI oder ElevenLabs) zu generieren und Lippen-Sync durchzuführen:

- Standard Model

- Realistic Model

- Mood-Enabled Realistic Model

- Verwenden Sie Runtime AI Chatbot Integrator, um eine Verbindung zu Streaming-TTS-APIs (wie ElevenLabs Streaming API) herzustellen

- Verwenden Sie Runtime Audio Importer, um die synthetisierten Audiodaten zu importieren

- Binden Sie sich an den

OnGeneratePCMData-Delegaten der streaming sound wave, bevor Sie sie abspielen - Rufen Sie in der gebundenen Funktion

ProcessAudioDatavon Ihrem Runtime Viseme Generator auf

Das Realistic Model verwendet den gleichen Audioverarbeitungs-Workflow wie das Standard Model, jedoch mit der Variable RealisticLipSyncGenerator anstelle von VisemeGenerator.

Das Mood-Enabled Model verwendet den gleichen Audioverarbeitungs-Workflow, jedoch mit der Variable MoodMetaHumanLipSyncGenerator und zusätzlichen Mood-Konfigurationsmöglichkeiten.

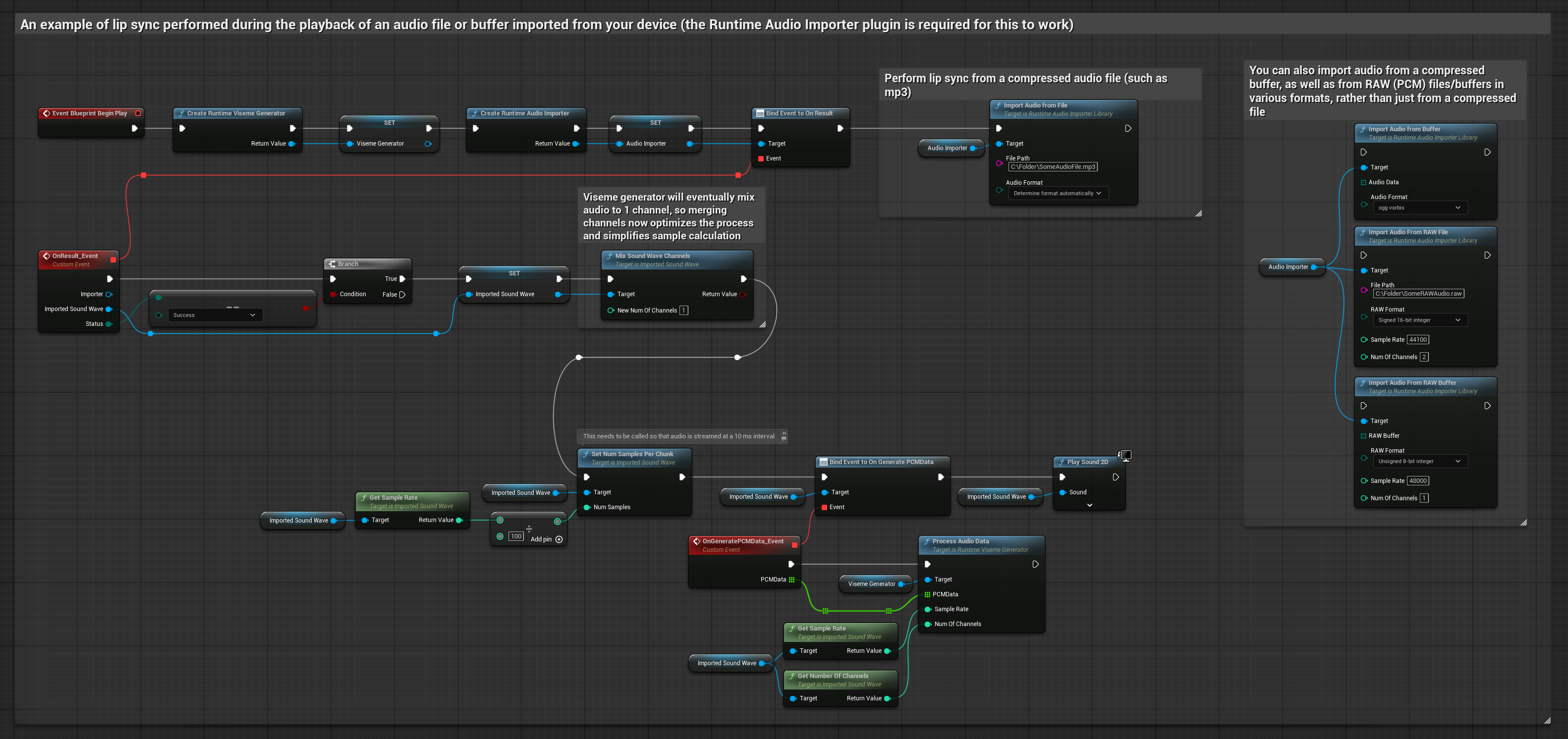

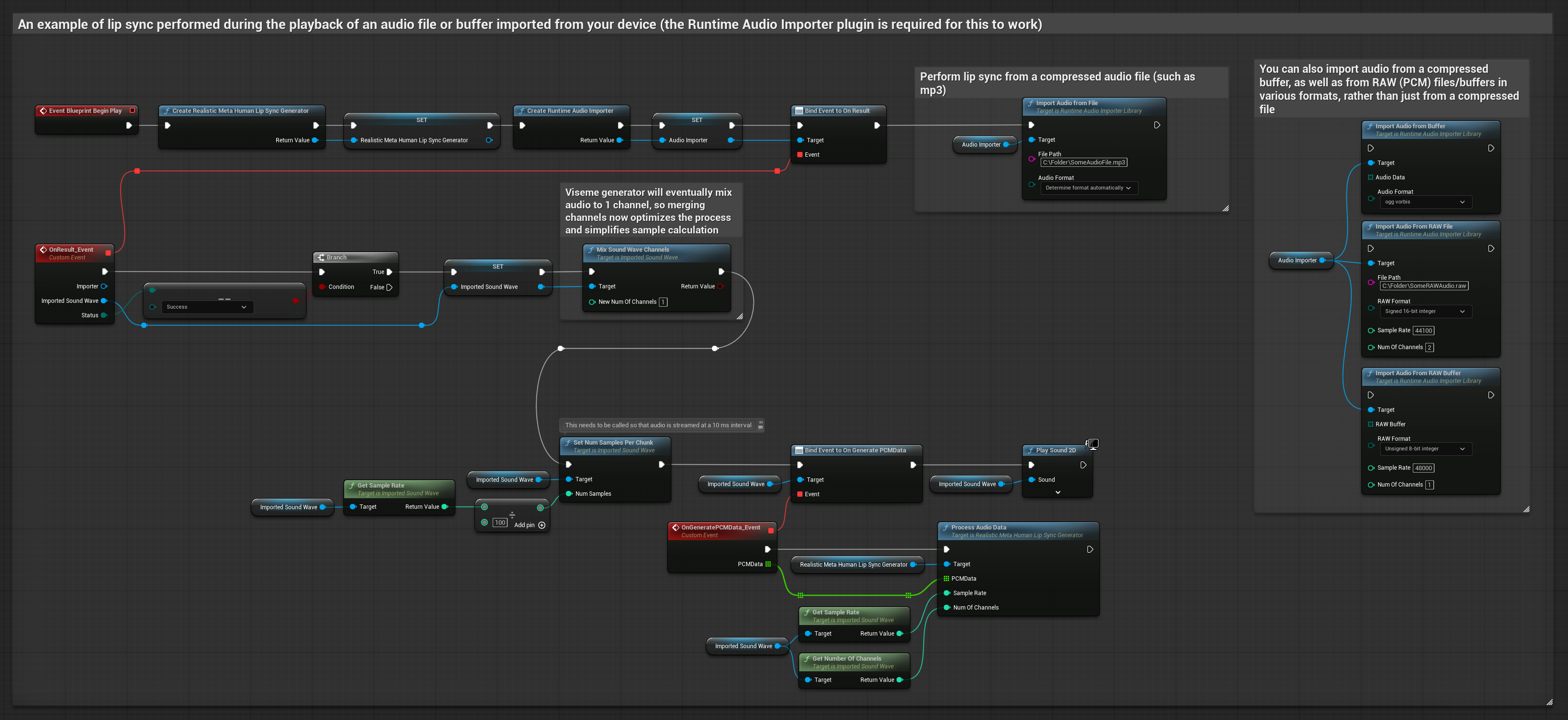

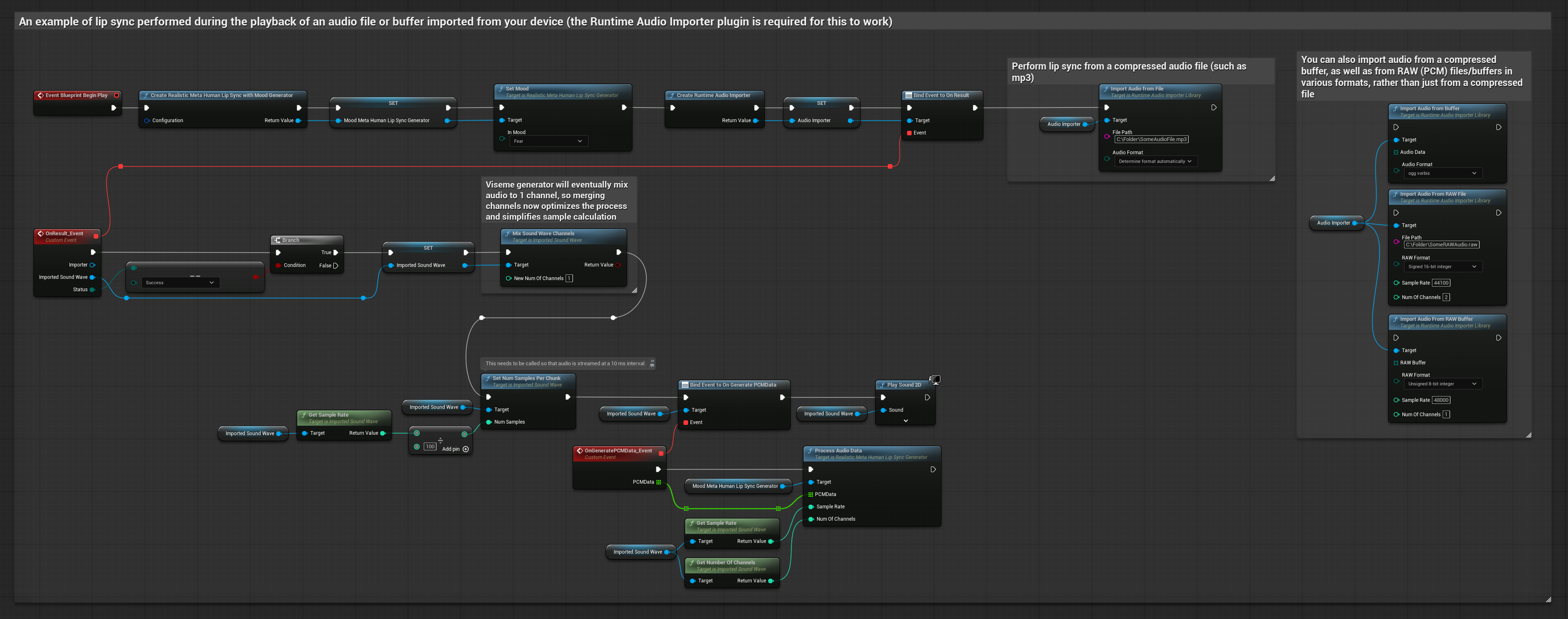

Dieser Ansatz verwendet voraufgenommene Audiodateien oder Audio-Puffer für Lippen-Sync:

- Standard Model

- Realistic Model

- Mood-Enabled Realistic Model

- Verwenden Sie Runtime Audio Importer, um eine Audiodatei von der Festplatte oder aus dem Speicher zu importieren

- Binden Sie sich an den

OnGeneratePCMData-Delegaten der importierten sound wave, bevor Sie sie abspielen - Rufen Sie in der gebundenen Funktion

ProcessAudioDatavon Ihrem Runtime Viseme Generator auf - Spielen Sie die importierte sound wave ab und beobachten Sie die Lippen-Sync-Animation

Das Realistic Model verwendet den gleichen Audioverarbeitungs-Workflow wie das Standard Model, jedoch mit der Variable RealisticLipSyncGenerator anstelle von VisemeGenerator.

Das Mood-Enabled Model verwendet den gleichen Audioverarbeitungs-Workflow, jedoch mit der Variable MoodMetaHumanLipSyncGenerator und zusätzlichen Mood-Konfigurationsmöglichkeiten.

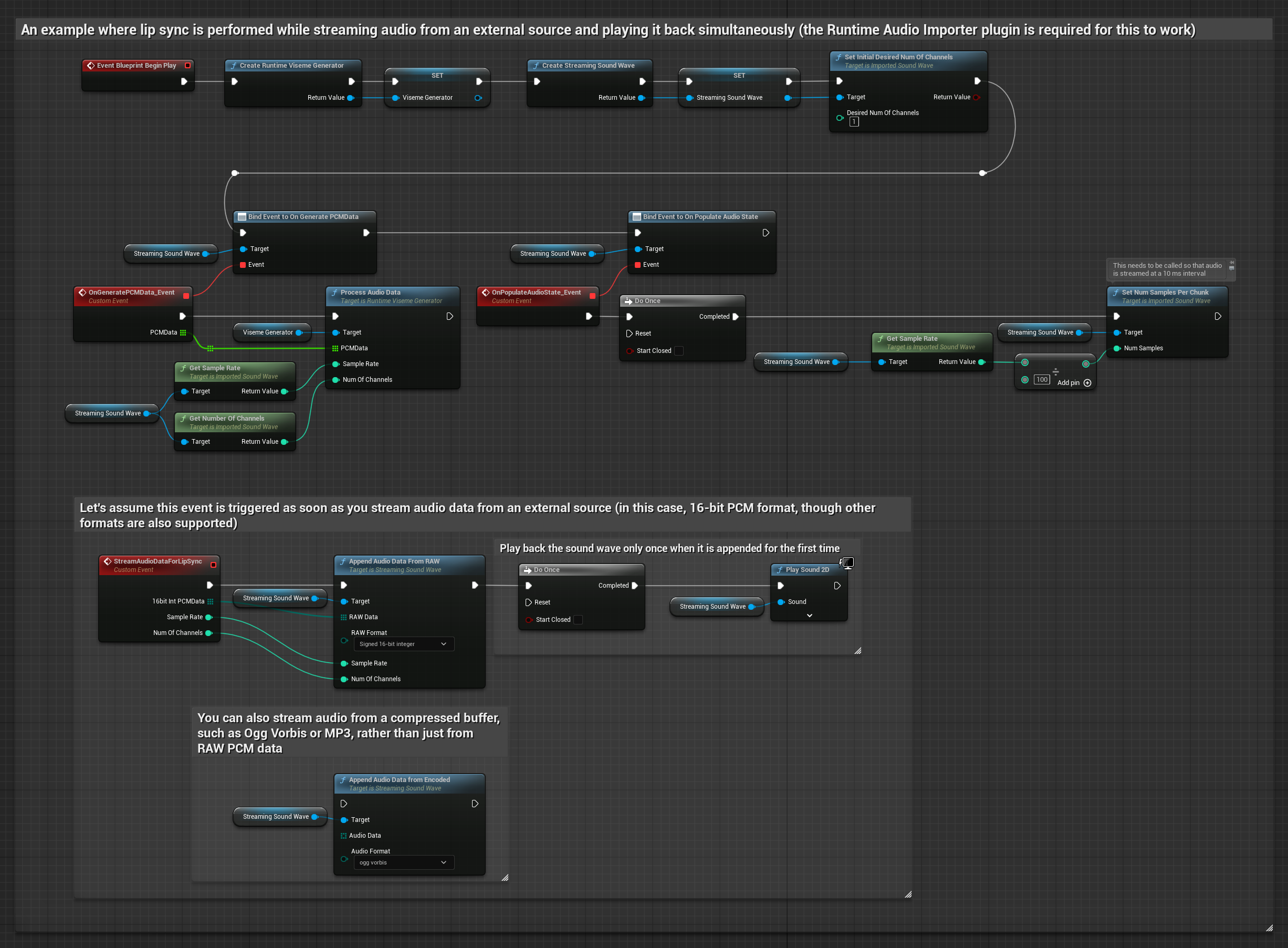

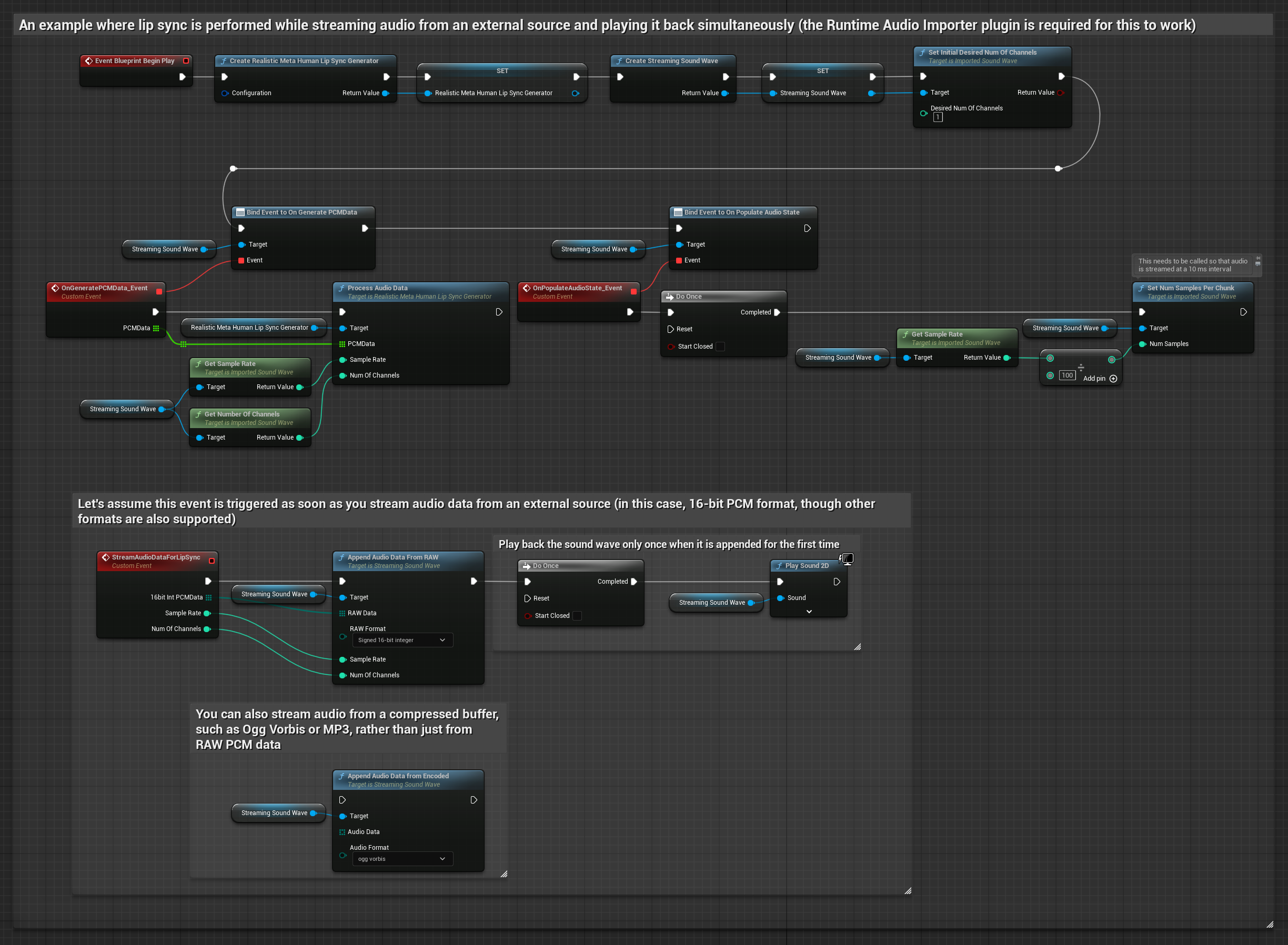

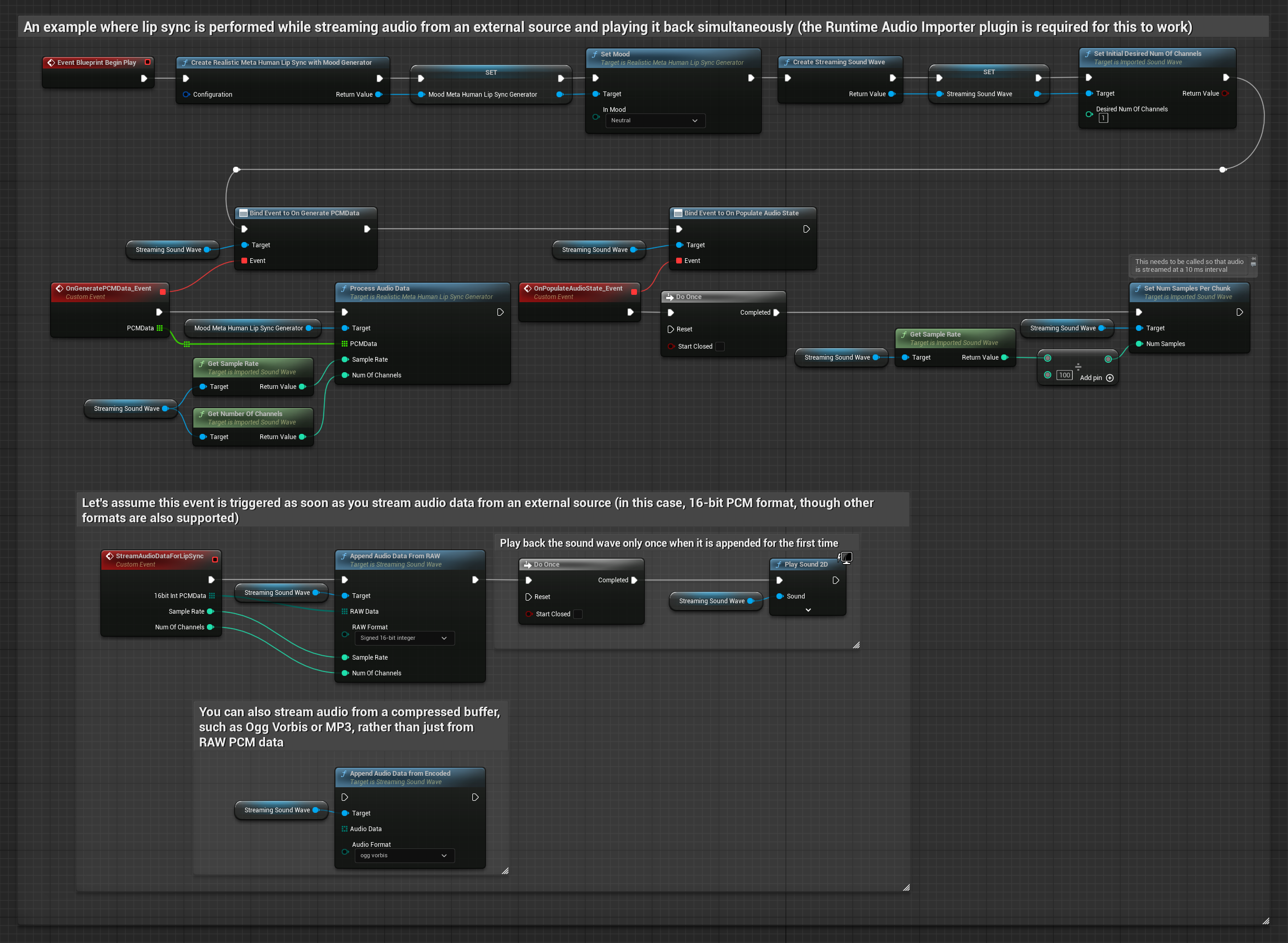

Für Streaming-Audiodaten aus einem Puffer benötigen Sie:

- Standard Model

- Realistic Model

- Mood-Enabled Realistic Model

- Audiodaten im Float-PCM-Format (ein Array von Fließkomma-Samples), verfügbar von Ihrer Streaming-Quelle (oder verwenden Sie Runtime Audio Importer, um weitere Formate zu unterstützen)

- Die Abtastrate und die Anzahl der Kanäle

- Rufen Sie

ProcessAudioDatavon Ihrem Runtime Viseme Generator mit diesen Parametern auf, sobald Audio-Chunks verfügbar werden

Das Realistic Model verwendet den gleichen Audioverarbeitungs-Workflow wie das Standard Model, jedoch mit der Variable RealisticLipSyncGenerator anstelle von VisemeGenerator.

Das Mood-Enabled Model verwendet den gleichen Audioverarbeitungs-Workflow, jedoch mit der Variable MoodMetaHumanLipSyncGenerator und zusätzlichen Mood-Konfigurationsmöglichkeiten.

Hinweis: Stellen Sie bei der Verwendung von Streaming-Audioquellen sicher, dass Sie die Audio-Wiedergabetiming angemessen verwalten, um verzerrte Wiedergabe zu vermeiden. Weitere Informationen finden Sie in der Streaming Sound Wave-Dokumentation.

Verarbeitungsleistungs-Tipps

-

Chunk-Größe: Das Erhöhen der

ProcessingChunkSize-Konfigurationsoption (z.B. auf 320, 480 oder 640 Samples) kann die Latenz spürbar verbessern, mit minimalen Auswirkungen auf Qualität oder Reaktionsfähigkeit. -

Modelltyp: Bei Verwendung von Realistic Models kann das Umschalten auf den Highly Optimized model type (standardmäßig ausgewählt) die Leistung verbessern. Beachten Sie, dass das Originalmodell möglicherweise eine etwas bessere Qualität liefert, insbesondere bei verrauschtem Audio.

-

Pufferverwaltung: Das mood-enabled model verarbeitet Audio in 320-Sample-Frames (20ms bei 16kHz). Stellen Sie sicher, dass Ihr Audioeingabe-Timing dafür optimiert ist.

-

Generator-Neuerstellung: Für einen zuverlässigen Betrieb mit Realistic Models erstellen Sie den Generator jedes Mal neu, wenn Sie nach einer Inaktivitätsphase neue Audiodaten zuführen möchten.

Nächste Schritte

Sobald Sie die Audioverarbeitung eingerichtet haben, möchten Sie vielleicht:

- Erfahren Sie mehr über Konfigurationsoptionen, um Ihr Lippen-Sync-Verhalten fein abzustimmen

- Lach-Animation für mehr Ausdruckskraft hinzufügen

- Lippen-Sync mit bestehenden Gesichtsanimationen kombinieren, indem Sie die im Konfigurationsleitfaden beschriebenen Layering-Techniken verwenden