Demo-Projekte

Um Ihnen den schnellen Einstieg mit Runtime MetaHuman Lip Sync zu erleichtern, stehen zwei sofort einsatzbereite Demo-Projekte zur Verfügung. Beide sind mit Unreal Engine 5.6+ erstellt, sind ausschließlich Blueprint-Projekte und laufen plattformübergreifend auf Windows, Mac, Linux, iOS, Android sowie auf Android-basierten Plattformen (einschließlich Meta Quest).

Verfügbare Demo-Projekte

- KI-Konversations-NPC / Interaktiver Avatar

- Grundlegende Lip-Sync-Demo

Ein vollständiger KI-Konversations-Avatar-Workflow, der Spracherkennung, einen KI-Chatbot (LLM), Text-zu-Sprache und Audiowiedergabe mit Echtzeit-Lippensynchronisation kombiniert – alles zusammen in einem einzigen Projekt. Geeignet für eine Vielzahl von Anwendungsfällen – darunter interaktive Kiosks, virtuelle Produktion, Museumsinstallationen, digitale Assistenten, Trainingssimulationen und Spiele.

Pipeline-Übersicht

🎤 Microphone → Speech Recognition → 💬 LLM Chatbot → 🔊 Text-to-Speech → 👄 Lip Sync + Playback

Videos

Schnellvorschau (~30 Sekunden)

Ein kurzer Einblick in die Demo in Aktion.

Vollständige exemplarische Vorgehensweise

Eine detaillierte Anleitung, die Einrichtung, Konfiguration und die gesamte Konversationspipeline abdeckt.

Downloads

Erforderliche und optionale Plugins

Das Demo-Projekt ist modular – Sie benötigen nur die Plugins für die Anbieter, die Sie verwenden möchten.

| Plugin | Zweck | Erforderlich? |

|---|---|---|

| Runtime MetaHuman Lip Sync | Lippensynchronisation-Animation | ✅ Immer |

| Runtime Audio Importer | Audioaufnahme und -verarbeitung | ✅ Immer |

| Runtime Speech Recognizer | Offline-Spracherkennung (whisper.cpp) | ✅ Immer |

| Runtime AI Chatbot Integrator | Externe LLMs (OpenAI, Claude, DeepSeek, Gemini, Grok, Ollama) und/oder externe TTS (OpenAI, ElevenLabs) | 🔶 Optional |

| Runtime Local LLM | Lokale LLM-Inferenz über llama.cpp (Llama, Mistral, Gemma usw., GGUF-Modelle) | 🔶 Optional |

| Runtime Text To Speech | Lokale TTS über Piper und Kokoro | 🔶 Optional |

Obwohl jedes der oben genannten Plugins einzeln optional ist, benötigen Sie mindestens einen LLM-Anbieter und mindestens einen TTS-Anbieter, damit die Demo funktioniert. Kombinieren Sie frei (z. B. lokales LLM + ElevenLabs TTS oder OpenAI LLM + lokales TTS).

Modulare Architektur

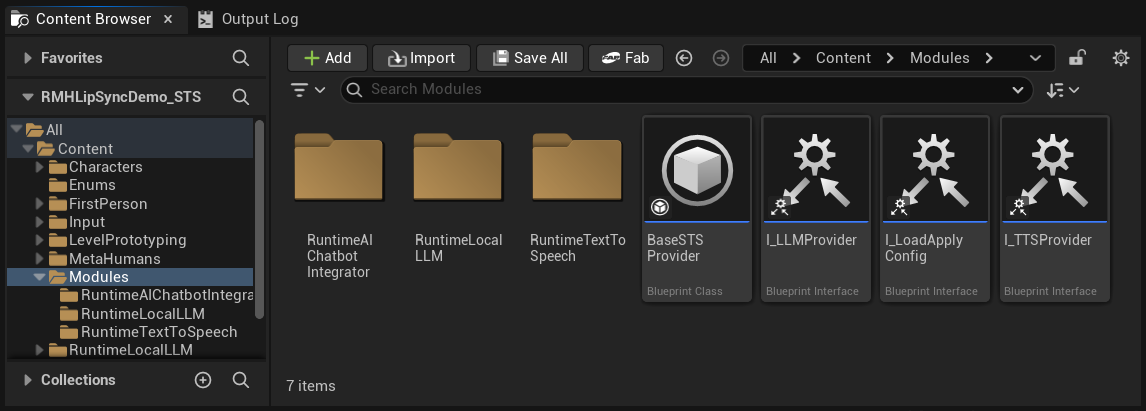

Im Content-Ordner finden Sie einen Modules-Ordner, der drei Unterordner enthält:

Content/

└── Modules/

├── RuntimeAIChatbotIntegrator/ ← External LLMs and/or external TTS

├── RuntimeLocalLLM/ ← Local LLM via llama.cpp

└── RuntimeTextToSpeech/ ← Local TTS via Piper/Kokoro

Wenn Sie eines (oder mehrere) der optionalen Plugins nicht erworben haben, löschen Sie einfach die entsprechenden Ordner. Die Basis-Assets des Demoprojekts (GameInstance, Widgets usw.) verweisen nicht direkt auf diese Module, sodass das Löschen keine Asset-Referenzfehler verursacht. Die Konfigurations-UI blendet automatisch jeden Anbieter aus, dessen Ordner fehlt.

Diese Modularität gilt nur für LLM- und TTS-Anbieter. Spracherkennung (Runtime Speech Recognizer) und Lippensynchronisation (Runtime MetaHuman Lip Sync) sind Teil des Basis-Demoprojekts und werden immer benötigt.

Beim ersten Start fragt Unreal möglicherweise, ob fehlende optionale Plugins deaktiviert werden sollen – klicken Sie auf Ja. Stellen Sie sicher, dass Sie auch den entsprechenden Content/Modules/-Ordner gelöscht haben (siehe oben).

Aufbau des Demoprojekts

Die unten gezeigte Benutzeroberfläche wurde vollständig mit UMG (Unreal Motion Graphics) erstellt und dient ausschließlich dazu, die Pipeline zu demonstrieren – Spracherkennung → LLM → TTS → Lippensynchronisation. Sie können sie jederzeit neu gestalten oder ersetzen, um sie an das visuelle Design, das Steuerungsschema oder die Plattform Ihres Projekts anzupassen (VR/AR, Mobilgeräte, Konsole, Kiosk usw.). Wenn bestimmte Widgets in Ihrem Anwendungsfall nicht benötigt werden, können Sie sie auch einfach ausblenden (z. B. Sichtbarkeit auf Collapsed oder Hidden setzen).

| Bereich | Was dort ist |

|---|---|

| Mitte | Der MetaHuman-Charakter. |

| Linke Seite | Vier Konfigurationsschaltflächen (Spracherkennung, KI-Chatbot, Text-to-Speech, Animationen), die unten im Detail beschrieben werden. |

| Untere Mitte | Eine Start Recording-Schaltfläche. Klicken Sie darauf, um eine Sprachkonversation zu starten: Ihr Mikrofon wird erfasst, transkribiert, an das LLM gesendet, die Antwort wird per TTS synthetisiert und mit Lip Sync abgespielt – vollständig freihändig. |

| Rechte Mitte | Ein Gesprächsverlauf-Widget, das den gesamten Dialog zwischen Ihnen und der KI anzeigt (Benutzer- und Assistenten-Nachrichten). Es enthält außerdem ein Texteingabefeld, sodass Sie Nachrichten direkt eingeben können, ohne Spracherkennung zu verwenden – nützlich zum Testen, für die Barrierefreiheit oder wenn kein Mikrofon verfügbar ist. |

Sie können beide Eingabemodi in derselben Sitzung beliebig kombinieren – sprechen Sie einige Nachrichten und tippen Sie andere.

Konfigurationsschaltflächen

Die vier Konfigurationsschaltflächen auf der linken Seite öffnen eigene Panels für jeden Teil der Pipeline:

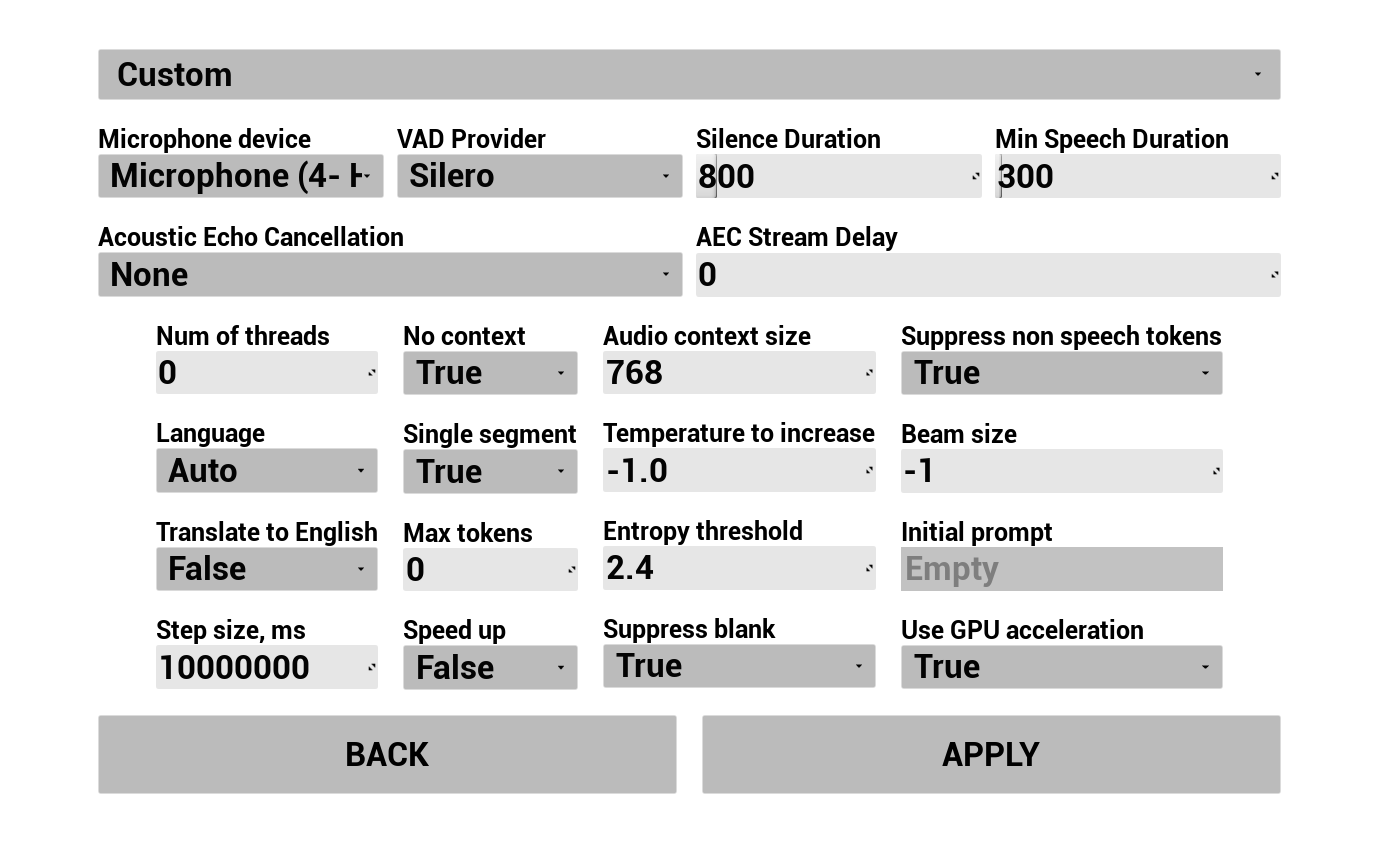

1. Spracherkennung konfigurieren

Konfigurieren Sie, wie die Stimme des Benutzers erfasst und transkribiert wird:

- Wählen Sie die Sprache aus

- Passen Sie die Parameter der Spracherkennung an (Whisper-Modelleinstellungen)

- Konfigurieren Sie die AEC (Akustische Echounterdrückung)

- Konfigurieren Sie die VAD (Sprachaktivitätserkennung)

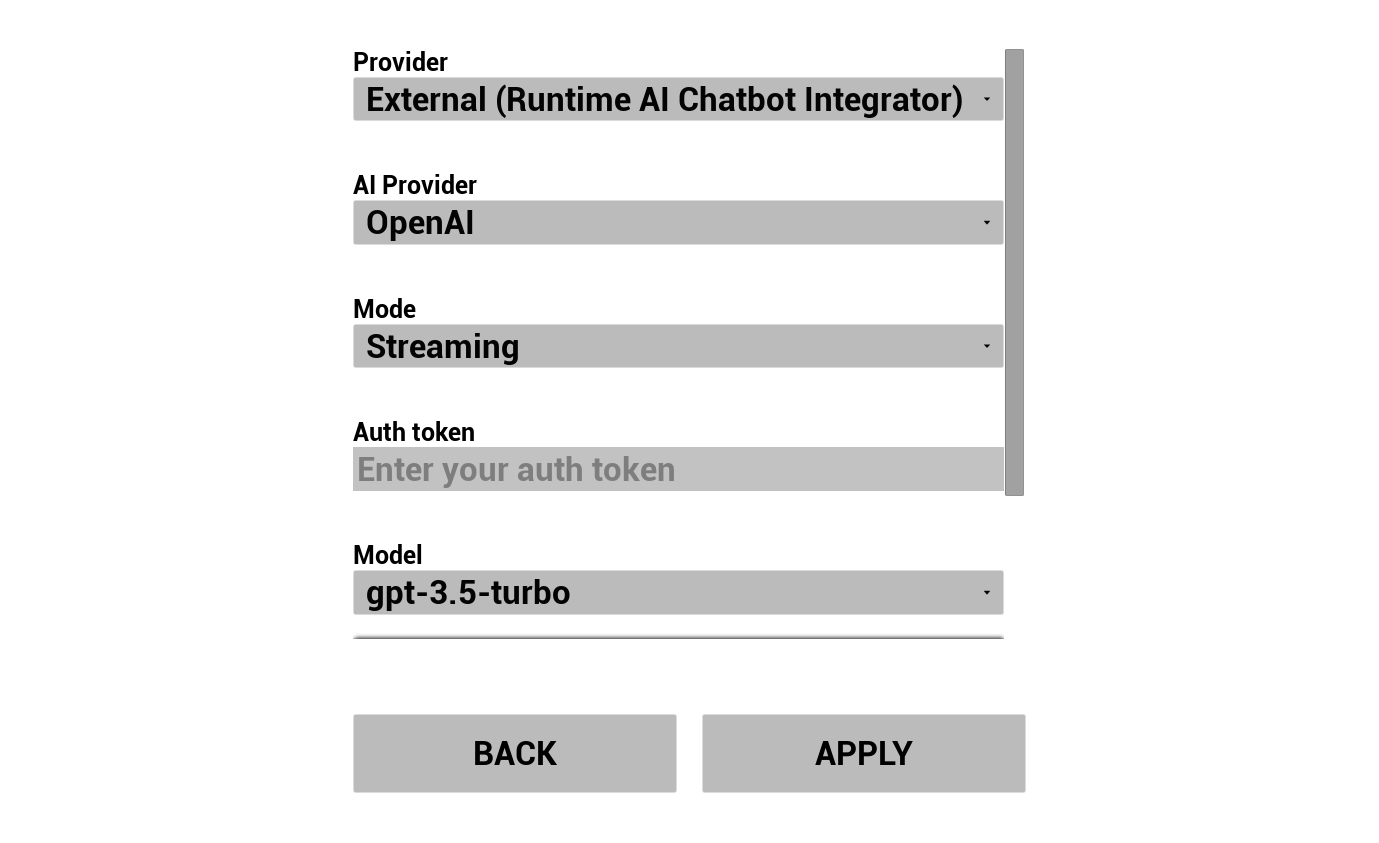

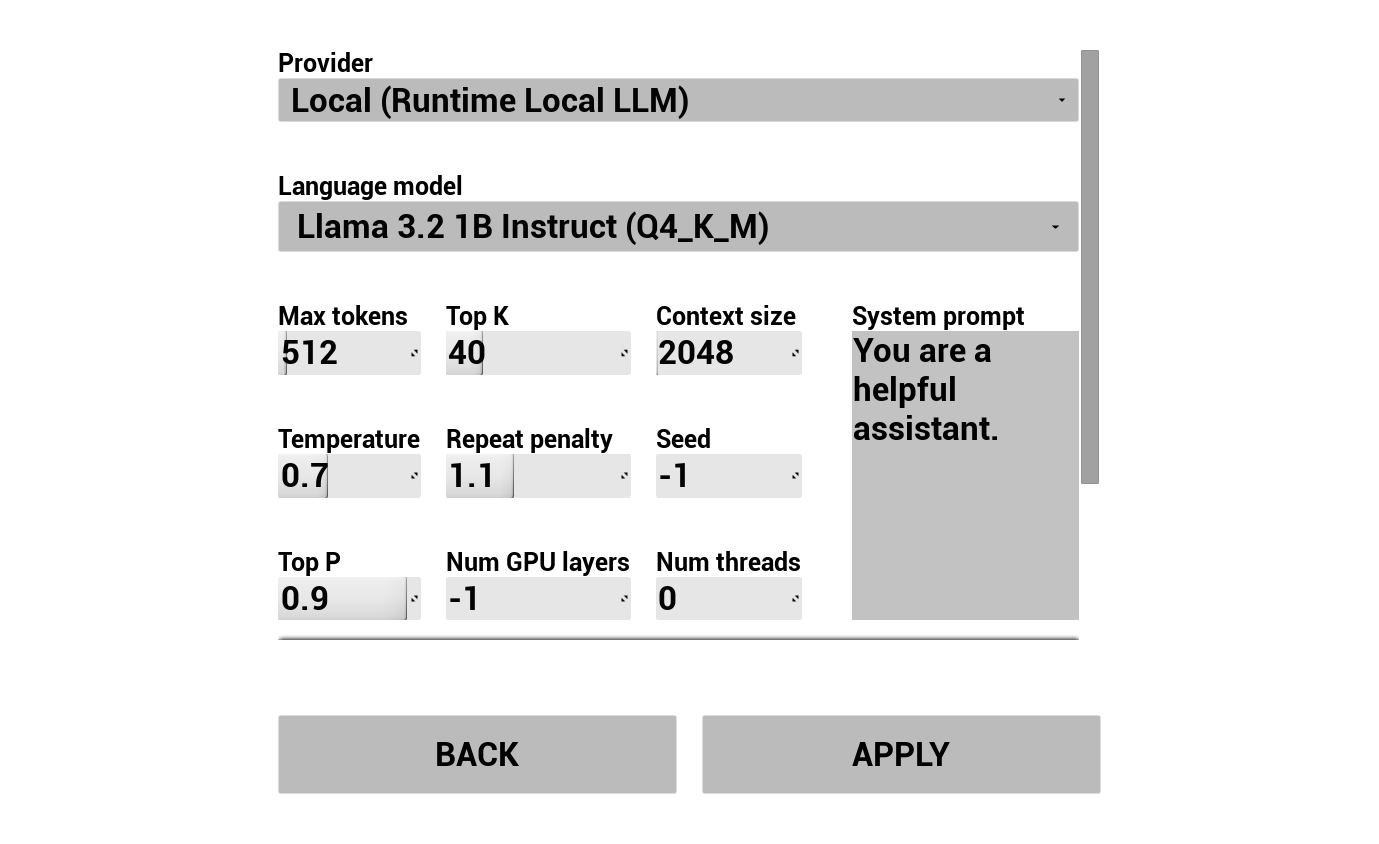

2. KI-Chatbot konfigurieren

Wählen Sie Ihren LLM-Anbieter und konfigurieren Sie ihn:

- Wählen Sie den Anbieter (Runtime AI Chatbot Integrator oder Runtime Local LLM)

- Für externe Anbieter: Auth-Token, Modellname, usw.

- Für lokale LLM: Wählen Sie ein GGUF-Modell, legen Sie die Kontextgröße und andere Inferenzparameter fest. Sie können auch Ihr eigenes GGUF-Modell zur Laufzeit herunterladen direkt aus der Demo (z. B. per URL) und es sofort verwenden, ohne das Projekt neu zu bauen.

Die Anbieter-Combobox zeigt nur Anbieter an, deren Plugin-Modulordner in Content/Modules/ vorhanden ist.

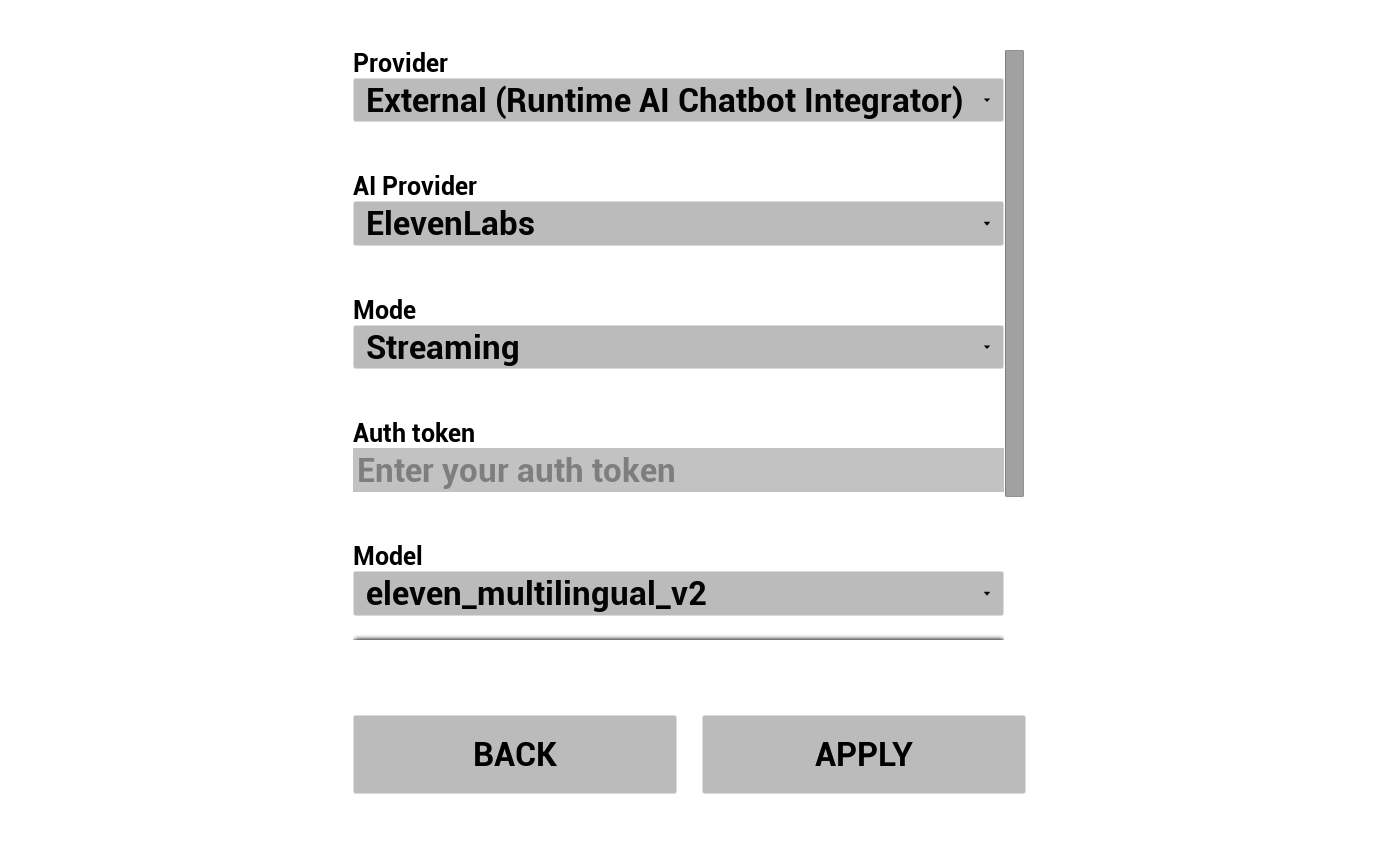

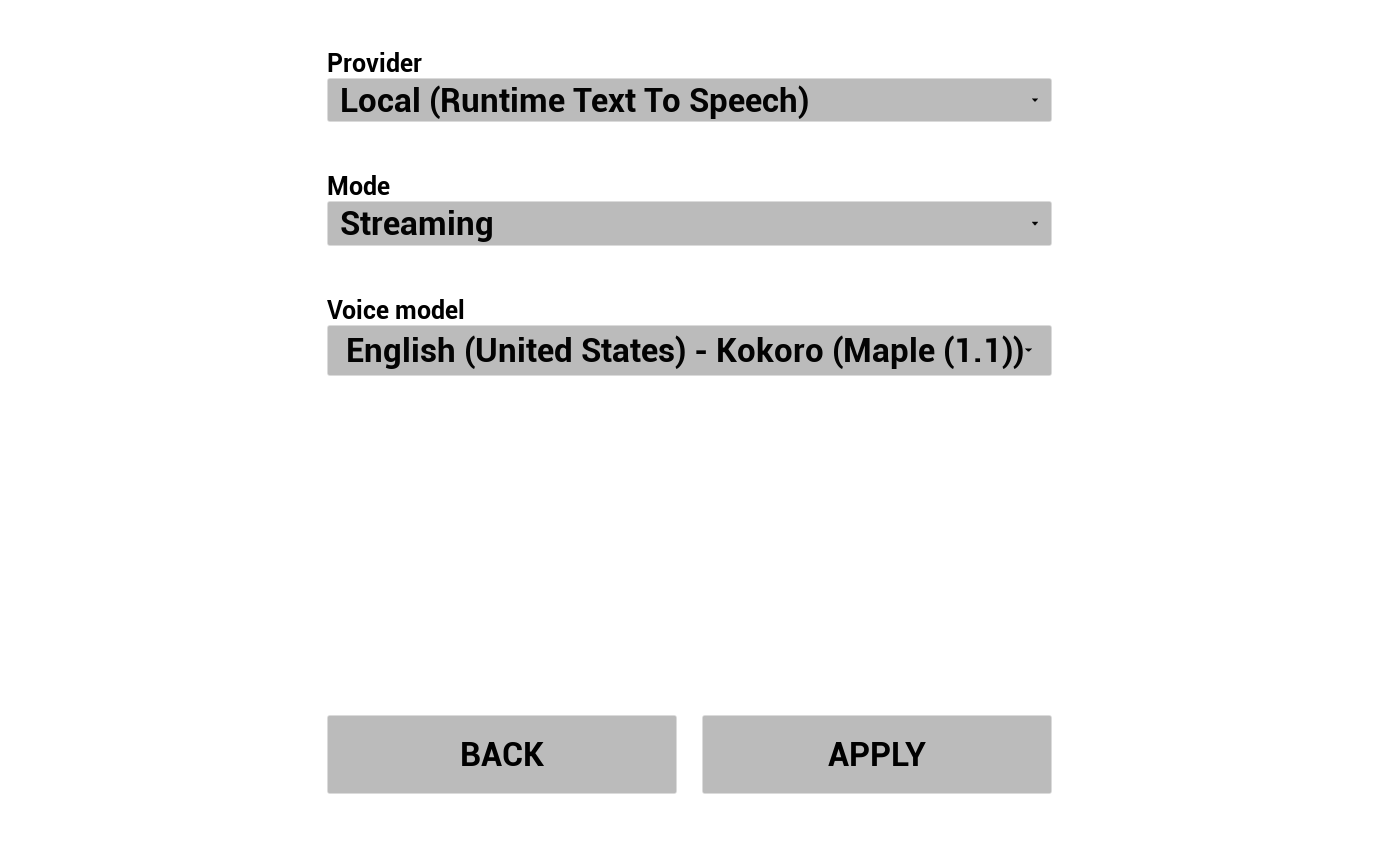

3. Text-To-Speech konfigurieren

Wählen Sie Ihren TTS-Anbieter und konfigurieren Sie Stimmen/Modelle:

- Wählen Sie den Anbieter (Runtime AI Chatbot Integrator für OpenAI/ElevenLabs oder Runtime Text To Speech für lokales Piper/Kokoro)

- Wählen Sie Stimme/Modell aus

- Passen Sie anbieterspezifische Parameter an

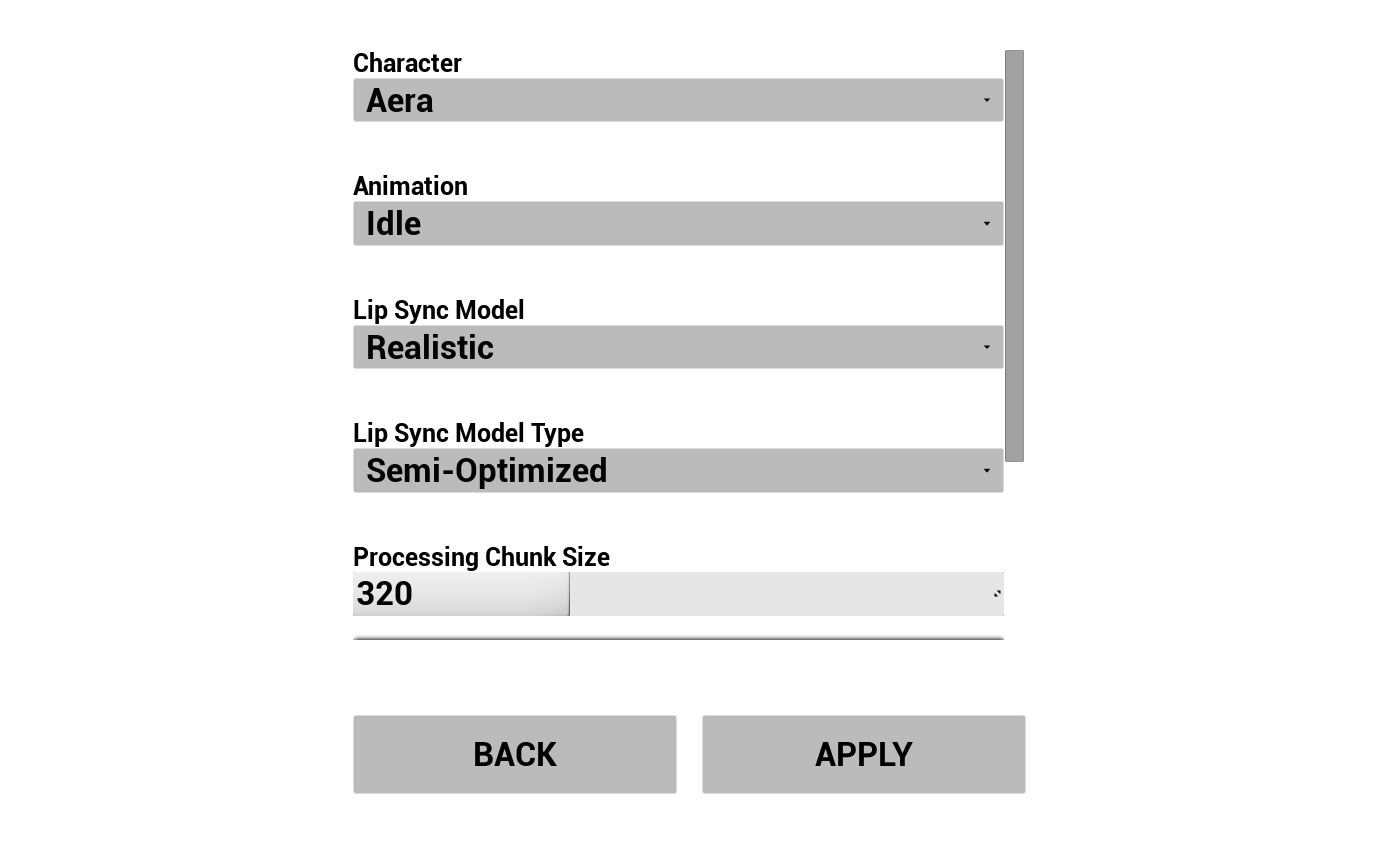

4. Animationen konfigurieren

Steuern Sie die visuelle Darstellung Ihres KI-Avatars:

- Wählen Sie zwischen 3 vorinstallierten MetaHuman-Charakteren (Aera, Ada, Orlando)

- Wählen Sie das Lip-Sync-Modell (Standard oder Realistic)

- Wählen Sie den Lip-Sync-Modelltyp – Highly Optimized, Semi-Optimized oder Original (siehe Modelltyp)

- Passen Sie die Processing Chunk Size an – steuert, wie oft die Lip-Sync-Inferenz ausgeführt wird (siehe Processing Chunk Size)

- Wählen Sie eine Idle-Animation aus, die auf dem MetaHuman während des Gesprächs abgespielt wird

Vorkonfiguration der Demo im Editor

Wenn Sie mit der Quellversion arbeiten, können Sie Standardwerte direkt im Editor vorbelegen, damit diese nicht bei jedem Lauf neu eingegeben werden müssen:

| Was | Wo |

|---|---|

| Allgemeine Einstellungen (Lip-Sync-Modell, Idle-Animation, Charakterklasse, Spracherkennung usw.) | Content/LipSyncSTSGameInstance |

| Externe LLM- / externe TTS-Einstellungen (Runtime AI Chatbot Integrator) | Content/Modules/RuntimeAIChatbotIntegrator/RuntimeAIChatbotIntegrator_Provider |

| Lokale LLM-Einstellungen (Runtime Local LLM) | Content/Modules/RuntimeLocalLLM/RuntimeLocalLLM_Provider |

| Lokale TTS-Einstellungen (Runtime Text To Speech) | Content/Modules/RuntimeTextToSpeech/RuntimeTextToSpeech_Provider |

Plattformübergreifende Hinweise

Alle von der Demo verwendeten Plugins unterstützen Windows, Mac, Linux, iOS, Android und Android-basierte Plattformen (einschließlich Meta Quest), sodass das Demoprojekt ebenfalls auf all diesen funktioniert. Dadurch eignet es sich für den Einsatz in einer Vielzahl von Umgebungen – von Desktop-Kiosken und browserbasierten Erlebnissen über mobile Apps und eigenständige VR-Headsets bis hin zu virtuellen Produktions-Setups am Set.

Für schwächere Geräte (Mobilgeräte, eigenständige VR) empfiehlt es sich:

- Verwenden Sie das Standard-Lip-Sync-Modell anstelle von Realistic – siehe Modellvergleich

- Wechseln Sie zum Modelltyp Highly Optimized

- Erhöhen Sie die Processing Chunk Size, um die CPU-Last zu reduzieren

- Wählen Sie kleinere LLM- / TTS-Modelle

Weitere Einrichtungsschritte für Android, iOS, Mac und Linux finden Sie unter Plattformspezifische Konfiguration.

Eigenen Charakter mitbringen

Das Demoprojekt wird mit drei Beispiel-MetaHuman-Charakteren (Aera, Ada, Orlando) ausgeliefert, aber Sie können Ihren eigenen MetaHuman importieren und in der Demo verwenden.

📺 Video-Tutorial: Hinzufügen eines benutzerdefinierten MetaHuman-Charakters zum Demoprojekt

Das Plugin Runtime MetaHuman Lip Sync selbst unterstützt viele andere Charaktersysteme über MetaHumans hinaus (ARKit-basierte Charaktere, Daz Genesis 8/9, Reallusion CC3/CC4, Mixamo, ReadyPlayerMe usw. – siehe Anleitung zur Einrichtung eigener Charaktere). Egal ob Sie einen Spiel-NPC, einen virtuellen Moderator, einen Kiosk-Assistenten oder einen digitalen Menschen für die virtuelle Produktion erstellen – das Plugin passt sich Ihrer Charakter-Pipeline an.

Ein einfacheres Demoprojekt, das sich ausschließlich auf das Lip-Sync-Feature konzentriert, ohne den vollständigen KI-Konversationsworkflow. Geeignet, wenn Sie nur Lip Sync in Aktion mit verschiedenen Audioquellen sehen möchten.

Vorgestelltes Video

Downloads

Enthaltene Funktionen

Diese Demo zeigt die grundlegenden Lip-Sync-Workflows:

- Mikrofoneingabe – Echtzeit-Lip-Sync von Live-Audio

- Audiodateiwiedergabe – Lip Sync von importierten Audiodateien

- Text-to-Speech – Lip Sync gesteuert durch synthetisierte Sprache

Erforderliche & optionale Plugins

| Plugin | Zweck | Erforderlich? |

|---|---|---|

| Runtime MetaHuman Lip Sync | Lip-Sync-Animation | ✅ Erforderlich |

| Runtime Audio Importer | Audio-Import & -Aufnahme | ✅ Erforderlich |

| Runtime Text To Speech | Lokales TTS für die TTS-Demo-Szene | 🔶 Optional |

| Runtime AI Chatbot Integrator | Externe TTS-Anbieter (OpenAI, ElevenLabs) | 🔶 Optional |

Hinweise zum Standard-Lip-Sync-Modell

Wenn Sie das Standard-Modell (anstatt Realistic) in einem der Demoprojekte verwenden möchten, müssen Sie das Standard Lip Sync Extension-Plugin installieren. Installationsanweisungen finden Sie unter Standard Model Extension.

Brauchen Sie Hilfe?

Wenn Sie beim Einrichten oder Ausführen der Demoprojekte auf Probleme stoßen, können Sie sich gerne melden:

Für individuelle Entwicklungsanfragen (z. B. Erweiterung der Demo mit eigener Logik, Anpassung für eine bestimmte Plattform oder Charakter-Pipeline) kontaktieren Sie [email protected].