Proyectos de demostración

Para ayudarte a empezar rápidamente con Runtime MetaHuman Lip Sync, hay dos proyectos de demostración listos para usar. Ambos están creados con Unreal Engine 5.6+, son proyectos exclusivamente con Blueprints y se ejecutan multiplataforma en Windows, Mac, Linux, iOS, Android y plataformas basadas en Android (incluido Meta Quest).

Proyectos de demostración disponibles

- AI Conversational NPC / Interactive Avatar

- Demo de sincronización labial básica

Un flujo de trabajo completo de avatar conversacional con IA que combina reconocimiento de voz, un chatbot de IA (LLM), texto a voz y reproducción de audio con sincronización labial en tiempo real, todo funcionando junto en un solo proyecto. Adecuado para una amplia gama de casos de uso — incluyendo quioscos interactivos, producción virtual, instalaciones de museos, asistentes digitales, simulaciones de entrenamiento y juegos.

Resumen del pipeline

🎤 Microphone → Speech Recognition → 💬 LLM Chatbot → 🔊 Text-to-Speech → 👄 Lip Sync + Playback

Vídeos

Vista previa rápida (~30 s)

Una breve muestra de la demo en acción.

Recorrido completo

Un recorrido detallado que cubre la configuración, la instalación y el flujo conversacional completo.

Descargas

Complementos requeridos y opcionales

El proyecto de demo es modular: solo necesitas los complementos de los proveedores que desees utilizar.

| Complemento | Propósito | ¿Requerido? |

|---|---|---|

| Runtime MetaHuman Lip Sync | Animación de sincronización labial | ✅ Siempre |

| Runtime Audio Importer | Captura y procesamiento de audio | ✅ Siempre |

| Runtime Speech Recognizer | Reconocimiento de voz sin conexión (whisper.cpp) | ✅ Siempre |

| Runtime AI Chatbot Integrator | LLMs externos (OpenAI, Claude, DeepSeek, Gemini, Grok, Ollama) y/o TTS externos (OpenAI, ElevenLabs) | 🔶 Opcional |

| Runtime Local LLM | Inferencia LLM local mediante llama.cpp (modelos GGUF de Llama, Mistral, Gemma, etc.) | 🔶 Opcional |

| Runtime Text To Speech | TTS local mediante Piper y Kokoro | 🔶 Opcional |

Aunque cada complemento anterior es individualmente opcional, necesitas al menos un proveedor LLM y al menos un proveedor TTS para que la demo funcione. Puedes combinar libremente (ej. LLM local + TTS de ElevenLabs, o LLM de OpenAI + TTS local).

Arquitectura modular

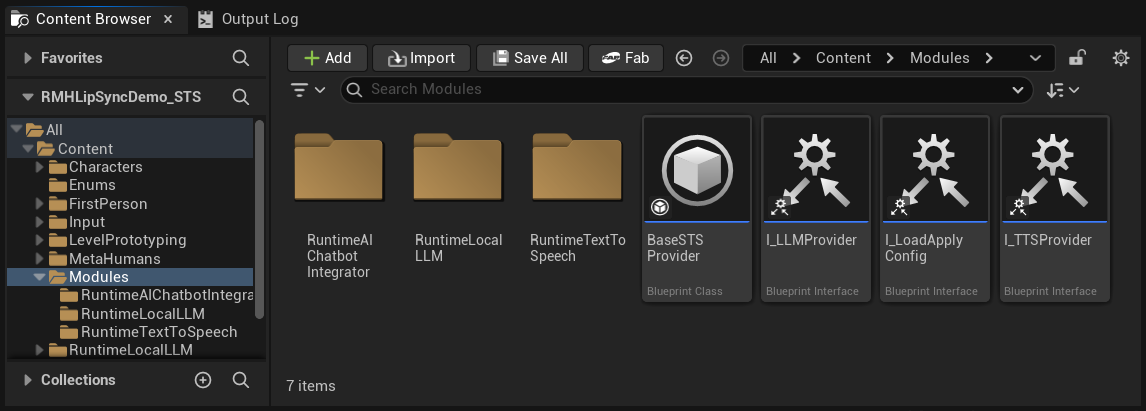

En la carpeta Content encontrarás una carpeta Modules que contiene tres subcarpetas:

Content/

└── Modules/

├── RuntimeAIChatbotIntegrator/ ← External LLMs and/or external TTS

├── RuntimeLocalLLM/ ← Local LLM via llama.cpp

└── RuntimeTextToSpeech/ ← Local TTS via Piper/Kokoro

Si no adquiriste uno (o más) de los complementos opcionales, simplemente elimina la(s) carpeta(s) correspondiente(s). Los assets base del proyecto de demostración (instancia del juego, widgets, etc.) no hacen referencia directa a estos módulos, por lo que eliminarlos no causará errores de referencia de assets. La UI de configuración ocultará automáticamente cualquier proveedor cuya carpeta no esté presente.

Esta modularidad se aplica solo a los proveedores de LLM y TTS. Reconocimiento de Voz (Runtime Speech Recognizer) y Sincronización labial (Runtime MetaHuman Lip Sync) son parte del proyecto demo base y siempre son necesarios.

Al iniciar por primera vez, Unreal puede preguntar si deseas deshabilitar los complementos opcionales que falten - haz clic en Yes. Asegúrate de haber eliminado también la carpeta Content/Modules/ correspondiente (ver arriba).

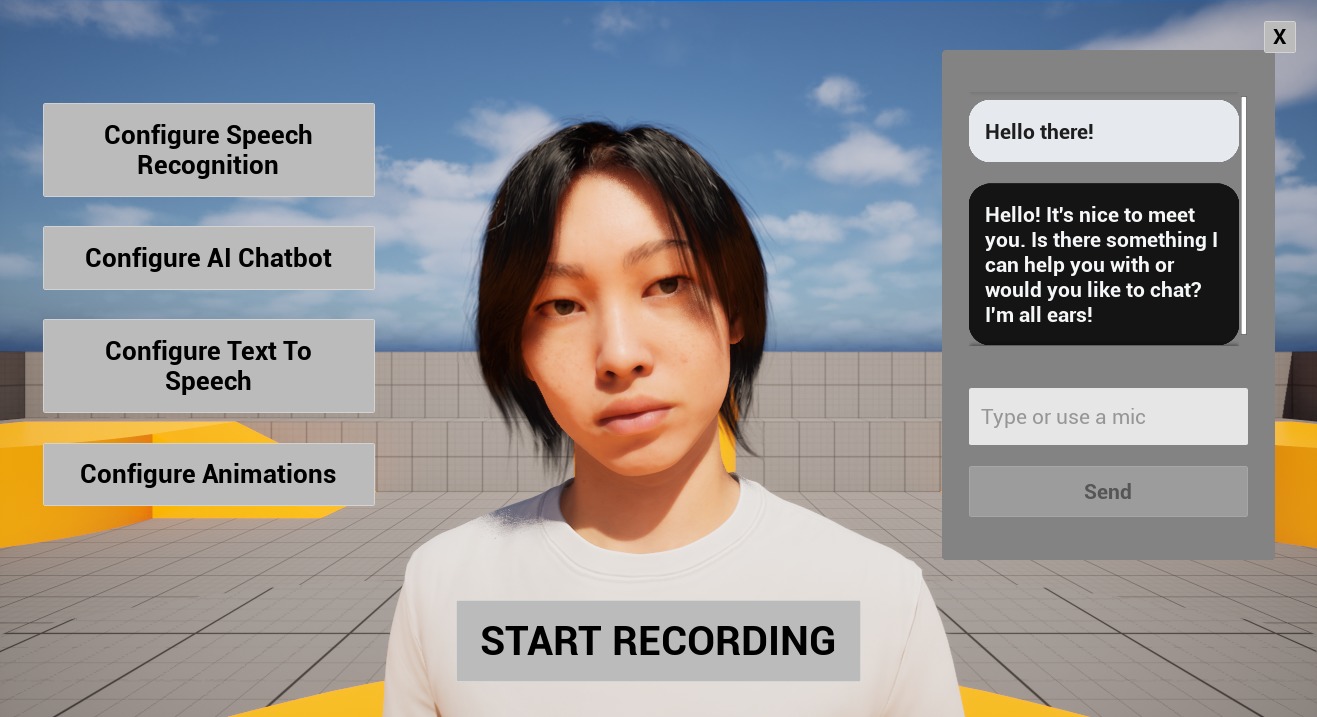

Estructura del proyecto demo

La interfaz de usuario mostrada a continuación está construida completamente con UMG (Unreal Motion Graphics) y está destinada únicamente a demostrar el pipeline - reconocimiento de voz → LLM → TTS → sincronización labial. Eres libre de rediseñarla o reemplazarla para que coincida con el diseño visual de tu proyecto, esquema de control o plataforma (VR/AR, móvil, consola, quiosco, etc.). Si ciertos widgets no son necesarios en tu caso de uso, también puedes ocultarlos (por ejemplo, establecer su visibilidad a Collapsed o Hidden).

| Área | Qué hay |

|---|---|

| Centro | El personaje MetaHuman. |

| Lado izquierdo | Cuatro botones de configuración (Reconocimiento de Voz, Chatbot de IA, Texto a Voz, Animaciones), descritos en detalle más abajo. |

| Centro inferior | Un botón Start Recording. Haz clic en él para iniciar una conversación por voz: tu micrófono se captura, se transcribe, se envía al LLM, la respuesta se sintetiza mediante TTS y se reproduce con sincronización labial, completamente manos libres. |

| Centro derecho | Un widget de historial de conversación que muestra el ida y vuelta completo entre tú y la IA (tanto mensajes del usuario como del asistente). También incluye un campo de entrada de texto, para que puedas escribir mensajes directamente sin usar reconocimiento de voz, útil para pruebas, accesibilidad o cuando no hay un micrófono disponible. |

Puedes mezclar ambos modos de entrada libremente en la misma sesión - habla algunos mensajes, escribe otros.

Botones de configuración

Los cuatro botones de configuración a la izquierda abren paneles dedicados para cada parte del pipeline:

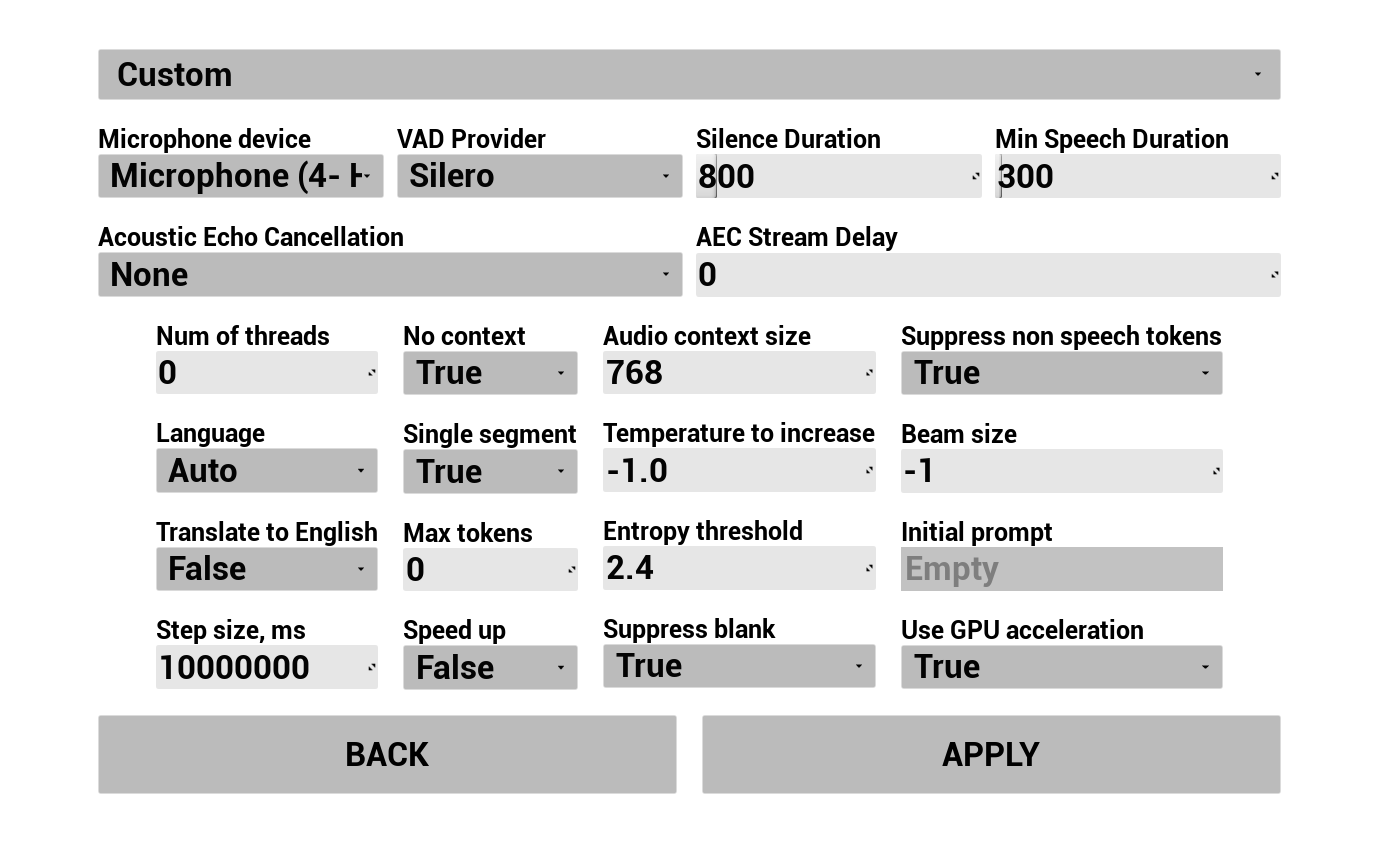

1. Configurar reconocimiento de voz

Configura cómo se captura y transcribe la voz del usuario:

- Selecciona el idioma

- Ajusta parámetros de reconocimiento de voz (configuración del modelo Whisper)

- Configura AEC (Cancelación de eco acústico)

- Configura VAD (Detección de actividad de voz)

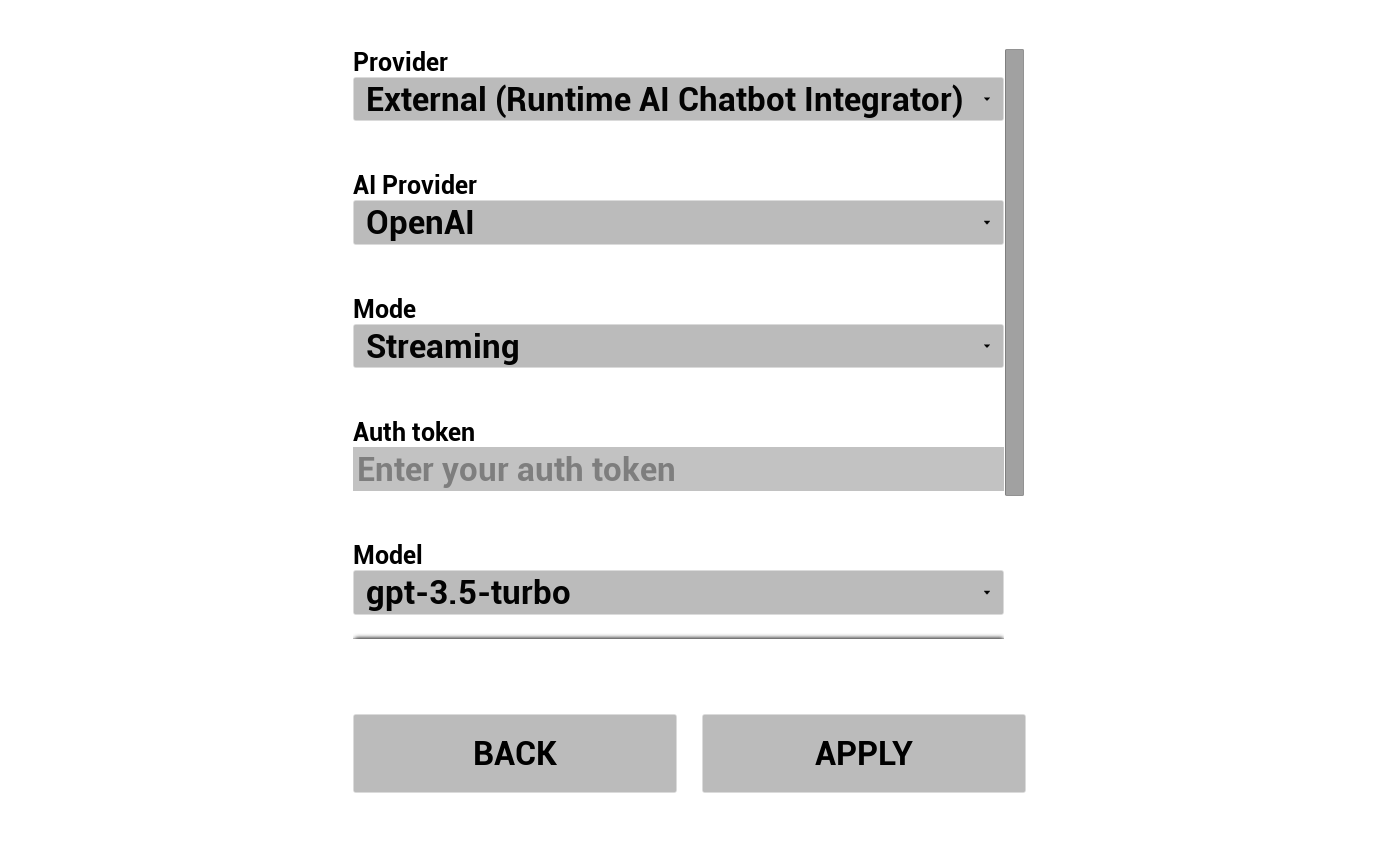

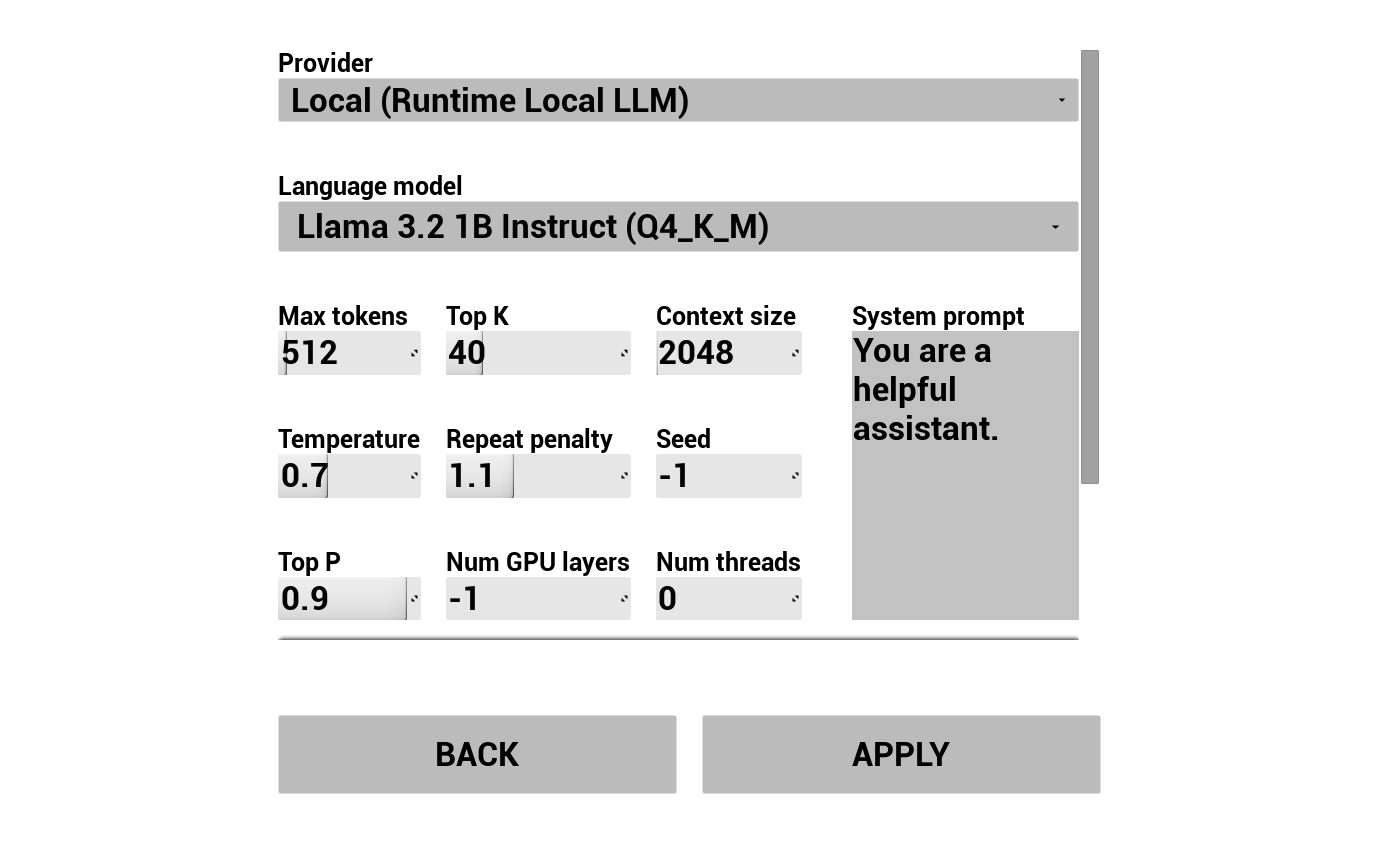

2. Configurar Chatbot de IA

Elige tu proveedor de LLM y configúralo:

- Selecciona proveedor (Runtime AI Chatbot Integrator o Runtime Local LLM)

- Para proveedores externos: token de autenticación, nombre del modelo, etc.

- Para LLM local: selecciona un modelo GGUF, establece tamaño de contexto y otros parámetros de inferencia. También puedes descargar tu propio modelo GGUF en tiempo de ejecución directamente desde el demo (por ejemplo, mediante URL), y usarlo inmediatamente sin reconstruir el proyecto.

El combobox de proveedor solo muestra los proveedores cuya carpeta de módulo del complemento está presente en Content/Modules/.

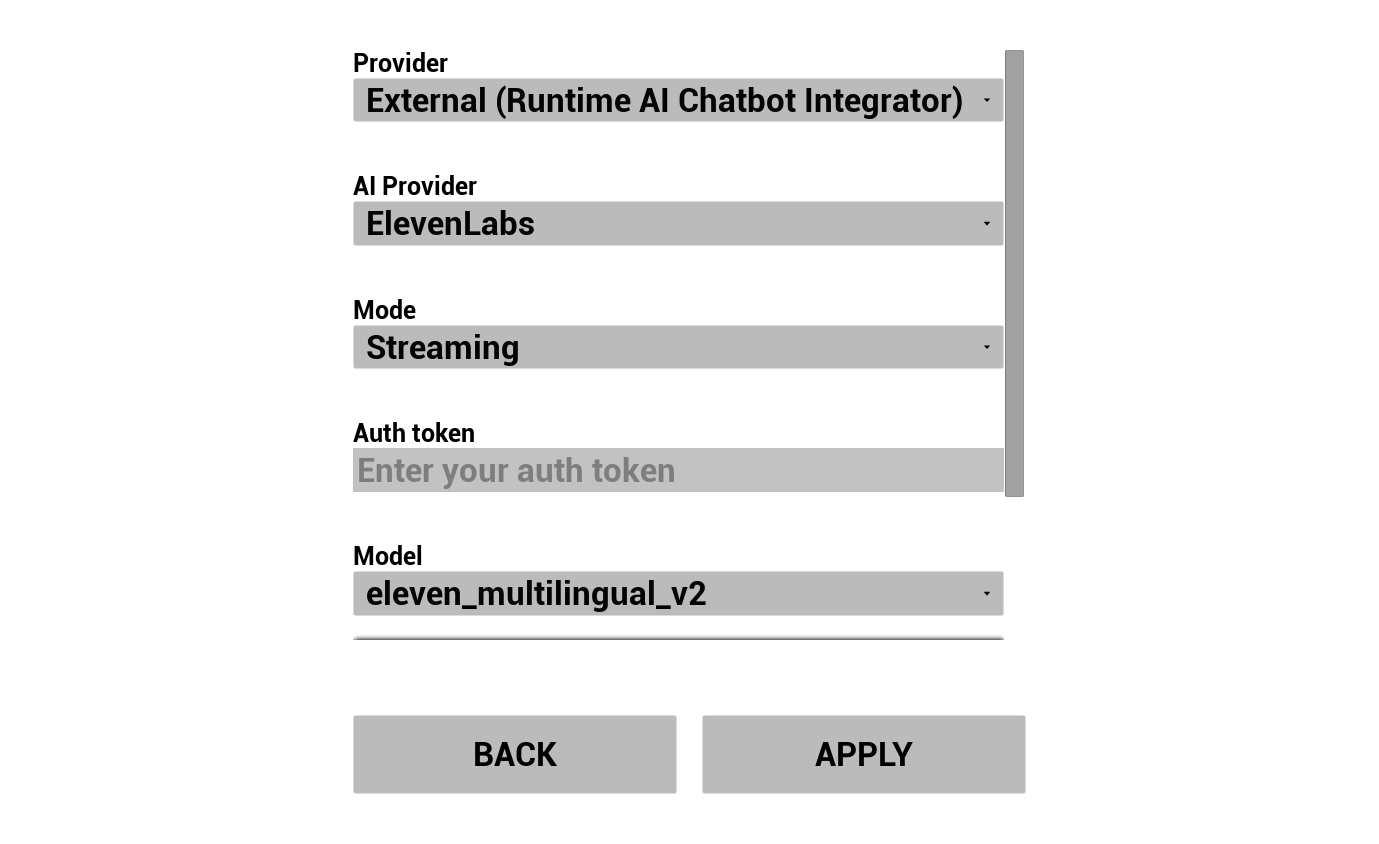

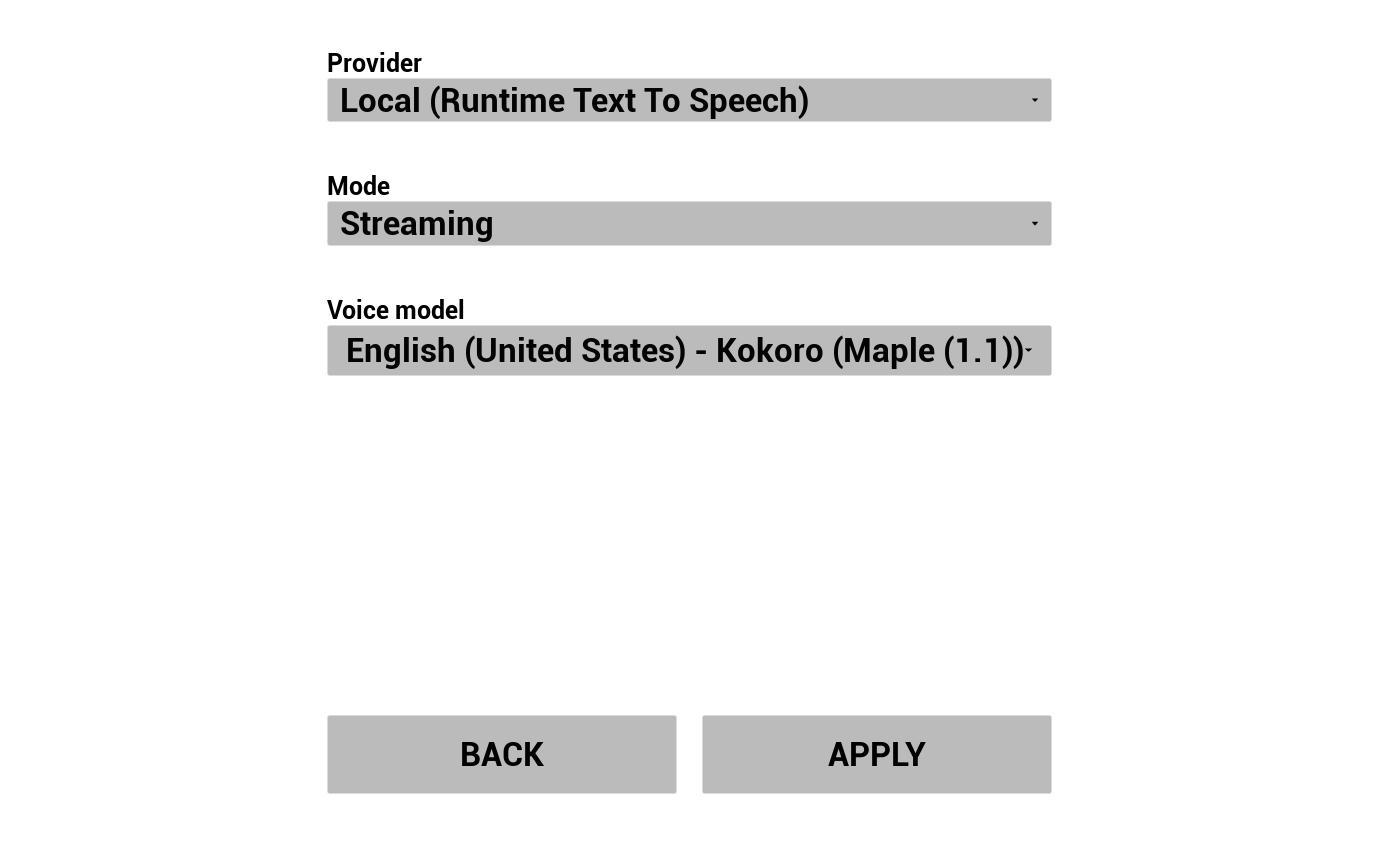

3. Configurar Texto a Voz

Elige tu proveedor de TTS y configura voces/modelos:

- Selecciona proveedor (Runtime AI Chatbot Integrator para OpenAI/ElevenLabs, o Runtime Text To Speech para Piper/Kokoro local)

- Selecciona voz/modelo

- Ajusta parámetros específicos del proveedor

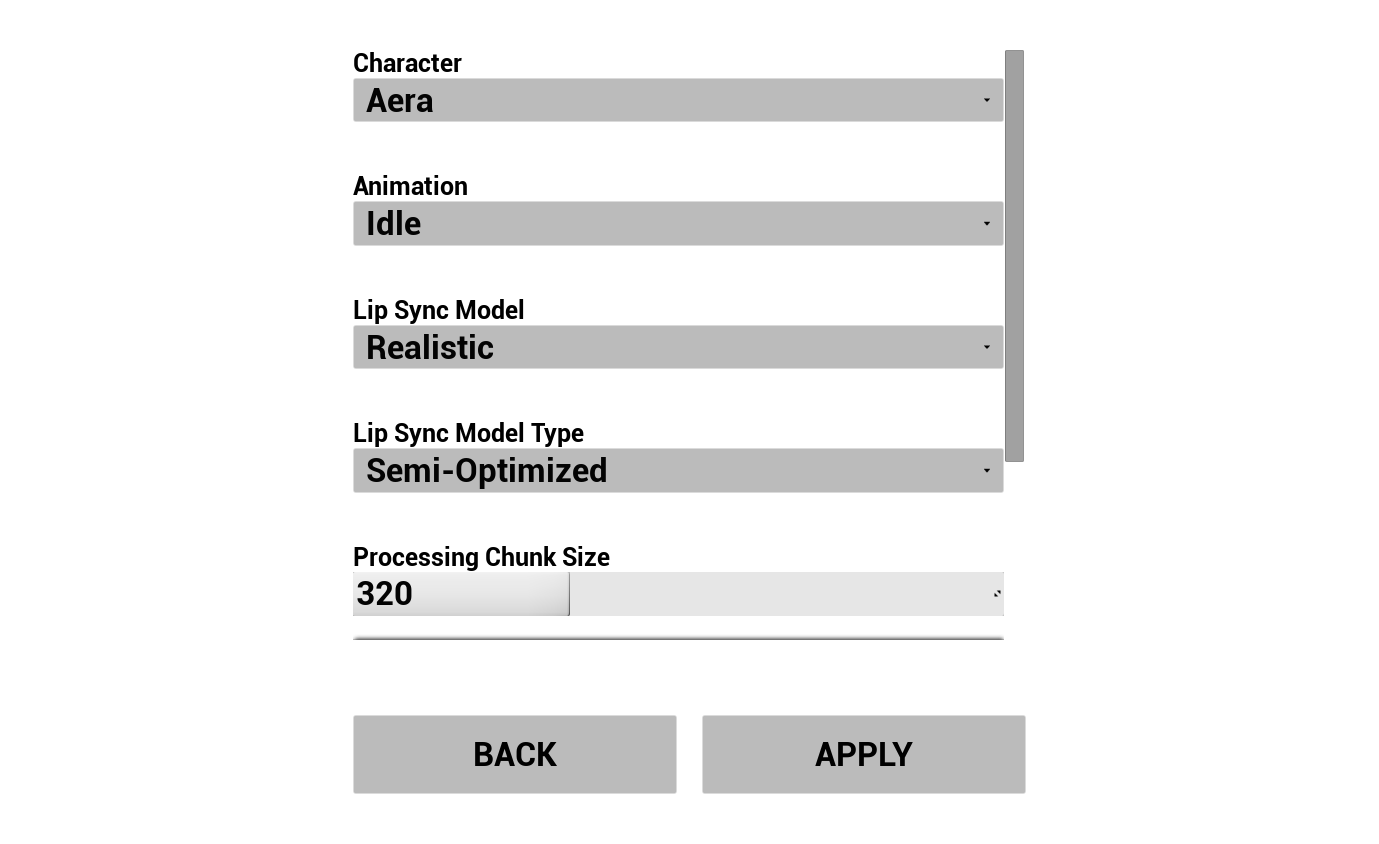

4. Configurar Animaciones

Controla las visuales de tu avatar de IA:

- Elige entre 3 personajes MetaHuman pre-descargados (Aera, Ada, Orlando)

- Selecciona modelo de sincronización labial (Estándar o Realista)

- Selecciona tipo de modelo de sincronización labial - Highly Optimized, Semi-Optimized u Original (ver Tipo de modelo)

- Ajusta Tamaño de fragmento de procesamiento - controla con qué frecuencia se ejecuta la inferencia de sincronización labial (ver Tamaño de fragmento de procesamiento)

- Selecciona una animación inactiva para reproducir en el MetaHuman durante la conversación

Preconfigurando el Demo en el Editor

Al trabajar con la versión fuente, puedes pre-llenar valores predeterminados directamente en el editor para que no necesites volver a introducirlos en cada ejecución:

| Qué | Dónde |

|---|---|

| Configuración general (modelo de sincronización labial, animación inactiva, clase de personaje, reconocimiento de voz, etc) | Content/LipSyncSTSGameInstance |

| Configuración de LLM externo / TTS externo (Runtime AI Chatbot Integrator) | Content/Modules/RuntimeAIChatbotIntegrator/RuntimeAIChatbotIntegrator_Provider |

| Configuración de LLM local (Runtime Local LLM) | Content/Modules/RuntimeLocalLLM/RuntimeLocalLLM_Provider |

| Configuración de TTS local (Runtime Text To Speech) | Content/Modules/RuntimeTextToSpeech/RuntimeTextToSpeech_Provider |

Notas multiplataforma

Todos los complementos utilizados por el demo son compatibles con Windows, Mac, Linux, iOS, Android y plataformas basadas en Android (incluyendo Meta Quest), por lo que el proyecto demo también funciona en todas ellas. Esto lo hace adecuado para despliegue en una amplia variedad de entornos — desde quioscos de escritorio y experiencias basadas en navegador hasta aplicaciones móviles, visores VR independientes y configuraciones de producción virtual en set.

Para dispositivos más débiles (móvil, VR independiente), quizás quieras:

- Usar el modelo de sincronización labial estándar en lugar del Realista - ver Comparación de modelos

- Cambiar al tipo de modelo Highly Optimized

- Aumentar el Tamaño de fragmento de procesamiento para reducir la carga de CPU

- Elegir modelos LLM / TTS más pequeños

Ver Configuración específica por plataforma para pasos adicionales de configuración en Android, iOS, Mac y Linux.

Traer tu propio personaje

El proyecto demo incluye tres personajes MetaHuman de muestra (Aera, Ada, Orlando), pero puedes importar tu propio MetaHuman y usarlo en el demo.

📺 Video tutorial: Añadir un personaje MetaHuman personalizado al proyecto demo

El complemento Runtime MetaHuman Lip Sync en sí mismo soporta muchos otros sistemas de personajes más allá de MetaHumans (personajes basados en ARKit, Daz Genesis 8/9, Reallusion CC3/CC4, Mixamo, ReadyPlayerMe, etc - ver la Guía de configuración de personajes personalizados). Ya sea que estés construyendo un NPC de juego, un presentador virtual, un asistente de quiosco o un humano digital para producción virtual, el complemento se adapta a tu pipeline de personajes.

Un proyecto demo más sencillo que se enfoca puramente en la característica de sincronización labial en sí, sin el flujo de trabajo conversacional completo de IA. Adecuado si solo quieres ver la sincronización labial en acción con varias fuentes de audio.

Video destacado

Descargas

Qué incluye

Este demo muestra los flujos de trabajo básicos de sincronización labial:

- Entrada de micrófono - sincronización labial en tiempo real desde audio en vivo

- Reproducción de archivo de audio - sincronización labial desde archivos de audio importados

- Texto a voz - sincronización labial impulsada por voz sintetizada

Complementos requeridos y opcionales

| Complemento | Propósito | ¿Requerido? |

|---|---|---|

| Runtime MetaHuman Lip Sync | Animación de sincronización labial | ✅ Requerido |

| Runtime Audio Importer | Importación y captura de audio | ✅ Requerido |

| Runtime Text To Speech | TTS local para la escena de demo TTS | 🔶 Opcional |

| Runtime AI Chatbot Integrator | Proveedores de TTS externos (OpenAI, ElevenLabs) | 🔶 Opcional |

Notas para el modelo de sincronización labial estándar

Si planeas usar el Modelo Estándar (en lugar del Realista) en cualquiera de los proyectos demo, necesitarás instalar el complemento Standard Lip Sync Extension. Consulta Extensión del modelo estándar para obtener instrucciones de instalación.

¿Necesitas ayuda?

Si encuentras algún problema al configurar o ejecutar los proyectos demo, no dudes en contactarnos:

Para solicitudes de desarrollo personalizado (p. ej., ampliar la demo con tu propia lógica, adaptarla para una plataforma específica o un pipeline de personajes), contacta con [email protected].