Paramètres d'inférence

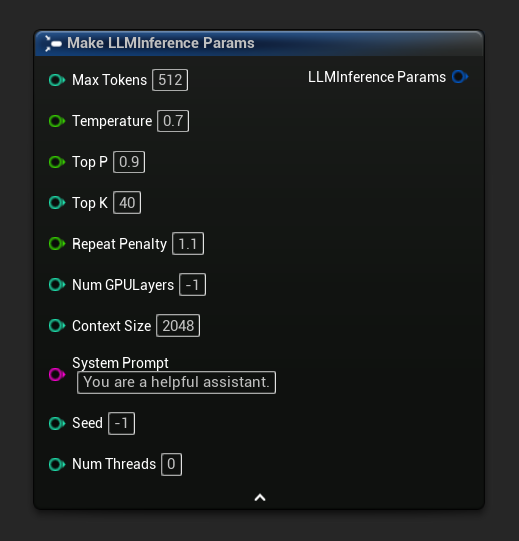

La structure LLM Inference Parameters contrôle comment le modèle charge et génère du texte. Vous transmettez ces paramètres lors du chargement d'un modèle. Cette page décrit chaque paramètre et son effet.

Référence des paramètres

| Paramètre | Type | Par défaut | Plage | Description |

|---|---|---|---|---|

| Max Tokens | int32 | 512 | 1–8192 | Nombre maximum de jetons à générer dans une seule réponse |

| Temperature | float | 0.7 | 0.0–2.0 | Contrôle l'aléa. 0.0 = déterministe. Valeurs plus élevées = sortie plus créative |

| Top P | float | 0.9 | 0.0–1.0 | Échantillonnage par noyau. Seuls les jetons dont la probabilité cumulée dépasse cette valeur sont considérés |

| Top K | int32 | 40 | 0–200 | Limite la sélection aux K jetons les plus probables. 0 = désactivé |

| Repeat Penalty | float | 1.1 | 0.0–3.0 | Pénalise les jetons qui apparaissent déjà dans la sortie. 1.0 = aucune pénalité |

| Num GPU Layers | int32 | -1 | -1–200 | Couches de modèle à transférer vers le GPU. -1 = automatique. 0 = CPU uniquement |

| Context Size | int32 | 2048 | 128–131072 | Taille maximale de la fenêtre de contexte en jetons. Les valeurs plus grandes utilisent plus de mémoire |

| System Prompt | FString | "You are a helpful assistant." | — | Instruction système qui façonne le comportement du modèle |

| Seed | int32 | -1 | -1+ | Graine aléatoire pour une sortie reproductible. -1 = aléatoire |

| Num Threads | int32 | 0 | 0–128 | Threads CPU pour la génération. 0 = automatique |

Utilisation

- Blueprint

- C++

Les paramètres d'inférence apparaissent sous forme de broche de struct sur les nœuds de chargement et asynchrones. Utilisez Break sur la structure pour définir des valeurs individuelles :

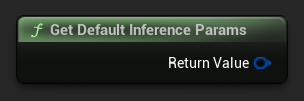

Pour obtenir un ensemble de paramètres par défaut comme point de départ, utilisez Get Default Inference Params :

// Creative writing

FLLMInferenceParams CreativeParams;

CreativeParams.MaxTokens = 1024;

CreativeParams.Temperature = 1.2f;

CreativeParams.TopP = 0.95f;

CreativeParams.TopK = 80;

CreativeParams.RepeatPenalty = 1.2f;

CreativeParams.SystemPrompt = TEXT("You are a creative storyteller.");

// Factual / deterministic

FLLMInferenceParams FactualParams;

FactualParams.MaxTokens = 256;

FactualParams.Temperature = 0.1f;

FactualParams.TopP = 0.5f;

FactualParams.TopK = 10;

FactualParams.SystemPrompt = TEXT("Answer questions concisely and accurately.");

// Mobile-optimized

FLLMInferenceParams MobileParams;

MobileParams.MaxTokens = 128;

MobileParams.ContextSize = 1024;

MobileParams.NumGPULayers = 0;

MobileParams.NumThreads = 4;

MobileParams.SystemPrompt = TEXT("You are a helpful assistant. Keep responses brief.");

// Get defaults programmatically

FLLMInferenceParams DefaultParams = URuntimeLocalLLM::GetDefaultInferenceParams();

Recommandations de plate-forme

Mobile / VR (Android, iOS, Meta Quest)

- Context Size : 1 024–2 048

- Num GPU Layers : 0 (CPU uniquement) sauf si l’appareil dispose d’un support de calcul GPU confirmé

- Max Tokens : Moins de 256 pour des interactions réactives

- Num Threads : 2–4 selon l’appareil

Desktop (Windows, Mac, Linux)

- Context Size : 2 048–8 192 pour la plupart des conversations

- Num GPU Layers : -1 (auto) pour exploiter l’accélération GPU lorsqu’elle est disponible

- Num Threads : 0 (auto)

- Max Tokens : 512–2 048 pour des réponses plus longues