Projets de démonstration

Pour vous aider à démarrer rapidement avec Runtime MetaHuman Lip Sync, deux projets de démonstration prêts à l'emploi sont disponibles. Les deux sont construits avec Unreal Engine 5.6+, sont uniquement Blueprint et fonctionnent de manière multiplateforme sur Windows, Mac, Linux, iOS, Android et les plateformes basées sur Android (y compris Meta Quest).

Projets de démonstration disponibles

- PNJ Conversationnel IA / Avatar Interactif

- Démo Lip Sync Basique

Un flux de travail complet d'avatar conversationnel utilisant l'IA combinant la reconnaissance vocale, un chatbot IA (LLM), la synthèse vocale et la lecture audio avec synchronisation labiale en temps réel - le tout fonctionnant ensemble dans un seul projet. Convient à une grande variété de cas d'utilisation — y compris les bornes interactives, la production virtuelle, les installations muséales, les assistants numériques, les simulations de formation et les jeux.

Aperçu du pipeline

🎤 Microphone → Speech Recognition → 💬 LLM Chatbot → 🔊 Text-to-Speech → 👄 Lip Sync + Playback

Vidéos

Aperçu rapide (~30 s)

Une courte démonstration de la démo en action.

Visite guidée complète

Une visite guidée détaillée couvrant l'installation, la configuration et l'ensemble du pipeline conversationnel.

Téléchargements

Plugins requis et optionnels

Le projet de démonstration est modulaire - vous n'avez besoin que des plugins pour les fournisseurs que vous souhaitez utiliser.

| Plugin | Objectif | Requis ? |

|---|---|---|

| Runtime MetaHuman Lip Sync | Animation de synchronisation labiale | ✅ Toujours |

| Runtime Audio Importer | Capture et traitement audio | ✅ Toujours |

| Runtime Speech Recognizer | Reconnaissance vocale hors ligne (whisper.cpp) | ✅ Toujours |

| Runtime AI Chatbot Integrator | LLM externes (OpenAI, Claude, DeepSeek, Gemini, Grok, Ollama) et/ou TTS externes (OpenAI, ElevenLabs) | 🔶 Optionnel |

| Runtime Local LLM | Inférence de LLM local via llama.cpp (Llama, Mistral, Gemma, etc., modèles GGUF) | 🔶 Optionnel |

| Runtime Text To Speech | TTS local via Piper et Kokoro | 🔶 Optionnel |

Bien que chaque plugin ci-dessus soit individuellement optionnel, vous avez besoin d'au moins un fournisseur de LLM et d'au moins un fournisseur de TTS pour que la démo fonctionne. Mélangez et associez librement (par exemple, LLM local + TTS ElevenLabs, ou LLM OpenAI + TTS local).

Architecture modulaire

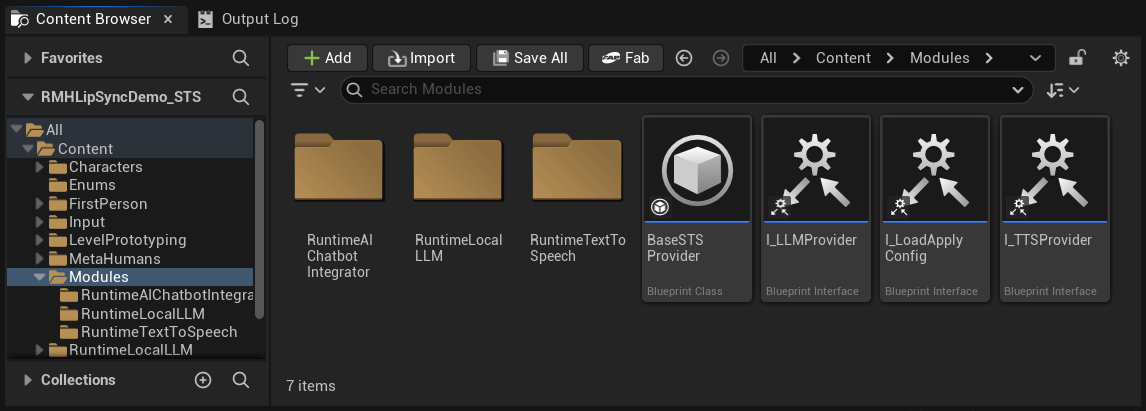

Dans le dossier Content, vous trouverez un dossier Modules qui contient trois sous-dossiers :

Content/

└── Modules/

├── RuntimeAIChatbotIntegrator/ ← External LLMs and/or external TTS

├── RuntimeLocalLLM/ ← Local LLM via llama.cpp

└── RuntimeTextToSpeech/ ← Local TTS via Piper/Kokoro

Si vous n'avez pas acquis un (ou plusieurs) des plugins optionnels, supprimez simplement le(s) dossier(s) correspondant(s). Les assets de base du projet de démonstration (instance de jeu, widgets, etc.) ne référencent pas directement ces modules, leur suppression ne provoquera donc pas d'erreurs de référence d'asset. L'interface de configuration masquera automatiquement tout fournisseur dont le dossier est absent.

Cette modularité s'applique uniquement aux fournisseurs de LLM et de TTS. La Reconnaissance vocale (Runtime Speech Recognizer) et le Lip Sync (Runtime MetaHuman Lip Sync) font partie du projet de démonstration de base et sont toujours requis.

Au premier lancement, Unreal peut vous demander si vous souhaitez désactiver les plugins optionnels manquants - cliquez sur Yes. Assurez-vous également d'avoir supprimé le dossier correspondant Content/Modules/ (voir ci-dessus).

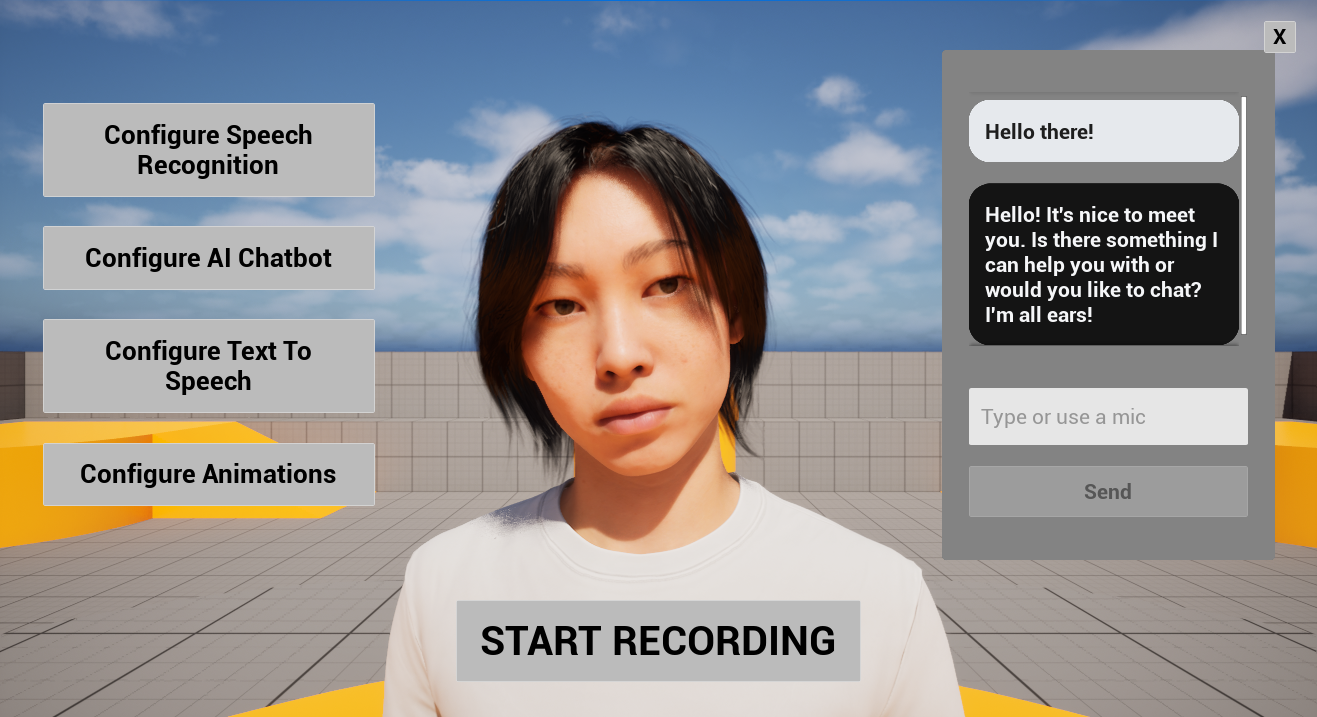

Structure du projet de démonstration

L'interface utilisateur présentée ci-dessous est entièrement construite avec UMG (Unreal Motion Graphics) et a pour seul but de démontrer le pipeline - reconnaissance vocale → LLM → TTS → lip sync. Vous êtes libre de la restructurer ou de la remplacer pour l'adapter au design visuel, au schéma de contrôle ou à la plateforme de votre projet (VR/AR, mobile, console, borne interactive, etc.). Si certains widgets ne sont pas nécessaires dans votre cas d'usage, vous pouvez également les masquer simplement (par exemple en réglant leur visibilité sur Collapsed ou Hidden).

| Zone | Ce qui s'y trouve |

|---|---|

| Centre | Le personnage MetaHuman. |

| Côté gauche | Quatre boutons de configuration (Reconnaissance vocale, Chatbot IA, Synthèse vocale, Animations), décrits en détail ci-dessous. |

| Centre en bas | Un bouton Démarrer l'enregistrement. Cliquez dessus pour démarrer une conversation vocale : votre microphone est capturé, transcrit, envoyé au LLM, la réponse est synthétisée par TTS et lue avec le lip sync, le tout en mode mains libres. |

| Centre droit | Un widget d'historique de conversation affichant la totalité des échanges entre vous et l'IA (messages de l'utilisateur et de l'assistant). Il comporte également un champ de saisie de texte qui vous permet de taper des messages directement sans utiliser la reconnaissance vocale, pratique pour les tests, l'accessibilité ou lorsqu'aucun microphone n'est disponible. |

Vous pouvez mélanger librement les deux modes de saisie dans une même session - prononcer certains messages, en taper d'autres.

Boutons de configuration

Les quatre boutons de configuration à gauche ouvrent des panneaux dédiés à chaque partie du pipeline :

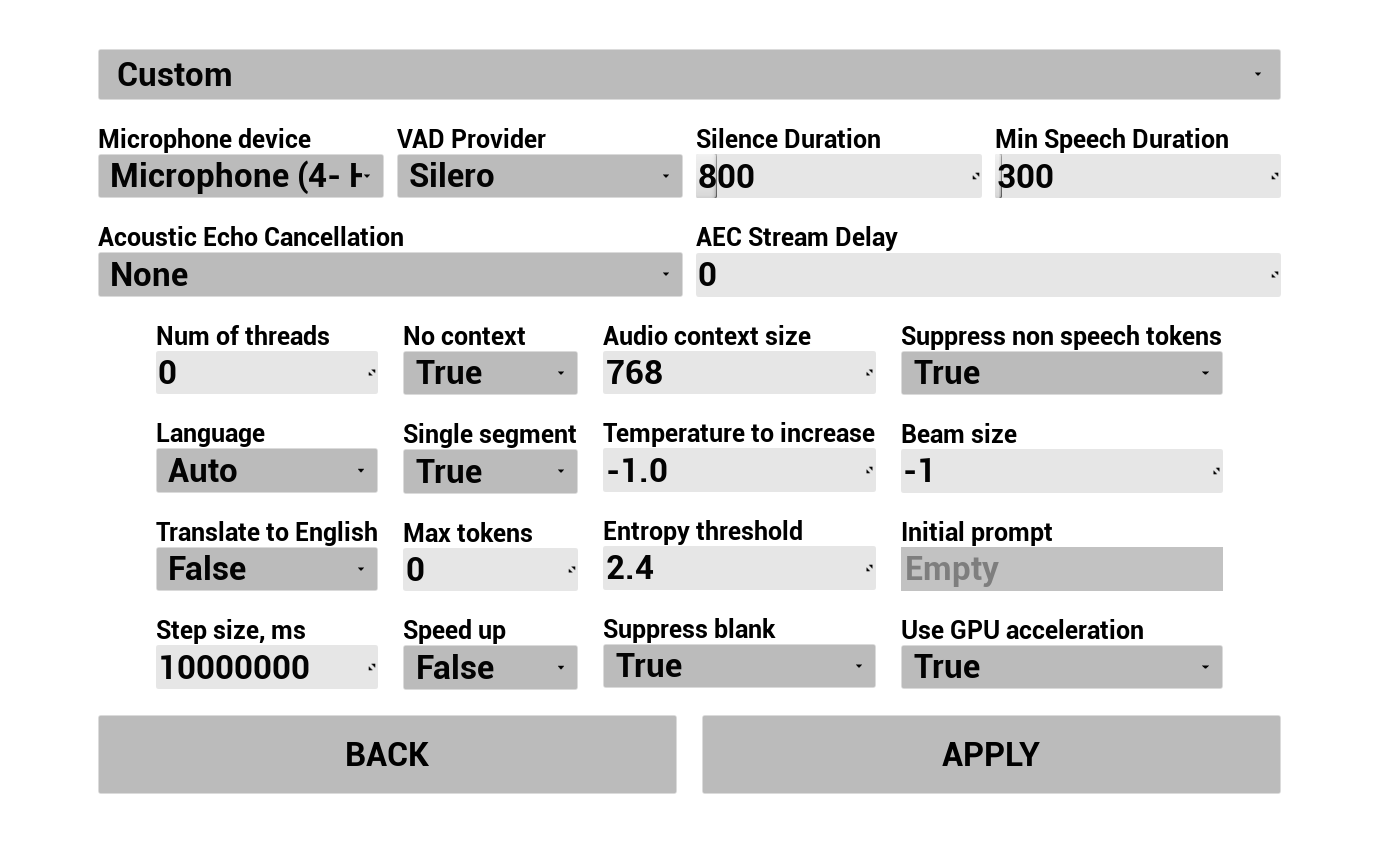

1. Configurer la Reconnaissance vocale

Configurez la manière dont la voix de l'utilisateur est capturée et transcrite :

- Sélectionner la langue

- Ajuster les paramètres de reconnaissance vocale (paramètres du modèle Whisper)

- Configurer l'AEC (Annulation d'Écho Acoustique)

- Configurer la VAD (Détection d'Activité Vocale)

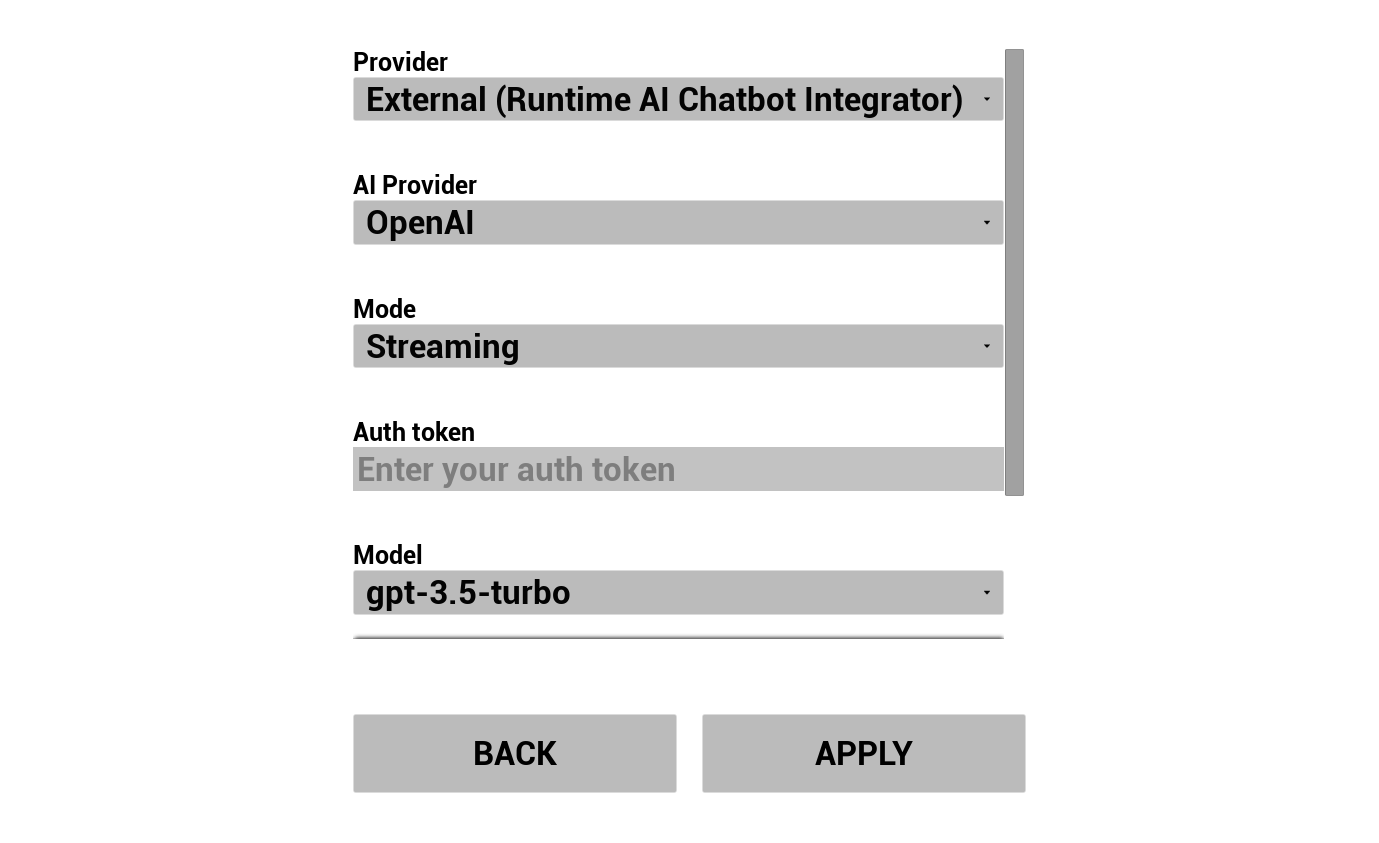

2. Configurer le Chatbot IA

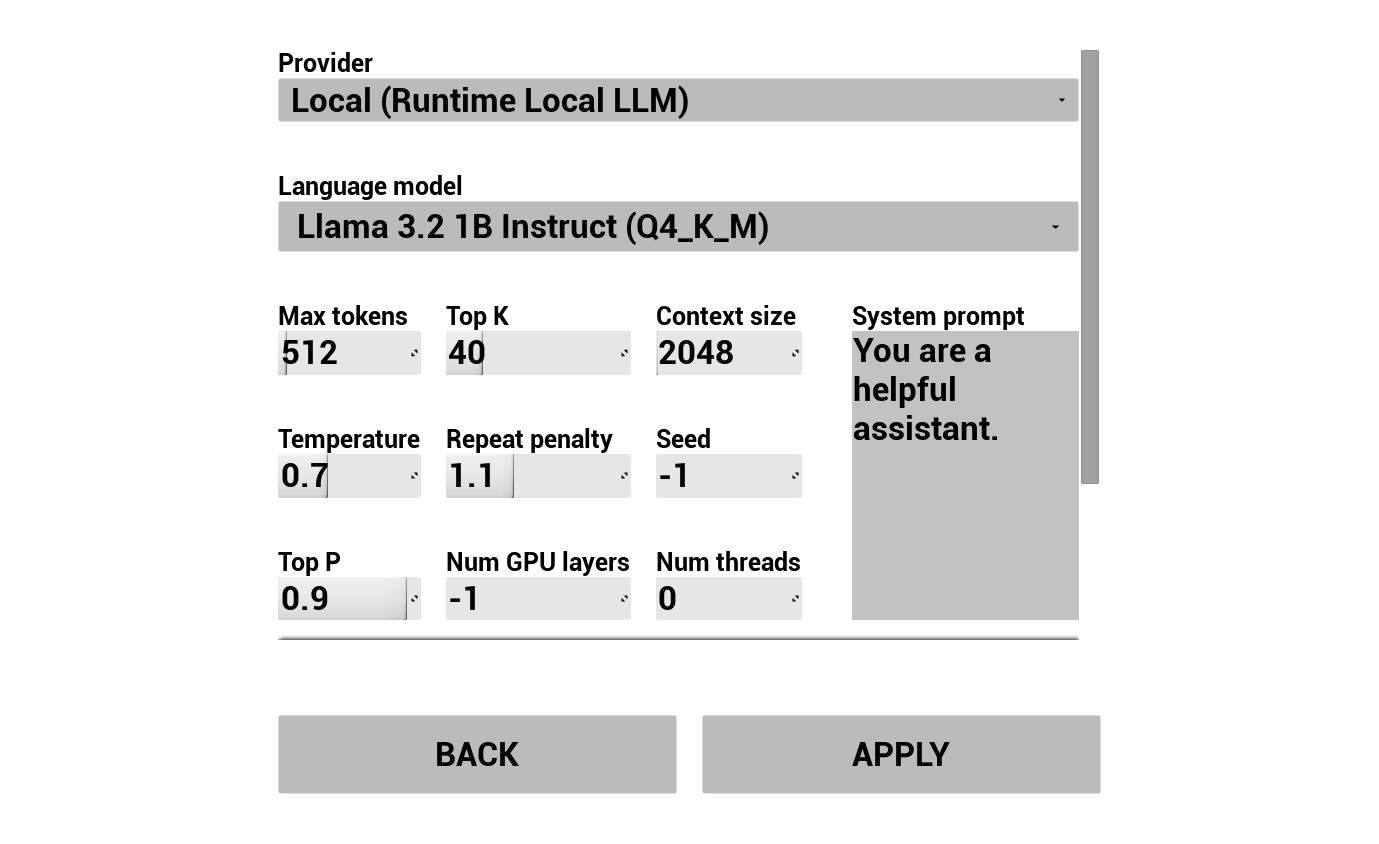

Choisissez votre fournisseur de LLM et configurez-le :

- Sélectionner un fournisseur (Runtime AI Chatbot Integrator ou Runtime Local LLM)

- Pour les fournisseurs externes : jeton d'authentification, nom du modèle, etc.

- Pour le LLM local : sélectionner un modèle GGUF, définir la taille du contexte et d'autres paramètres d'inférence. Vous pouvez également télécharger votre propre modèle GGUF à l'exécution directement depuis la démo (par exemple via une URL) et l'utiliser immédiatement sans avoir à reconstruire le projet.

La liste déroulante des fournisseurs n'affiche que ceux dont le dossier du module de plugin est présent dans Content/Modules/.

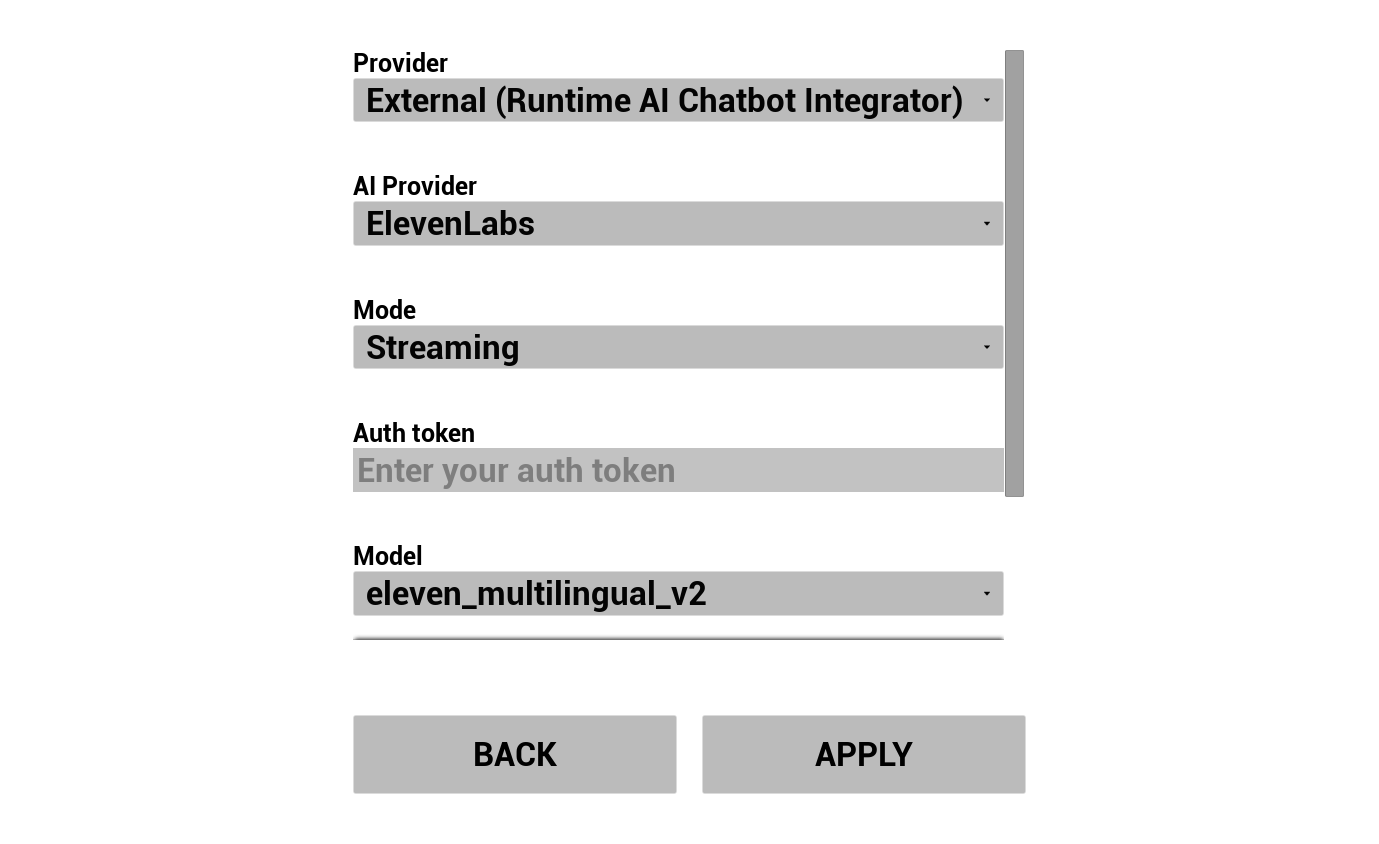

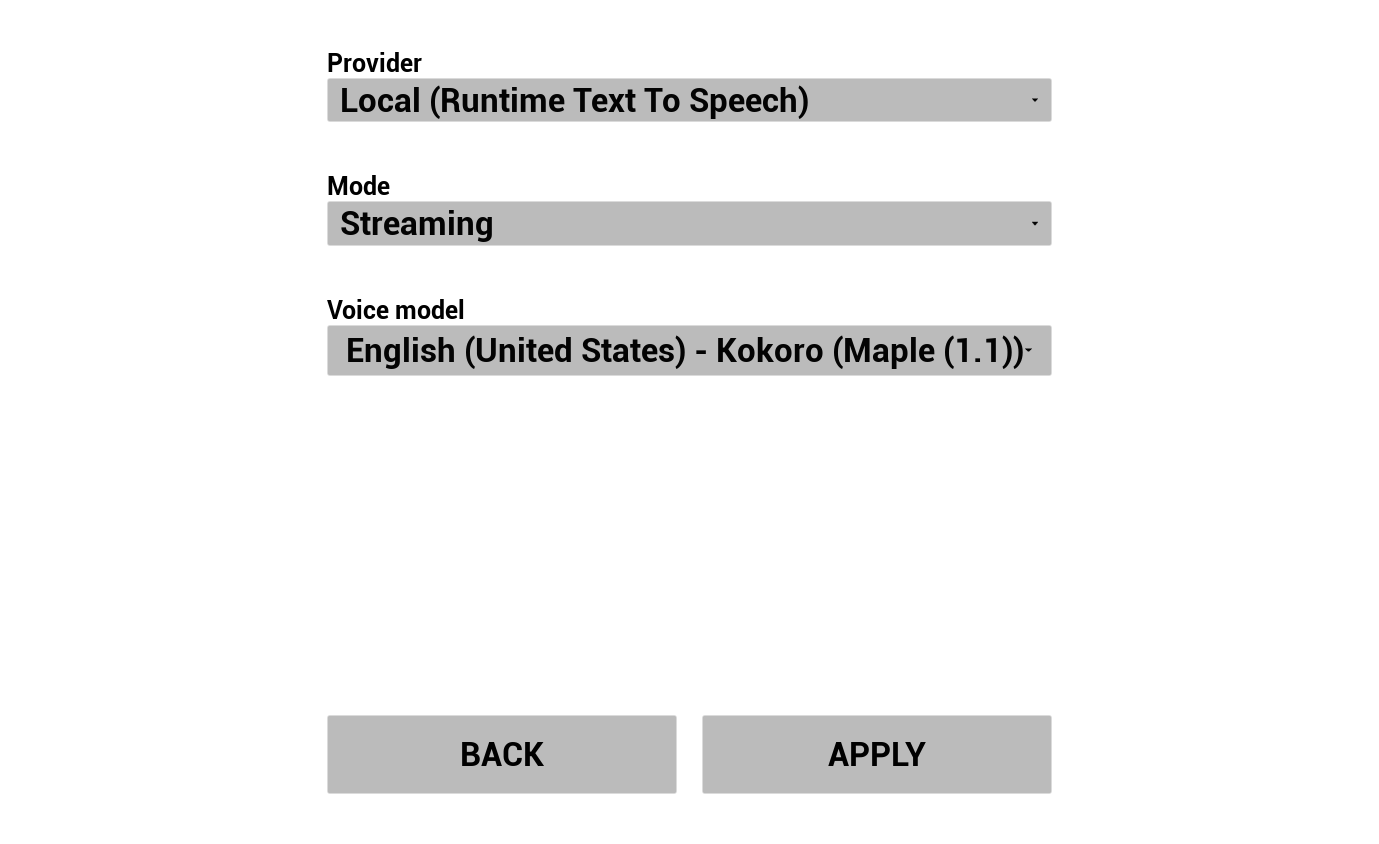

3. Configurer la Synthèse vocale (TTS)

Choisissez votre fournisseur de TTS et configurez les voix/modèles :

- Sélectionner un fournisseur (Runtime AI Chatbot Integrator pour OpenAI/ElevenLabs, ou Runtime Text To Speech pour Piper/Kokoro locaux)

- Sélectionner une voix/un modèle

- Ajuster les paramètres spécifiques au fournisseur

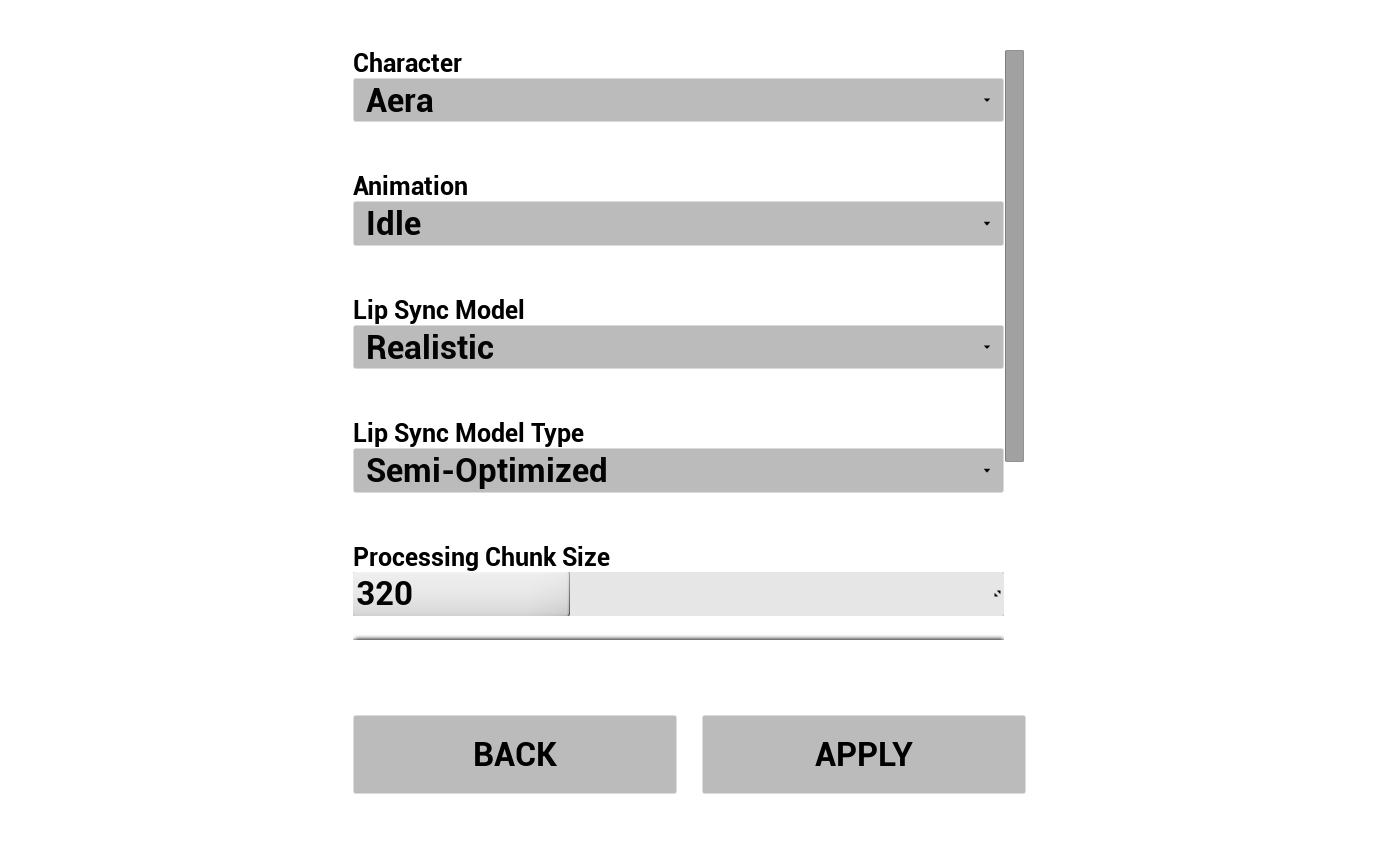

4. Configurer les Animations

Contrôlez l'apparence visuelle de votre avatar IA :

- Choisissez parmi 3 personnages MetaHuman prétéléchargés (Aera, Ada, Orlando)

- Sélectionnez le modèle de lip sync (Standard ou Realistic)

- Sélectionnez le type de modèle de lip sync - Highly Optimized, Semi-Optimized ou Original (voir Type de modèle)

- Ajustez la Taille de lot de traitement - contrôle la fréquence d'exécution de l'inférence de lip sync (voir Taille de lot de traitement)

- Sélectionnez une animation d'attente à jouer sur le MetaHuman pendant la conversation

Préconfiguration de la démo dans l'Éditeur

Lorsque vous travaillez avec la version source, vous pouvez préremplir les valeurs par défaut directement dans l'éditeur afin de ne pas avoir à les saisir à chaque exécution :

| Quoi | Où |

|---|---|

| Paramètres généraux (modèle de lip sync, animation d'attente, classe de personnage, reconnaissance vocale, etc.) | Content/LipSyncSTSGameInstance |

| Paramètres LLM externe / TTS externe (Runtime AI Chatbot Integrator) | Content/Modules/RuntimeAIChatbotIntegrator/RuntimeAIChatbotIntegrator_Provider |

| Paramètres LLM local (Runtime Local LLM) | Content/Modules/RuntimeLocalLLM/RuntimeLocalLLM_Provider |

| Paramètres TTS local (Runtime Text To Speech) | Content/Modules/RuntimeTextToSpeech/RuntimeTextToSpeech_Provider |

Remarques multiplateformes

Tous les plugins utilisés par la démo prennent en charge Windows, Mac, Linux, iOS, Android et les plateformes basées sur Android (y compris Meta Quest), le projet de démonstration fonctionne donc également sur l'ensemble de ces plateformes. Cela le rend adapté au déploiement dans une grande variété d'environnements — des bornes de bureau et expériences sur navigateur web aux applications mobiles, casques VR autonomes et configurations de production virtuelle sur plateau.

Pour les appareils moins puissants (mobile, VR autonome), vous pouvez envisager de :

- Utiliser le modèle de lip sync Standard au lieu de Realistic - voir la comparaison des modèles

- Passer au type de modèle Highly Optimized

- Augmenter la Taille de lot de traitement pour réduire la charge CPU

- Choisir des modèles LLM / TTS plus petits

Consultez Configuration spécifique à la plateforme pour des étapes supplémentaires de configuration sur Android, iOS, Mac et Linux.

Importer votre propre personnage

Le projet de démonstration est livré avec trois personnages MetaHuman d'exemple (Aera, Ada, Orlando), mais vous pouvez importer votre propre MetaHuman et l'utiliser dans la démo.

📺 Tutoriel vidéo : Ajouter un personnage MetaHuman personnalisé au projet de démonstration

Le plugin Runtime MetaHuman Lip Sync prend en charge de nombreux autres systèmes de personnages au-delà des MetaHumans (personnages basés sur ARKit, Daz Genesis 8/9, Reallusion CC3/CC4, Mixamo, ReadyPlayerMe, etc. - voir le Guide de configuration de personnages personnalisés). Que vous construisiez un PNJ de jeu, un présentateur virtuel, un préposé de borne interactive ou un humain numérique pour la production virtuelle, le plugin s'adapte à votre pipeline de création de personnages.

Un projet de démonstration plus simple qui se concentre uniquement sur la fonctionnalité de lip sync elle-même, sans le pipeline conversationnel IA complet. Convient si vous souhaitez simplement voir le lip sync en action avec différentes sources audio.

Vidéo mise en avant

Téléchargements

Ce qui est inclus

Cette démo montre les flux de travail de base du lip sync :

- Entrée microphone - lip sync en temps réel à partir d'un flux audio en direct

- Lecture de fichier audio - lip sync à partir de fichiers audio importés

- Synthèse vocale (TTS) - lip sync piloté par de la parole synthétisée

Plugins requis et optionnels

| Plugin | Utilité | Requis ? |

|---|---|---|

| Runtime MetaHuman Lip Sync | Animation du lip sync | ✅ Requis |

| Runtime Audio Importer | Import et capture audio | ✅ Requis |

| Runtime Text To Speech | TTS local pour la scène de démo TTS | 🔶 Optionnel |

| Runtime AI Chatbot Integrator | Fournisseurs TTS externes (OpenAI, ElevenLabs) | 🔶 Optionnel |

Remarques concernant le Standard Lip Sync Model

Si vous prévoyez d'utiliser le Modèle Standard (au lieu de Realistic) dans l'un ou l'autre des projets de démonstration, vous devrez installer le plugin Extension pour le Modèle Standard de Lip Sync. Consultez Extension du Modèle Standard pour les instructions d'installation.

Besoin d'aide ?

Si vous rencontrez des difficultés pour configurer ou exécuter les projets de démonstration, n'hésitez pas à nous contacter :

Pour les demandes de développement personnalisé (par exemple, étendre la démo avec votre propre logique, l'adapter à une plateforme ou un pipeline de personnage spécifique), contactez [email protected].