Guide d'Installation

Ce guide vous accompagne dans le processus de configuration de base de Runtime MetaHuman Lip Sync avec vos personnages MetaHuman.

Note : Runtime MetaHuman Lip Sync fonctionne avec les MetaHuman et les personnages personnalisés. Pour des instructions détaillées sur la configuration des personnages personnalisés, consultez le Guide de Configuration des Personnages Personnalisés.

Prérequis

Avant de commencer, assurez-vous que :

-

Exigences du plugin MetaHuman :

- UE 5.5 et versions antérieures : Activez le plugin MetaHuman dans votre projet

- UE 5.6 et versions ultérieures : Activez le plugin MetaHuman Core Tech dans votre projet

Plugins MetaHuman supplémentairesSelon la façon dont vous créez vos personnages MetaHuman, vous pourriez avoir besoin de plugins supplémentaires. Par exemple, si vous prévoyez de créer un MetaHuman avec le nouveau système MetaHuman Creator introduit dans UE 5.6, vous devrez également activer le plugin MetaHuman Creator. Pour plus d'informations sur ce système, consultez la documentation MetaHuman Creator.

-

Vous avez au moins un personnage MetaHuman téléchargé et disponible dans votre projet

-

Le plugin Runtime MetaHuman Lip Sync est installé

Plugin d'Extension du Modèle Standard

Si vous prévoyez d'utiliser le Modèle Standard, vous devrez installer le plugin d'extension :

- Téléchargez le plugin Standard Lip Sync Extension depuis ici

- Extrayez le dossier de l'archive téléchargée dans le dossier

Pluginsde votre projet (créez ce dossier s'il n'existe pas) - Assurez-vous que votre projet est configuré comme un projet C++ (même si vous n'avez pas de code C++)

- Recompilez votre projet

- Cette extension est nécessaire uniquement si vous souhaitez utiliser le Modèle Standard. Si vous n'avez besoin que des Modèles Réalistes, vous pouvez ignorer cette étape.

- Pour plus d'informations sur la construction manuelle des plugins, consultez le tutoriel Building Plugins

Plugins Supplémentaires

- Si vous prévoyez d'utiliser la capture audio (par exemple, l'entrée microphone), installez le plugin Runtime Audio Importer.

- Si vous prévoyez d'utiliser la fonctionnalité synthèse vocale :

- Pour la synthèse vocale locale (Modèle Standard et Modèle Réaliste avec Émotions), installez le plugin Runtime Text To Speech.

- Pour les fournisseurs de synthèse vocale externes (ElevenLabs, OpenAI, Google Cloud, Azure), installez le plugin Runtime AI Chatbot Integrator.

Configuration du Blueprint d'Animation

Étape 1 : Localiser et modifier le Blueprint d'animation du visage

- UE 5.5 et versions antérieures (ou MetaHumans Hérités dans UE 5.6+)

- UE 5.6+ MetaHuman Creator Characters

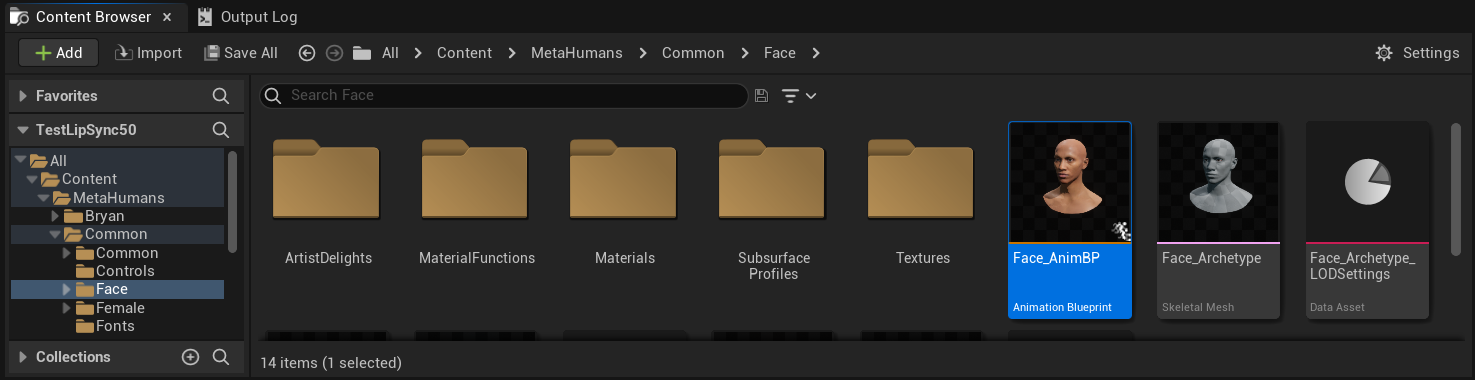

Vous devez modifier un Blueprint d'Animation qui sera utilisé pour les animations faciales de votre personnage MetaHuman. Le Blueprint d'Animation facial par défaut des MetaHuman se trouve à l'emplacement :

Content/MetaHumans/Common/Face/Face_AnimBP

Vous avez plusieurs options pour implémenter la fonctionnalité de synchronisation labiale :

- Edit Default Asset (Simplest Option)

- Create Duplicate

- Use Custom Animation Blueprint

Ouvrez directement l'Face_AnimBP par défaut et effectuez vos modifications. Tous les changements affecteront tous les personnages MetaHuman utilisant ce Blueprint d'animation.

Remarque : Cette approche est pratique mais impactera tous les personnages utilisant le Blueprint d'animation par défaut.

- Dupliquez

Face_AnimBPet donnez-lui un nom descriptif - Localisez la classe Blueprint de votre personnage (par exemple, pour le personnage "Bryan", elle se trouverait à

Content/MetaHumans/Bryan/BP_Bryan) - Ouvrez le Blueprint du personnage et trouvez le composant Face

- Modifiez la propriété Anim Class pour qu'elle pointe vers votre nouveau Blueprint d'animation dupliqué

Remarque : Cette approche vous permet de personnaliser la synchronisation labiale pour des personnages spécifiques tout en laissant les autres inchangés.

Vous pouvez implémenter le mélange de synchronisation labiale dans n'importe quel Blueprint d'animation ayant accès aux os faciaux requis :

- Créez ou utilisez un Blueprint d'animation personnalisé existant

- Assurez-vous que votre Blueprint d'animation fonctionne avec un squelette contenant les mêmes os faciaux que le

Face_Archetype_Skeletonpar défaut de MetaHuman

Remarque : Cette approche vous offre une flexibilité maximale pour l'intégration avec des systèmes d'animation personnalisés.

À partir de l'UE 5.6, le nouveau système MetaHuman Creator a été introduit. Pour ces personnages, le plugin fournit un Blueprint d'animation facial situé à :

Content/LipSyncData/LipSync_Face_AnimBP

Cette Animation Blueprint se trouve dans le dossier de contenu du plugin et sera écrasée à chaque mise à jour du plugin. Pour éviter de perdre vos personnalisations :

- Copiez cet asset dans le dossier Content de votre projet (par exemple, dans

YourProject/Content/MetaHumans/LipSync_Face_AnimBP) - Utilisez votre version copiée dans la configuration de votre personnage

- Effectuez toutes vos modifications sur la version copiée

Utilisation de l'Animation Blueprint du visage du plugin :

- Localisez la classe Blueprint de votre personnage MetaHuman Creator

- Ouvrez le Blueprint du personnage et trouvez le composant Face

- Modifiez la propriété Anim Class pour utiliser le

LipSync_Face_AnimBPdu plugin - Poursuivez avec les étapes suivantes pour configurer la fonctionnalité Runtime MetaHuman Lip Sync

Étape 2 : Configuration du graphe d'événements

Ouvrez votre Animation Blueprint du visage et basculez vers le Event Graph. Vous devrez créer un générateur qui traitera les données audio et générera l'animation de synchronisation labiale.

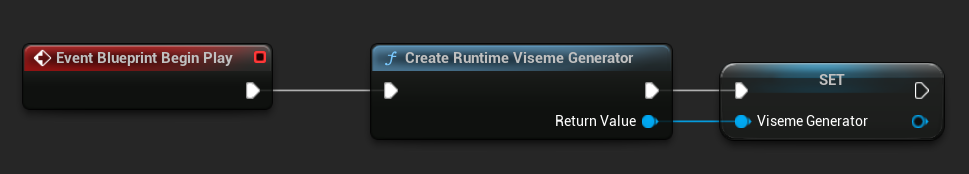

- Modèle Standard

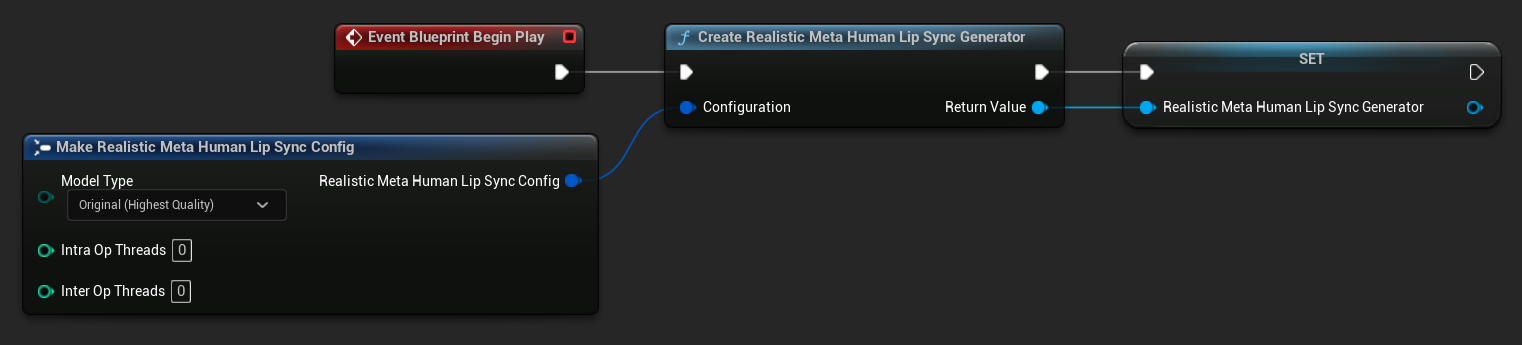

- Modèle Réaliste

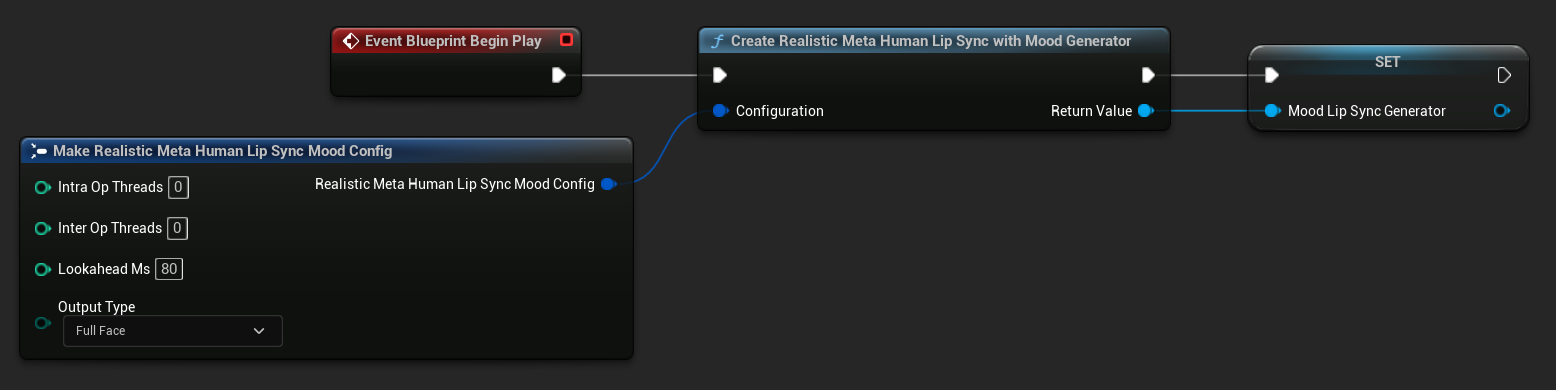

- Modèle Réaliste avec Émotions

- Ajoutez le nœud

Event Blueprint Begin Plays'il n'existe pas déjà - Ajoutez le nœud

Create Runtime Viseme Generatoret connectez-le à l'événement Begin Play - Sauvegardez la sortie dans une variable (par exemple "VisemeGenerator") pour l'utiliser dans d'autres parties du graphe

Pour les options de configuration détaillées, consultez la section Configuration du Modèle Standard.

- Ajoutez le nœud

Event Blueprint Begin Plays'il n'existe pas déjà - Ajoutez le nœud

Create Realistic MetaHuman Lip Sync Generatoret connectez-le à l'événement Begin Play - Sauvegardez la sortie dans une variable (par exemple "RealisticMetaHumanLipSyncGenerator") pour l'utiliser dans d'autres parties du graphe

- (Optionnel) Configurez les paramètres du générateur en utilisant le paramètre Configuration

Pour les options de configuration détaillées, y compris les types de modèles, les paramètres de performance et les paramètres de traitement, consultez la section Configuration du Modèle Réaliste.

- Ajoutez le nœud

Event Blueprint Begin Plays'il n'existe pas déjà - Ajoutez le nœud

Create Realistic MetaHuman Lip Sync With Mood Generatoret connectez-le à l'événement Begin Play - Sauvegardez la sortie dans une variable (par exemple "MoodMetaHumanLipSyncGenerator") pour l'utiliser dans d'autres parties du graphe

- (Optionnel) Configurez les paramètres du générateur en utilisant le paramètre Configuration

Pour la configuration détaillée des émotions, y compris les types d'émotions, les paramètres d'intensité, le timing de prévision et la sélection du type de sortie, consultez la section Configuration du Modèle avec Émotions.

Étape 3 : Configuration du graphe d'animation

Après avoir configuré le Event Graph, basculez vers le Anim Graph pour connecter le générateur à l'animation du personnage :

- Modèle Standard

- Modèle Réaliste

- Modèle Réaliste avec Émotions

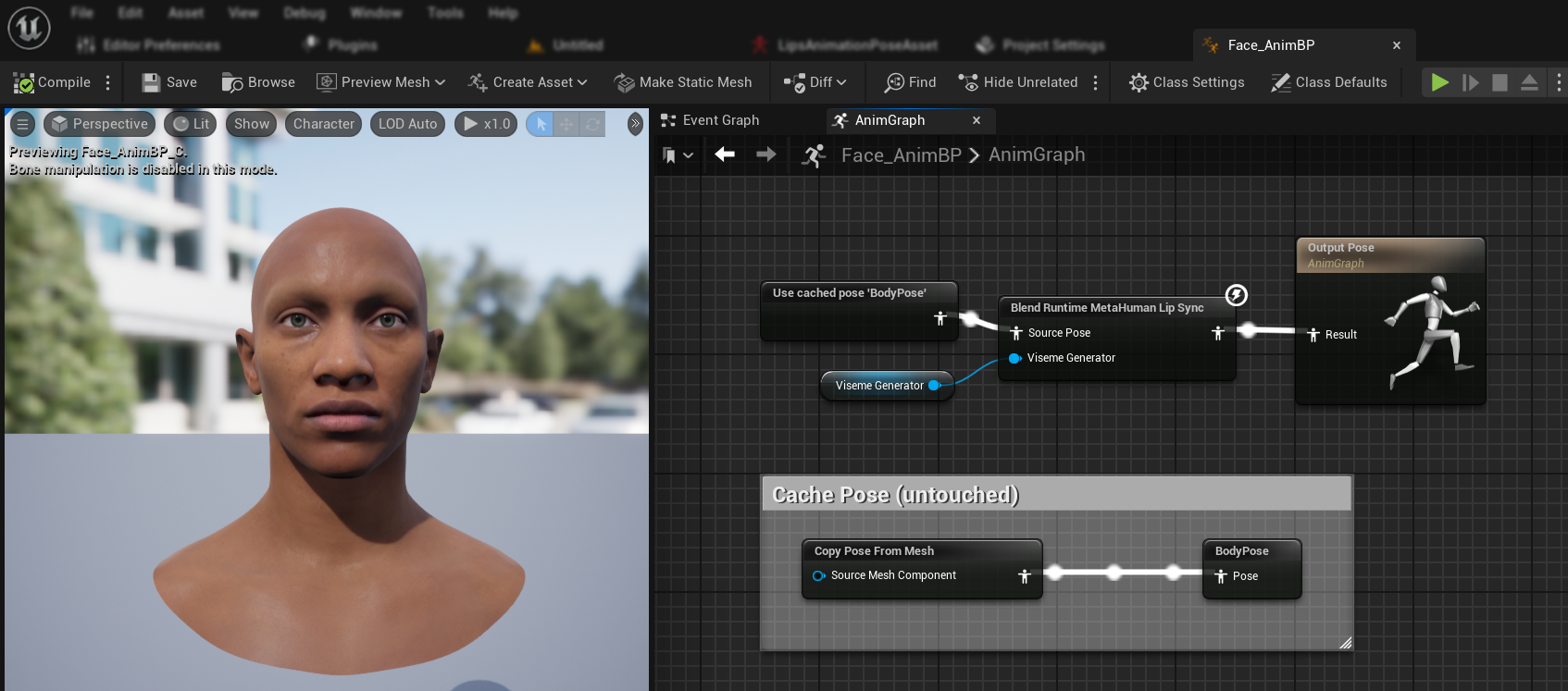

- Localisez la pose qui contient le visage MetaHuman (généralement depuis

Use cached pose 'Body Pose') - Ajoutez le nœud

Blend Runtime MetaHuman Lip Sync - Connectez la pose à l'entrée

Source Posedu nœudBlend Runtime MetaHuman Lip Sync - Connectez votre variable

VisemeGeneratorà la brocheViseme Generator - Connectez la sortie du nœud

Blend Runtime MetaHuman Lip Syncà la brocheResultduOutput Pose

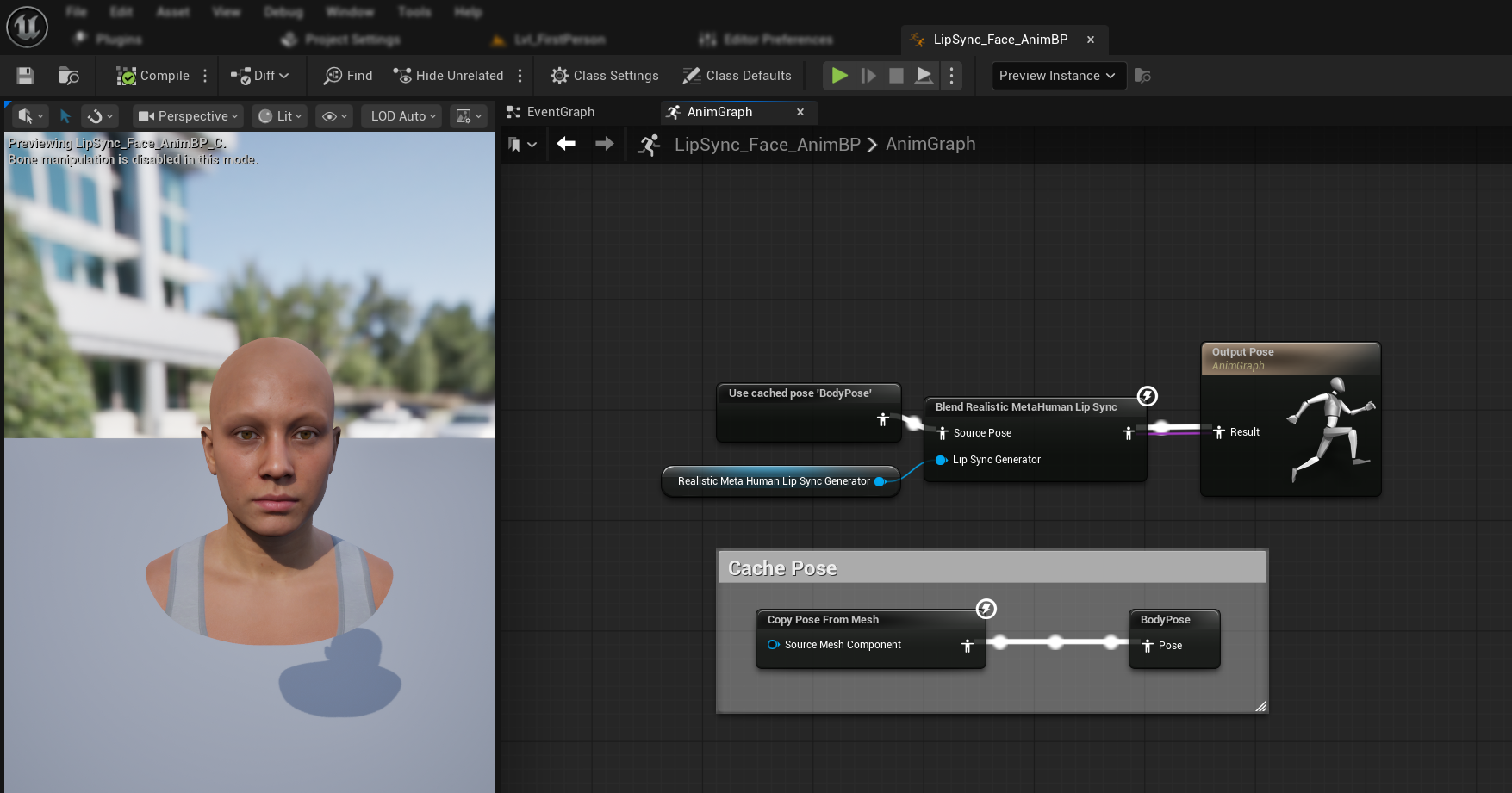

- Localisez la pose qui contient le visage MetaHuman (généralement depuis

Use cached pose 'Body Pose') - Ajoutez le nœud

Blend Realistic MetaHuman Lip Sync - Connectez la pose à l'entrée

Source Posedu nœudBlend Realistic MetaHuman Lip Sync - Connectez votre variable

RealisticMetaHumanLipSyncGeneratorà la brocheLip Sync Generator - Connectez la sortie du nœud

Blend Realistic MetaHuman Lip Syncà la brocheResultduOutput Pose

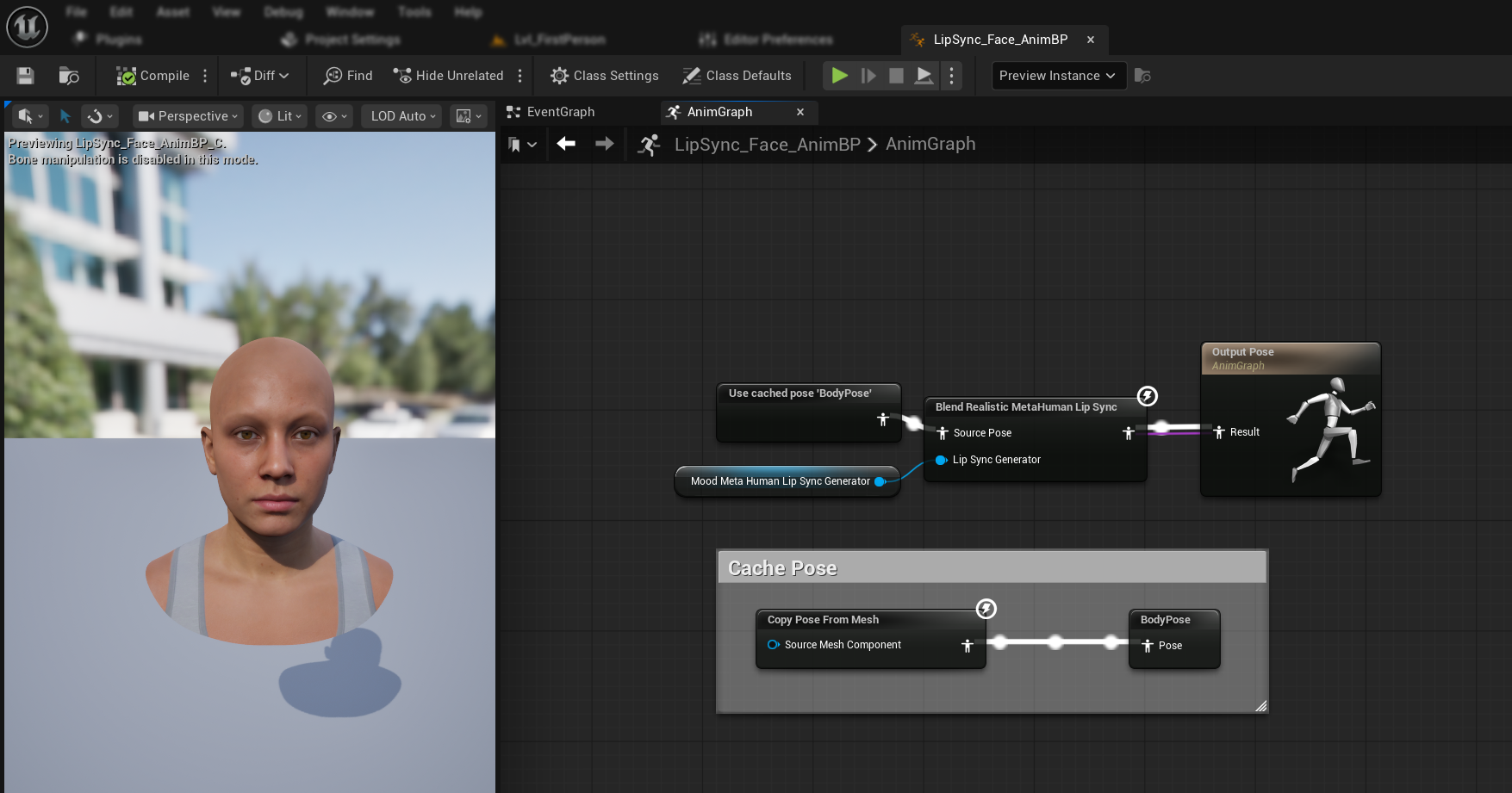

- Localisez la pose qui contient le visage MetaHuman (généralement depuis

Use cached pose 'Body Pose') - Ajoutez le nœud

Blend Realistic MetaHuman Lip Sync(même nœud que le modèle réaliste régulier) - Connectez la pose à l'entrée

Source Posedu nœudBlend Realistic MetaHuman Lip Sync - Connectez votre variable

MoodMetaHumanLipSyncGeneratorà la brocheLip Sync Generator - Connectez la sortie du nœud

Blend Realistic MetaHuman Lip Syncà la brocheResultduOutput Pose

Note : Le modèle avec émotions utilise le même nœud d'Animation Blueprint que le modèle réaliste régulier. La fonctionnalité d'émotions est gérée en interne par le générateur.

Prochaines Étapes

Maintenant que la configuration de base de l'Animation Blueprint est terminée, vous devrez configurer le traitement de l'entrée audio pour alimenter votre générateur de synchronisation labiale.

Poursuivez avec le Guide de Traitement Audio pour apprendre comment configurer différentes méthodes d'entrée audio, y compris la capture microphone, la synthèse vocale et le traitement de fichiers audio.

Pour les options de configuration avancées et le réglage fin, consultez le Guide de Configuration.