डेमो प्रोजेक्ट्स

Runtime MetaHuman Lip Sync के साथ शीघ्रता से आरंभ करने में आपकी सहायता के लिए, दो उपयोग के लिए तैयार डेमो प्रोजेक्ट उपलब्ध हैं। दोनों Unreal Engine 5.6+ में बनाए गए हैं, Blueprint-मात्र हैं, और Windows, Mac, Linux, iOS, Android, तथा Android-आधारित प्लेटफ़ॉर्म्स (जिनमें Meta Quest शामिल है) पर क्रॉस-प्लेटफ़ॉर्म चलते हैं।

उपलब्ध डेमो प्रोजेक्ट्स

- AI संवादात्मक NPC / इंटरैक्टिव अवतार

- मूल लिप सिंक डेमो

एक पूर्ण AI संवादात्मक अवतार कार्यप्रवाह जो आवाज़ पहचान, एक AI चैटबॉट (LLM), टेक्स्ट-टू-स्पीच, और रीयल-टाइम लिप सिंक के साथ ऑडियो प्लेबैक को संयोजित करता है — सभी एक ही प्रोजेक्ट में एक साथ चल रहे हैं। उपयोग के व्यापक मामलों के लिए उपयुक्त — जिनमें इंटरैक्टिव कियोस्क, वर्चुअल प्रोडक्शन, म्यूज़ियम इंस्टॉलेशन, डिजिटल असिस्टेंट, प्रशिक्षण सिमुलेशन, और खेल शामिल हैं।

पाइपलाइन अवलोकन

🎤 Microphone → Speech Recognition → 💬 LLM Chatbot → 🔊 Text-to-Speech → 👄 Lip Sync + Playback

वीडियो

त्वरित पूर्वावलोकन (~30 सेकंड)

डेमो की कार्रवाई का एक छोटा प्रदर्शन।

पूर्ण वॉकथ्रू

सेटअप, कॉन्फ़िगरेशन और पूर्ण वार्तालाप पाइपलाइन को कवर करने वाला एक विस्तृत वॉकथ्रू।

डाउनलोड

आवश्यक और वैकल्पिक प्लगइन्स

डेमो प्रोजेक्ट मॉड्यूलर है - आपको केवल उन प्रदाताओं के लिए प्लगइन्स की आवश्यकता है जिनका आप उपयोग करना चाहते हैं।

| प्लगइन | उद्देश्य | आवश्यक? |

|---|---|---|

| Runtime MetaHuman Lip Sync | लिप सिंक एनीमेशन | ✅ हमेशा |

| Runtime Audio Importer | ऑडियो कैप्चर और प्रोसेसिंग | ✅ हमेशा |

| Runtime Speech Recognizer | ऑफ़लाइन स्पीच रिकॉग्निशन (whisper.cpp) | ✅ हमेशा |

| Runtime AI Chatbot Integrator | बाहरी LLMs (OpenAI, Claude, DeepSeek, Gemini, Grok, Ollama) और/या बाहरी TTS (OpenAI, ElevenLabs) | 🔶 वैकल्पिक |

| Runtime Local LLM | llama.cpp के माध्यम से स्थानीय LLM अनुमान (Llama, Mistral, Gemma, आदि, GGUF मॉडल) | 🔶 वैकल्पिक |

| Runtime Text To Speech | Piper और Kokoro के माध्यम से स्थानीय TTS | 🔶 वैकल्पिक |

जबकि ऊपर बताए गए प्रत्येक प्लगइन अलग-अलग वैकल्पिक हैं, डेमो को काम करने के लिए आपको कम से कम एक LLM प्रदाता और कम से कम एक TTS प्रदाता की आवश्यकता है। स्वतंत्र रूप से मिलाएँ और मिलान करें (जैसे, स्थानीय LLM + ElevenLabs TTS, या OpenAI LLM + स्थानीय TTS)।

मॉड्यूलर आर्किटेक्चर

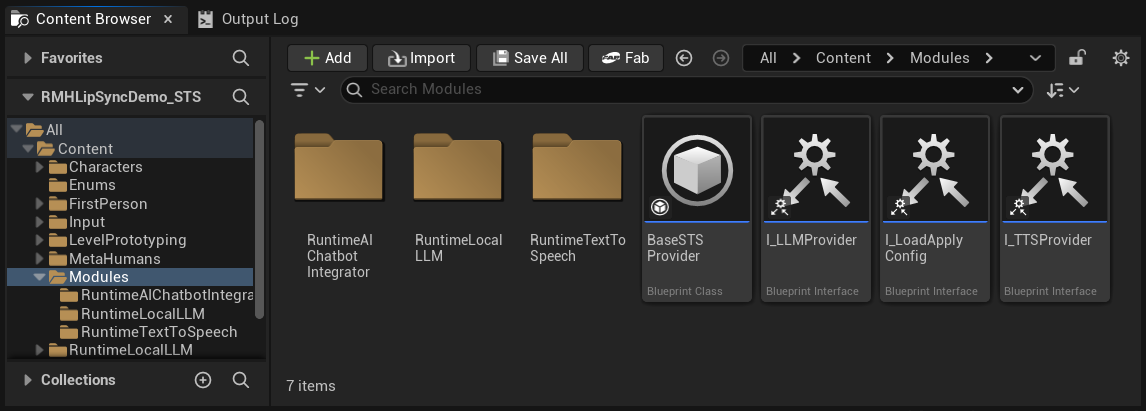

Content फ़ोल्डर में आपको एक Modules फ़ोल्डर मिलेगा जिसमें तीन सबफ़ोल्डर हैं:

Content/

└── Modules/

├── RuntimeAIChatbotIntegrator/ ← External LLMs and/or external TTS

├── RuntimeLocalLLM/ ← Local LLM via llama.cpp

└── RuntimeTextToSpeech/ ← Local TTS via Piper/Kokoro

यदि आपने एक (या अधिक) वैकल्पिक प्लगइन प्राप्त नहीं किए हैं, तो बस संबंधित फ़ोल्डर(फ़ोल्डर्स) को हटा दें। डेमो प्रोजेक्ट की बेस एसेट्स (गेम इंस्टेंस, विजेट्स, आदि) सीधे इन मॉड्यूल्स का संदर्भ नहीं लेती हैं, इसलिए उन्हें हटाने से एसेट रेफरेंस एरर नहीं आएगा। कॉन्फ़िगरेशन UI स्वचालित रूप से उस प्रदाता को छुपा देगा जिसका फ़ोल्डर गायब है।

यह मॉड्यूलरिटी केवल LLM और TTS प्रदाताओं पर लागू होती है। स्पीच रिकॉग्निशन (Runtime Speech Recognizer) और लिप सिंक (Runtime MetaHuman Lip Sync) बेस डेमो प्रोजेक्ट का हिस्सा हैं और हमेशा आवश्यक हैं।

:::चेतावनी

पहली बार लॉन्च होने पर, Unreal पूछ सकता है कि क्या गायब वैकल्पिक प्लगइन्स को अक्षम करना है - हां पर क्लिक करें। सुनिश्चित करें कि आपने संबंधित Content/Modules/ फ़ोल्डर भी हटा दिया है (ऊपर देखें)।

:::

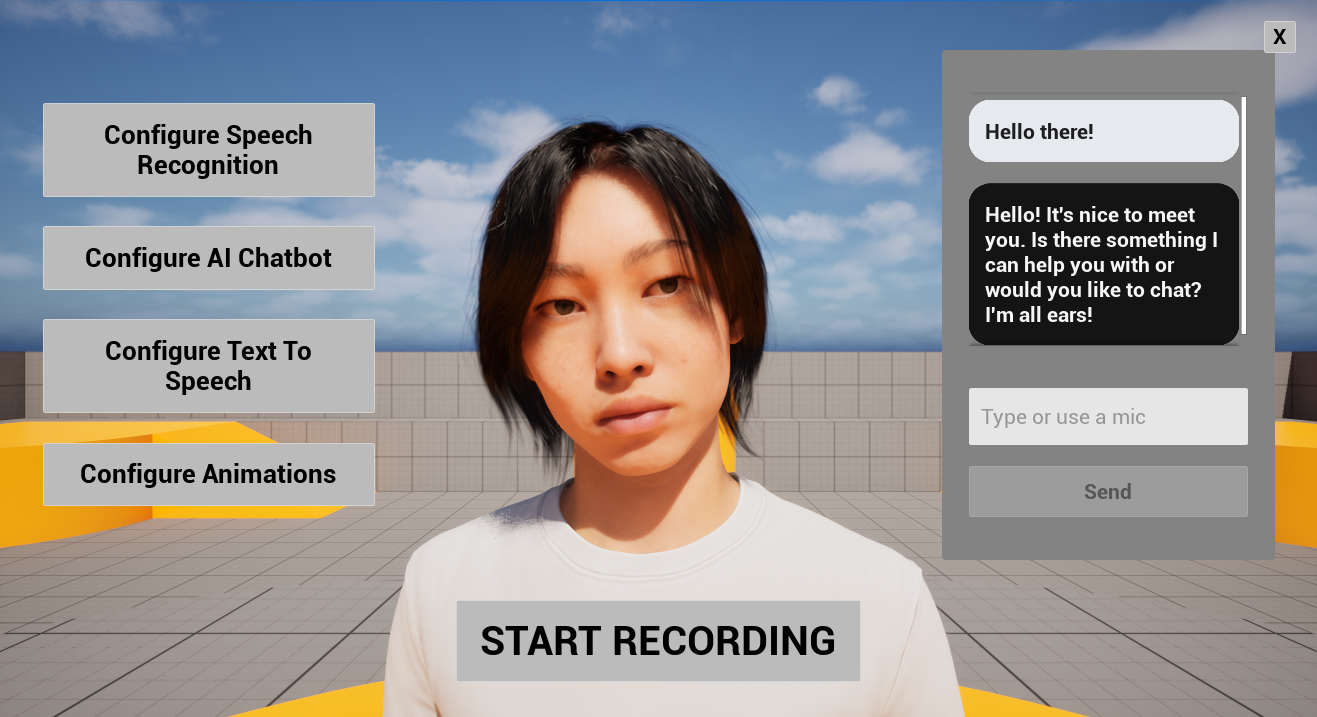

डेमो प्रोजेक्ट लेआउट

नीचे दिखाया गया यूजर इंटरफ़ेस पूरी तरह से UMG (Unreal Motion Graphics) के साथ बनाया गया है और इसका उद्देश्य केवल पाइपलाइन का प्रदर्शन करना है - स्पीच रिकॉग्निशन → LLM → TTS → लिप सिंक। आप इसे अपने प्रोजेक्ट के विज़ुअल डिज़ाइन, कंट्रोल स्कीम, या प्लेटफ़ॉर्म (VR/AR, मोबाइल, कंसोल, कियोस्क, आदि) से मेल खाने के लिए पुनः स्टाइल या बदल सकते हैं। यदि आपके उपयोग के मामले में कुछ विजेट्स की आवश्यकता नहीं है, तो आप उन्हें छुपा भी सकते हैं (जैसे उनकी विज़िबिलिटी को Collapsed या Hidden पर सेट करें)।

| क्षेत्र | वहां क्या है |

|---|---|

| केंद्र | MetaHuman कैरेक्टर। |

| बायाँ भाग | चार कॉन्फ़िगरेशन बटन (Speech Recognition, AI Chatbot, Text To Speech, Animations), जिनका विवरण नीचे दिया गया है। |

| केंद्र निचला | एक Start Recording बटन। ध्वनि-वार्तालाप शुरू करने के लिए इसे क्लिक करें: आपका माइक्रोफ़ोन कैप्चर किया जाता है, ट्रांसक्राइब किया जाता है, LLM को भेजा जाता है, उत्तर TTS के माध्यम से संश्लेषित किया जाता है, और लिप सिंक के साथ प्लेबैक किया जाता है, पूरी तरह से हाथों-मुक्त। |

| दायाँ केंद्र | एक संवाद इतिहास विजेट आपके और AI के बीच पूरे संवाद (उपयोगकर्ता और सहायक दोनों संदेश) को दिखाता है। इसमें एक टेक्स्ट इनपुट फ़ील्ड भी शामिल है, ताकि आप स्पीच रिकॉग्निशन का उपयोग किए बिना सीधे संदेश टाइप कर सकें, जो परीक्षण, सुलभता, या जब माइक्रोफ़ोन उपलब्ध न हो तब उपयोगी है। |

:::सुझाव आप एक ही सत्र में दोनों इनपुट मोड को स्वतंत्र रूप से मिला सकते हैं - कुछ संदेश बोलें, कुछ टाइप करें। :::

कॉन्फ़िगरेशन बटन

बाईं ओर के चार कॉन्फ़िगरेशन बटन पाइपलाइन के प्रत्येक भाग के लिए समर्पित पैनल खोलते हैं:

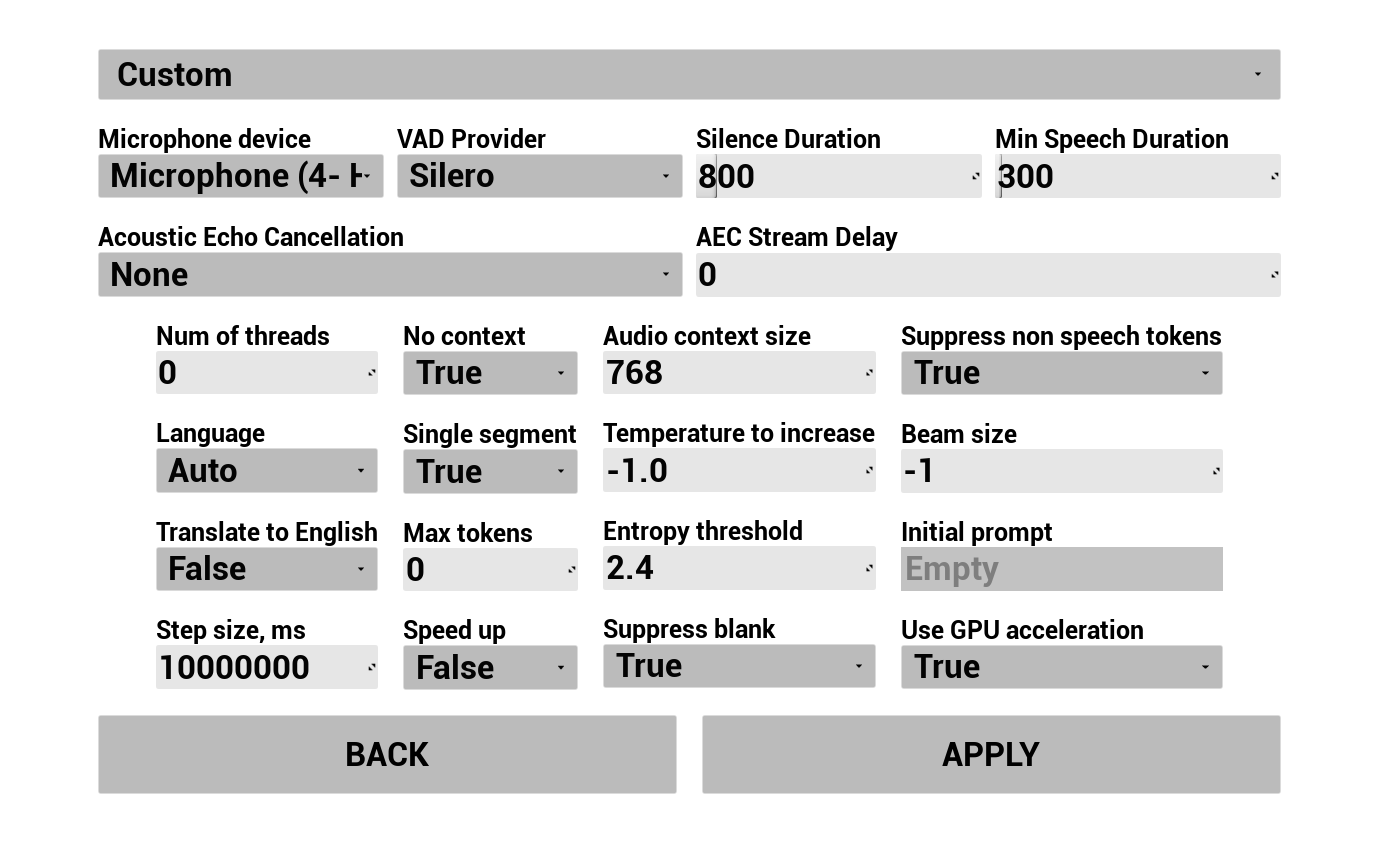

1. भाषण पहचान कॉन्फ़िगर करें

उपयोगकर्ता की आवाज़ को कैसे कैप्चर और ट्रांसक्राइब किया जाए, कॉन्फ़िगर करें:

- भाषा चुनें

- स्पीच रिकॉग्निशन पैरामीटर समायोजित करें (Whisper मॉडल सेटिंग्स)

- AEC (Acoustic Echo Cancellation) कॉन्फ़िगर करें

- VAD (Voice Activity Detection) कॉन्फ़िगर करें

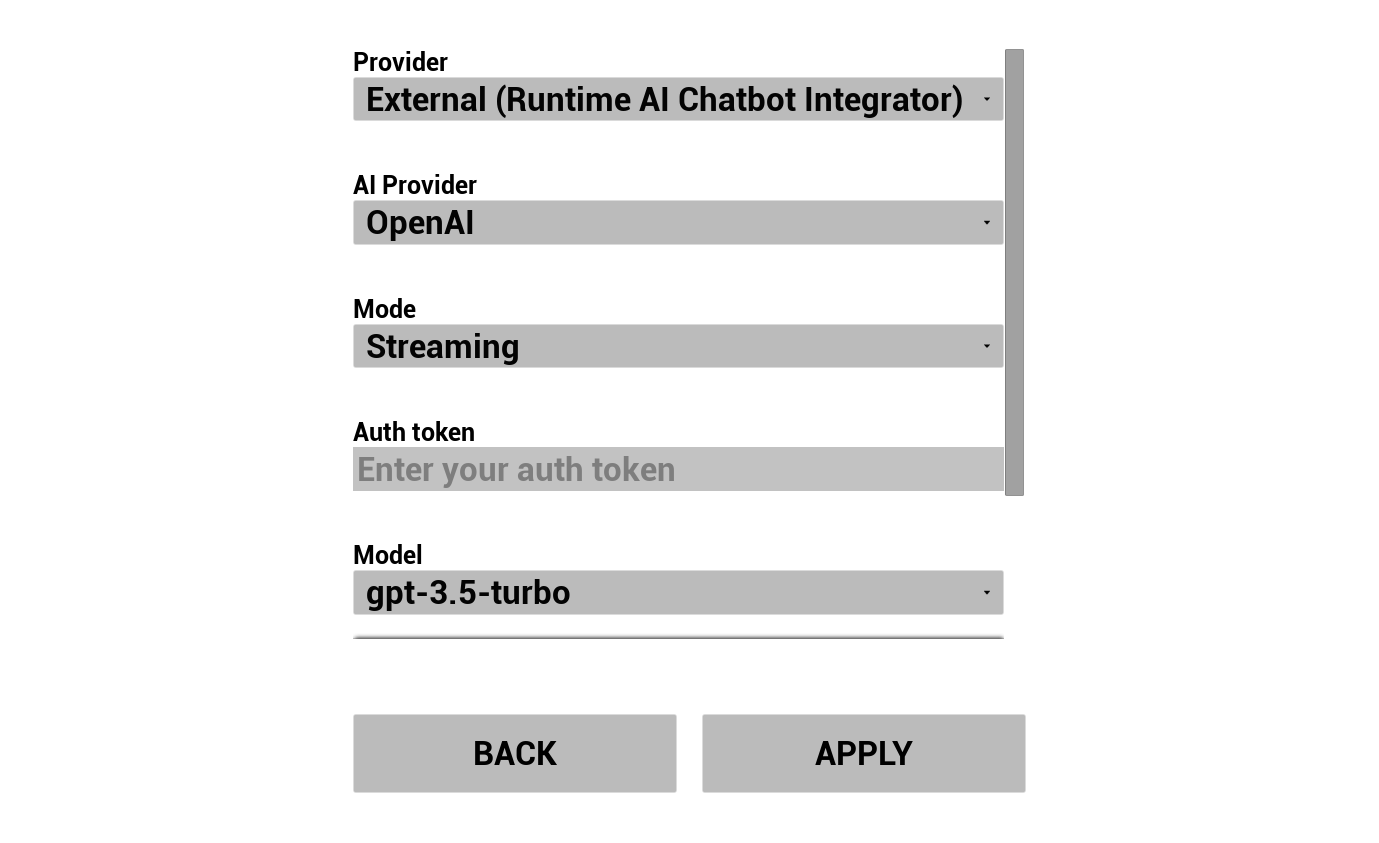

2. AI चैटबॉट कॉन्फ़िगर करें

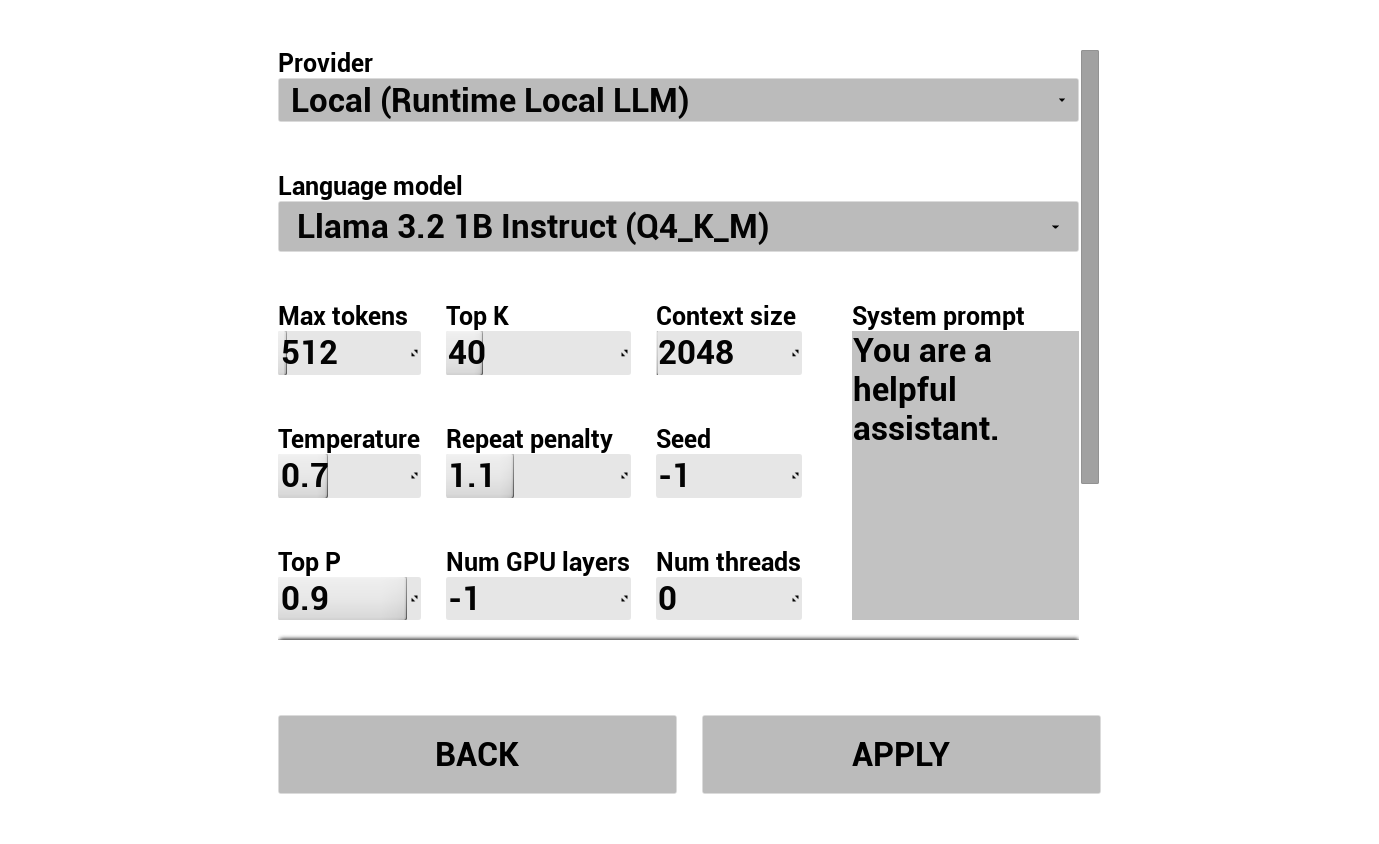

अपना LLM प्रदाता चुनें और इसे कॉन्फ़िगर करें:

- प्रदाता चुनें (Runtime AI Chatbot Integrator या Runtime Local LLM)

- बाहरी प्रदाताओं के लिए: auth token, model name, आदि।

- स्थानीय LLM के लिए: एक GGUF मॉडल चुनें, context size, और अन्य इन्फरेंस पैरामीटर सेट करें। आप रनटाइम पर अपना स्वयं का GGUF मॉडल डाउनलोड कर सकते हैं (जैसे URL द्वारा), और प्रोजेक्ट को रीबिल्ड किए बिना तुरंत इसका उपयोग कर सकते हैं।

:::सुझाव

प्रदाता कॉम्बोबॉक्स केवल उन्हीं प्रदाताओं को दिखाता है जिनका प्लगइन मॉड्यूल फ़ोल्डर Content/Modules/ में मौजूद है।

:::

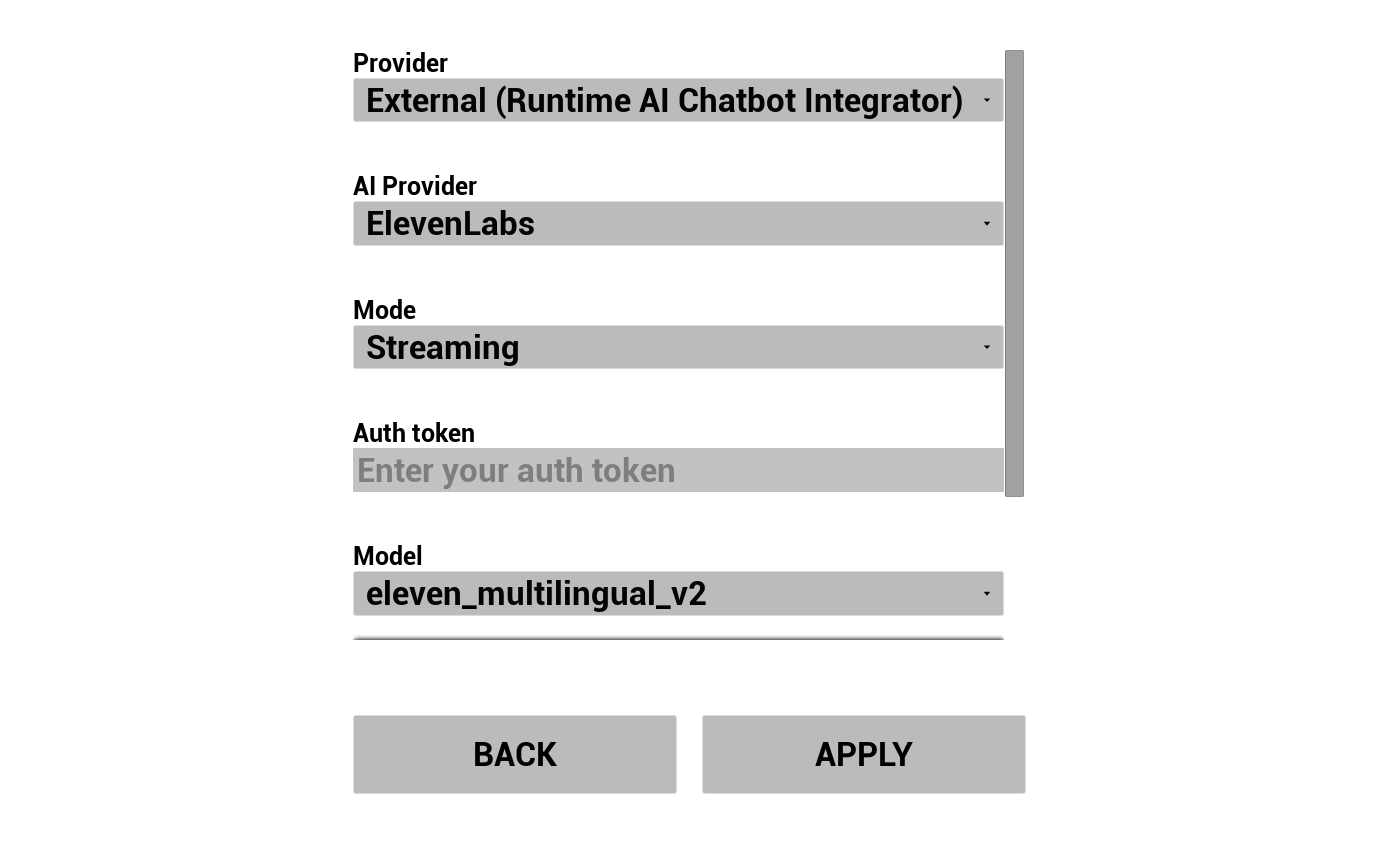

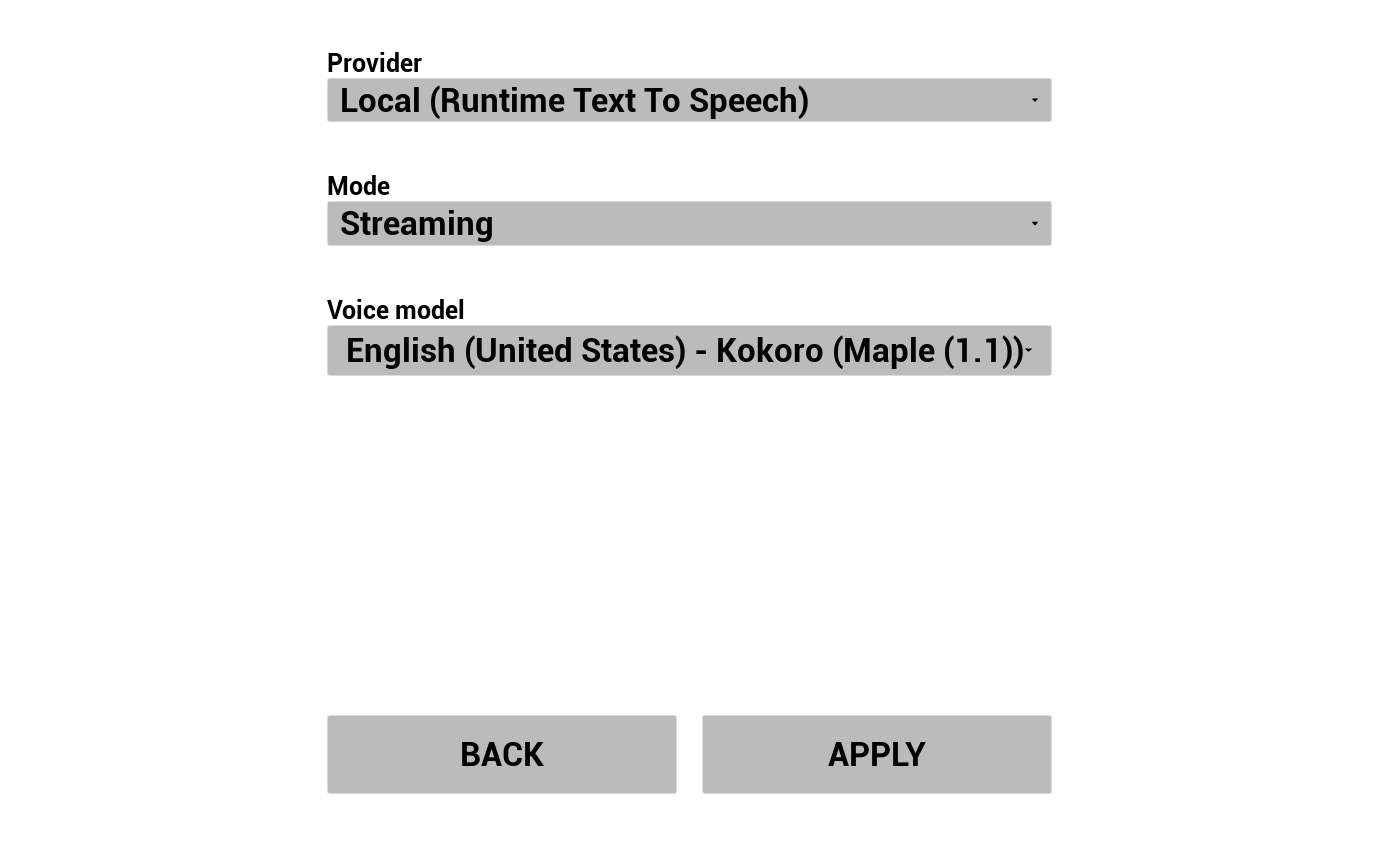

3. टेक्स्ट टू स्पीच कॉन्फ़िगर करें

अपना TTS प्रदाता चुनें और आवाज़/मॉडल कॉन्फ़िगर करें:

- प्रदाता चुनें (OpenAI/ElevenLabs के लिए Runtime AI Chatbot Integrator, या स्थानीय Piper/Kokoro के लिए Runtime Text To Speech)

- आवाज़/मॉडल चुनें

- प्रदाता-विशिष्ट पैरामीटर समायोजित करें

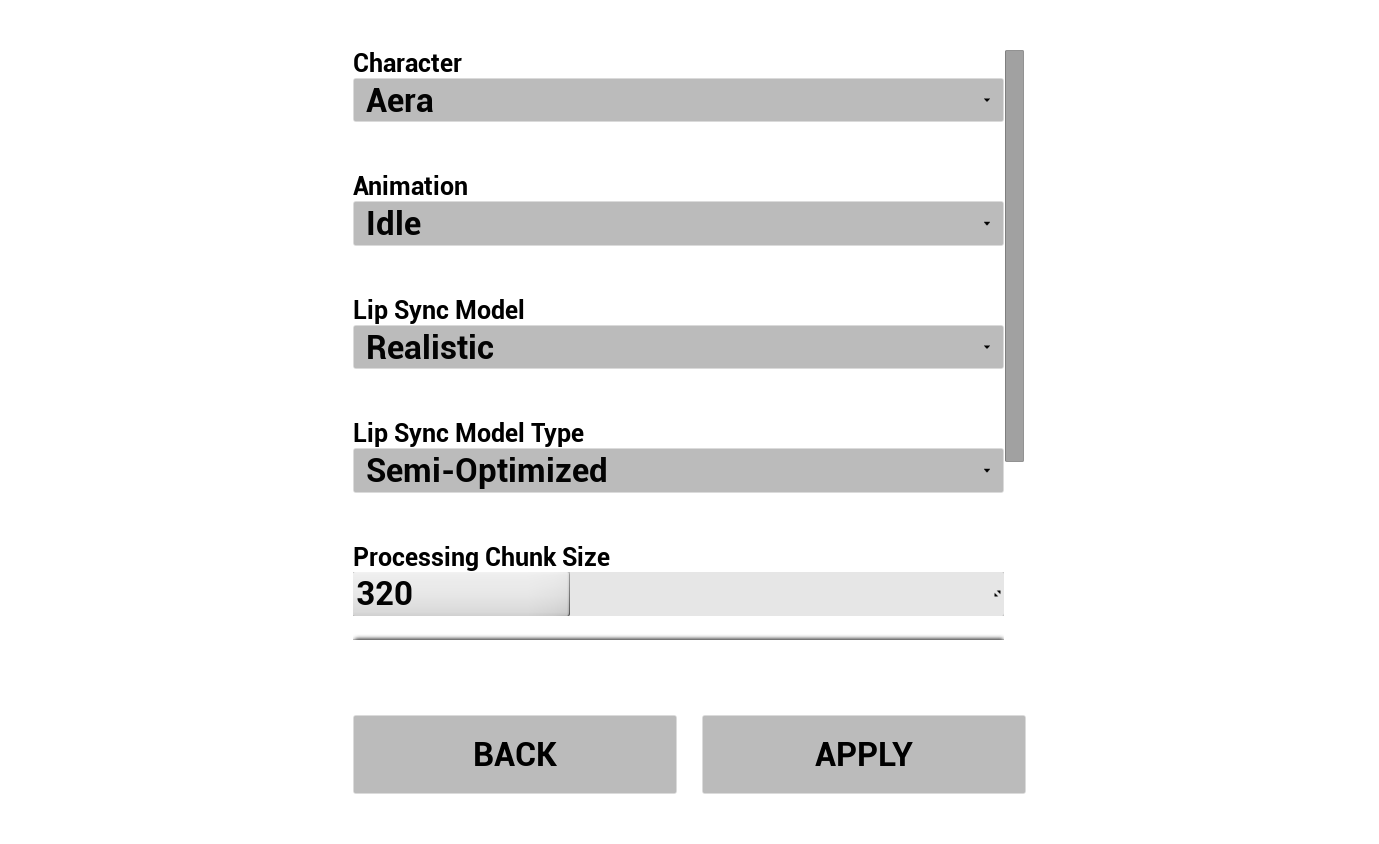

4. एनिमेशन कॉन्फ़िगर करें

अपने AI अवतार के विज़ुअल्स को नियंत्रित करें:

- 3 पूर्व-डाउनलोड MetaHuman कैरेक्टरों (Aera, Ada, Orlando) में से चुनें

- लिप सिंक मॉडल चुनें (Standard या Realistic)

- लिप सिंक मॉडल प्रकार चुनें - Highly Optimized, Semi-Optimized, या Original (देखें Model Type)

- Processing Chunk Size समायोजित करें - यह नियंत्रित करता है कि लिप सिंक इन्फरेंस कितनी बार चले (देखें Processing Chunk Size)

- बातचीत के दौरान MetaHuman पर चलाने के लिए एक आइडल एनीमेशन चुनें

एडिटर में डेमो को पूर्व-कॉन्फ़िगर करना

सोर्स वर्शन के साथ काम करते समय, आप एडिटर में सीधे डिफ़ॉल्ट भर सकते हैं ताकि हर रन पर मूल्यों को दोबारा दर्ज न करना पड़े:

| क्या | कहाँ |

|---|---|

| सामान्य सेटिंग्स (लिप सिंक मॉडल, आइडल एनीमेशन, कैरेक्टर क्लास, स्पीच रिकॉग्निशन, आदि) | Content/LipSyncSTSGameInstance |

| बाहरी LLM / बाहरी TTS सेटिंग्स (Runtime AI Chatbot Integrator) | Content/Modules/RuntimeAIChatbotIntegrator/RuntimeAIChatbotIntegrator_Provider |

| स्थानीय LLM सेटिंग्स (Runtime Local LLM) | Content/Modules/RuntimeLocalLLM/RuntimeLocalLLM_Provider |

| स्थानीय TTS सेटिंग्स (Runtime Text To Speech) | Content/Modules/RuntimeTextToSpeech/RuntimeTextToSpeech_Provider |

क्रॉस-प्लेटफ़ॉर्म नोट्स

डेमो द्वारा उपयोग किए जाने वाले सभी प्लगइन्स Windows, Mac, Linux, iOS, Android, और Android-आधारित प्लेटफ़ॉर्म (Meta Quest सहित) का समर्थन करते हैं, इसलिए डेमो प्रोजेक्ट इन सभी पर भी काम करता है। यह इसे डेस्कटॉप कियोस्क और ब्राउज़र-आधारित अनुभवों से लेकर मोबाइल ऐप्स, स्टैंडअलोन VR हेडसेट और ऑन-सेट वर्चुअल प्रोडक्शन सेटअप तक विभिन्न वातावरणों में तैनाती के लिए उपयुक्त बनाता है।

कमज़ोर डिवाइसों (मोबाइल, स्टैंडअलोन VR) के लिए, आप ये करना चाह सकते हैं:

- Realistic के बजाय Standard लिप सिंक मॉडल का उपयोग करें - देखें मॉडल तुलना

- Highly Optimized मॉडल प्रकार पर स्विच करें

- CPU लोड कम करने के लिए Processing Chunk Size बढ़ाएं

- छोटे LLM / TTS मॉडल चुनें

Android, iOS, Mac और Linux पर अतिरिक्त सेटअप चरणों के लिए प्लेटफ़ॉर्म-विशिष्ट कॉन्फ़िगरेशन देखें।

अपना स्वयं का कैरेक्टर लाना

डेमो प्रोजेक्ट तीन नमूना MetaHuman कैरेक्टरों (Aera, Ada, Orlando) के साथ आता है, लेकिन आप अपना स्वयं का MetaHuman इम्पोर्ट कर सकते हैं और डेमो में उपयोग कर सकते हैं।

📺 वीडियो ट्यूटोरियल: डेमो प्रोजेक्ट में एक कस्टम MetaHuman कैरेक्टर जोड़ना

Runtime MetaHuman Lip Sync प्लगइन स्वयं MetaHumans से परे कई अन्य कैरेक्टर सिस्टम (ARKit-आधारित कैरेक्टर, Daz Genesis 8/9, Reallusion CC3/CC4, Mixamo, ReadyPlayerMe, आदि - देखें कस्टम कैरेक्टर सेटअप गाइड) का समर्थन करता है। चाहे आप गेम NPC, वर्चुअल प्रेजेंटर, कियोस्क अटेंडेंट, या वर्चुअल प्रोडक्शन के लिए डिजिटल ह्यूमन बना रहे हों, प्लगइन आपकी कैरेक्टर पाइपलाइन के अनुकूल हो जाता है।

एक सरल डेमो प्रोजेक्ट जो पूर्ण AI संवादी वर्कफ़्लो के बिना, शुद्ध रूप से लिप सिंक सुविधा पर केंद्रित है। यदि आप विभिन्न ऑडियो स्रोतों के साथ लिप सिंक को कार्य करते हुए देखना चाहते हैं तो उपयुक्त है।

प्रमुख वीडियो

डाउनलोड

इसमें क्या शामिल है

यह डेमो बुनियादी लिप सिंक वर्कफ़्लो को प्रदर्शित करता है:

- माइक्रोफ़ोन इनपुट - लाइव ऑडियो से रीयल-टाइम लिप सिंक

- ऑडियो फ़ाइल प्लेबैक - इम्पोर्टेड ऑडियो फ़ाइलों से लिप सिंक

- टेक्स्ट-टू-स्पीच - संश्लेषित भाषण द्वारा संचालित लिप सिंक

आवश्यक और वैकल्पिक प्लगइन्स

| प्लगइन | उद्देश्य | आवश्यक? |

|---|---|---|

| Runtime MetaHuman Lip Sync | लिप सिंक एनीमेशन | ✅ आवश्यक |

| Runtime Audio Importer | ऑडियो आयात और कैप्चर | ✅ आवश्यक |

| Runtime Text To Speech | TTS डेमो दृश्य के लिए स्थानीय TTS | 🔶 वैकल्पिक |

| Runtime AI Chatbot Integrator | बाहरी TTS प्रदाता (OpenAI, ElevenLabs) | 🔶 वैकल्पिक |

Standard Lip Sync Model के लिए नोट्स

यदि आप किसी भी डेमो प्रोजेक्ट में Standard Model (Realistic के बजाय) का उपयोग करने की योजना बना रहे हैं, तो आपको Standard Lip Sync Extension प्लगइन इंस्टॉल करने की आवश्यकता होगी। इंस्टॉलेशन निर्देशों के लिए Standard Model Extension देखें।

मदद चाहिए?

यदि आपको डेमो प्रोजेक्ट सेट अप करने या चलाने में कोई समस्या आती है, तो बेझिझक संपर्क करें:

कस्टम विकास अनुरोधों के लिए (जैसे कि अपने स्वयं के तर्क के साथ डेमो का विस्तार करना, इसे किसी विशिष्ट प्लेटफ़ॉर्म या कैरेक्टर पाइपलाइन के लिए अनुकूलित करना), [email protected] पर संपर्क करें।