सेटअप गाइड

यह गाइड आपको अपने मेटाह्यूमन कैरेक्टर्स के साथ रनटाइम मेटाह्यूमन लिप सिंक के बेसिक सेटअप प्रक्रिया के माध्यम से ले जाती है।

नोट: रनटाइम मेटाह्यूमन लिप सिंक मेटाह्यूमन और कस्टम कैरेक्टर्स दोनों के साथ काम करता है। कस्टम कैरेक्टर्स सेट करने के विस्तृत निर्देशों के लिए, कस्टम कैरेक्टर सेटअप गाइड देखें।

पूर्वापेक्षाएँ

शुरू करने से पहले, सुनिश्चित करें:

-

मेटाह्यूमन प्लगइन आवश्यकताएँ:

- यूई 5.5 और पहले: अपने प्रोजेक्ट में मेटाह्यूमन प्लगइन सक्षम करें

- यूई 5.6 और बाद में: अपने प्रोजेक्ट में मेटाह्यूमन कोर टेक प्लगइन सक्षम करें

अतिरिक्त मेटाह्यूमन प्लगइन्सआप अपने मेटाह्यूमन कैरेक्टर्स कैसे बनाते हैं, इस पर निर्भर करते हुए, आपको अतिरिक्त प्लगइन्स की आवश्यकता हो सकती है। उदाहरण के लिए, यदि आप यूई 5.6 में पेश किए गए नए मेटाह्यूमन क्रिएटर सिस्टम के साथ एक मेटाह्यूमन बनाना चाहते हैं, तो आपको मेटाह्यूमन क्रिएटर प्लगइन भी सक्षम करना होगा। इस सिस्टम के बारे में अधिक जानकारी के लिए, मेटाह्यूमन क्रिएटर दस्तावेज़ीकरण देखें।

-

आपके पास कम से कम एक मेटाह्यूमन कैरेक्टर डाउनलोड और आपके प्रोजेक्ट में उपलब्ध है

-

रनटाइम मेटाह्यूमन लिप सिंक प्लगइन इंस्टॉल है

स्टैंडर्ड मॉडल एक्सटेंशन प्लगइन

यदि आप स्टैंडर्ड मॉडल का उपयोग करने की योजना बना रहे हैं, तो आपको एक्सटेंशन प्लगइन इंस्टॉल करने की आवश्यकता होगी:

- स्टैंडर्ड लिप सिंक एक्सटेंशन प्लगइन को यहाँ से डाउनलोड करें

- डाउनलोड की गई आर्काइव से फ़ोल्डर को अपने प्रोजेक्ट के

Pluginsफ़ोल्डर में निकालें (यदि यह फ़ोल्डर मौजूद नहीं है तो इसे बनाएं) - सुनिश्चित करें कि आपका प्रोजेक्ट एक C++ प्रोजेक्ट के रूप में सेट है (भले ही आपके पास कोई C++ कोड न हो)

- अपने प्रोजेक्ट को रीबिल्ड करें

- यह एक्सटेंशन केवल तभी आवश्यक है जब आप स्टैंडर्ड मॉडल का उपयोग करना चाहते हैं। यदि आपको केवल यथार्थवादी मॉडल की आवश्यकता है, तो आप इस चरण को छोड़ सकते हैं।

- प्लगइन्स को मैन्युअल रूप से बनाने के तरीके के बारे में अधिक जानकारी के लिए, बिल्डिंग प्लगइन्स ट्यूटोरियल देखें

अतिरिक्त प्लगइन्स

- यदि आप ऑडियो कैप्चर (जैसे, माइक्रोफ़ोन इनपुट) का उपयोग करने की योजना बना रहे हैं, तो रनटाइम ऑडियो इम्पोर्टर प्लगइन इंस्टॉल करें।

- यदि आप टेक्स्ट-टू-स्पीच कार्यक्षमता का उपयोग करने की योजना बना रहे हैं:

- लोकल TTS (स्टैंडर्ड मॉडल और मूड-सक्षम यथार्थवादी मॉडल) के लिए, Runtime Text To Speech प्लगइन इंस्टॉल करें।

- बाहरी TTS प्रदाताओं (ElevenLabs, OpenAI, Google Cloud, Azure) के लिए, Audio Analysis Tools प्लगइन इंस्टॉल करें।

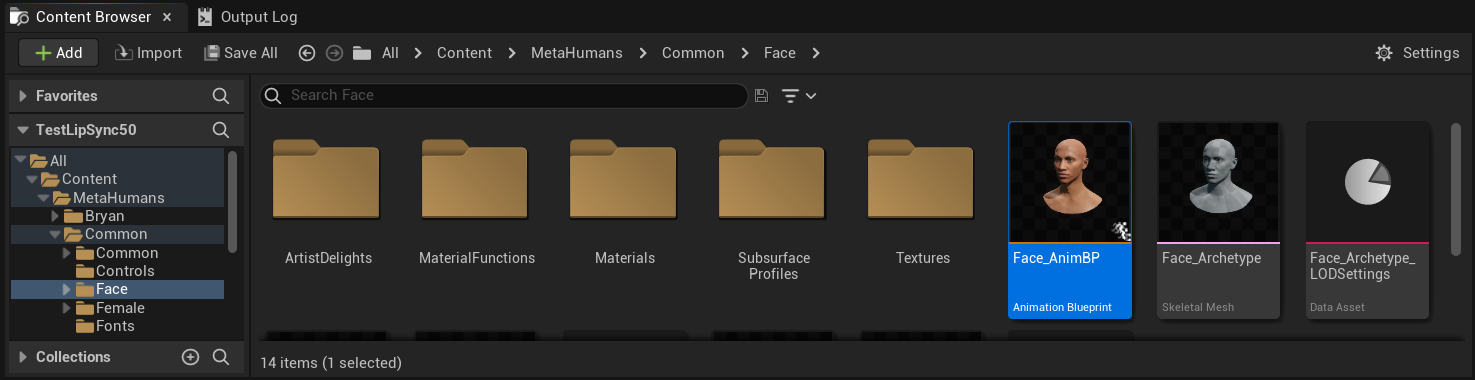

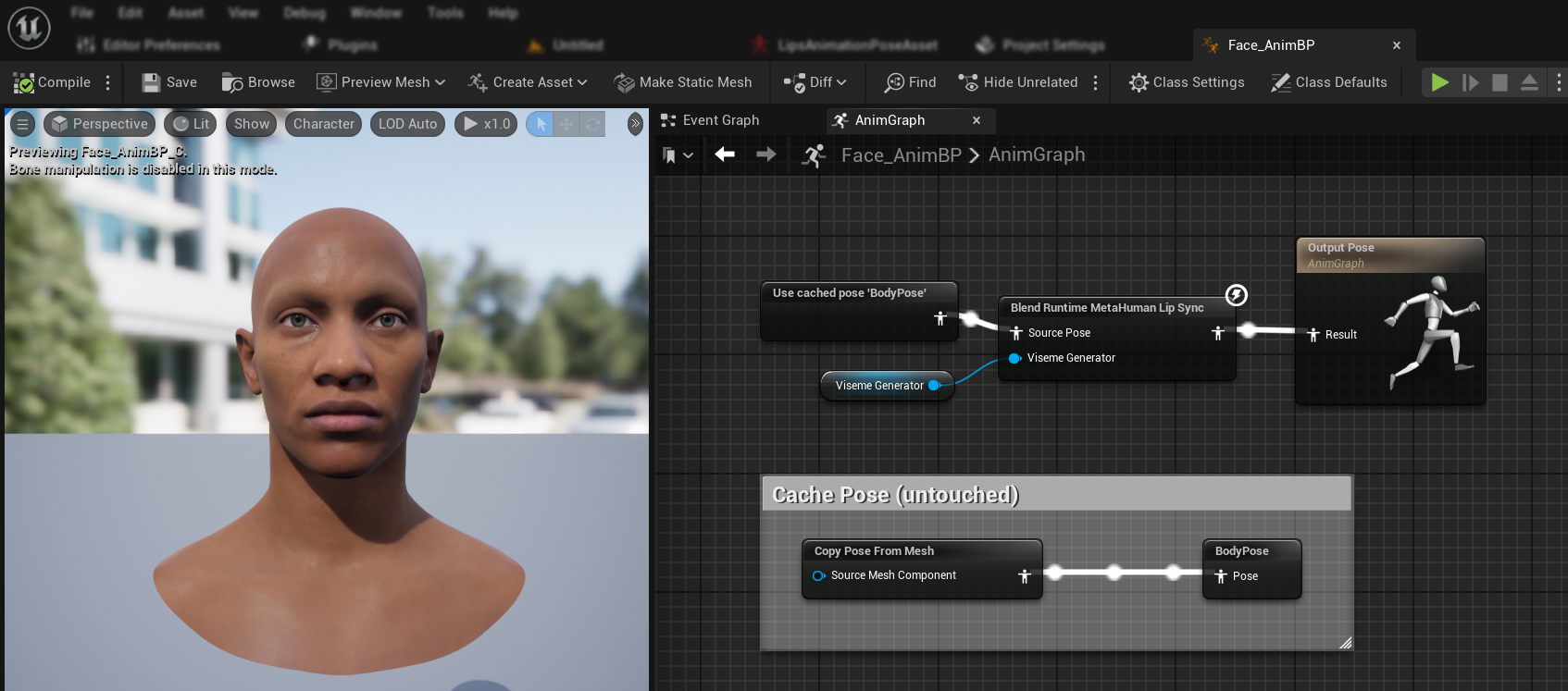

एनीमेशन ब्लूप्रिंट सेटअप

चरण 1: फेस एनीमेशन ब्लूप्रिंट का पता लगाएं और संशोधित करें

- यूई 5.5 और पहले (या यूई 5.6+ में लीगेसी मेटाह्यूमन्स)

- UE 5.6+ MetaHuman Creator कैरेक्टर्स

आपको एक एनीमेशन ब्लूप्रिंट को संशोधित करने की आवश्यकता है जो आपके मेटाह्यूमन कैरेक्टर के फेशियल एनिमेशन के लिए उपयोग किया जाएगा। डिफ़ॉल्ट मेटाह्यूमन फेस एनीमेशन ब्लूप्रिंट यहाँ स्थित है:

Content/MetaHumans/Common/Face/Face_AnimBP

आपके पास लिप सिंक कार्यक्षमता को लागू करने के लिए कई विकल्प हैं:

- डिफ़ॉल्ट एसेट को सीधे संपादित करें (सबसे सरल विकल्प)

- डुप्लिकेट बनाएं

- कस्टम एनीमेशन ब्लूप्रिंट का उपयोग करें

डिफ़ॉल्ट Face_AnimBP को सीधे खोलें और अपने संशोधन करें। किसी भी परिवर्तन का प्रभाव इस एनीमेशन ब्लूप्रिंट का उपयोग करने वाले सभी MetaHuman कैरेक्टर्स पर पड़ेगा।

नोट: यह दृष्टिकोण सुविधाजनक है लेकिन डिफ़ॉल्ट एनीमेशन ब्लूप्रिंट का उपयोग करने वाले सभी कैरेक्टर्स को प्रभावित करेगा।

Face_AnimBPकी डुप्लिकेट बनाएं और उसे एक वर्णनात्मक नाम दें- अपने कैरेक्टर की ब्लूप्रिंट क्लास ढूंढें (उदाहरण के लिए, कैरेक्टर "Bryan" के लिए, यह

Content/MetaHumans/Bryan/BP_Bryanपर होगी) - कैरेक्टर ब्लूप्रिंट खोलें और Face कंपोनेंट ढूंढें

- Anim Class प्रॉपर्टी को अपने नए बनाए गए डुप्लिकेट एनीमेशन ब्लूप्रिंट में बदलें

नोट: यह दृष्टिकोण आपको विशिष्ट कैरेक्टर्स के लिए लिप सिंक को अनुकूलित करने की अनुमति देता है जबकि अन्य को अपरिवर्तित छोड़ देता है।

आप लिप सिंक ब्लेंडिंग को किसी भी एनीमेशन ब्लूप्रिंट में लागू कर सकते हैं जिसकी आवश्यक फेशियल बोन्स तक पहुंच हो:

- एक कस्टम एनीमेशन ब्लूप्रिंट बनाएं या मौजूदा का उपयोग करें

- सुनिश्चित करें कि आपका एनीमेशन ब्लूप्रिंट एक ऐसी स्केलेटन के साथ काम करता है जिसमें डिफ़ॉल्ट MetaHuman की

Face_Archetype_Skeletonके समान फेशियल बोन्स हों

नोट: यह दृष्टिकोण आपको कस्टम एनीमेशन सिस्टम के साथ एकीकरण के लिए अधिकतम लचीलापन प्रदान करता है।

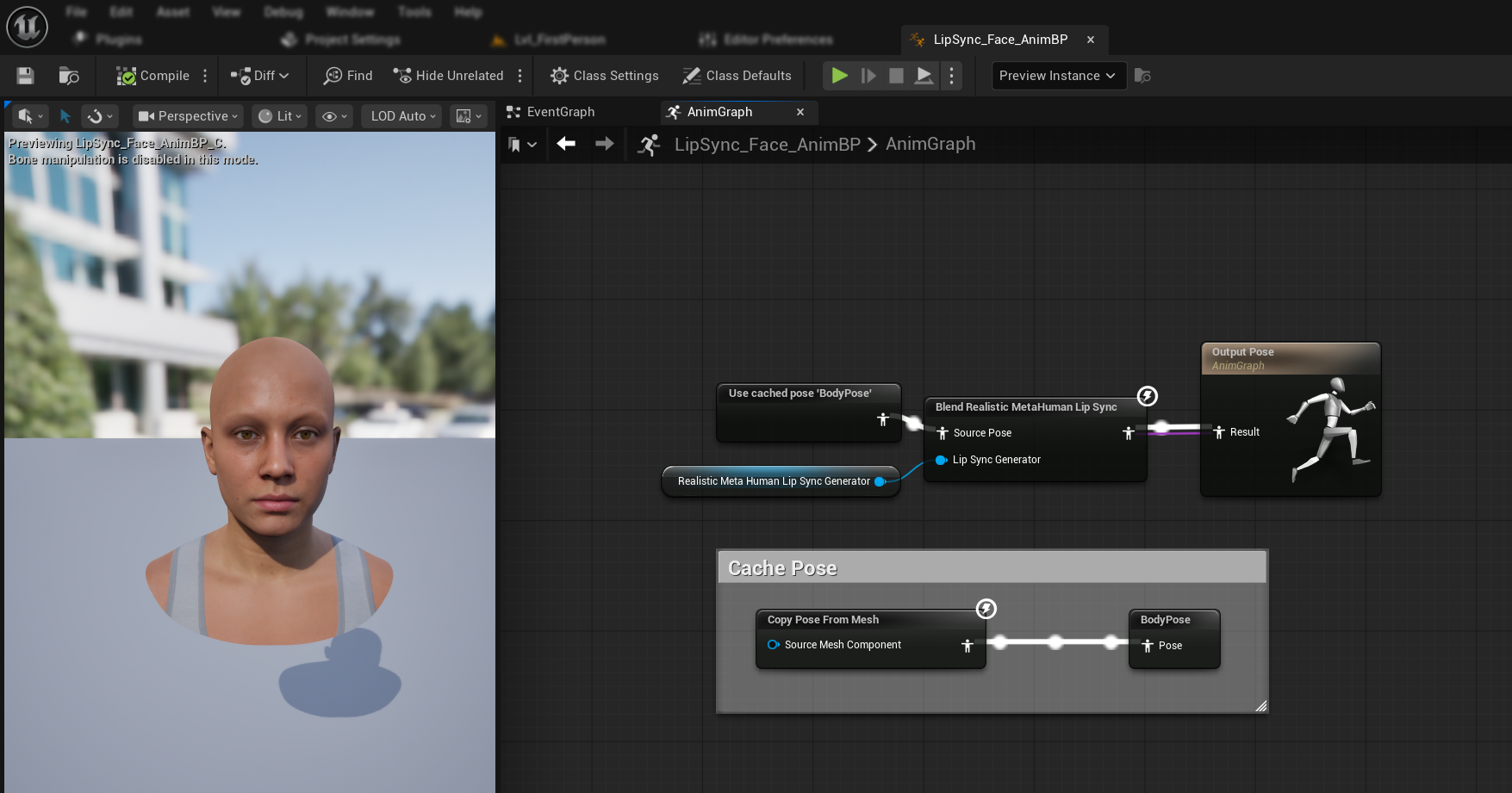

UE 5.6 से शुरू होकर, नई MetaHuman Creator प्रणाली पेश की गई थी। इन कैरेक्टर्स के लिए, प्लगइन एक फेस एनीमेशन ब्लूप्रिंट प्रदान करता है जो यहां स्थित है:

Content/LipSyncData/LipSync_Face_AnimBP

यह एनीमेशन ब्लूप्रिंट प्लगइन की कंटेंट फ़ोल्डर में स्थित है और प्रत्येक प्लगइन अपडेट के साथ अधिलेखित हो जाएगा। अपने कस्टमाइज़ेशन को खोने से बचाने के लिए:

- इस एसेट को अपने प्रोजेक्ट की कंटेंट फ़ोल्डर में कॉपी करें (उदाहरण के लिए,

YourProject/Content/MetaHumans/LipSync_Face_AnimBPमें) - अपने कैरेक्टर सेटअप में अपनी कॉपी किए गए संस्करण का उपयोग करें

- अपने सभी संशोधन कॉपी किए गए संस्करण में करें

प्लगइन के फेस एनीमेशन ब्लूप्रिंट का उपयोग करना:

- अपने MetaHuman Creator कैरेक्टर के ब्लूप्रिंट क्लास का पता लगाएं

- कैरेक्टर ब्लूप्रिंट खोलें और Face कंपोनेंट ढूंढें

- Anim Class प्रॉपर्टी को प्लगइन के

LipSync_Face_AnimBPमें बदलें - Runtime MetaHuman Lip Sync कार्यक्षमता को कॉन्फ़िगर करने के लिए अगले चरणों के साथ जारी रखें

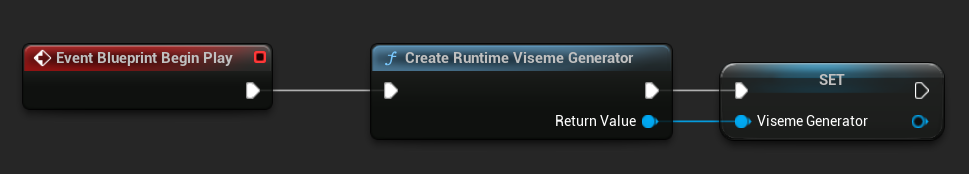

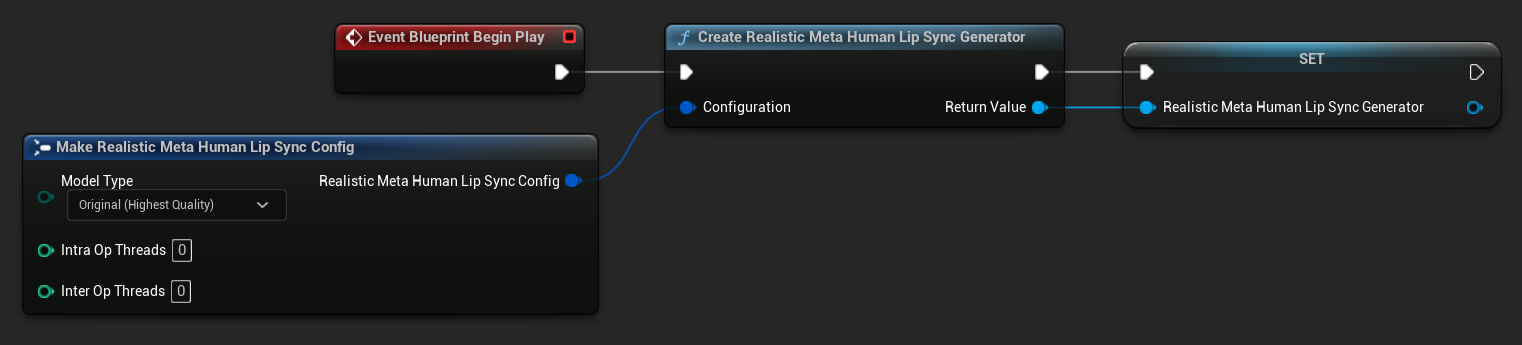

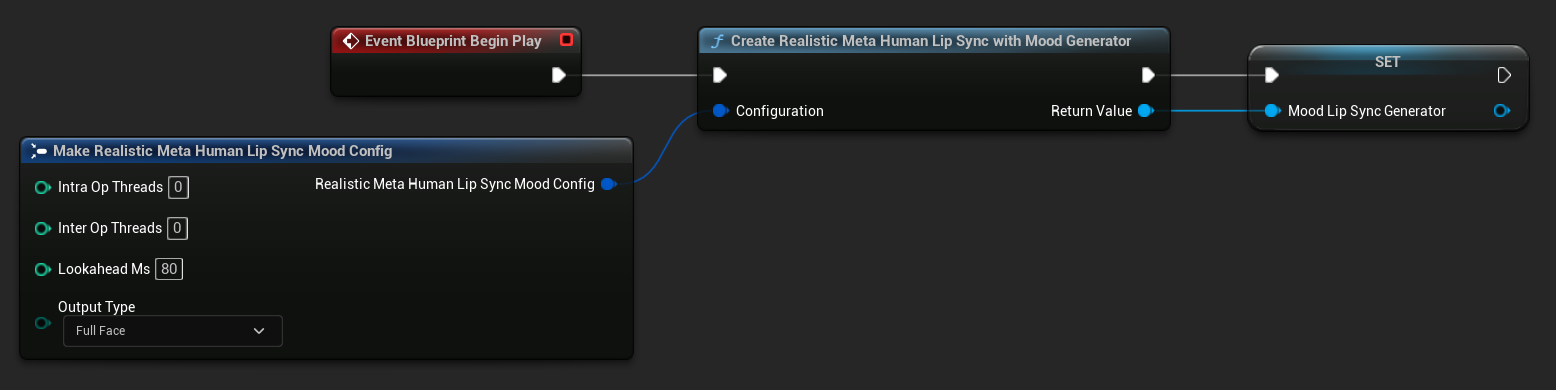

चरण 2: इवेंट ग्राफ़ सेटअप

अपना Face Animation Blueprint खोलें और Event Graph पर स्विच करें। आपको एक जनरेटर बनाने की आवश्यकता होगी जो ऑडियो डेटा को प्रोसेस करेगा और लिप सिंक एनीमेशन उत्पन्न करेगा।

- स्टैंडर्ड मॉडल

- यथार्थवादी मॉडल

- मूड-सक्षम यथार्थवादी मॉडल

Event Blueprint Begin Playनोड जोड़ें यदि यह पहले से मौजूद नहीं हैCreate Runtime Viseme Generatorनोड जोड़ें और इसे Begin Play इवेंट से कनेक्ट करें- आउटपुट को एक वेरिएबल के रूप में सेव करें (जैसे "VisemeGenerator") ग्राफ़ के अन्य भागों में उपयोग के लिए

विस्तृत कॉन्फ़िगरेशन विकल्पों के लिए, स्टैंडर्ड मॉडल कॉन्फ़िगरेशन सेक्शन देखें।

Event Blueprint Begin Playनोड जोड़ें यदि यह पहले से मौजूद नहीं हैCreate Realistic MetaHuman Lip Sync Generatorनोड जोड़ें और इसे Begin Play इवेंट से कनेक्ट करें- आउटपुट को एक वेरिएबल के रूप में सेव करें (जैसे "RealisticMetaHumanLipSyncGenerator") ग्राफ़ के अन्य भागों में उपयोग के लिए

- (वैकल्पिक) कॉन्फ़िगरेशन पैरामीटर का उपयोग करके जनरेटर सेटिंग्स कॉन्फ़िगर करें

मॉडल प्रकार, प्रदर्शन सेटिंग्स और प्रोसेसिंग पैरामीटर सहित विस्तृत कॉन्फ़िगरेशन विकल्पों के लिए, यथार्थवादी मॉडल कॉन्फ़िगरेशन सेक्शन देखें।

Event Blueprint Begin Playनोड जोड़ें यदि यह पहले से मौजूद नहीं हैCreate Realistic MetaHuman Lip Sync With Mood Generatorनोड जोड़ें और इसे Begin Play इवेंट से कनेक्ट करें- आउटपुट को एक वेरिएबल के रूप में सेव करें (जैसे "MoodMetaHumanLipSyncGenerator") ग्राफ़ के अन्य भागों में उपयोग के लिए

- (वैकल्पिक) कॉन्फ़िगरेशन पैरामीटर का उपयोग करके जनरेटर सेटिंग्स कॉन्फ़िगर करें

मूड प्रकार, तीव्रता सेटिंग्स, लुकअहेड टाइमिंग और आउटपुट प्रकार चयन सहित विस्तृत मूड कॉन्फ़िगरेशन के लिए, मूड-सक्षम मॉडल कॉन्फ़िगरेशन सेक्शन देखें।

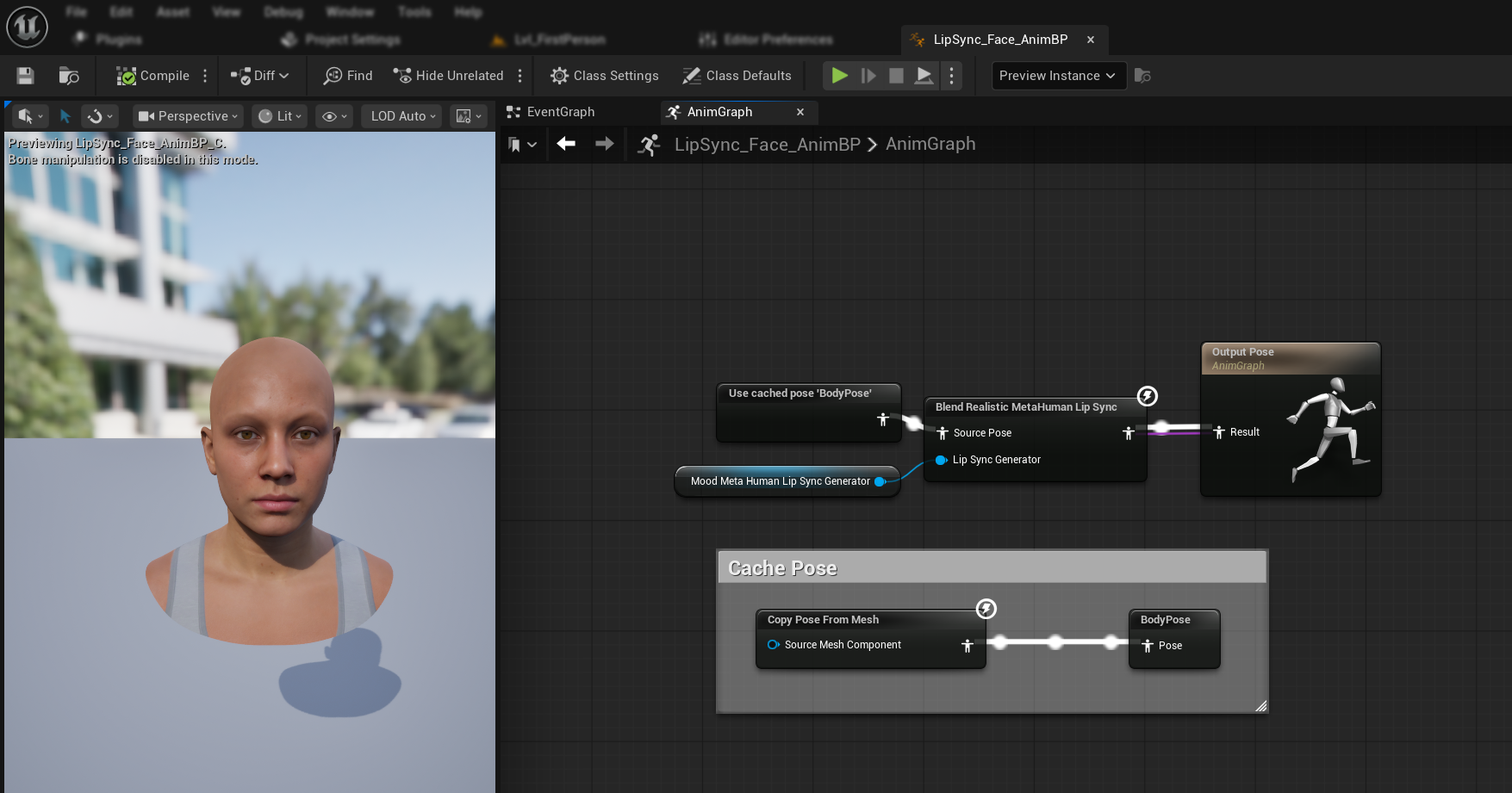

चरण 3: एनिम ग्राफ़ सेटअप

इवेंट ग्राफ़ सेटअप करने के बाद, जनरेटर को कैरेक्टर की एनीमेशन से कनेक्ट करने के लिए Anim Graph पर स्विच करें:

- स्टैंडर्ड मॉडल

- यथार्थवादी मॉडल

- मूड-सक्षम यथार्थवादी मॉडल

- वह पोज़ ढूंढें जिसमें MetaHuman फेस होता है (आमतौर पर

Use cached pose 'Body Pose'से) Blend Runtime MetaHuman Lip Syncनोड जोड़ें- पोज़ को

Blend Runtime MetaHuman Lip Syncनोड केSource Poseसे कनेक्ट करें - अपने

VisemeGeneratorवेरिएबल कोViseme Generatorपिन से कनेक्ट करें Blend Runtime MetaHuman Lip Syncनोड के आउटपुट कोOutput PoseकेResultपिन से कनेक्ट करें

- वह पोज़ ढूंढें जिसमें MetaHuman फेस होता है (आमतौर पर

Use cached pose 'Body Pose'से) Blend Realistic MetaHuman Lip Syncनोड जोड़ें- पोज़ को

Blend Realistic MetaHuman Lip Syncनोड केSource Poseसे कनेक्ट करें - अपने

RealisticMetaHumanLipSyncGeneratorवेरिएबल कोLip Sync Generatorपिन से कनेक्ट करें Blend Realistic MetaHuman Lip Syncनोड के आउटपुट कोOutput PoseकेResultपिन से कनेक्ट करें

- वह पोज़ ढूंढें जिसमें MetaHuman फेस होता है (आमतौर पर

Use cached pose 'Body Pose'से) Blend Realistic MetaHuman Lip Syncनोड जोड़ें (नियमित यथार्थवादी मॉडल के समान नोड)- पोज़ को

Blend Realistic MetaHuman Lip Syncनोड केSource Poseसे कनेक्ट करें - अपने

MoodMetaHumanLipSyncGeneratorवेरिएबल कोLip Sync Generatorपिन से कनेक्ट करें Blend Realistic MetaHuman Lip Syncनोड के आउटपुट कोOutput PoseकेResultपिन से कनेक्ट करें

नोट: मूड-सक्षम मॉडल नियमित यथार्थवादी मॉडल के समान ही एनीमेशन ब्लूप्रिंट नोड का उपयोग करता है। मूड कार्यक्षमता जनरेटर द्वारा आंतरिक रूप से संभाली जाती है।

अगले चरण

अब जब आपका बेसिक एनीमेशन ब्लूप्रिंट सेटअप पूरा हो गया है, तो आपको अपने लिप सिंक जनरेटर को ऑडियो डेटा फीड करने के लिए ऑडियो इनपुट प्रोसेसिंग कॉन्फ़िगर करने की आवश्यकता होगी।

विभिन्न ऑडियो इनपुट विधियों को सेटअप करने का तरीका जानने के लिए ऑडियो प्रोसेसिंग गाइड पर जारी रखें, जिसमें माइक्रोफ़ोन कैप्चर, टेक्स्ट-टू-स्पीच और ऑडियो फ़ाइल प्रोसेसिंग शामिल है।

उन्नत कॉन्फ़िगरेशन विकल्पों और फ़ाइन-ट्यूनिंग के लिए, कॉन्फ़िगरेशन गाइड देखें।