Fornitori di Traduzione

L'AI Localization Automator supporta cinque diversi fornitori di IA, ciascuno con punti di forza e opzioni di configurazione unici. Scegli il fornitore che meglio si adatta alle esigenze, al budget e ai requisiti di qualità del tuo progetto.

Ollama (IA Locale)

Ideale per: Progetti sensibili alla privacy, traduzione offline, utilizzo illimitato

Ollama esegue modelli di IA localmente sulla tua macchina, fornendo privacy e controllo completi senza costi API o requisiti di internet.

Modelli Popolari

- translategemma:12b (Modello di traduzione specializzato basato su Gemma 3)

- llama3.2 (Scopo generale consigliato)

- mistral (Alternativa efficiente)

- codellama (Traduzioni consapevoli del codice)

- E molti altri modelli della community

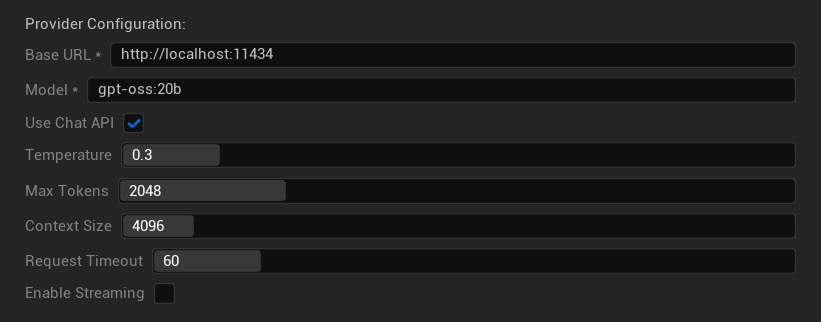

Opzioni di Configurazione

- URL Base: Server Ollama locale (predefinito:

http://localhost:11434) - Modello: Nome del modello installato localmente (obbligatorio)

- Usa Chat API: Abilita per una migliore gestione delle conversazioni

- Temperatura: 0.0-2.0 (0.3 consigliato)

- Token Massimi: 1-8.192 token

- Dimensione Contesto: 512-32.768 token

- Timeout Richiesta: 10-300 secondi (i modelli locali possono essere più lenti)

- Abilita Streaming: Per l'elaborazione delle risposte in tempo reale

Punti di Forza

- ✅ Privacy completa (nessun dato lascia la tua macchina)

- ✅ Nessun costo API o limite di utilizzo

- ✅ Funziona offline

- ✅ Controllo completo sui parametri del modello

- ✅ Ampia varietà di modelli della community

- ✅ Nessun vincolo al fornitore

Considerazioni

- 💻 Richiede configurazione locale e hardware adeguato

- ⚡ Generalmente più lento dei fornitori cloud

- 🔧 Configurazione più tecnica richiesta

- 📊 La qualità della traduzione varia significativamente in base al modello (alcuni possono superare i fornitori cloud)

- 💾 Grandi requisiti di archiviazione per i modelli

Configurazione di Ollama

- Installa Ollama: Scarica da ollama.ai e installa sul tuo sistema

- Scarica Modelli: Usa

ollama pull translategemma:12bper scaricare il modello scelto - Avvia Server: Ollama viene eseguito automaticamente, oppure avvia con

ollama serve - Configura Plugin: Imposta l'URL base e il nome del modello nelle impostazioni del plugin

- Test Connessione: Il plugin verificherà la connettività quando applichi la configurazione

OpenAI

Ideale per: Qualità di traduzione complessiva più alta, ampia selezione di modelli

OpenAI fornisce modelli linguistici all'avanguardia attraverso la loro Chat Completions API, inclusi gli ultimi modelli GPT, modelli di ragionamento e modelli abilitati alla ricerca web.

Modelli Disponibili

Famiglia GPT-5 (Modelli principali)

- gpt-5, gpt-5-mini, gpt-5-nano

- gpt-5.1, gpt-5.2, gpt-5.3-chat-latest

- gpt-5.4, gpt-5.4-mini, gpt-5.4-nano

Famiglia GPT-4.1 (Alte prestazioni)

- gpt-4.1, gpt-4.1-mini, gpt-4.1-nano

Famiglia GPT-4o (Multimodale)

- gpt-4o, gpt-4o-mini, chatgpt-4o-latest

Serie O (Modelli di ragionamento — temperatura/top_p non supportati)

- o1, o1-pro, o3, o3-mini, o4-mini

Modelli Ricerca Web (Temperatura/top_p non supportati)

- gpt-5-search-api, gpt-4o-search-preview, gpt-4o-mini-search-preview

Legacy / Anteprima

- gpt-4.5-preview, gpt-4, gpt-4-32k, gpt-4-turbo, gpt-3.5-turbo, gpt-3.5-turbo-16k

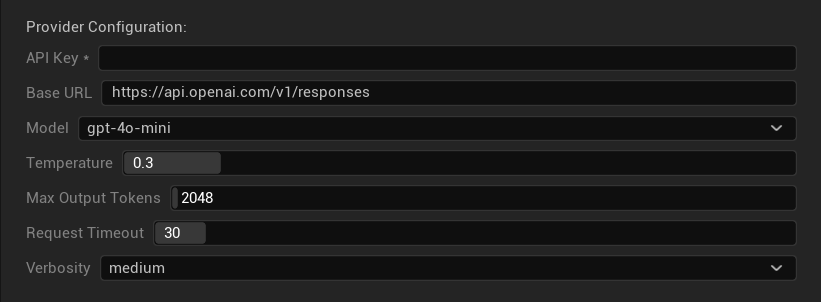

Opzioni di Configurazione

- Chiave API: La tua chiave API OpenAI (obbligatoria)

- URL Base: Endpoint API (predefinito:

https://api.openai.com/v1/chat/completions) - Modello: Scegli tra i modelli disponibili elencati sopra

- Usa Temperatura: Attiva/disattiva il parametro temperatura (ignorato automaticamente per i modelli di ragionamento serie o e ricerca web)

- Temperatura: 0.0–2.0 (0.3 consigliato per coerenza della traduzione)

- Top P: Parametro di campionamento nucleo 0.0–1.0 (ignorato per i modelli di ragionamento serie o e ricerca web)

- Token Completamento Massimi: 1–128.000 token (include sia token di output che di ragionamento)

- Timeout Richiesta: 5–300 secondi

Punti di Forza

- ✅ Traduzioni di qualità costantemente alta

- ✅ Eccellente comprensione del contesto

- ✅ Forte preservazione del formato

- ✅ Ampio supporto linguistico

- ✅ Affidabilità dell'API

Considerazioni

- 💰 Costo più alto per richiesta

- 🌐 Richiede connessione internet

- ⏱️ Limiti di utilizzo basati sul piano

Anthropic Claude

Ideale per: Traduzioni sfumate, contenuti creativi, applicazioni focalizzate sulla sicurezza

I modelli Claude eccellono nella comprensione del contesto e delle sfumature, rendendoli ideali per giochi ricchi di narrativa e scenari di localizzazione complessi.

Modelli Disponibili

Famiglia Claude 4.6 (Ultimi)

- claude-opus-4-6, claude-sonnet-4-6

Famiglia Claude 4.5

- claude-haiku-4-5 (Veloce ed efficiente)

- claude-sonnet-4-5, claude-opus-4-5

Famiglia Claude 4.x

- claude-sonnet-4-0, claude-opus-4-1, claude-opus-4-0

Famiglia Claude 3.x (Legacy)

- claude-3-7-sonnet-latest, claude-3-5-haiku-latest, claude-3-opus-latest

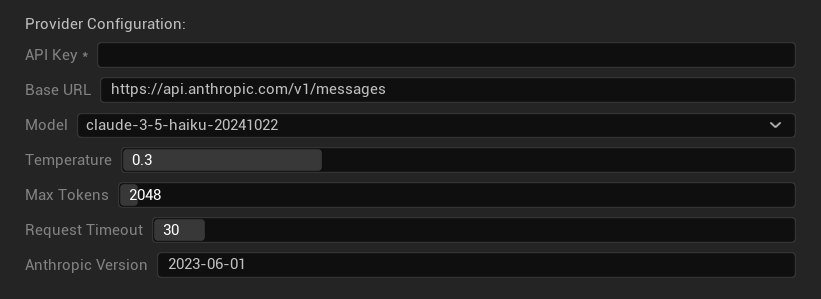

Opzioni di Configurazione

- Chiave API: La tua chiave API Anthropic (obbligatoria)

- URL Base: Endpoint API Claude

- Modello: Seleziona dalla famiglia di modelli Claude

- Temperatura: 0.0–1.0 (0.3 consigliato)

- Top K: Parametro di campionamento Top-K (0 = non impostato)

- Token Massimi: 1–64.000 token

- Timeout Richiesta: 5–300 secondi

- Versione Anthropic: Intestazione versione API

Punti di Forza

- ✅ Consapevolezza eccezionale del contesto

- ✅ Ottimo per contenuti creativi/narrativi

- ✅ Forti funzionalità di sicurezza

- ✅ Capacità di ragionamento dettagliate (pensiero esteso sui modelli 3.7+)

- ✅ Eccellente rispetto delle istruzioni

Considerazioni

- 💰 Modello di prezzo premium

- 🌐 Richiesta connessione internet

- 📏 Limiti di token variabili per modello

DeepSeek

Ideale per: Traduzione conveniente, alto throughput, progetti attenti al budget

DeepSeek offre una qualità di traduzione competitiva a una frazione del costo degli altri fornitori, rendendolo ideale per progetti di localizzazione su larga scala.

Modelli Disponibili

- deepseek-chat (Scopo generale, consigliato)

- deepseek-reasoner (Capacità di ragionamento potenziate)

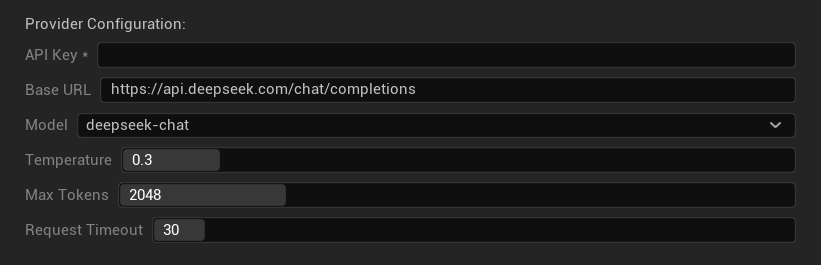

Opzioni di Configurazione

- Chiave API: La tua chiave API DeepSeek (obbligatoria)

- URL Base: Endpoint API DeepSeek

- Modello: Scegli tra modelli chat e reasoner

- Temperatura: 0.0-2.0 (0.3 consigliato)

- Token Massimi: 1-8.192 token

- Timeout Richiesta: 5-300 secondi

Punti di Forza

- ✅ Molto conveniente

- ✅ Buona qualità di traduzione

- ✅ Tempi di risposta veloci

- ✅ Configurazione semplice

- ✅ Limiti di frequenza alti

Considerazioni

- 📏 Limiti di token più bassi

- 🆕 Fornitore più recente (meno esperienza consolidata)

- 🌐 Richiede connessione internet

Google Gemini

Ideale per: Progetti multilingue, traduzione conveniente, integrazione ecosistema Google

I modelli Gemini offrono forti capacità multilingue con prezzi competitivi e funzionalità uniche come la modalità thinking per un ragionamento potenziato.

Modelli Disponibili

Famiglia Gemini 3.x (Anteprima)

- gemini-3.1-pro-preview, gemini-3-pro-preview, gemini-3-flash-preview

Famiglia Gemini 2.5 (Con supporto thinking)

- gemini-2.5-pro (Principale con thinking)

- gemini-2.5-flash (Veloce, con supporto thinking)

- gemini-2.5-flash-lite (Variante leggera)

Famiglia Gemini 2.0

- gemini-2.0-flash, gemini-2.0-flash-lite

Alias Più Recenti

- gemini-flash-latest, gemini-flash-lite-latest

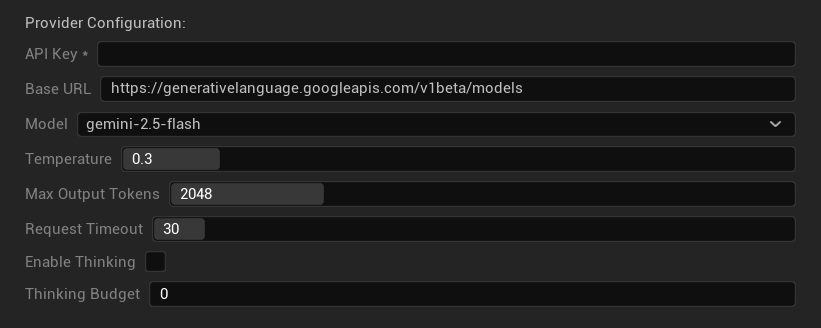

Opzioni di Configurazione

- Chiave API: La tua chiave API Google AI (obbligatoria)

- URL Base: Endpoint API Gemini

- Modello: Seleziona dalla famiglia di modelli Gemini

- Temperatura: 0.0–2.0 (0.3 consigliato)

- Token Output Massimi: 1–8.192 token

- Timeout Richiesta: 5–300 secondi

- Abilita Thinking: Attiva il ragionamento potenziato per i modelli 2.5+

- Budget Thinking: Controlla l'allocazione dei token di thinking (0 = nessun thinking)

Punti di Forza

- ✅ Forte supporto multilingue

- ✅ Prezzi competitivi

- ✅ Ragionamento avanzato (modalità thinking)

- ✅ Integrazione ecosistema Google

- ✅ Aggiornamenti regolari dei modelli con accesso in anteprima ai modelli più nuovi

Considerazioni

- 🧠 La modalità thinking aumenta l'uso dei token

- 📏 Limiti di token variabili per modello

- 🌐 Richiesta connessione internet

Scegliere il Fornitore Giusto

| Fornitore | Ideale Per | Qualità | Costo | Configurazione | Privacy |

|---|---|---|---|---|---|

| Ollama | Privacy/offline | Variabile* | Gratuito | Avanzata | Locale |

| OpenAI | Qualità più alta | ⭐⭐⭐⭐⭐ | 💰💰💰 | Semplice | Cloud |

| Claude | Contenuti creativi | ⭐⭐⭐⭐⭐ | 💰💰💰💰 | Semplice | Cloud |

| DeepSeek | Progetti budget | ⭐⭐⭐⭐ | 💰 | Semplice | Cloud |

| Gemini | Multilingue | ⭐⭐⭐⭐ | 💰 | Semplice | Cloud |

*La qualità per Ollama varia significativamente in base al modello locale utilizzato - alcuni modelli locali moderni possono eguagliare o superare i fornitori cloud.

Suggerimenti per la Configurazione del Fornitore

Per Tutti i Fornitori Cloud:

- Memorizza le chiavi API in modo sicuro e non commetterle al controllo versione

- Inizia con impostazioni di temperatura conservative (0.3) per traduzioni consistenti

- Monitora l'utilizzo e i costi della tua API

- Testa con piccoli lotti prima di eseguire grandi operazioni di traduzione

Per Ollama:

- Assicurati RAM adeguata (8GB+ consigliati per modelli più grandi)

- Usa archiviazione SSD per prestazioni di caricamento modello migliori

- Considera l'accelerazione GPU per inferenza più veloce

- Testa localmente prima di affidarti ad esso per traduzioni di produzione