推論パラメータ

LLM推論パラメータ構造体は、モデルのロードとテキスト生成の方法を制御します。モデルをロードするときにこれらのパラメータを渡します。このページでは、各パラメータとその効果について説明します。

パラメータリファレンス

| パラメータ | 型 | デフォルト | 範囲 | 説明 |

|---|---|---|---|---|

| 最大トークン数 | int32 | 512 | 1–8192 | 1回の応答で生成するトークンの最大数 |

| 温度 | float | 0.7 | 0.0–2.0 | ランダム性を制御します。0.0 = 決定的。値が高いほど創造的な出力になります |

| Top P | float | 0.9 | 0.0–1.0 | Nucleusサンプリング。この値を超える累積確率を持つトークンのみが候補となります |

| Top K | int32 | 40 | 0–200 | 最も確率の高い上位K個のトークンに選択肢を限定します。0 = 無効 |

| 繰り返しペナルティ | float | 1.1 | 0.0–3.0 | すでに出力に現れたトークンにペナルティを与えます。1.0 = ペナルティなし |

| GPUレイヤー数 | int32 | -1 | -1–200 | GPUにオフロードするモデルレイヤー数。-1 = 自動。0 = CPUのみ |

| コンテキストサイズ | int32 | 2048 | 128–131072 | トークン単位の最大コンテキストウィンドウ。より大きな値はより多くのメモリを使用します |

| システムプロンプト | FString | "You are a helpful assistant." | — | モデルの動作を形作るシステム指示 |

| シード | int32 | -1 | -1以上 | 再現可能な出力のためのランダムシード。-1 = ランダム |

| スレッド数 | int32 | 0 | 0–128 | 生成に使用するCPUスレッド数。0 = 自動 |

使用方法

- Blueprint

- C++

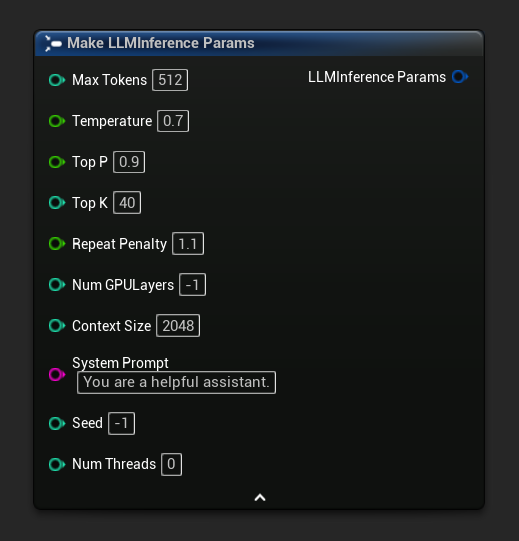

推論パラメータは、ロードノードや非同期ノードの構造体ピンとして表示されます。構造体を分割して個別の値を設定します。

デフォルトのパラメータセットを開始点として取得するには、Get Default Inference Params を使用します。

// Creative writing

FLLMInferenceParams CreativeParams;

CreativeParams.MaxTokens = 1024;

CreativeParams.Temperature = 1.2f;

CreativeParams.TopP = 0.95f;

CreativeParams.TopK = 80;

CreativeParams.RepeatPenalty = 1.2f;

CreativeParams.SystemPrompt = TEXT("You are a creative storyteller.");

// Factual / deterministic

FLLMInferenceParams FactualParams;

FactualParams.MaxTokens = 256;

FactualParams.Temperature = 0.1f;

FactualParams.TopP = 0.5f;

FactualParams.TopK = 10;

FactualParams.SystemPrompt = TEXT("Answer questions concisely and accurately.");

// Mobile-optimized

FLLMInferenceParams MobileParams;

MobileParams.MaxTokens = 128;

MobileParams.ContextSize = 1024;

MobileParams.NumGPULayers = 0;

MobileParams.NumThreads = 4;

MobileParams.SystemPrompt = TEXT("You are a helpful assistant. Keep responses brief.");

// Get defaults programmatically

FLLMInferenceParams DefaultParams = URuntimeLocalLLM::GetDefaultInferenceParams();

プラットフォームの推奨設定

モバイル / VR (Android, iOS, Meta Quest)

- コンテキストサイズ: 1024–2048

- GPUレイヤー数: 0 (CPUのみ) ただし、デバイスがGPUコンピュートをサポートしていることが確認されている場合を除く

- 最大トークン数: 応答性の高い対話のために256未満

- スレッド数: デバイスに応じて2~4

デスクトップ (Windows, Mac, Linux)

- コンテキストサイズ: ほとんどの会話では2048~8192

- GPUレイヤー数: -1 (自動) 利用可能な場合にGPUアクセラレーションを活用するため

- スレッド数: 0 (自動)

- 最大トークン数: 長めの応答には512~2048