デモプロジェクト

Runtime MetaHuman Lip Sync をすぐに使い始めるために、すぐに使用できる2つのデモプロジェクトが用意されています。どちらも Unreal Engine 5.6+ で構築されており、Blueprint-only で、Windows、Mac、Linux、iOS、Android、および Android ベースのプラットフォーム(Meta Quest を含む)でクロスプラットフォームで動作します。

利用可能なデモプロジェクト

- AI Conversational NPC / Interactive Avatar

- 基本リップシンクデモ

AI 会話アバターの完全なワークフロー - 音声認識、AI チャットボット (LLM)、テキスト読み上げ、リアルタイム リップシンクによるオーディオ再生を組み合わせ、すべてを 1 つのプロジェクトで実行します。幅広いユースケースに適しています - ゲーム、インタラクティブ キオスク、バーチャル プロダクション、博物館の展示、デジタル アシスタント、トレーニング シミュレーション など。

パイプラインの概要

🎤 Microphone → Speech Recognition → 💬 LLM Chatbot → 🔊 Text-to-Speech → 👄 Lip Sync + Playback

ビデオ

クイックプレビュー (~30秒)

動作中のデモの短いショーケースです。

完全なウォークスルー

セットアップ、設定、および会話パイプライン全体をカバーする詳細なウォークスルーです。

ダウンロード

必須およびオプションのプラグイン

このデモプロジェクトは モジュール式 です。利用したいプロバイダーに必要なプラグインだけが必要です。

| プラグイン | 目的 | 必須? |

|---|---|---|

| Runtime MetaHuman Lip Sync | リップシンクアニメーション | ✅ 常に |

| Runtime Audio Importer | 音声キャプチャおよび処理 | ✅ 常に |

| Runtime Speech Recognizer | オフライン音声認識 (whisper.cpp) | ✅ 常に |

| Runtime AI Chatbot Integrator | 外部LLM (OpenAI、Claude、DeepSeek、Gemini、Grok、Ollama) および/または 外部TTS (OpenAI、ElevenLabs) | 🔶 オプション |

| Runtime Local LLM | llama.cpp によるローカルLLM推論 (Llama、Mistral、Gemma など、GGUF モデル) | 🔶 オプション |

| Runtime Text To Speech | ローカルTTS (Piper および Kokoro 経由) | 🔶 オプション |

上記の各プラグインは個別にオプションですが、デモが動作するためには 少なくとも1つのLLMプロバイダー と 少なくとも1つのTTSプロバイダー が必要です。自由に組み合わせてください(例:ローカルLLM + ElevenLabs TTS、または OpenAI LLM + ローカルTTS)。

モジュールアーキテクチャ

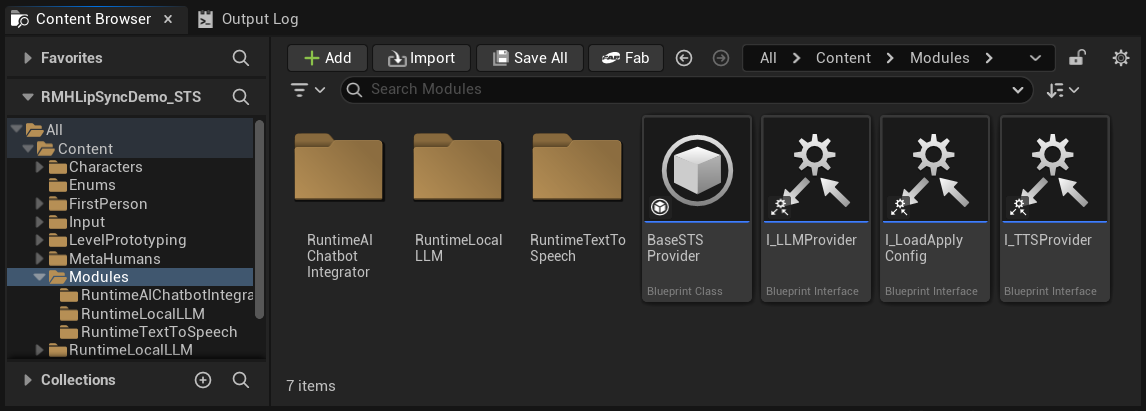

Content フォルダ内には、3つのサブフォルダを含む Modules フォルダがあります。

Content/

└── Modules/

├── RuntimeAIChatbotIntegrator/ ← External LLMs and/or external TTS

├── RuntimeLocalLLM/ ← Local LLM via llama.cpp

└── RuntimeTextToSpeech/ ← Local TTS via Piper/Kokoro

もしオプショナルプラグインを1つ(または複数)入手しなかった場合、該当するフォルダを削除してください。デモプロジェクトの基本アセット(ゲームインスタンス、ウィジェットなど)はこれらのモジュールを直接参照していないため、削除してもアセットの参照エラーは発生しません。設定UIは、フォルダが存在しないプロバイダーを自動的に非表示にします。

このモジュール性はLLMとTTSプロバイダーにのみ適用されます。音声認識(Runtime Speech Recognizer)とリップシンク(Runtime MetaHuman Lip Sync)はベースデモプロジェクトの一部であり、常に必要です。

初回起動時に、Unrealが不足しているオプショナルプラグインを無効にするか尋ねる場合があります。その際は、Yesをクリックしてください。また、対応するContent/Modules/フォルダも削除されていることを確認してください(上記参照)。

デモプロジェクトのレイアウト

以下に示すユーザーインターフェースは完全にUMG(Unreal Motion Graphics)で構築されており、音声認識 → LLM → TTS → リップシンクというパイプラインを示すためのものです。プロジェクトのビジュアルデザイン、操作方法、またはプラットフォーム(VR/AR、モバイル、コンソール、キオスクなど)に合わせて自由にスタイル変更または置き換えることができます。特定のウィジェットが不要な場合は、表示を折りたたみや非表示に設定して、シンプルに非表示にすることも可能です。

| エリア | 内容 |

|---|---|

| 中央 | MetaHumanキャラクター。 |

| 左側 | 4つの設定ボタン(音声認識、AIチャットボット、テキスト読み上げ、アニメーション)。詳細は後述。 |

| 中央下部 | 録音開始ボタン。クリックすると音声会話が始まります:マイク入力がキャプチャされ、文字起こしされ、LLMに送信され、応答がTTSで音声合成され、リップシンク付きで再生されます。完全にハンズフリーです。 |

| 右中央 | 会話履歴ウィジェット。ユーザーとAIの間のやりとり(ユーザーメッセージとアシスタントメッセージ)をすべて表示します。またテキスト入力フィールドも含まれており、音声認識を使わずに直接メッセージを入力できます。テストやアクセシビリティ、マイクが利用できない場合に便利です。 |

同じセッション内で両方の入力モードを自由に組み合わせることができます。一部のメッセージは話し、一部は入力する、といった使い方が可能です。

設定ボタン

左側の4つの設定ボタンは、パイプラインの各部分に対応した専用パネルを開きます:

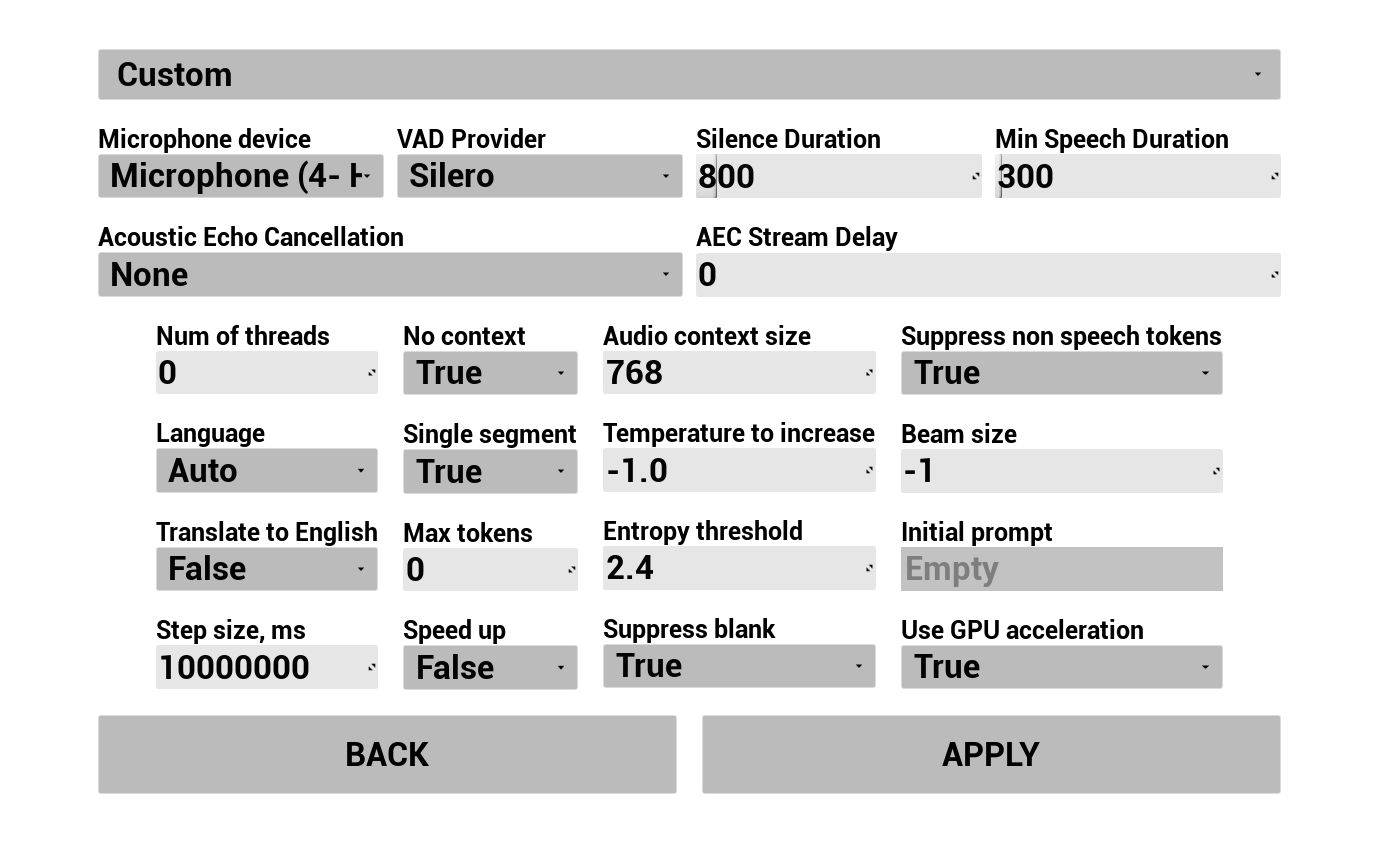

1. 音声認識の設定

ユーザーの声のキャプチャと文字起こし方法を設定します:

- 言語の選択

- 音声認識パラメータの調整(Whisperモデル設定)

- AEC(音響エコーキャンセレーション)の設定

- VAD(音声アクティビティ検出)の設定

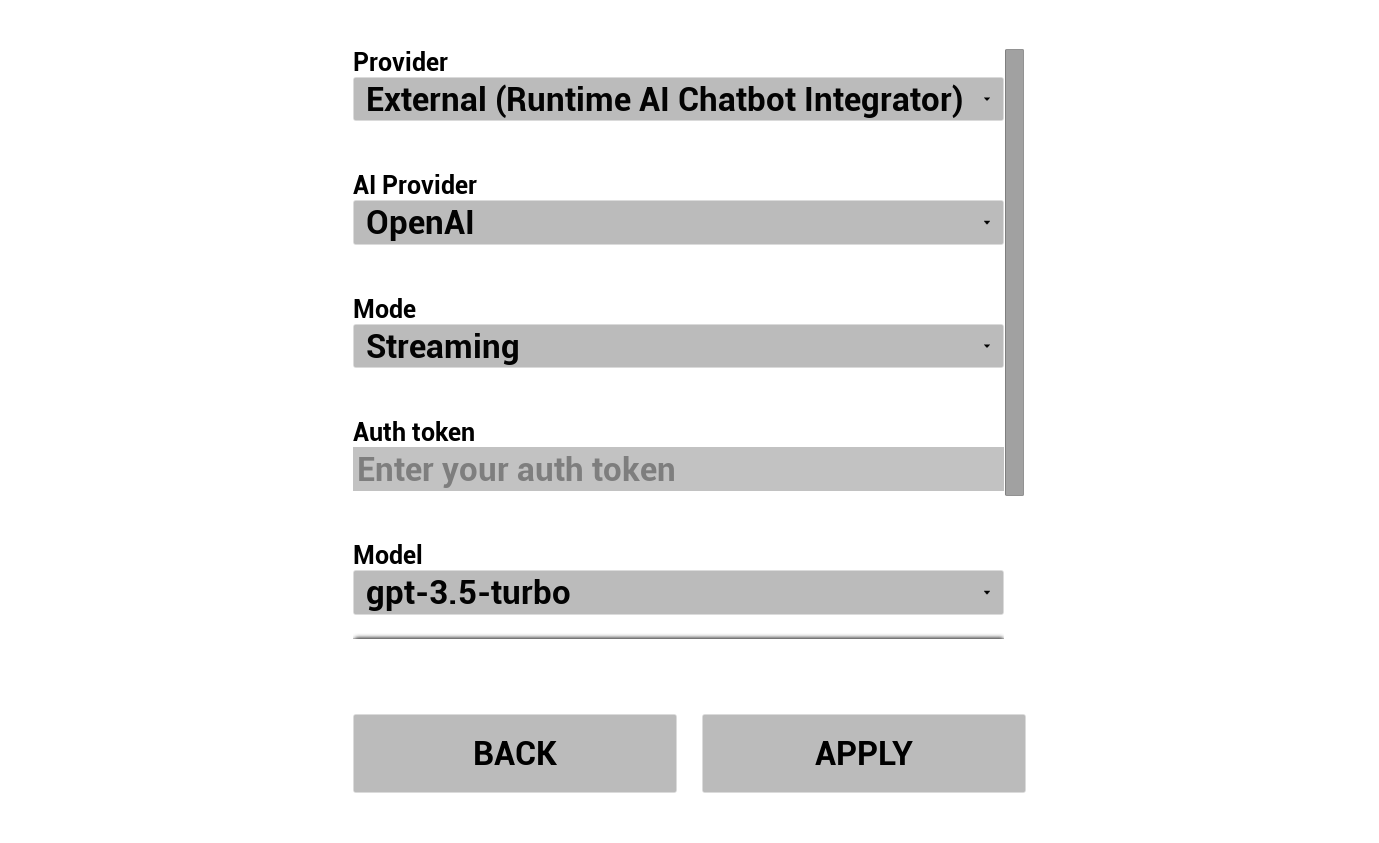

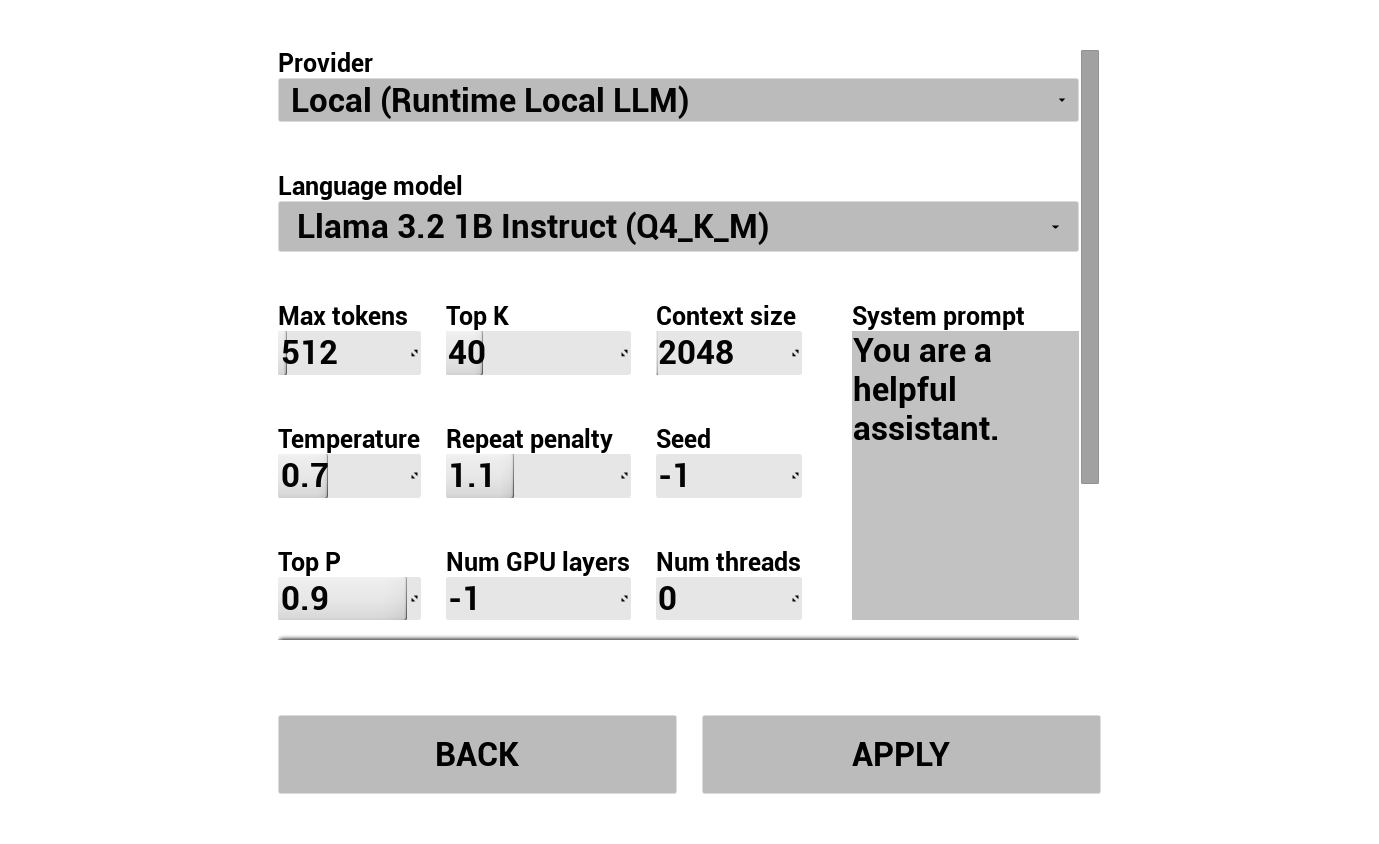

2. AIチャットボットの設定

LLMプロバイダーを選択し、設定します:

- プロバイダーの選択(Runtime AI Chatbot Integrator または Runtime Local LLM)

- 外部プロバイダーの場合:認証トークン、モデル名など

- ローカルLLMの場合:GGUFモデルの選択、コンテキストサイズなどの推論パラメータ設定。また、デモから直接実行時に自分のGGUFモデルをダウンロード(例:URL経由)し、プロジェクトを再ビルドせずにすぐに使用できます。

プロバイダーのコンボボックスには、Content/Modules/に当該プラグインモジュールフォルダが存在するプロバイダーのみが表示されます。

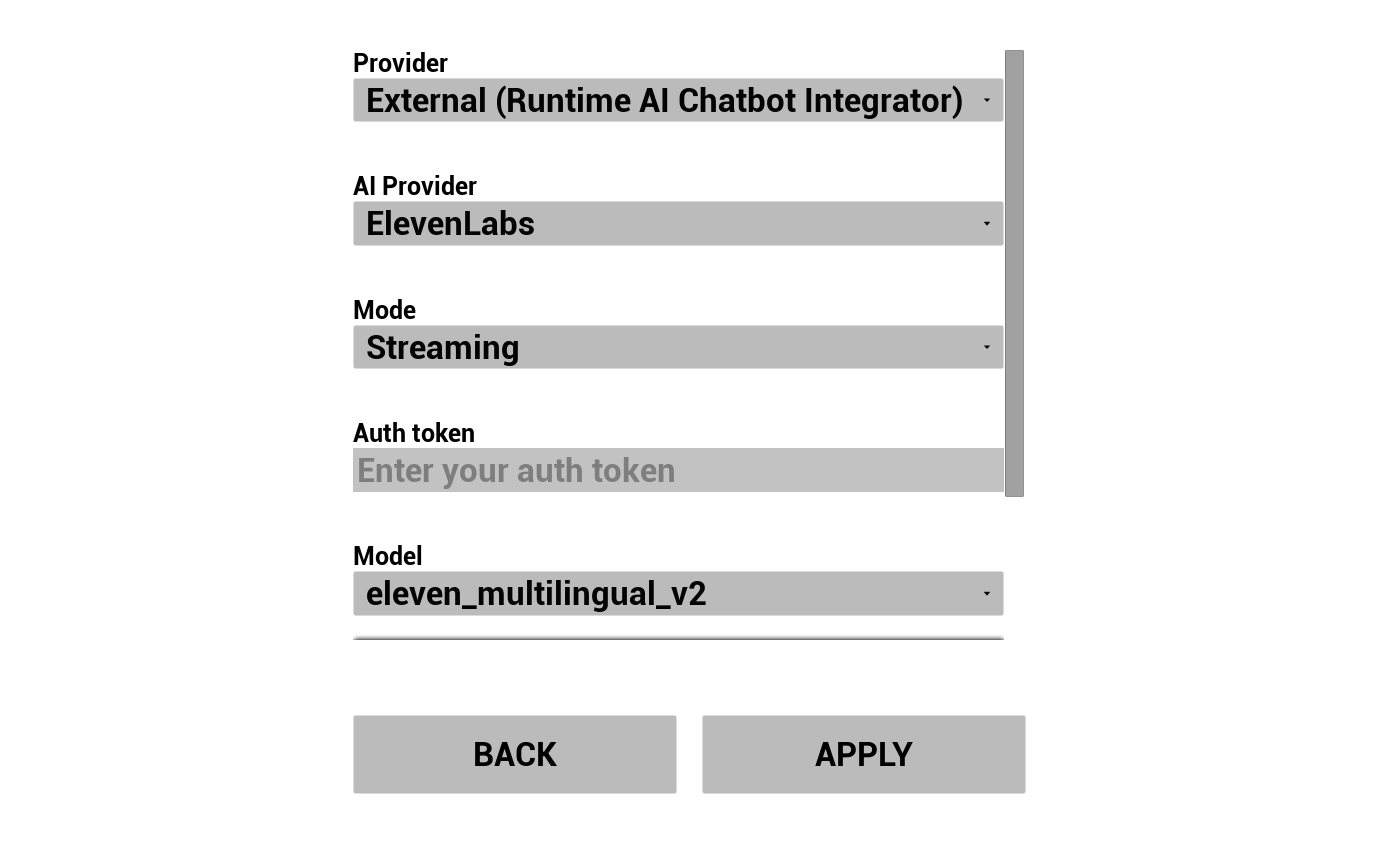

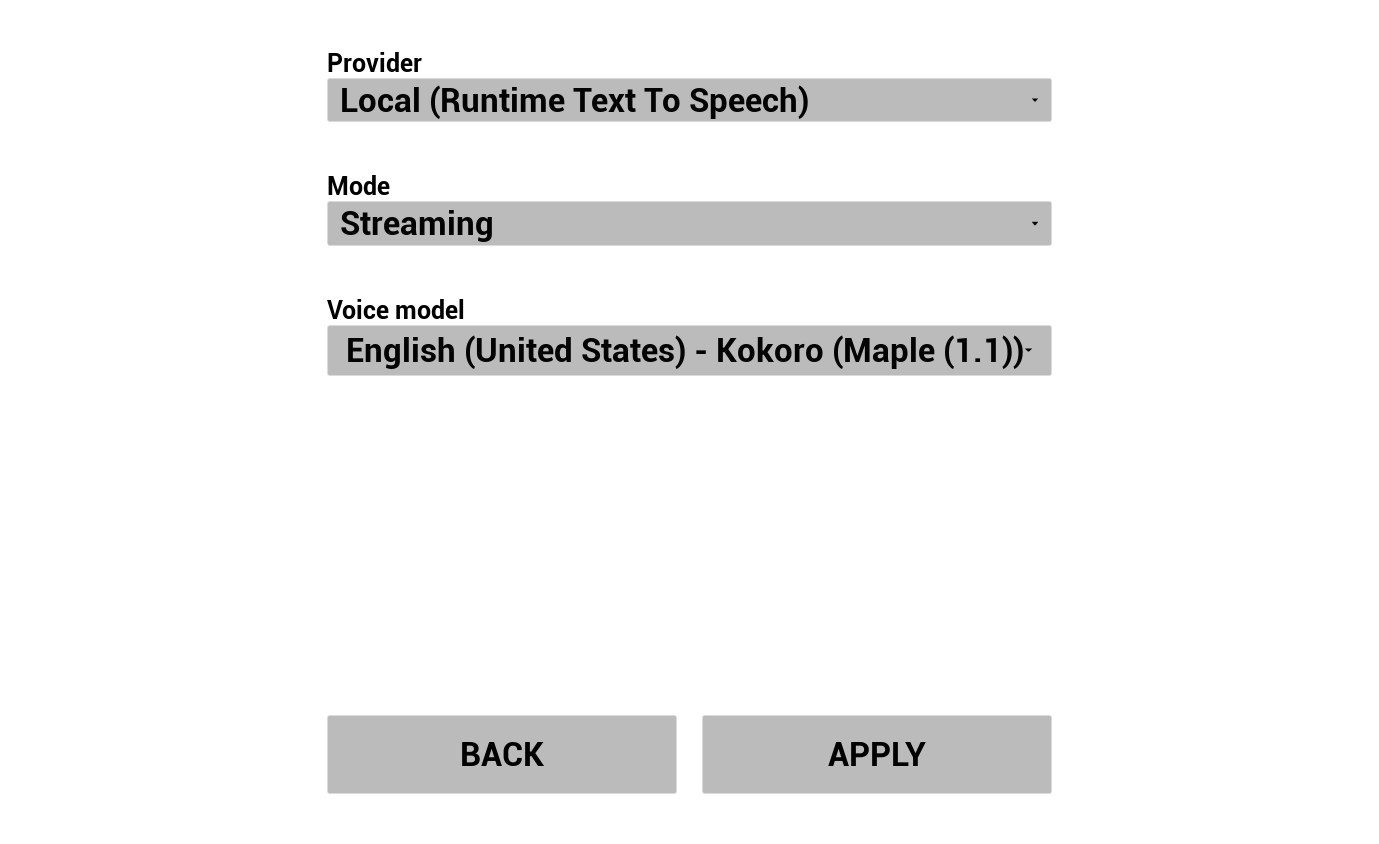

3. テキスト読み上げの設定

TTSプロバイダーを選択し、ボイス/モデルを設定します:

- プロバイダーの選択(OpenAI/ElevenLabs向けRuntime AI Chatbot Integrator、またはローカルPiper/Kokoro向けRuntime Text To Speech)

- ボイス/モデルの選択

- プロバイダー固有のパラメータ調整

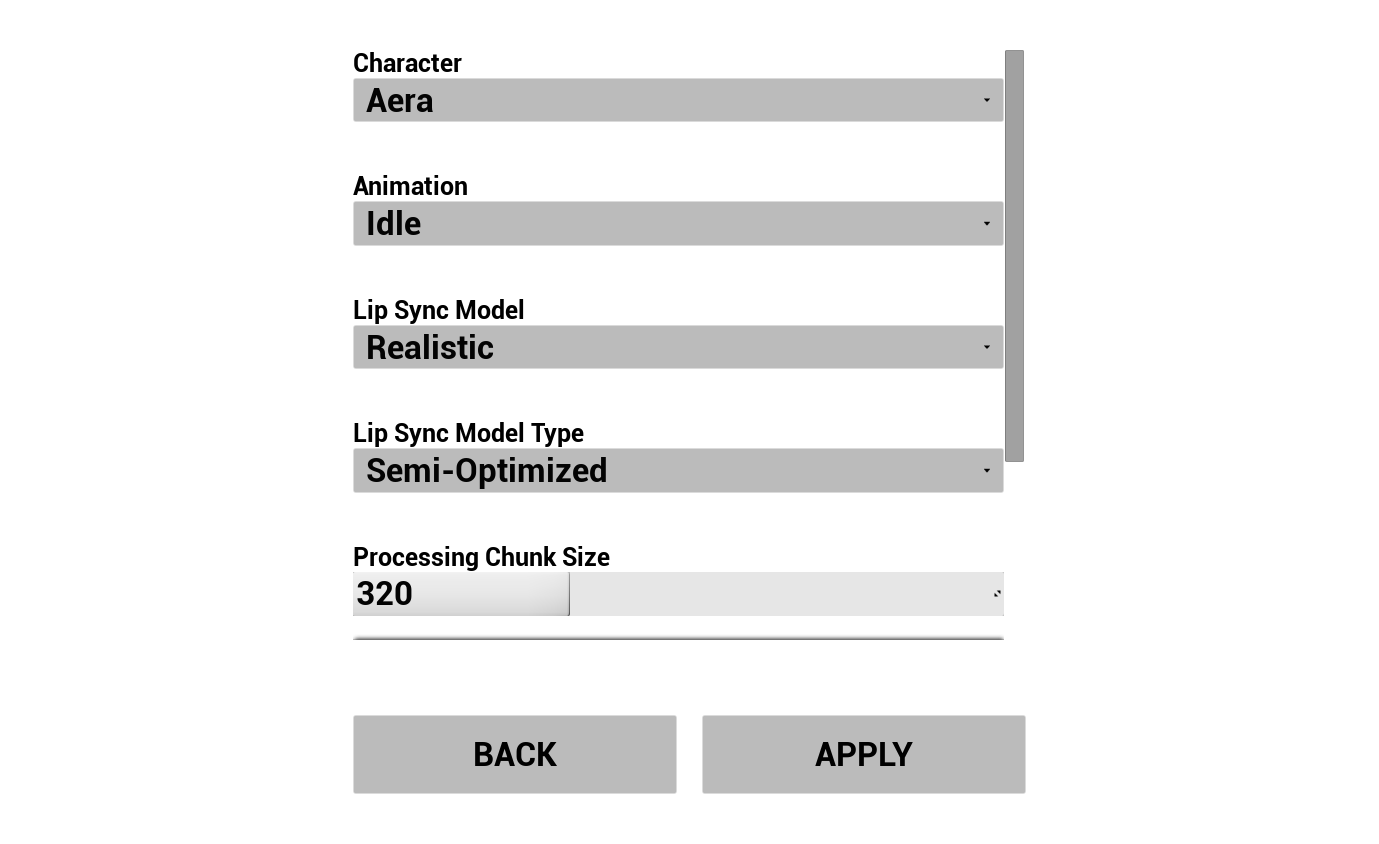

4. アニメーションの設定

AIアバターのビジュアルを制御します:

- 事前にダウンロードされた3つのMetaHumanキャラクター(Aera、Ada、Orlando)から選択

- リップシンクモデルの選択(Standard または Realistic)

- リップシンクモデルタイプの選択 - Highly Optimized、Semi-Optimized、Original(Model Typeを参照)

- 処理チャンクサイズの調整 - リップシンク推論の実行頻度を制御(Processing Chunk Sizeを参照)

- 会話中にMetaHumanに再生するアイドルアニメーションの選択

エディタでのデモの事前設定

ソースバージョンで作業する場合、エディタで直接デフォルト値を事前入力できるため、実行のたびに値を再入力する必要がありません:

| 項目 | 場所 |

|---|---|

| 一般設定(リップシンクモデル、アイドルアニメーション、キャラクタークラス、音声認識など) | Content/LipSyncSTSGameInstance |

| 外部LLM / 外部TTS 設定(Runtime AI Chatbot Integrator) | Content/Modules/RuntimeAIChatbotIntegrator/RuntimeAIChatbotIntegrator_Provider |

| ローカルLLM 設定(Runtime Local LLM) | Content/Modules/RuntimeLocalLLM/RuntimeLocalLLM_Provider |

| ローカルTTS 設定(Runtime Text To Speech) | Content/Modules/RuntimeTextToSpeech/RuntimeTextToSpeech_Provider |

クロスプラットフォームの注意点

デモで使用されるすべてのプラグインはWindows、Mac、Linux、iOS、Android、およびAndroidベースのプラットフォーム(Meta Questを含む)をサポートしているため、デモプロジェクトもこれらすべてで動作します。これにより、ゲームやデスクトップキオスクからモバイルアプリ、スタンドアロンVRヘッドセット、セット上のバーチャルプロダクション環境まで、幅広い環境への展開が可能です。

性能の低いデバイス(モバイル、スタンドアロンVR)では、以下の調整を検討してください:

- Realisticの代わりにStandardリップシンクモデルを使用する(モデルの比較を参照)

- Highly Optimizedモデルタイプに切り替える

- 処理チャンクサイズを大きくしてCPU負荷を軽減

- より小型のLLM / TTSモデルを選択する

Android、iOS、Mac、Linuxでの追加セットアップ手順については、プラットフォーム別設定を参照してください。

独自のキャラクターの持ち込み

デモプロジェクトには3つのサンプルMetaHumanキャラクター(Aera、Ada、Orlando)が同梱されていますが、独自のMetaHumanをインポートしてデモで使用することも可能です。

📺 ビデオチュートリアル: デモプロジェクトへのカスタムMetaHumanキャラクターの追加

Runtime MetaHuman Lip Syncプラグイン自体は、MetaHuman以外にも多くのキャラクターシステムをサポートしています(ARKitベースのキャラクター、Daz Genesis 8/9、Reallusion CC3/CC4、Mixamo、ReadyPlayerMeなど - カスタムキャラクター設定ガイドを参照)。ゲームNPC、バーチャルプレゼンター、キオスクアテンダント、バーチャルプロダクション用のデジタルヒューマンなど、どのようなプロジェクトでも、プラグインはあなたのキャラクターパイプラインに適応します。

よりシンプルなデモプロジェクトで、完全なAI会話ワークフローを必要とせず、リップシンク機能自体に焦点を当てています。さまざまな音声ソースでリップシンクを動作確認したい場合に最適です。

注目の動画

ダウンロード

含まれるもの

このデモでは、基本的なリップシンクワークフローを紹介します:

- マイク入力 - ライブ音声からのリアルタイムリップシンク

- 音声ファイル再生 - インポートした音声ファイルからのリップシンク

- テキスト読み上げ - 合成音声によるリップシンク

必須およびオプショナルプラグイン

| プラグイン | 目的 | 必須? |

|---|---|---|

| Runtime MetaHuman Lip Sync | リップシンクアニメーション | ✅ 必須 |

| Runtime Audio Importer | 音声のインポートとキャプチャ | ✅ 必須 |

| Runtime Text To Speech | TTSデモシーン用のローカルTTS | 🔶 オプション |

| Runtime AI Chatbot Integrator | 外部TTSプロバイダー(OpenAI、ElevenLabs) | 🔶 オプション |

Standard Lip Sync Modelに関する注意点

いずれかのデモプロジェクトでStandard Model(Realisticではなく)を使用する予定がある場合、Standard Lip Sync Extensionプラグインをインストールする必要があります。インストール手順はStandard Model Extensionを参照してください。

お困りですか?

デモプロジェクトのセットアップや実行で問題が発生した場合は、お気軽にお問い合わせください:

カスタム開発リクエストについては(例:独自のロジックでデモを拡張したり、特定のプラットフォームやキャラクターパイプラインに適応させるなど)、[email protected] までご連絡ください。