데모 프로젝트

Runtime MetaHuman Lip Sync를 사용하여 빠르게 시작할 수 있도록 두 개의 즉시 사용 가능한 데모 프로젝트가 제공됩니다. 두 프로젝트 모두 **Unreal Engine 5.6+**로 제작되었으며, Blueprint-only이며, Windows, Mac, Linux, iOS, Android 및 Android 기반 플랫폼(Meta Quest 포함)에서 크로스 플랫폼으로 실행됩니다.

사용 가능한 데모 프로젝트

- AI Conversational NPC

- 기본 립싱크 데모

음성 인식, AI 챗봇(LLM), 텍스트-음성 변환, 실시간 립싱크 오디오 재생을 결합하여 단일 프로젝트에서 모두 함께 실행되는 완전한 AI NPC 대화 워크플로우입니다.

파이프라인 개요

🎤 Microphone → Speech Recognition → 💬 LLM Chatbot → 🔊 Text-to-Speech → 👄 Lip Sync + Playback

비디오

빠른 미리보기 (~30초)

데모 작동의 짧은 쇼케이스.

전체 워크스루

설정, 구성 및 전체 대화 파이프라인을 다루는 상세한 워크스루.

다운로드

필수 및 선택적 플러그인

데모 프로젝트는 모듈식입니다 - 사용하려는 제공업체에 필요한 플러그인만 있으면 됩니다.

| 플러그인 | 목적 | 필수 여부? |

|---|---|---|

| Runtime MetaHuman Lip Sync | 립싱크 애니메이션 | ✅ 항상 |

| Runtime Audio Importer | 오디오 캡처 및 처리 | ✅ 항상 |

| Runtime Speech Recognizer | 오프라인 음성 인식 (whisper.cpp) | ✅ 항상 |

| Runtime AI Chatbot Integrator | 외부 LLM (OpenAI, Claude, DeepSeek, Gemini, Grok, Ollama) 및/또는 외부 TTS (OpenAI, ElevenLabs) | 🔶 선택적 |

| Runtime Local LLM | 로컬 LLM 추론 (llama.cpp 사용, Llama, Mistral, Gemma 등, GGUF 모델) | 🔶 선택적 |

| Runtime Text To Speech | 로컬 TTS (Piper, Kokoro 사용) | 🔶 선택적 |

위의 각 플러그인은 개별적으로 선택적이지만, 데모가 작동하려면 최소 하나의 LLM 제공업체와 최소 하나의 TTS 제공업체가 필요합니다. 자유롭게 혼합하세요 (예: 로컬 LLM + ElevenLabs TTS, 또는 OpenAI LLM + 로컬 TTS).

모듈형 아키텍처

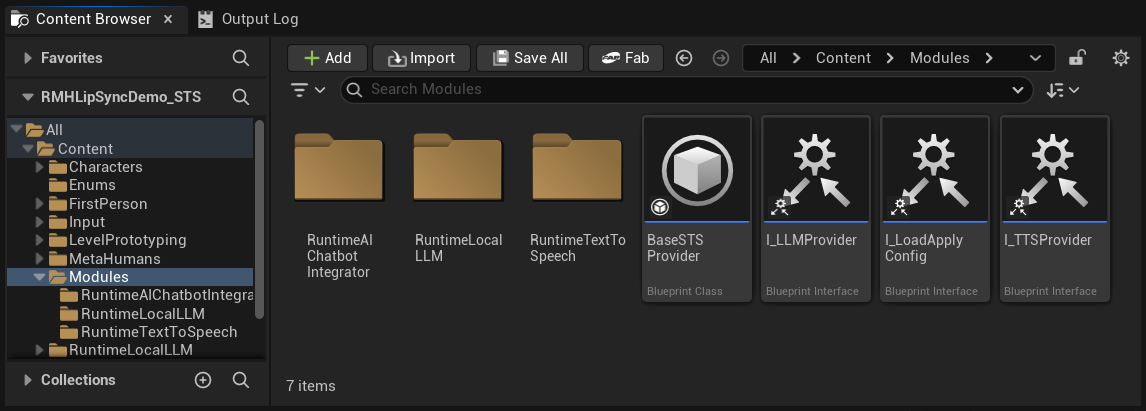

Content 폴더 안에 세 개의 하위 폴더를 포함하는 Modules 폴더가 있습니다:

Content/

└── Modules/

├── RuntimeAIChatbotIntegrator/ ← External LLMs and/or external TTS

├── RuntimeLocalLLM/ ← Local LLM via llama.cpp

└── RuntimeTextToSpeech/ ← Local TTS via Piper/Kokoro

If you didn't acquire one (or more) of the optional plugins, simply delete the corresponding folder(s). The demo project's base assets (game instance, widgets, etc.) do not reference these modules directly, so deleting them won't cause asset reference errors. The configuration UI will automatically hide any provider whose folder is missing.

This modularity applies only to LLM and TTS providers. Speech Recognition (Runtime Speech Recognizer) and Lip Sync (Runtime MetaHuman Lip Sync) are part of the base demo project and are always required.

On first launch, Unreal may ask whether to disable any missing optional plugins - click Yes. Make sure you've also deleted the corresponding Content/Modules/ folder (see above).

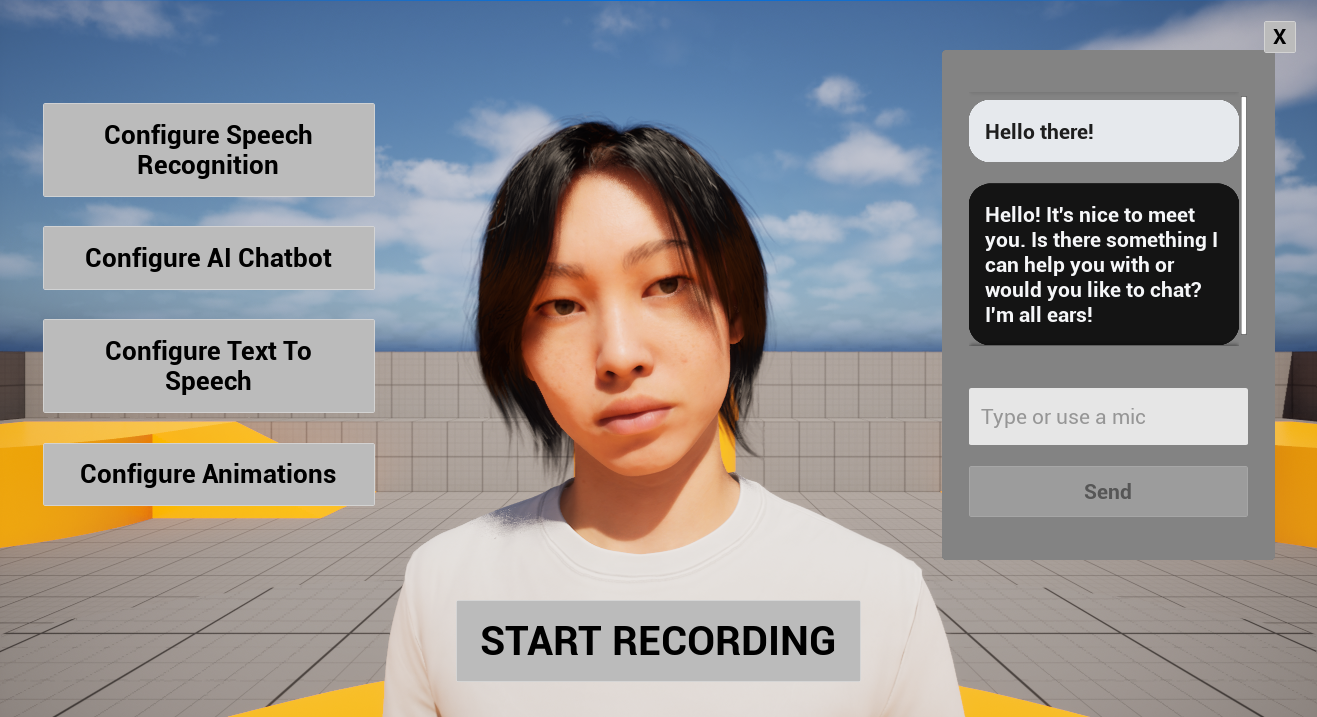

데모 프로젝트 레이아웃

아래 표시된 사용자 인터페이스는 완전히 UMG(Unreal Motion Graphics)로 제작되었으며, 순전히 파이프라인을 시연하기 위한 것입니다 - 음성 인식 → LLM → TTS → 립싱크. 자유롭게 재스타일링하거나 교체하여 게임의 비주얼 디자인, 컨트롤 체계 또는 플랫폼(VR/AR, 모바일, 콘솔 등)에 맞출 수 있습니다. 특정 위젯이 사용 사례에 불필요한 경우 단순히 숨길 수도 있습니다(예: 가시성을 Collapsed 또는 Hidden으로 설정).

| 영역 | 내용 |

|---|---|

| 중앙 | MetaHuman 캐릭터입니다. |

| 왼쪽 | 아래에서 자세히 설명하는 네 개의 구성 버튼(음성 인식, AI 챗봇, 텍스트 음성 변환, 애니메이션). |

| 중앙 하단 | 녹음 시작 버튼. 클릭하면 음성 대화가 시작됩니다: 마이크가 캡처되고, 텍스트로 변환되어 LLM으로 전송되며, 응답이 TTS로 합성되고 립싱크와 함께 재생됩니다. 완전히 핸즈프리로 진행됩니다. |

| 오른쪽 중앙 | 사용자와 AI 간의 전체 대화를 보여주는 대화 기록 위젯으로, 사용자와 어시스턴트 메시지가 모두 표시됩니다. 텍스트 입력 필드도 포함되어 있어 음성 인식 없이 직접 메시지를 입력할 수 있으며, 테스트, 접근성, 마이크를 사용할 수 없을 때 유용합니다. |

같은 세션에서 두 입력 모드를 자유롭게 혼합할 수 있습니다 - 일부 메시지는 말하고, 다른 메시지는 입력하세요.

구성 버튼

왼쪽의 네 개의 구성 버튼은 파이프라인의 각 부분에 대한 전용 패널을 엽니다:

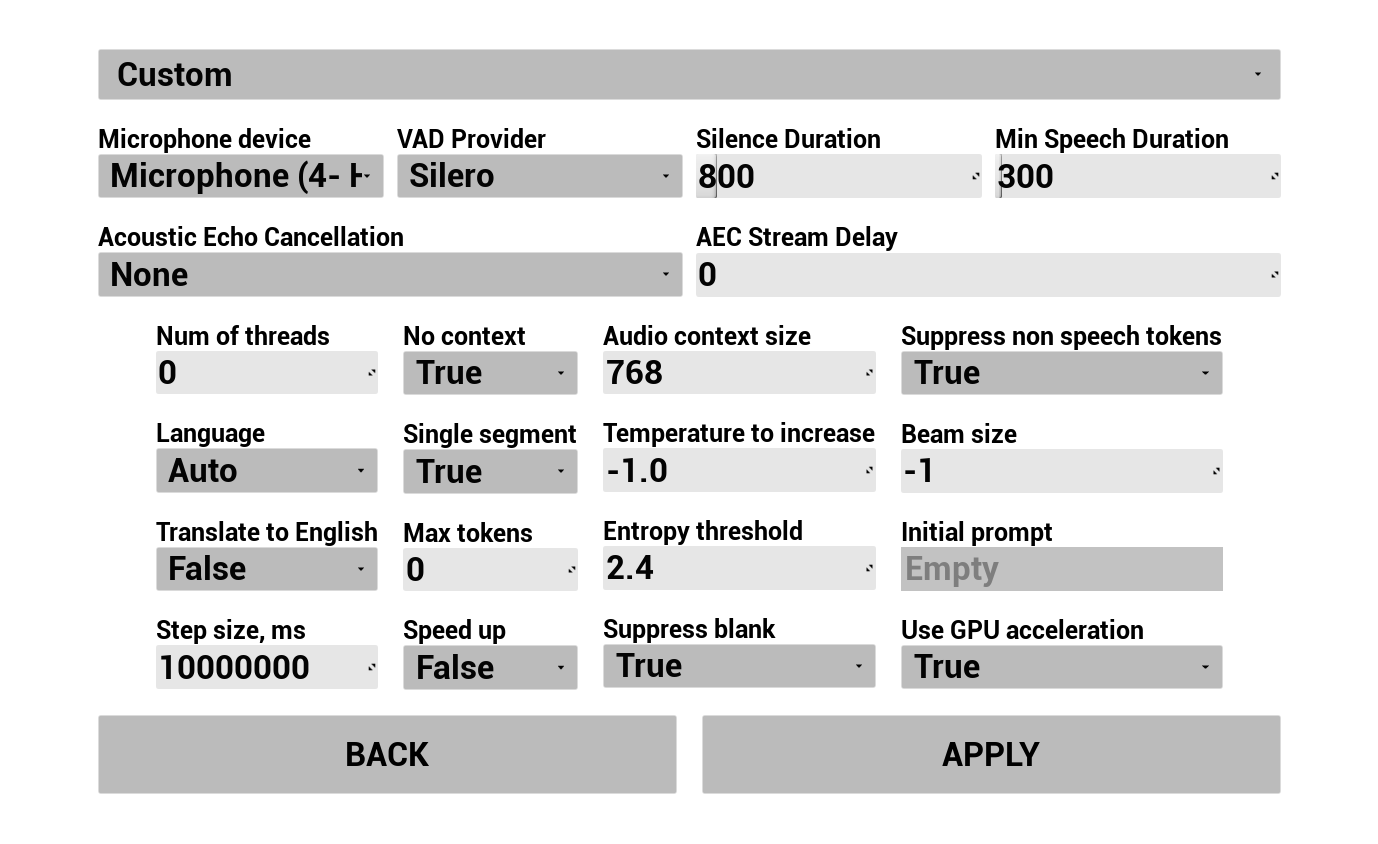

1. 음성 인식 구성

사용자의 음성이 캡처되고 텍스트로 변환되는 방식을 구성합니다:

- 언어 선택

- 음성 인식 매개변수 조정 (Whisper 모델 설정)

- AEC(음향 반향 제거) 구성

- VAD(음성 활동 감지) 구성

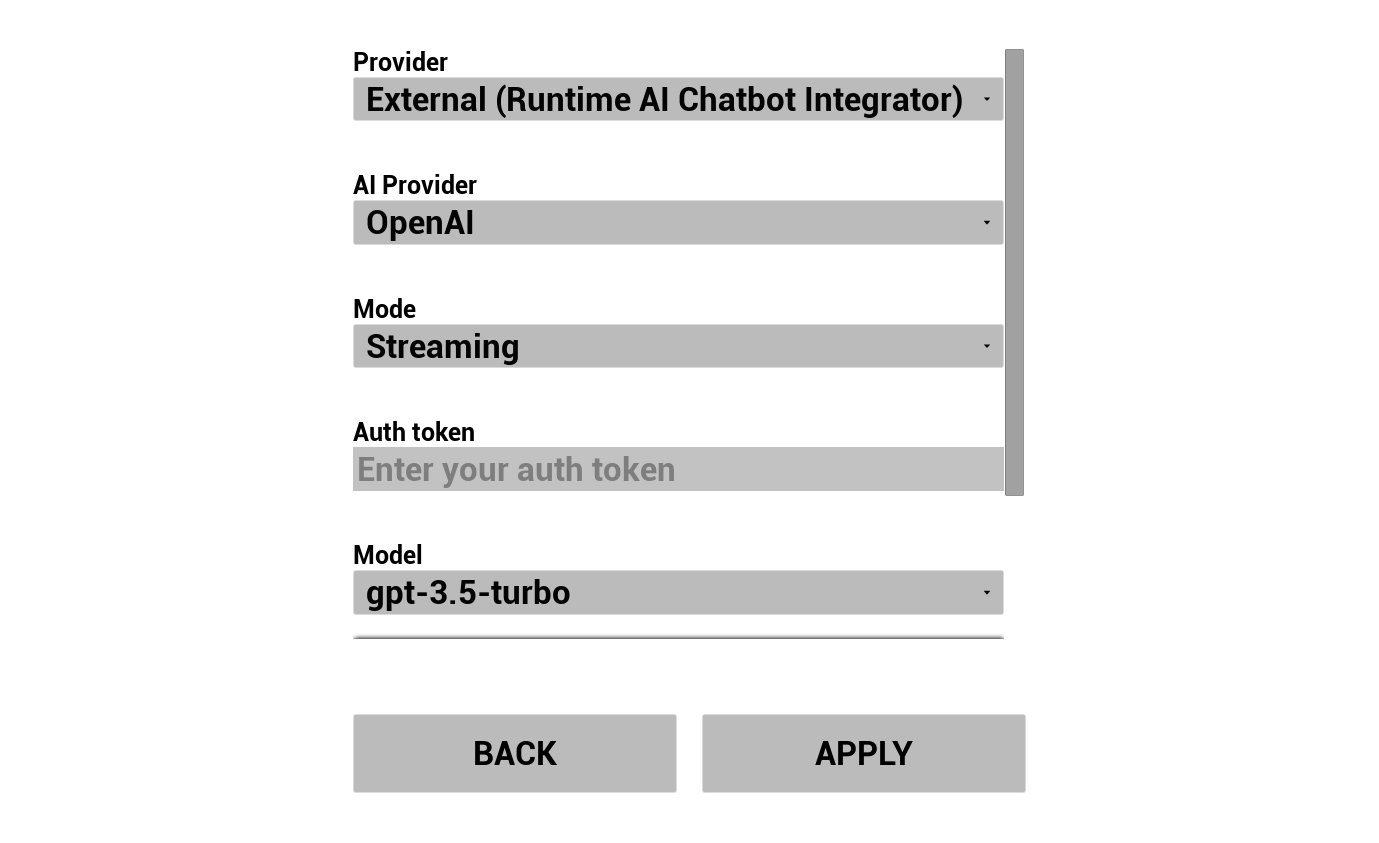

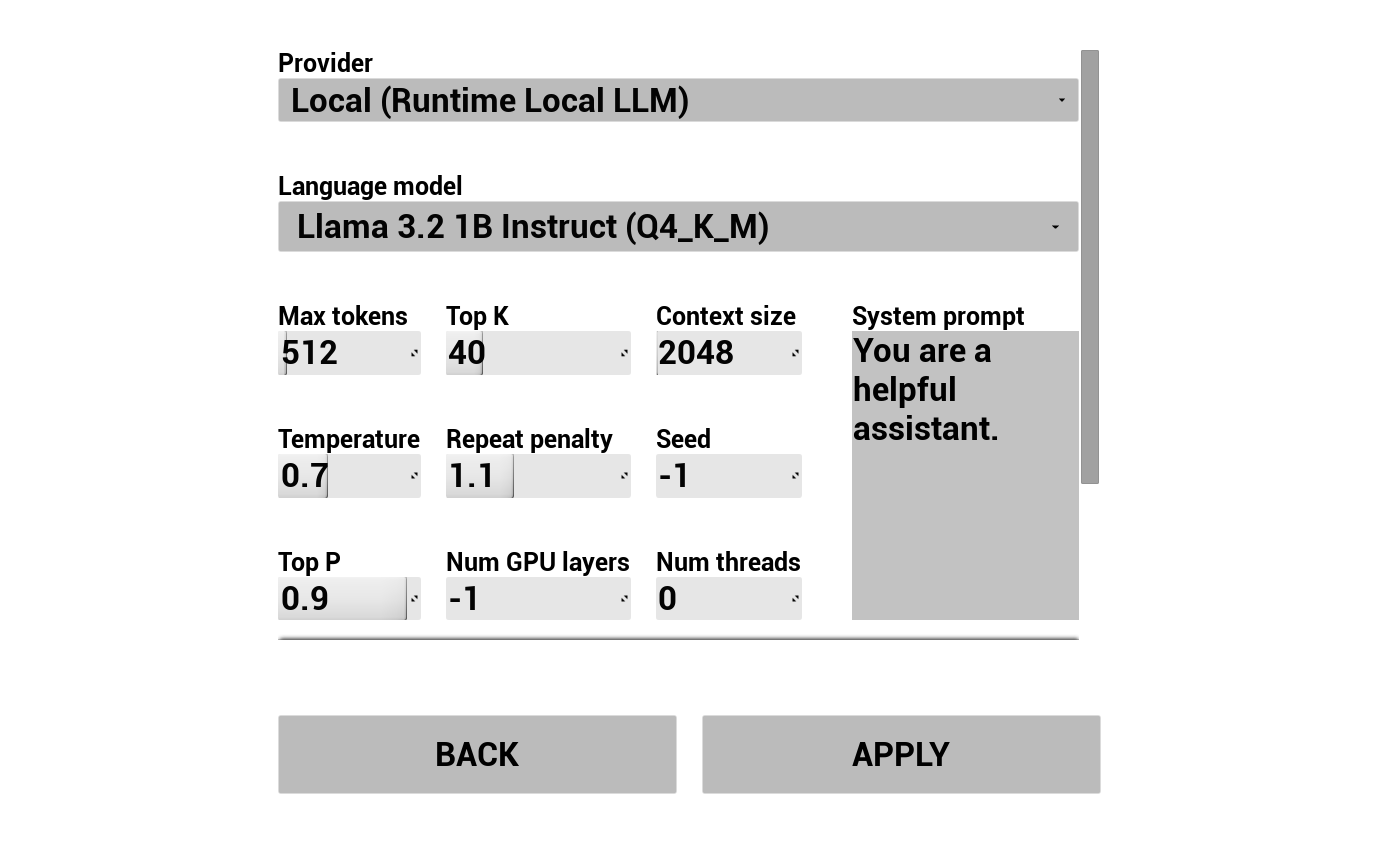

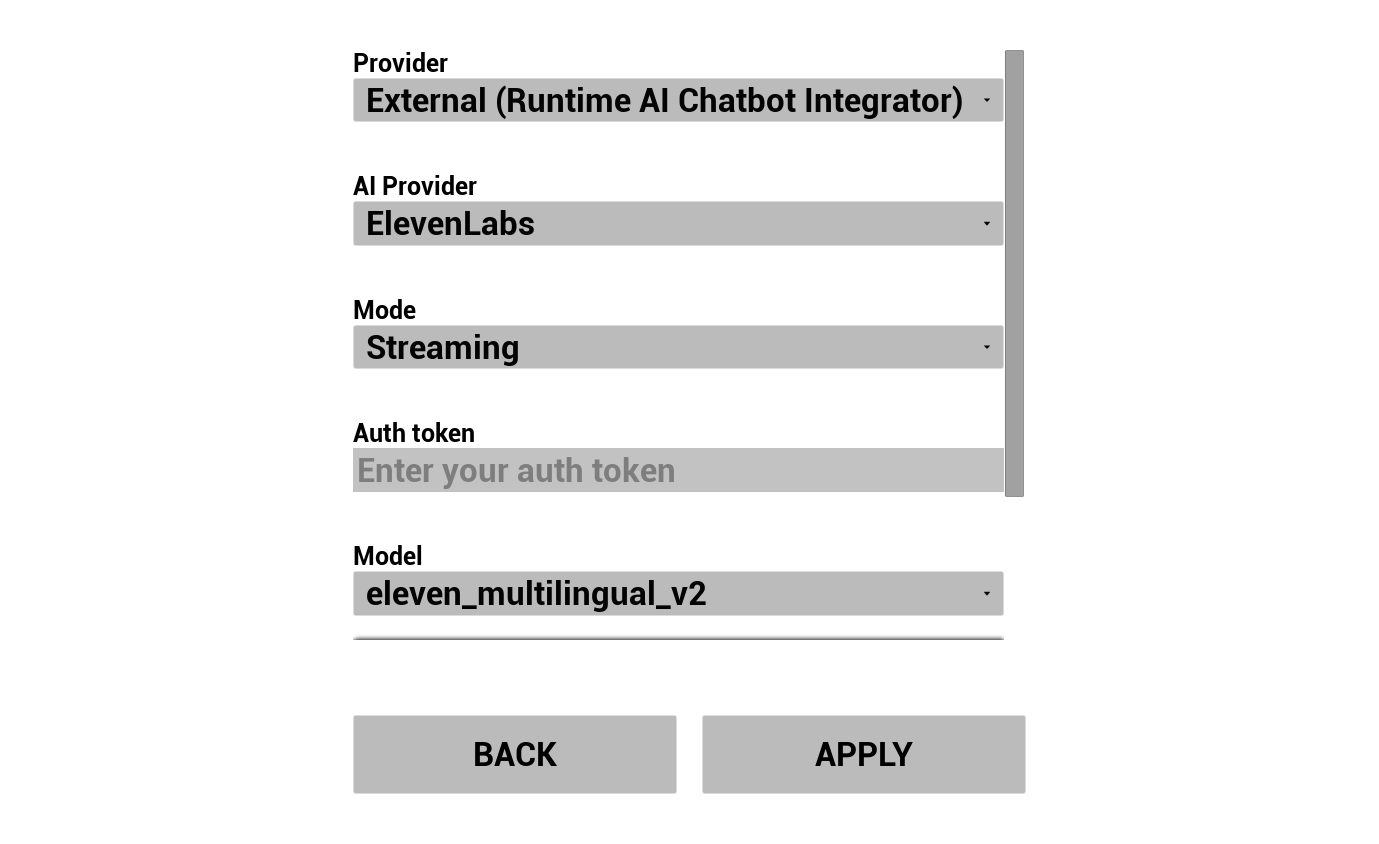

2. AI 챗봇 구성

LLM 제공자를 선택하고 구성합니다:

- 제공자 선택 (Runtime AI Chatbot Integrator 또는 Runtime Local LLM)

- 외부 제공자의 경우: 인증 토큰, 모델 이름 등

- 로컬 LLM의 경우: GGUF 모델 선택, 컨텍스트 크기 및 기타 추론 매개변수 설정. 또한 데모에서 직접 런타임에 자신의 GGUF 모델을 다운로드(예: URL을 통해)하여 프로젝트를 재빌드하지 않고 즉시 사용할 수도 있습니다.

제공자 콤보박스에는 Content/Modules/에 해당 플러그인 모듈 폴더가 존재하는 제공자만 표시됩니다.

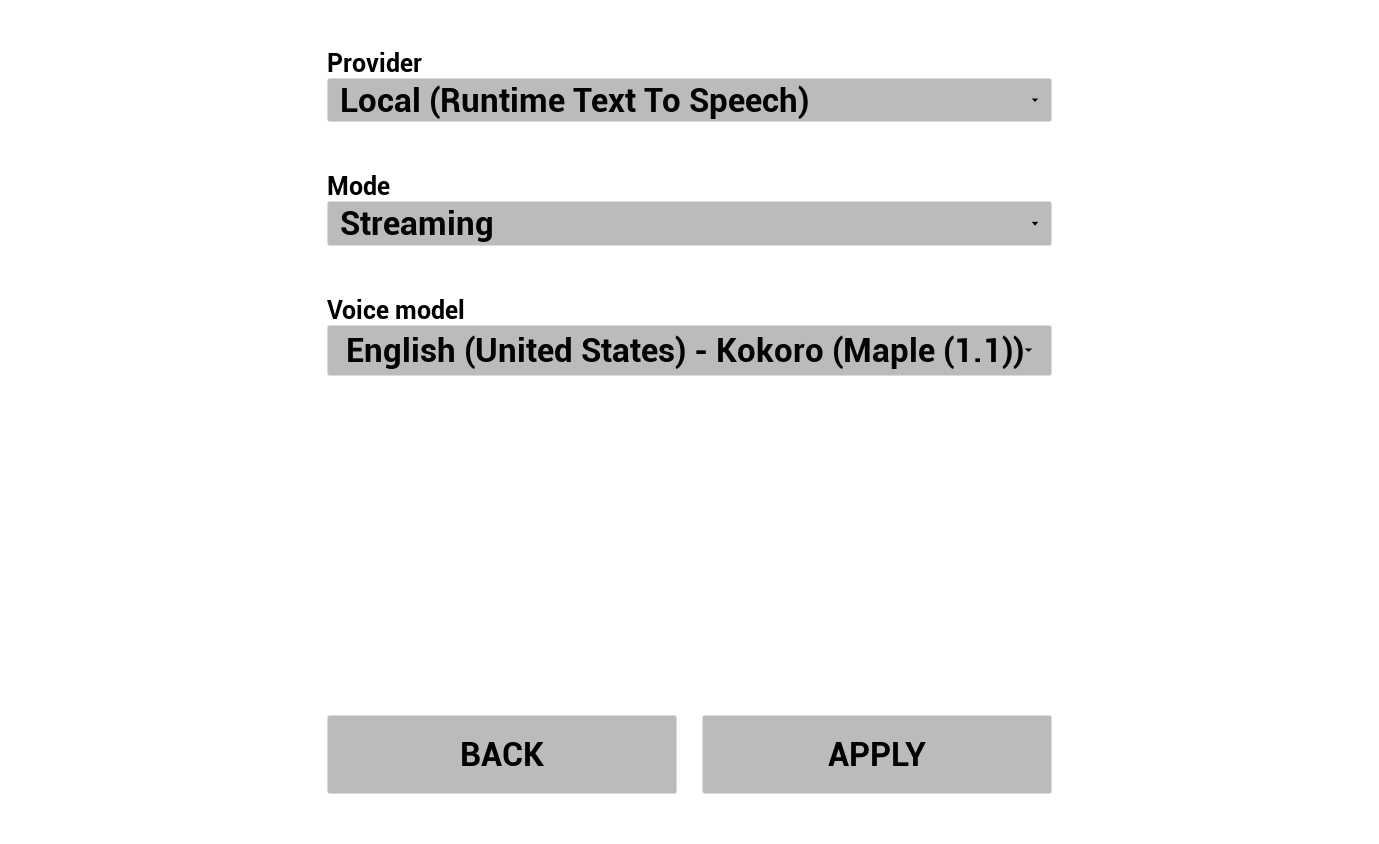

3. 텍스트 음성 변환 구성

TTS 제공자를 선택하고 음성/모델을 구성합니다:

- 제공자 선택 (OpenAI/ElevenLabs용 Runtime AI Chatbot Integrator, 또는 로컬 Piper/Kokoro용 Runtime Text To Speech)

- 음성/모델 선택

- 제공자별 매개변수 조정

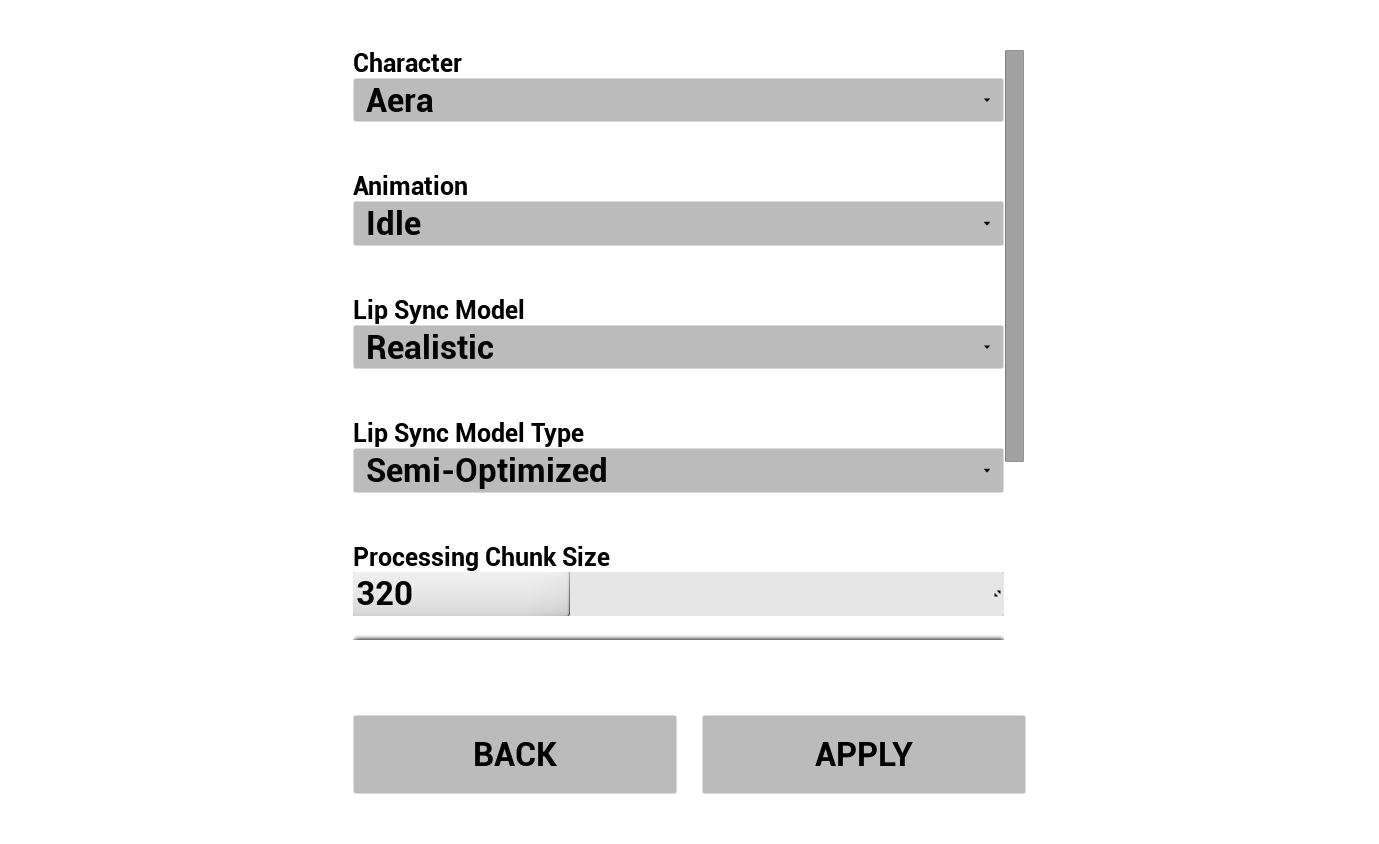

4. 애니메이션 구성

AI NPC의 비주얼을 제어합니다:

- 3개의 사전 다운로드된 MetaHuman 캐릭터 중 선택 (Aera, Ada, Orlando)

- 립싱크 모델 선택 (Standard 또는 Realistic)

- 립싱크 모델 유형 선택 - Highly Optimized, Semi-Optimized, 또는 Original (모델 유형 참조)

- Processing Chunk Size 조정 - 립싱크 추론 실행 빈도를 제어합니다 (Processing Chunk Size 참조)

- 대화 중 MetaHuman에 재생할 대기 애니메이션 선택

편집기에서 데모 사전 구성

소스 버전으로 작업할 때, 매번 실행할 때마다 값을 다시 입력하지 않도록 편집기에서 직접 기본값을 미리 채울 수 있습니다:

| 항목 | 위치 |

|---|---|

| 일반 설정 (립싱크 모델, 대기 애니메이션, 캐릭터 클래스, 음성 인식 등) | Content/LipSyncSTSGameInstance |

| 외부 LLM / 외부 TTS 설정 (Runtime AI Chatbot Integrator) | Content/Modules/RuntimeAIChatbotIntegrator/RuntimeAIChatbotIntegrator_Provider |

| 로컬 LLM 설정 (Runtime Local LLM) | Content/Modules/RuntimeLocalLLM/RuntimeLocalLLM_Provider |

| 로컬 TTS 설정 (Runtime Text To Speech) | Content/Modules/RuntimeTextToSpeech/RuntimeTextToSpeech_Provider |

크로스 플랫폼 참고 사항

데모에서 사용되는 모든 플러그인은 Windows, Mac, Linux, iOS, Android 및 Android 기반 플랫폼(Meta Quest 포함)을 지원하므로 데모 프로젝트도 이 모든 환경에서 작동합니다.

약한 기기(모바일, 스탠드얼론 VR)의 경우 다음을 고려할 수 있습니다:

- Realistic 대신 Standard 립싱크 모델 사용 - 모델 비교 참조

- Highly Optimized 모델 유형으로 전환

- Processing Chunk Size를 늘려 CPU 부하 감소

- 더 작은 LLM / TTS 모델 선택

Android, iOS, Mac, Linux에서의 추가 설정 단계는 플랫폼별 구성을 참조하세요.

나만의 MetaHuman 가져오기

데모 프로젝트에는 세 개의 샘플 MetaHuman 캐릭터(Aera, Ada, Orlando)가 포함되어 있지만, 직접 만든 MetaHuman을 가져와 데모에서 사용할 수 있습니다.

📺 비디오 튜토리얼: 데모 프로젝트에 커스텀 MetaHuman 캐릭터 추가하기

Runtime MetaHuman Lip Sync 플러그인 자체는 MetaHuman 이외에도 다양한 캐릭터 시스템(ARKit 기반 캐릭터, Daz Genesis 8/9, Reallusion CC3/CC4, Mixamo, ReadyPlayerMe 등)을 지원합니다 - 자세한 내용은 커스텀 캐릭터 설정 가이드를 참조하세요.

전체 AI 대화 워크플로우 없이 순수하게 립싱크 기능에만 초점을 맞춘 더 간단한 데모 프로젝트입니다. 다양한 오디오 소스로 립싱크가 작동하는 모습을 보기에 적합합니다.

특집 비디오

다운로드

포함 사항

이 데모는 기본 립싱크 워크플로우를 보여줍니다:

- 마이크 입력 - 실시간 오디오로부터의 실시간 립싱크

- 오디오 파일 재생 - 가져온 오디오 파일의 립싱크

- 텍스트 음성 변환 - 합성 음성에 의한 립싱크

필수 및 선택 플러그인

| 플러그인 | 목적 | 필수 여부 |

|---|---|---|

| Runtime MetaHuman Lip Sync | 립싱크 애니메이션 | ✅ 필수 |

| Runtime Audio Importer | 오디오 가져오기 및 캡처 | ✅ 필수 |

| Runtime Text To Speech | TTS 데모 씬용 로컬 TTS | 🔶 선택 |

| Runtime AI Chatbot Integrator | 외부 TTS 제공자 (OpenAI, ElevenLabs) | 🔶 선택 |

Standard 립싱크 모델 참고 사항

두 데모 프로젝트에서 Standard Model을 사용할 계획이라면(Realistic 대신) Standard Lip Sync Extension 플러그인을 설치해야 합니다. 설치 지침은 Standard Model Extension을 참조하십시오.

도움이 필요하신가요?

데모 프로젝트를 설정하거나 실행하는 데 문제가 발생하면 언제든지 문의하세요:

맞춤형 개발 요청(예: 자체 로직으로 데모 확장, 특정 플랫폼이나 캐릭터 파이프라인에 맞게 조정)은 [email protected]로 문의하세요.