Dostawcy Tłumaczeń

AI Localization Automator obsługuje pięciu różnych dostawców AI, z których każdy ma unikalne mocne strony i opcje konfiguracji. Wybierz dostawcę, który najlepiej odpowiada potrzebom, budżetowi i wymaganiom jakościowym Twojego projektu.

Ollama (Lokalne AI)

Najlepsze dla: Projektów wrażliwych na prywatność, tłumaczeń offline, nieograniczonego użycia

Ollama uruchamia modele AI lokalnie na Twoim komputerze, zapewniając pełną prywatność i kontrolę bez kosztów API i wymagań dotyczących połączenia internetowego.

Popularne Modele

- translategemma:12b (Wyspecjalizowany model tłumaczeniowy oparty na Gemma 3)

- llama3.2 (Zalecany ogólnego przeznaczenia)

- mistral (Wydajna alternatywa)

- codellama (Tłumaczenia z uwzględnieniem kodu)

- I wiele innych modeli społecznościowych

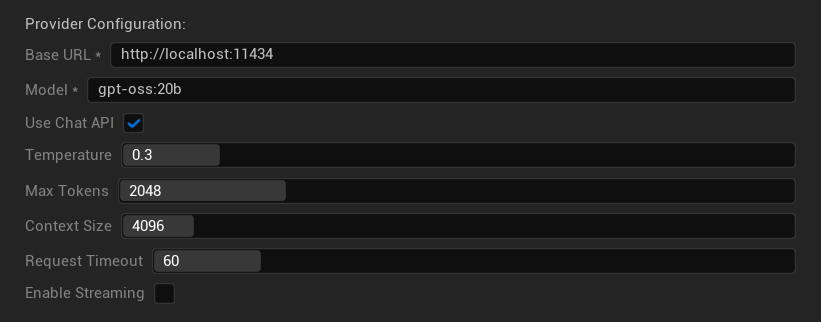

Opcje Konfiguracji

- Podstawowy URL: Lokalny serwer Ollama (domyślnie:

http://localhost:11434) - Model: Nazwa lokalnie zainstalowanego modelu (wymagane)

- Użyj Chat API: Włącz dla lepszej obsługi konwersacji

- Temperatura: 0.0-2.0 (zalecane 0.3)

- Maks. Tokenów: 1-8,192 tokenów

- Rozmiar Kontekstu: 512-32,768 tokenów

- Limit Czasu Żądania: 10-300 sekund (lokalne modele mogą być wolniejsze)

- Włącz Streaming: Do przetwarzania odpowiedzi w czasie rzeczywistym

Mocne Strony

- ✅ Pełna prywatność (żadne dane nie opuszczają Twojej maszyny)

- ✅ Brak kosztów API i limitów użycia

- ✅ Działa offline

- ✅ Pełna kontrola nad parametrami modelu

- ✅ Szeroka gama modeli społecznościowych

- ✅ Brak uzależnienia od dostawcy

Uwagi

- 💻 Wymaga lokalnej konfiguracji i wydajnego sprzętu

- ⚡ Ogólnie wolniejsze niż dostawcy chmurowi

- 🔧 Wymaga bardziej zaawansowanej konfiguracji technicznej

- 📊 Jakość tłumaczenia znacząco różni się w zależności od modelu (niektóre mogą przewyższać dostawców chmurowych)

- 💾 Duże wymagania dotyczące przestrzeni dyskowej dla modeli

Konfiguracja Ollama

- Zainstaluj Ollama: Pobierz z ollama.ai i zainstaluj w systemie

- Pobierz Modele: Użyj

ollama pull translategemma:12b, aby pobrać wybrany model - Uruchom Serwer: Ollama działa automatycznie lub uruchom go za pomocą

ollama serve - Skonfiguruj Wtyczkę: Ustaw podstawowy URL i nazwę modelu w ustawieniach wtyczki

- Przetestuj Połączenie: Wtyczka zweryfikuje łączność po zastosowaniu konfiguracji

OpenAI

Najlepsze dla: Najwyższej ogólnej jakości tłumaczeń, szerokiego wyboru modeli

OpenAI zapewnia wiodące w branży modele językowe poprzez ich API Chat Completions, w tym najnowsze modele GPT, modele wnioskowania oraz modele z obsługą wyszukiwania w sieci.

Dostępne Modele

Rodzina GPT-5 (Modele flagowe)

- gpt-5, gpt-5-mini, gpt-5-nano

- gpt-5.1, gpt-5.2, gpt-5.3-chat-latest

- gpt-5.4, gpt-5.4-mini, gpt-5.4-nano

Rodzina GPT-4.1 (Wysokowydajne)

- gpt-4.1, gpt-4.1-mini, gpt-4.1-nano

Rodzina GPT-4o (Wielomodalne)

- gpt-4o, gpt-4o-mini, chatgpt-4o-latest

Seria O (Modele wnioskowania — temperatura/top_p nieobsługiwane)

- o1, o1-pro, o3, o3-mini, o4-mini

Modele Wyszukiwania w Sieci (Temperatura/top_p nieobsługiwane)

- gpt-5-search-api, gpt-4o-search-preview, gpt-4o-mini-search-preview

Starsze / Podglądowe

- gpt-4.5-preview, gpt-4, gpt-4-32k, gpt-4-turbo, gpt-3.5-turbo, gpt-3.5-turbo-16k

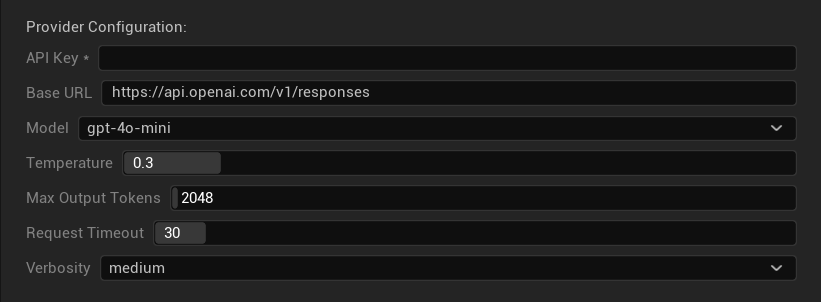

Opcje Konfiguracji

- Klucz API: Twój klucz API OpenAI (wymagany)

- Podstawowy URL: Punkt końcowy API (domyślnie:

https://api.openai.com/v1/chat/completions) - Model: Wybierz z dostępnych modeli wymienionych powyżej

- Użyj Temperatury: Przełącz parametr temperatury włącz/wyłącz (automatycznie ignorowany dla modeli wnioskowania serii o i wyszukiwania w sieci)

- Temperatura: 0.0–2.0 (zalecane 0.3 dla spójności tłumaczeń)

- Top P: 0.0–1.0 parametr próbkowania jądrowego (ignorowany dla modeli wnioskowania serii o i wyszukiwania w sieci)

- Maks. Tokenów Uzupełnienia: 1–128,000 tokenów (obejmuje zarówno tokeny wyjściowe, jak i wnioskowania)

- Limit Czasu Żądania: 5–300 sekund

Mocne Strony

- ✅ Stała, wysoka jakość tłumaczeń

- ✅ Doskonałe rozumienie kontekstu

- ✅ Silne zachowanie formatowania

- ✅ Szerokie wsparcie języków

- ✅ Niezawodny czas działania API

Uwagi

- 💰 Wyższy koszt na żądanie

- 🌐 Wymaga połączenia internetowego

- ⏱️ Limity użycia w zależności od poziomu

Anthropic Claude

Najlepsze dla: Tłumaczeń zniuansowanych, treści kreatywnych, aplikacji zorientowanych na bezpieczeństwo

Modele Claude doskonale radzą sobie ze zrozumieniem kontekstu i niuansów, co czyni je idealnymi dla gier z bogatą narracją i złożonych scenariuszy lokalizacji.

Dostępne Modele

Rodzina Claude 4.6 (Najnowsze)

- claude-opus-4-6, claude-sonnet-4-6

Rodzina Claude 4.5

- claude-haiku-4-5 (Szybkie i wydajne)

- claude-sonnet-4-5, claude-opus-4-5

Rodzina Claude 4.x

- claude-sonnet-4-0, claude-opus-4-1, claude-opus-4-0

Rodzina Claude 3.x (Starsze)

- claude-3-7-sonnet-latest, claude-3-5-haiku-latest, claude-3-opus-latest

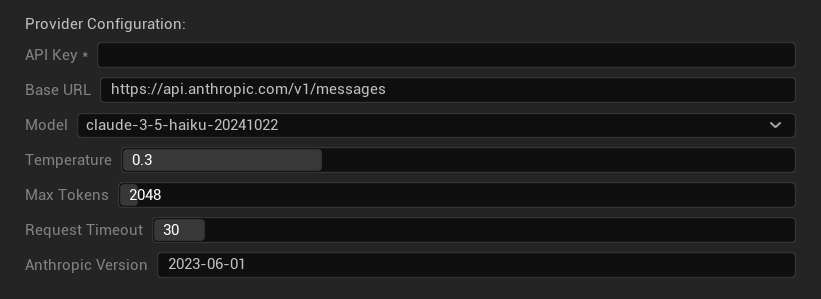

Opcje Konfiguracji

- Klucz API: Twój klucz API Anthropic (wymagany)

- Podstawowy URL: Punkt końcowy API Claude

- Model: Wybierz z rodziny modeli Claude

- Temperatura: 0.0–1.0 (zalecane 0.3)

- Top K: Parametr próbkowania Top-K (0 = nie ustawiony)

- Maks. Tokenów: 1–64,000 tokenów

- Limit Czasu Żądania: 5–300 sekund

- Wersja Anthropic: Nagłówek wersji API

Mocne Strony

- ✅ Wyjątkowa świadomość kontekstu

- ✅ Doskonałe dla treści kreatywnych/narracyjnych

- ✅ Silne funkcje bezpieczeństwa

- ✅ Szczegółowe możliwości wnioskowania (rozszerzone myślenie w modelach 3.7+)

- ✅ Doskonałe przestrzeganie instrukcji

Uwagi

- 💰 Model cenowy premium

- 🌐 Wymagane połączenie internetowe

- 📏 Limity tokenów różnią się w zależności od modelu

DeepSeek

Najlepsze dla: Ekonomicznych tłumaczeń, wysokiej przepustowości, projektów z ograniczonym budżetem

DeepSeek oferuje konkurencyjną jakość tłumaczeń za ułamek kosztów innych dostawców, co czyni go idealnym dla projektów lokalizacji na dużą skalę.

Dostępne Modele

- deepseek-chat (Ogólnego przeznaczenia, zalecany)

- deepseek-reasoner (Ulepszone możliwości wnioskowania)

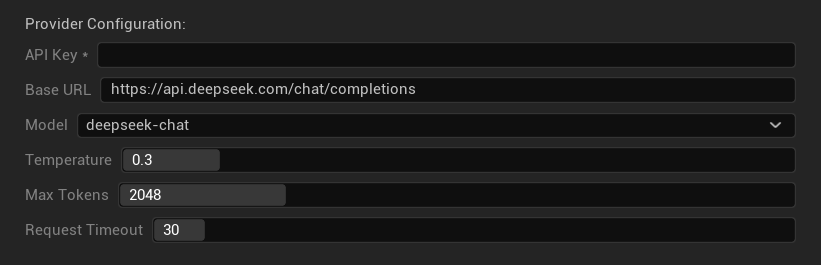

Opcje Konfiguracji

- Klucz API: Twój klucz API DeepSeek (wymagany)

- Podstawowy URL: Punkt końcowy API DeepSeek

- Model: Wybierz między modelami chat i reasoner

- Temperatura: 0.0-2.0 (zalecane 0.3)

- Maks. Tokenów: 1-8,192 tokenów

- Limit Czasu Żądania: 5-300 sekund

Mocne Strony

- ✅ Bardzo ekonomiczny

- ✅ Dobra jakość tłumaczeń

- ✅ Szybkie czasy odpowiedzi

- ✅ Prosta konfiguracja

- ✅ Wysokie limity szybkości

Uwagi

- 📏 Niższe limity tokenów

- 🆕 Nowy dostawca (mniej doświadczenia)

- 🌐 Wymaga połączenia internetowego

Google Gemini

Najlepsze dla: Projektów wielojęzycznych, ekonomicznych tłumaczeń, integracji z ekosystemem Google

Modele Gemini oferują silne możliwości wielojęzyczne z konkurencyjnymi cenami i unikalnymi funkcjami, takimi jak tryb myślenia dla ulepszonego wnioskowania.

Dostępne Modele

Rodzina Gemini 3.x (Podgląd)

- gemini-3.1-pro-preview, gemini-3-pro-preview, gemini-3-flash-preview

Rodzina Gemini 2.5 (Z obsługą myślenia)

- gemini-2.5-pro (Flagowy z myśleniem)

- gemini-2.5-flash (Szybki, z obsługą myślenia)

- gemini-2.5-flash-lite (Lekka wersja)

Rodzina Gemini 2.0

- gemini-2.0-flash, gemini-2.0-flash-lite

Najnowsze Aliasy

- gemini-flash-latest, gemini-flash-lite-latest

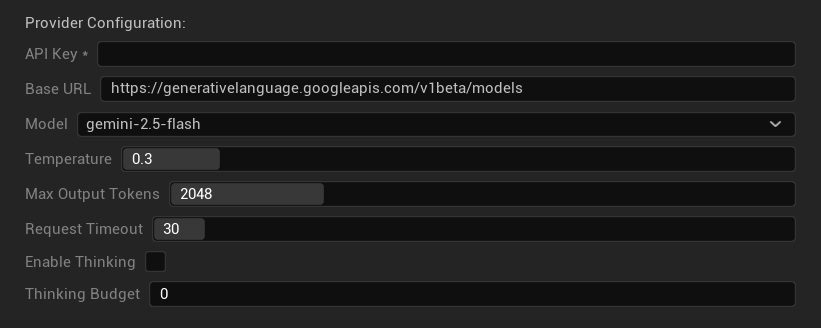

Opcje Konfiguracji

- Klucz API: Twój klucz API Google AI (wymagany)

- Podstawowy URL: Punkt końcowy API Gemini

- Model: Wybierz z rodziny modeli Gemini

- Temperatura: 0.0–2.0 (zalecane 0.3)

- Maks. Tokenów Wyjściowych: 1–8,192 tokenów

- Limit Czasu Żądania: 5–300 sekund

- Włącz Myślenie: Aktywuj ulepszone wnioskowanie dla modeli 2.5+

- Budżet Myślenia: Kontroluj alokację tokenów myślenia (0 = brak myślenia)

Mocne Strony

- ✅ Silne wsparcie wielojęzyczne

- ✅ Konkurencyjne ceny

- ✅ Zaawansowane wnioskowanie (tryb myślenia)

- ✅ Integracja z ekosystemem Google

- ✅ Regularne aktualizacje modeli z dostępem do podglądu najnowszych modeli

Uwagi

- 🧠 Tryb myślenia zwiększa użycie tokenów

- 📏 Zmienne limity tokenów w zależności od modelu

- 🌐 Wymaga połączenia internetowego

Wybór Właściwego Dostawcy

| Dostawca | Najlepszy dla | Jakość | Koszt | Konfiguracja | Prywatność |

|---|---|---|---|---|---|

| Ollama | Prywatność/offline | Zmienna* | Darmowy | Zaawansowana | Lokalna |

| OpenAI | Najwyższa jakość | ⭐⭐⭐⭐⭐ | 💰💰💰 | Łatwa | Chmura |

| Claude | Treści kreatywne | ⭐⭐⭐⭐⭐ | 💰💰💰💰 | Łatwa | Chmura |

| DeepSeek | Projekty budżetowe | ⭐⭐⭐⭐ | 💰 | Łatwa | Chmura |

| Gemini | Wielojęzyczne | ⭐⭐⭐⭐ | 💰 | Łatwa | Chmura |

*Jakość dla Ollama znacząco się różni w zależności od użytego lokalnego modelu - niektóre nowoczesne modele lokalne mogą dorównać lub przewyższyć dostawców chmurowych.

Wskazówki Dotyczące Konfiguracji Dostawcy

Dla Wszystkich Dostawców Chmurowych:

- Przechowuj klucze API bezpiecznie i nie dodawaj ich do kontroli wersji

- Zacznij od konserwatywnych ustawień temperatury (0.3) dla spójnych tłumaczeń

- Monitoruj swoje użycie API i koszty

- Testuj na małych partiach przed dużymi przebiegami tłumaczeń

Dla Ollama:

- Zapewnij odpowiednią ilość RAM (zalecane 8GB+ dla większych modeli)

- Użyj pamięci SSD dla lepszej wydajności ładowania modeli

- Rozważ przyspieszenie GPU dla szybszego wnioskowania

- Testuj lokalnie przed poleganiem na tym w tłumaczeniach produkcyjnych