Projetos de Demonstração

Para ajudá-lo a começar rapidamente com o Runtime MetaHuman Lip Sync, dois projetos de demonstração prontos para uso estão disponíveis. Ambos são construídos com Unreal Engine 5.6+, são apenas Blueprint e são multiplataforma, funcionando em Windows, Mac, Linux, iOS, Android e plataformas baseadas em Android (incluindo Meta Quest).

Projetos de Demonstração Disponíveis

- AI Conversational NPC / Interactive Avatar

- Demonstração Básica de Sincronização Labial

Um fluxo de trabalho de avatar conversacional com IA completo combinando reconhecimento de fala, um chatbot de IA (LLM), texto para fala e reprodução de áudio com sincronização labial em tempo real - tudo funcionando junto em um único projeto. Adequado para uma ampla gama de casos de uso — incluindo quiosques interativos, produção virtual, instalações de museu, assistentes digitais, simulações de treinamento e jogos.

Visão Geral do Pipeline

🎤 Microphone → Speech Recognition → 💬 LLM Chatbot → 🔊 Text-to-Speech → 👄 Lip Sync + Playback

Vídeos

Prévia Rápida (~30 seg)

Uma breve demonstração do demo em ação.

Passo a Passo Completo

Um passo a passo detalhado cobrindo configuração, opções e todo o pipeline de conversação.

Downloads

Plugins Necessários e Opcionais

O projeto demo é modular - você só precisa dos plugins dos provedores que deseja usar.

| Plugin | Finalidade | Necessário? |

|---|---|---|

| Runtime MetaHuman Lip Sync | Animação de sincronia labial | ✅ Sempre |

| Runtime Audio Importer | Captura e processamento de áudio | ✅ Sempre |

| Runtime Speech Recognizer | Reconhecimento de fala offline (whisper.cpp) | ✅ Sempre |

| Runtime AI Chatbot Integrator | LLMs externos (OpenAI, Claude, DeepSeek, Gemini, Grok, Ollama) e/ou TTS externo (OpenAI, ElevenLabs) | 🔶 Opcional |

| Runtime Local LLM | Inferência de LLM local via llama.cpp (modelos GGUF: Llama, Mistral, Gemma, etc) | 🔶 Opcional |

| Runtime Text To Speech | TTS local via Piper e Kokoro | 🔶 Opcional |

Embora cada plugin acima seja individualmente opcional, você precisa de pelo menos um provedor de LLM e pelo menos um provedor de TTS para que o demo funcione. Misture e combine livremente (por exemplo, LLM local + TTS ElevenLabs, ou LLM OpenAI + TTS local).

Arquitetura Modular

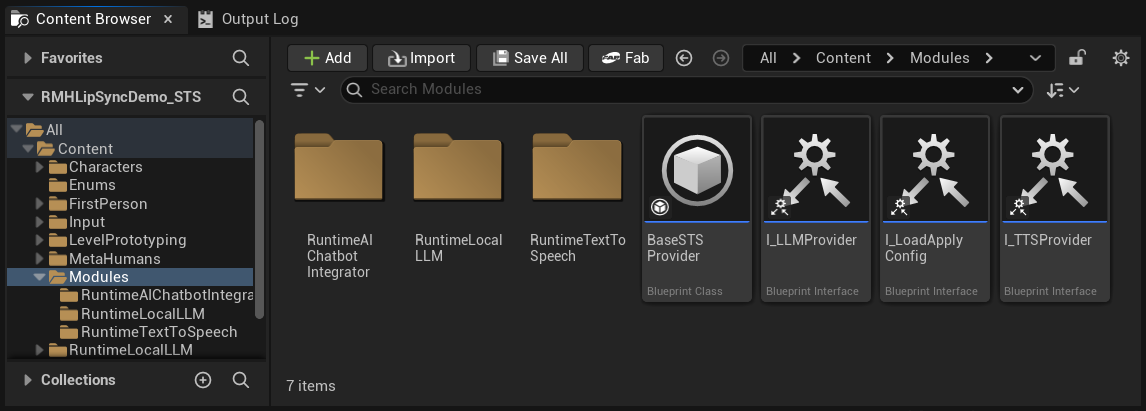

Na pasta Content você encontrará uma pasta Modules que contém três subpastas:

Content/

└── Modules/

├── RuntimeAIChatbotIntegrator/ ← External LLMs and/or external TTS

├── RuntimeLocalLLM/ ← Local LLM via llama.cpp

└── RuntimeTextToSpeech/ ← Local TTS via Piper/Kokoro

Se você não adquiriu um (ou mais) dos plugins opcionais, simplesmente exclua a(s) pasta(s) correspondente(s). Os ativos base do projeto de demonstração (game instance, widgets, etc.) não fazem referência direta a esses módulos, portanto excluí-los não causará erros de referência de ativos. A interface de configuração ocultará automaticamente qualquer provedor cuja pasta esteja ausente.

Essa modularidade se aplica apenas aos provedores de LLM e TTS. Reconhecimento de Fala (Runtime Speech Recognizer) e Sincronização Labial (Runtime MetaHuman Lip Sync) fazem parte do projeto de demonstração base e são sempre necessários.

Na primeira inicialização, o Unreal pode perguntar se deseja desabilitar quaisquer plugins opcionais ausentes - clique em Yes. Certifique-se de também ter excluído a pasta correspondente Content/Modules/ (veja acima).

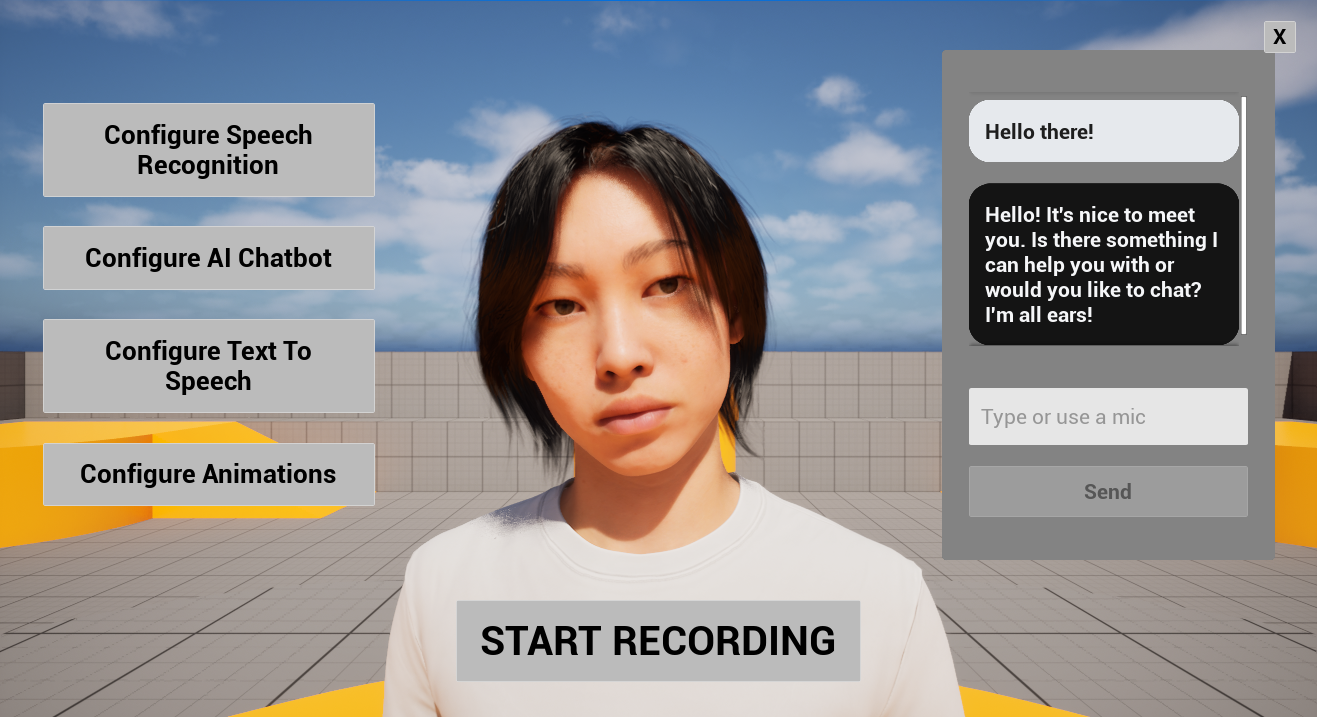

Layout do Projeto de Demonstração

A interface do usuário mostrada abaixo é construída inteiramente com UMG (Unreal Motion Graphics) e destina-se puramente a demonstrar o pipeline - reconhecimento de fala → LLM → TTS → sincronização labial. Você é livre para reestilizá-la ou substituí-la para corresponder ao design visual do seu projeto, esquema de controle ou plataforma (VR/AR, mobile, console, quiosque, etc.). Se certos widgets não forem necessários no seu caso de uso, você também pode simplesmente ocultá-los (por exemplo, definir sua visibilidade para Collapsed ou Hidden).

| Área | O que tem lá |

|---|---|

| Centro | O personagem MetaHuman. |

| Lado esquerdo | Quatro botões de configuração (Reconhecimento de Fala, Chatbot de IA, Texto para Fala, Animações), descritos em detalhes abaixo. |

| Parte inferior central | Um botão Iniciar Gravação. Clique nele para iniciar uma conversa por voz: seu microfone é capturado, transcrito, enviado ao LLM, a resposta é sintetizada via TTS e reproduzida com sincronização labial, totalmente mãos-livres. |

| Centro direito | Um widget de histórico de conversa mostrando a troca completa entre você e a IA (tanto mensagens do usuário quanto do assistente). Ele também inclui um campo de entrada de texto, para que você possa digitar mensagens diretamente sem usar o reconhecimento de fala, útil para testes, acessibilidade ou quando um microfone não está disponível. |

Você pode misturar ambos os modos de entrada livremente na mesma sessão - fale algumas mensagens, digite outras.

Botões de Configuração

Os quatro botões de configuração à esquerda abrem painéis dedicados para cada parte do pipeline:

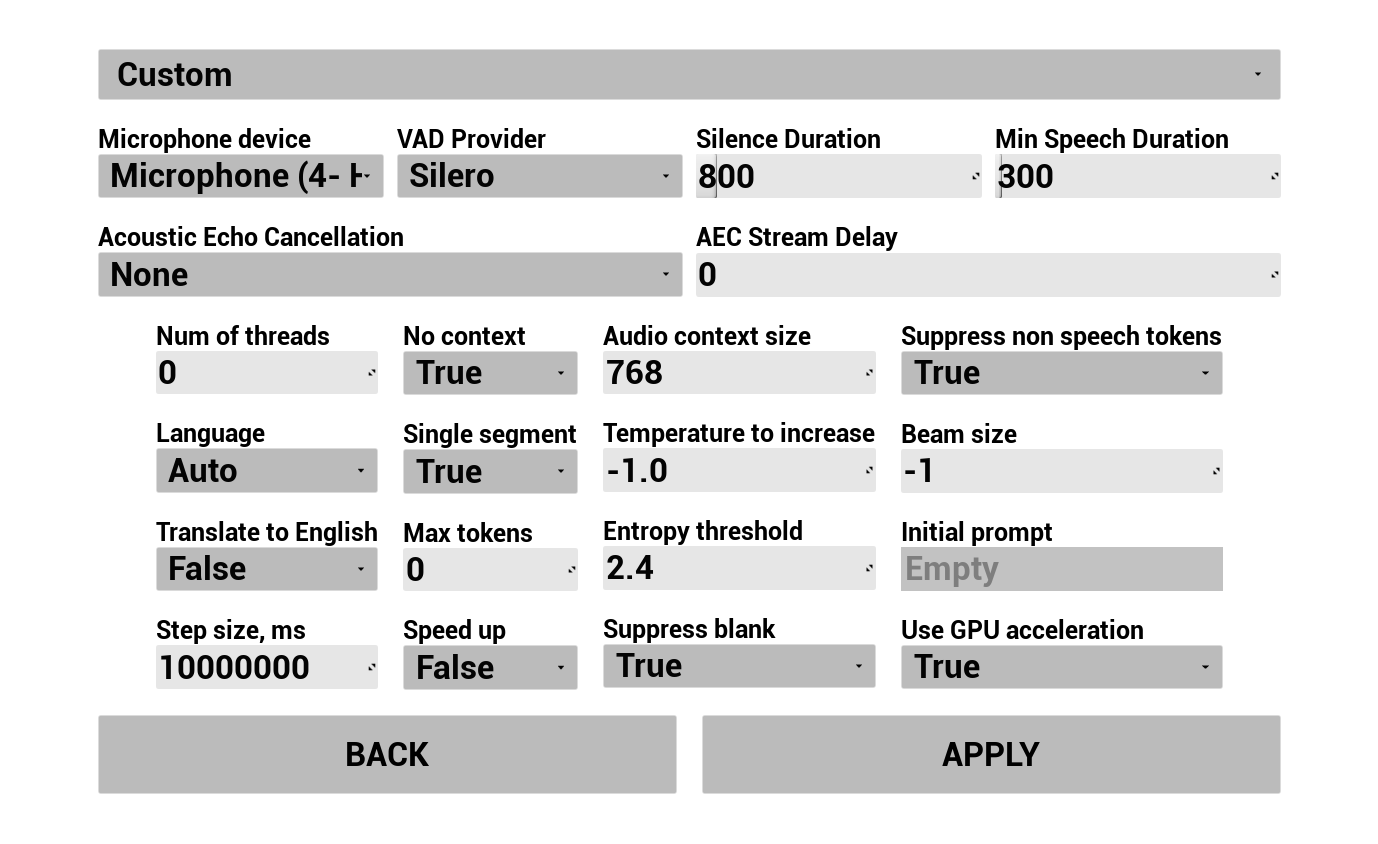

1. Configurar Reconhecimento de Fala

Configure como a voz do usuário é capturada e transcrita:

- Selecione o idioma

- Ajuste os parâmetros de reconhecimento de fala (configurações do modelo Whisper)

- Configure o AEC (Cancelamento de Eco Acústico)

- Configure o VAD (Detecção de Atividade de Voz)

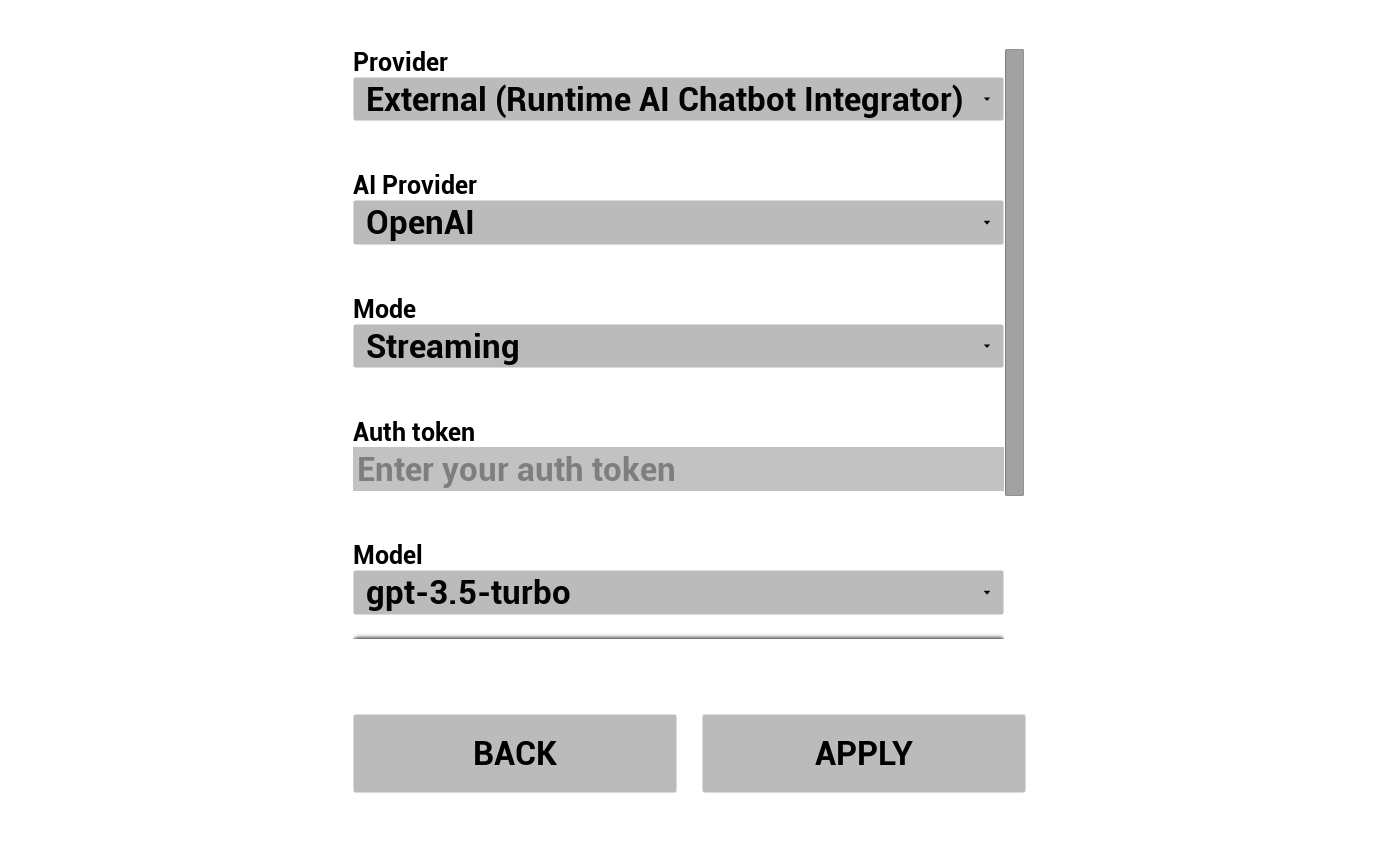

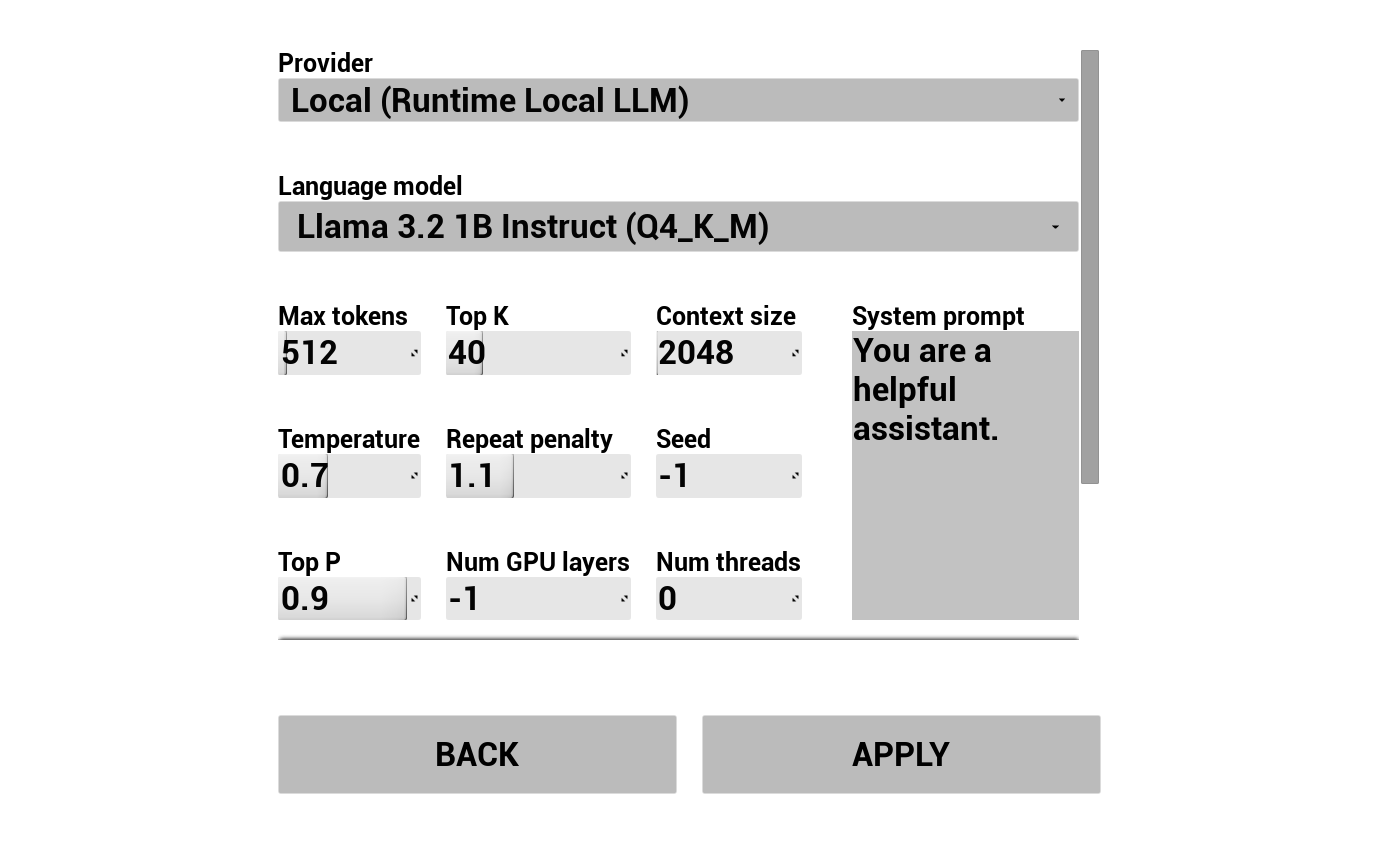

2. Configurar Chatbot de IA

Escolha seu provedor de LLM e configure-o:

- Selecione o provedor (Runtime AI Chatbot Integrator ou Runtime Local LLM)

- Para provedores externos: token de autenticação, nome do modelo, etc.

- Para LLM local: selecione um modelo GGUF, defina o tamanho do contexto e outros parâmetros de inferência. Você também pode baixar seu próprio modelo GGUF em tempo de execução diretamente da demonstração (por exemplo, por URL), e usá-lo imediatamente sem reconstruir o projeto.

A caixa de combinação de provedores mostra apenas os provedores cujo folder do módulo do plugin está presente em Content/Modules/.

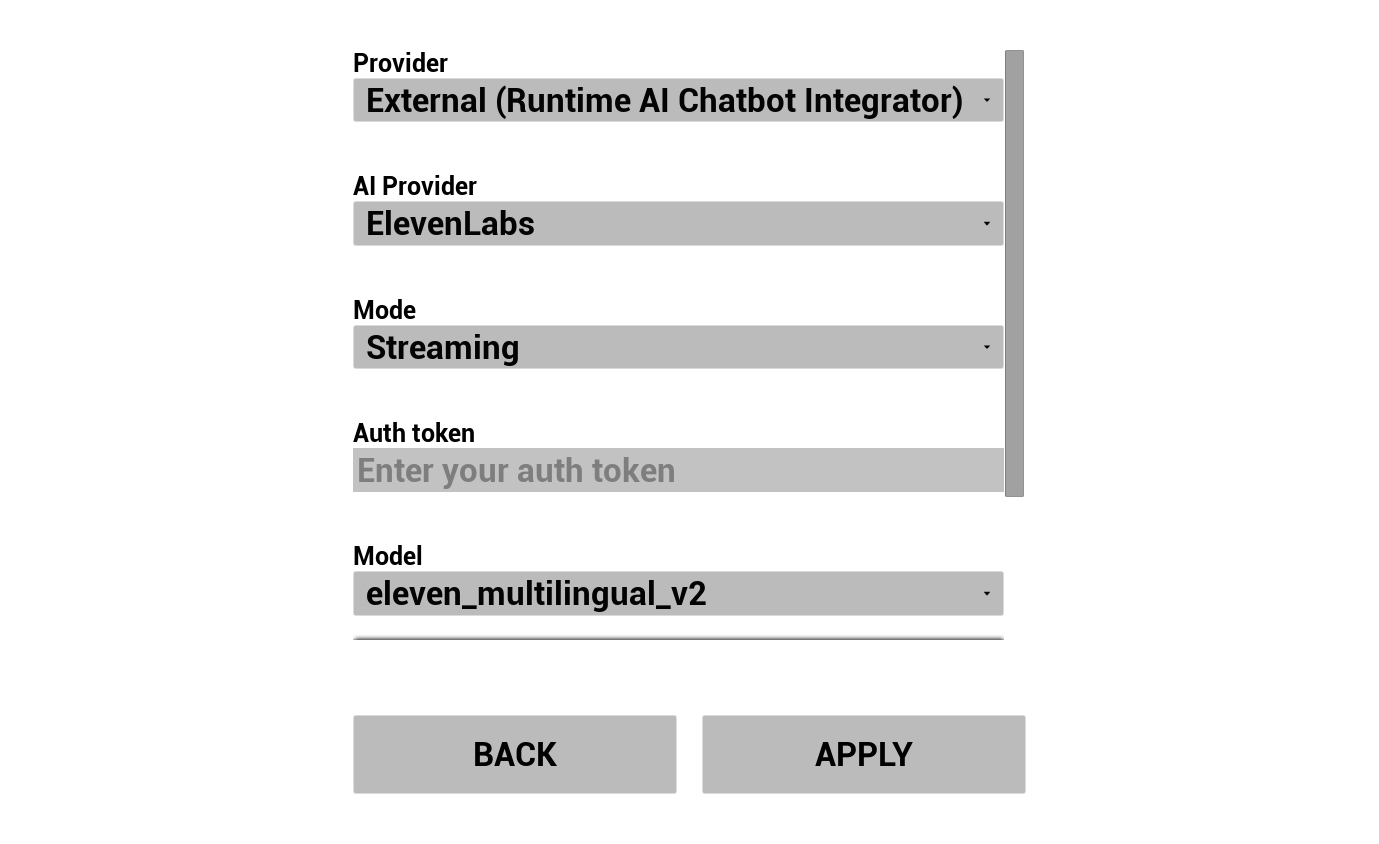

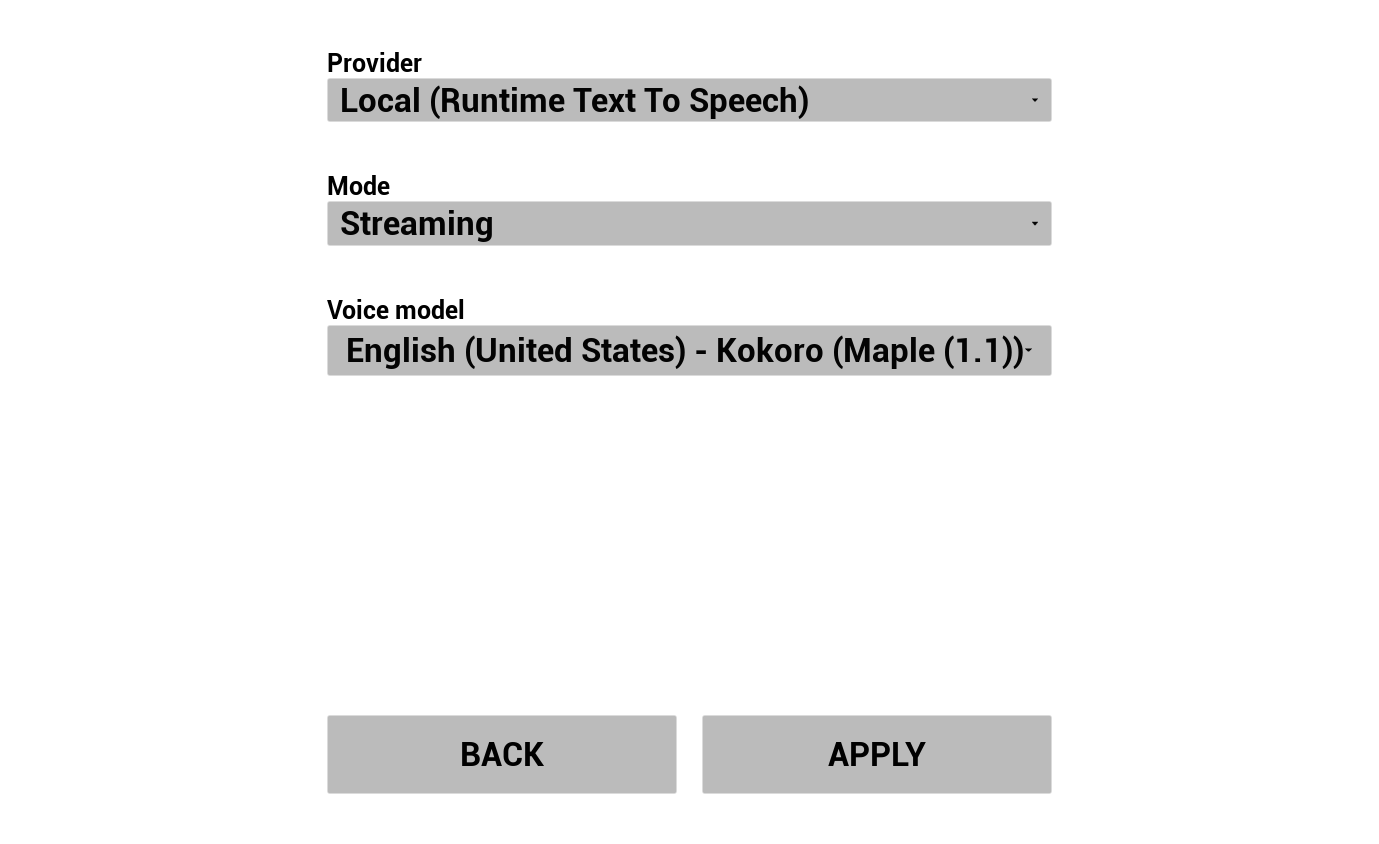

3. Configurar Texto para Fala

Escolha seu provedor de TTS e configure vozes/modelos:

- Selecione o provedor (Runtime AI Chatbot Integrator para OpenAI/ElevenLabs, ou Runtime Text To Speech para Piper/Kokoro local)

- Selecione voz/modelo

- Ajuste os parâmetros específicos do provedor

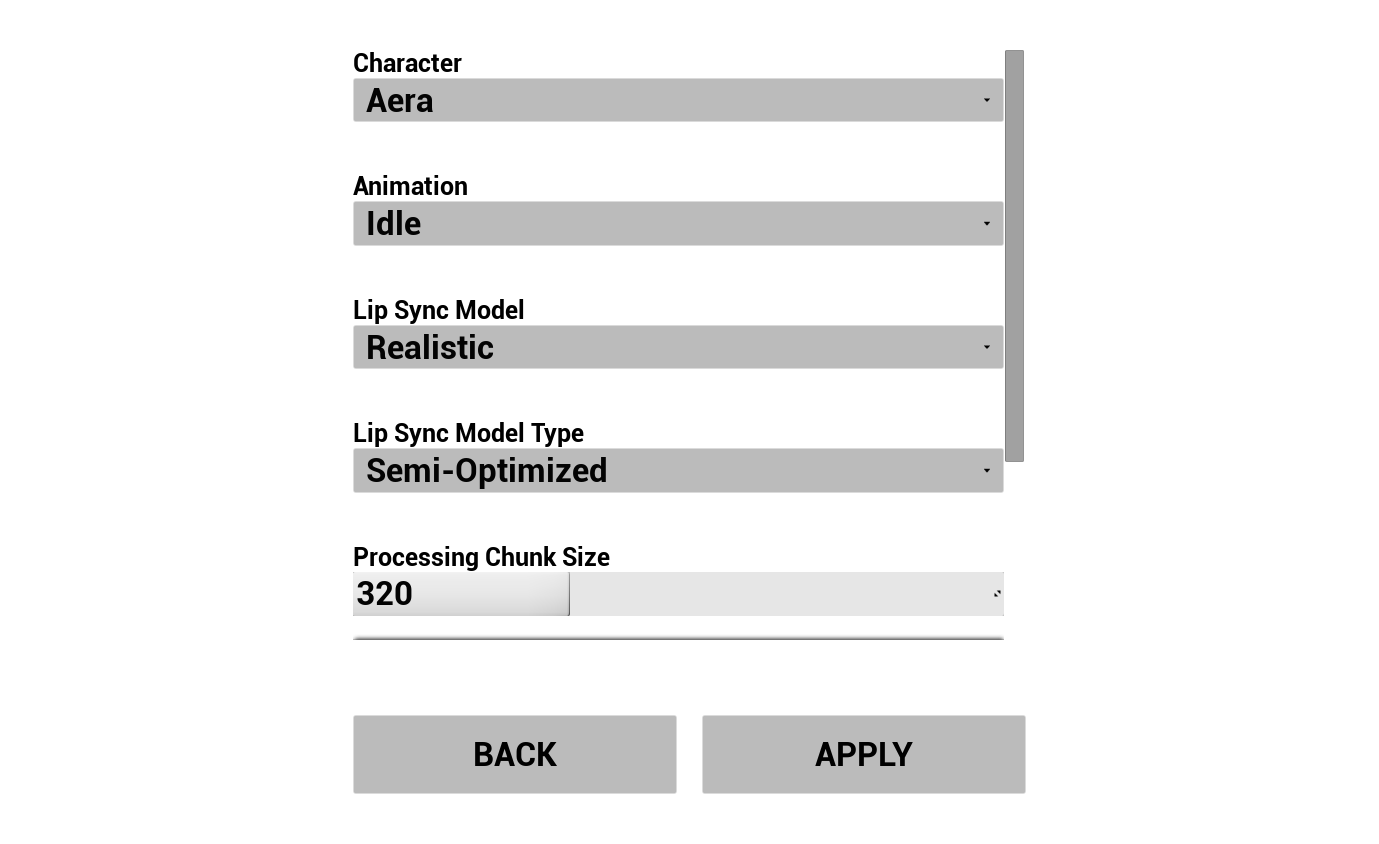

4. Configurar Animações

Controle os visuais do seu avatar de IA:

- Escolha entre 3 personagens MetaHuman pré-baixados (Aera, Ada, Orlando)

- Selecione o modelo de sincronização labial (Standard ou Realistic)

- Selecione o tipo de modelo de sincronização labial - Highly Optimized, Semi-Optimized ou Original (consulte Tipo de Modelo)

- Ajuste o Tamanho do Bloco de Processamento (Processing Chunk Size) - controla a frequência com que a inferência da sincronização labial é executada (consulte Tamanho do Bloco de Processamento)

- Selecione uma animação de espera (idle) para ser reproduzida no MetaHuman durante a conversa

Pré-configurando a Demonstração no Editor

Ao trabalhar com a versão fonte, você pode pré-preencher os valores padrão diretamente no editor para que não precise inserí-los novamente a cada execução:

| O quê | Onde |

|---|---|

| Configurações gerais (modelo de sincronização labial, animação idle, classe do personagem, reconhecimento de fala, etc) | Content/LipSyncSTSGameInstance |

| Configurações de LLM externo / TTS externo (Runtime AI Chatbot Integrator) | Content/Modules/RuntimeAIChatbotIntegrator/RuntimeAIChatbotIntegrator_Provider |

| Configurações de LLM local (Runtime Local LLM) | Content/Modules/RuntimeLocalLLM/RuntimeLocalLLM_Provider |

| Configurações de TTS local (Runtime Text To Speech) | Content/Modules/RuntimeTextToSpeech/RuntimeTextToSpeech_Provider |

Notas sobre Multiplataforma

Todos os plugins usados pela demonstração suportam Windows, Mac, Linux, iOS, Android e plataformas baseadas em Android (incluindo Meta Quest), portanto o projeto de demonstração funciona em todos esses também. Isso o torna adequado para implantação em uma ampla variedade de ambientes — de quiosques de desktop e experiências baseadas em navegador a aplicativos móveis, headsets VR autônomos e configurações de produção virtual no set.

Para dispositivos mais fracos (móveis, VR autônomos), você pode querer:

- Usar o modelo de sincronização labial Standard em vez do Realistic - veja a Comparação de modelos

- Mudar para o tipo de modelo Highly Optimized

- Aumentar o Tamanho do Bloco de Processamento (Processing Chunk Size) para reduzir a carga da CPU

- Escolher modelos menores de LLM / TTS

Veja Configuração específica da plataforma para etapas adicionais de configuração no Android, iOS, Mac e Linux.

Trazendo Seu Próprio Personagem

O projeto de demonstração vem com três personagens MetaHuman de exemplo (Aera, Ada, Orlando), mas você pode importar seu próprio MetaHuman e usá-lo na demonstração.

📺 Tutorial em vídeo: Adicionando um Personagem MetaHuman Personalizado ao Projeto de Demonstração

O próprio plugin Runtime MetaHuman Lip Sync oferece suporte a muitos outros sistemas de personagens além dos MetaHumans (personagens baseados em ARKit, Daz Genesis 8/9, Reallusion CC3/CC4, Mixamo, ReadyPlayerMe, etc - veja o Guia de Configuração de Personagens Personalizados). Se você estiver criando um NPC de jogo, um apresentador virtual, um atendente de quiosque ou um humano digital para produção virtual, o plugin se adapta ao seu pipeline de personagens.

Um projeto de demonstração mais simples que foca puramente no recurso de sincronização labial em si, sem o fluxo de trabalho conversacional completo de IA. Adequado se você quiser apenas ver a sincronização labial em ação com várias fontes de áudio.

Vídeo em Destaque

Downloads

O que está incluído

Esta demonstração mostra os fluxos de trabalho básicos de sincronização labial:

- Entrada de microfone - sincronização labial em tempo real a partir de áudio ao vivo

- Reprodução de arquivo de áudio - sincronização labial a partir de arquivos de áudio importados

- Texto para Fala - sincronização labial conduzida por fala sintetizada

Plugins Obrigatórios e Opcionais

| Plugin | Propósito | Obrigatório? |

|---|---|---|

| Runtime MetaHuman Lip Sync | Animação de sincronização labial | ✅ Obrigatório |

| Runtime Audio Importer | Importação e captura de áudio | ✅ Obrigatório |

| Runtime Text To Speech | TTS local para a cena de demonstração de TTS | 🔶 Opcional |

| Runtime AI Chatbot Integrator | Provedores de TTS externos (OpenAI, ElevenLabs) | 🔶 Opcional |

Notas para o Standard Lip Sync Model

Se você planeja usar o Standard Model (em vez do Realistic) em qualquer projeto de demonstração, você precisará instalar o plugin Standard Lip Sync Extension. Veja Standard Model Extension para instruções de instalação.

Precisa de Ajuda?

Se você encontrar qualquer problema ao configurar ou executar os projetos de demonstração, sinta-se à vontade para entrar em contato:

Para solicitações de desenvolvimento personalizado (por exemplo, estender a demonstração com sua própria lógica, adaptá-la para uma plataforma ou pipeline de personagem específico), entre em contato com [email protected].