Параметры инференса

Структура параметров инференса LLM управляет тем, как модель загружается и генерирует текст. Вы передаете эти параметры при загрузке модели. На этой странице описывается каждый параметр и его эффект.

Справочник параметров

| Параметр | Тип | По умолчанию | Диапазон | Описание |

|---|---|---|---|---|

| Max Tokens | int32 | 512 | 1–8192 | Максимальное количество токенов для генерации за один ответ |

| Temperature | float | 0.7 | 0.0–2.0 | Управляет случайностью. 0.0 = детерминированный вывод. Более высокие значения = более креативный результат |

| Top P | float | 0.9 | 0.0–1.0 | Nucleus sampling. Рассматриваются только токены, совокупная вероятность которых превышает это значение |

| Top K | int32 | 40 | 0–200 | Ограничивает выбор K наиболее вероятных токенов. 0 = отключено |

| Repeat Penalty | float | 1.1 | 0.0–3.0 | Штрафует токены, которые уже встречаются в выводе. 1.0 = без штрафа |

| Num GPU Layers | int32 | -1 | -1–200 | Количество слоёв модели, выгружаемых на GPU. -1 = автоматически. 0 = только CPU |

| Context Size | int32 | 2048 | 128–131072 | Максимальный размер контекстного окна в токенах. Более высокие значения потребляют больше памяти |

| System Prompt | FString | "You are a helpful assistant." | — | Системная инструкция, формирующая поведение модели |

| Seed | int32 | -1 | -1+ | Случайное зерно для воспроизводимого вывода. -1 = случайное |

| Num Threads | int32 | 0 | 0–128 | Количество потоков CPU для генерации. 0 = автоматически |

Использование

- Blueprint

- C++

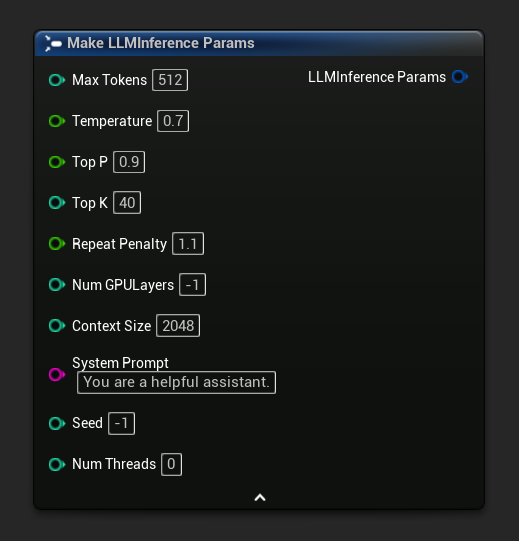

Параметры инференса отображаются как пина структуры на узлах загрузки и асинхронных узлах. Разбейте структуру, чтобы задать отдельные значения:

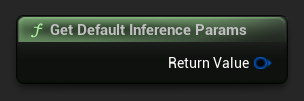

Чтобы получить набор параметров по умолчанию в качестве отправной точки, используйте Get Default Inference Params:

// Creative writing

FLLMInferenceParams CreativeParams;

CreativeParams.MaxTokens = 1024;

CreativeParams.Temperature = 1.2f;

CreativeParams.TopP = 0.95f;

CreativeParams.TopK = 80;

CreativeParams.RepeatPenalty = 1.2f;

CreativeParams.SystemPrompt = TEXT("You are a creative storyteller.");

// Factual / deterministic

FLLMInferenceParams FactualParams;

FactualParams.MaxTokens = 256;

FactualParams.Temperature = 0.1f;

FactualParams.TopP = 0.5f;

FactualParams.TopK = 10;

FactualParams.SystemPrompt = TEXT("Answer questions concisely and accurately.");

// Mobile-optimized

FLLMInferenceParams MobileParams;

MobileParams.MaxTokens = 128;

MobileParams.ContextSize = 1024;

MobileParams.NumGPULayers = 0;

MobileParams.NumThreads = 4;

MobileParams.SystemPrompt = TEXT("You are a helpful assistant. Keep responses brief.");

// Get defaults programmatically

FLLMInferenceParams DefaultParams = URuntimeLocalLLM::GetDefaultInferenceParams();

Рекомендации по платформам

Мобильные устройства / VR (Android, iOS, Meta Quest)

- Context Size: 1024–2048

- Num GPU Layers: 0 (только CPU), если устройство не подтверждает поддержку GPU-вычислений

- Max Tokens: менее 256 для быстрой реакции

- Num Threads: 2–4 в зависимости от устройства

Десктоп (Windows, Mac, Linux)

- Context Size: 2048–8192 для большинства разговоров

- Num GPU Layers: -1 (авто) для использования ускорения GPU, когда доступно

- Num Threads: 0 (авто)

- Max Tokens: 512–2048 для более длинных ответов