Настройка плагина

Настройка модели

Стандартная настройка модели

Узел Create Runtime Viseme Generator использует настройки по умолчанию, которые хорошо работают в большинстве сценариев. Конфигурация осуществляется через свойства узла смешивания Animation Blueprint.

Для параметров конфигурации Animation Blueprint см. раздел Настройка синхронизации губ ниже.

Настройка реалистичной модели

Узел Create Realistic MetaHuman Lip Sync Generator принимает необязательный параметр Configuration, который позволяет настроить поведение генератора:

Тип модели

Настройка Model Type определяет, какую версию реалистичной модели использовать:

| Тип модели | Производительность | Визуальное качество | Обработка шума | Рекомендуемые случаи использования |

|---|---|---|---|---|

| Highly Optimized (По умолчанию) | Наивысшая производительность, наименьшее использование ЦП | Хорошее качество | Может показывать заметные движения рта при фоновом шуме или неголосовых звуках | Чистые аудиоокружения, сценарии, критичные к производительности |

| Semi-Optimized | Хорошая производительность, умеренное использование ЦП | Высокое качество | Лучшая стабильность с шумным аудио | Сбалансированная производительность и качество, смешанные аудиоусловия |

| Original | Подходит для использования в реальном времени на современных ЦП | Наивысшее качество | Наиболее стабильна с фоновым шумом и неголосовыми звуками | Высококачественные постановки, шумные аудиоокружения, когда требуется максимальная точность |

Настройки производительности

Intra Op Threads: Управляет количеством потоков, используемых для внутренних операций обработки модели.

- 0 (По умолчанию/Автоматически): Использует автоматическое определение (обычно 1/4 доступных ядер ЦП, максимум 4)

- 1-16: Указать количество потоков вручную. Более высокие значения могут улучшить производительность на многопроцессорных системах, но используют больше ресурсов ЦП

Inter Op Threads: Управляет количеством потоков, используемых для параллельного выполнения различных операций модели.

- 0 (По умолчанию/Автоматически): Использует автоматическое определение (обычно 1/8 доступных ядер ЦП, максимум 2)

- 1-8: Указать количество потоков вручную. Обычно держится на низком уровне для обработки в реальном времени

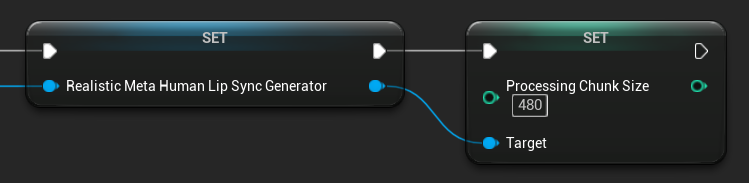

Размер чанка обработки

Processing Chunk Size определяет, сколько сэмплов обрабатывается на каждом шаге вывода. Значение по умолчанию — 160 сэмплов (10 мс аудио при 16 кГц):

- Меньшие значения обеспечивают более частые обновления, но увеличивают использование ЦП

- Большие значения снижают нагрузку на ЦП, но могут уменьшить отзывчивость синхронизации губ

- Рекомендуется использовать кратные 160 для оптимального выравнивания

Настройка модели с поддержкой настроения

Узел Create Realistic MetaHuman Lip Sync With Mood Generator предоставляет дополнительные параметры конфигурации помимо базовой реалистичной модели:

Базовая конфигурация

Lookahead Ms: Время упреждения в миллисекундах для повышения точности синхронизации губ.

- По умолчанию: 80 мс

- Диапазон: от 20 мс до 200 мс (должно быть кратно 20)

- Более высокие значения обеспечивают лучшую синхронизацию, но увеличивают задержку

Output Type: Управляет тем, какие лицевые контролы генерируются.

- Full Face: Все 81 лицевой контрол (брови, глаза, нос, рот, челюсть, язык)

- Mouth Only: Только контролы, связанные со ртом, челюстью и языком

Performance Settings: Использует те же настройки Intra Op Threads и Inter Op Threads, что и обычная реалистичная модель.

Настройки настроения

Доступные настроения:

- Нейтральное, Счастливое, Грустное, Отвращение, Злость, Удивление, Страх

- Уверенное, Взволнованное, Скучающее, Игривое, Смущенное

Интенсивность настроения: Управляет тем, насколько сильно настроение влияет на анимацию (от 0.0 до 1.0)

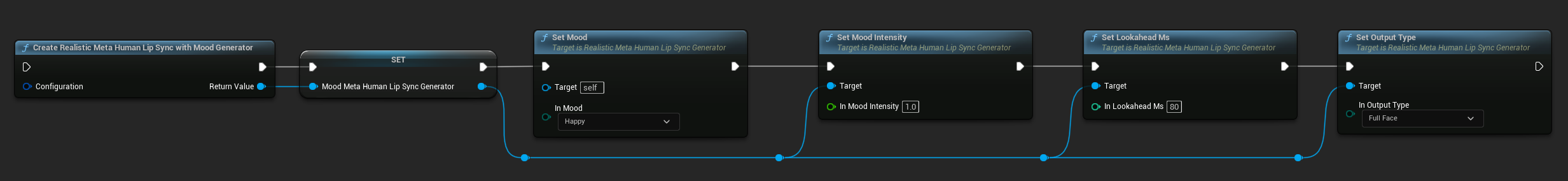

Управление настроением в реальном времени

Вы можете настраивать параметры настроения во время выполнения с помощью следующих функций:

- Set Mood: Изменить текущий тип настроения

- Set Mood Intensity: Настроить, насколько сильно настроение влияет на анимацию (от 0.0 до 1.0)

- Set Lookahead Ms: Изменить время упреждения для синхронизации

- Set Output Type: Переключиться между контролами Full Face и Mouth Only

Руководство по выбору настроения

Выбирайте подходящие настроения в зависимости от вашего контента:

| Настроение | Лучше всего подходит для | Типичный диапазон интенсивности |

|---|---|---|

| Нейтральное | Общий разговор, повествование, состояние по умолчанию | 0.5 - 1.0 |

| Счастливое | Позитивный контент, радостный диалог, празднования | 0.6 - 1.0 |

| Грустное | Меланхоличный контент, эмоциональные сцены, мрачные моменты | 0.5 - 0.9 |

| Отвращение | Негативные реакции, неприятный контент, отвержение | 0.4 - 0.8 |

| Злость | Агрессивный диалог, конфронтационные сцены, разочарование | 0.6 - 1.0 |

| Удивление | Неожиданные события, откровения, реакции шока | 0.7 - 1.0 |

| Страх | Угрожающие ситуации, тревога, нервный диалог | 0.5 - 0.9 |

| Уверенное | Профессиональные презентации, диалоги лидеров, уверенная речь | 0.7 - 1.0 |

| Взволнованное | Энергичный контент, объявления, восторженный диалог | 0.8 - 1.0 |

| Скучающее | Монотонный контент, незаинтересованный диалог, уставшая речь | 0.3 - 0.7 |

| Игривое | Неформальный разговор, юмор, легкие взаимодействия | 0.6 - 0.9 |

| Смущенное | Диалог с множеством вопросов, неуверенность, недоумение | 0.4 - 0.8 |

Настройка Animation Blueprint

Настройка синхронизации губ

- Standard Model

- Realistic Models

Узел Blend Runtime MetaHuman Lip Sync имеет параметры конфигурации на своей панели свойств:

| Свойство | По умолчанию | Описание |

|---|---|---|

| Interpolation Speed | 25 | Управляет тем, насколько быстро движения губ переходят между висемами. Более высокие значения приводят к более быстрым и резким переходам. |

| Reset Time | 0.2 | Продолжительность в секундах, после которой синхронизация губ сбрасывается. Это полезно, чтобы предотвратить продолжение синхронизации губ после остановки аудио. |

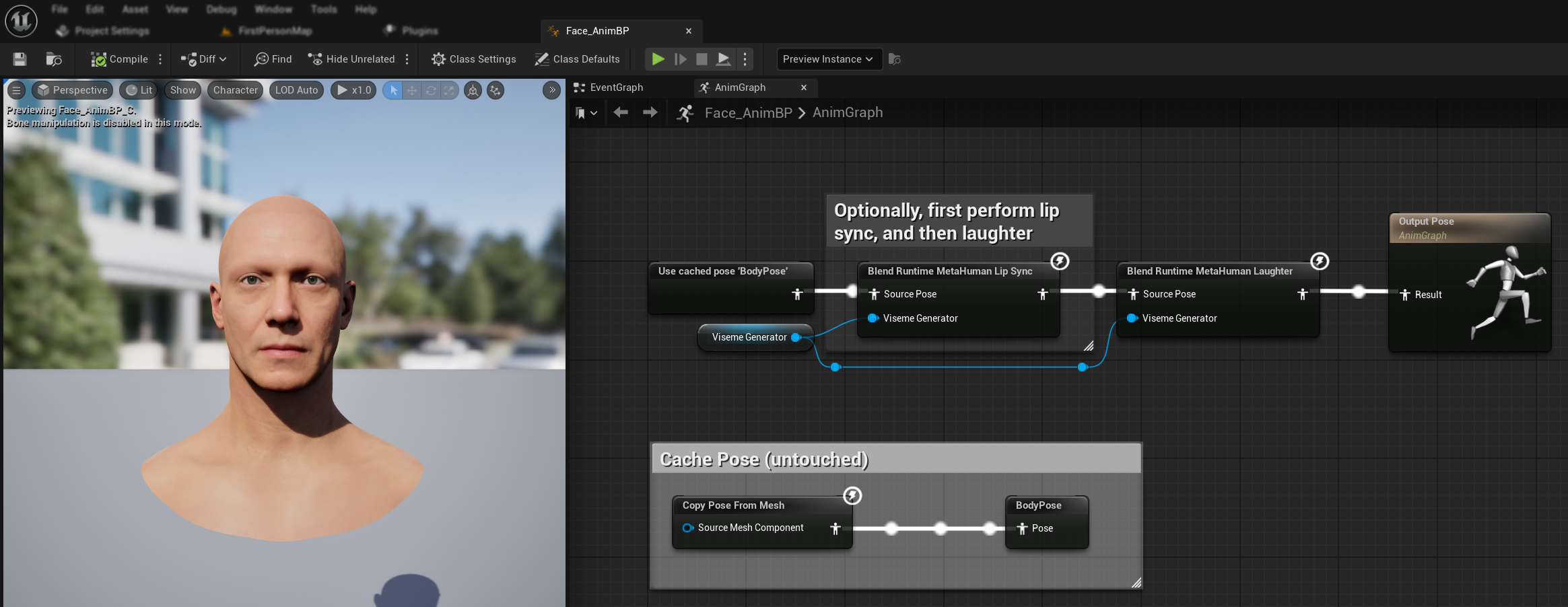

Анимация смеха

Вы также можете добавить анимации смеха, которые будут динамически реагировать на смех, обнаруженный в аудио:

- Добавьте узел

Blend Runtime MetaHuman Laughter - Подключите вашу переменную

RuntimeVisemeGeneratorк пинуViseme Generator - Если вы уже используете синхронизацию губ:

- Подключите выход из узла

Blend Runtime MetaHuman Lip Syncк пинуSource PoseузлаBlend Runtime MetaHuman Laughter - Подключите выход узла

Blend Runtime MetaHuman Laughterк пинуResultузлаOutput Pose

- Подключите выход из узла

- Если используется только смех без синхронизации губ:

- Подключите вашу исходную позу напрямую к пину

Source PoseузлаBlend Runtime MetaHuman Laughter - Подключите выход к пину

Result

- Подключите вашу исходную позу напрямую к пину

Когда в аудио обнаруживается смех, ваш персонаж будет динамически анимироваться соответствующим образом:

Конфигурация смеха

Узел Blend Runtime MetaHuman Laughter имеет собственные параметры конфигурации:

| Свойство | По умолчанию | Описание |

|---|---|---|

| Interpolation Speed | 25 | Управляет скоростью перехода движений губ между анимациями смеха. Более высокие значения приводят к более быстрым и резким переходам. |

| Reset Time | 0.2 | Длительность в секундах, после которой смех сбрасывается. Это полезно для предотвращения продолжения смеха после остановки аудио. |

| Max Laughter Weight | 0.7 | Масштабирует максимальную интенсивность анимации смеха (0.0 - 1.0). |

Примечание: Обнаружение смеха в настоящее время доступно только со Стандартной моделью.

Узел Blend Realistic MetaHuman Lip Sync имеет параметры конфигурации на панели свойств:

| Свойство | По умолчанию | Описание |

|---|---|---|

| Interpolation Speed | 30 | Управляет скоростью перехода мимических выражений во время активной речи. Более высокие значения приводят к более быстрым и резким переходам. |

| Idle Interpolation Speed | 15 | Управляет скоростью перехода мимических выражений обратно в состояние покоя/нейтральное. Более низкие значения создают более плавный и постепенный возврат к позе покоя. |

| Reset Time | 0.2 | Длительность в секундах, после которой синхронизация губ сбрасывается в состояние покоя. Полезно для предотвращения продолжения выражений после остановки аудио. |

| Preserve Idle State | false | При включении сохраняет последнее эмоциональное состояние в периоды покоя вместо сброса к нейтральному. |

| Preserve Eye Expressions | true | Управляет тем, сохраняются ли связанные с глазами мимические контролы в состоянии покоя. Эффективно только при включенном Preserve Idle State. |

| Preserve Brow Expressions | true | Управляет тем, сохраняются ли связанные с бровями мимические контролы в состоянии покоя. Эффективно только при включенном Preserve Idle State. |

| Preserve Mouth Shape | false | Управляет тем, сохраняются ли контролы формы рта (за исключением специфичных для речи движений, таких как язык и челюсть) в состоянии покоя. Эффективно только при включенном Preserve Idle State. |

Сохранение состояния покоя

Функция Preserve Idle State решает вопрос о том, как Реалистичная модель обрабатывает периоды тишины. В отличие от Стандартной модели, которая использует дискретные висемы и последовательно возвращается к нулевым значениям во время тишины, нейронная сеть Реалистичной модели может поддерживать тонкое позиционирование лица, отличающееся от позы покоя MetaHuman по умолчанию.

Когда включать:

- Поддержание эмоциональных выражений между сегментами речи

- Сохранение черт личности персонажа

- Обеспечение визуальной непрерывности в кинематографических последовательностях

Параметры регионального контроля:

- Eye Expressions: Сохраняет прищуривание, расширение глаз и позиционирование век

- Brow Expressions: Сохраняет позиционирование бровей и лба

- Mouth Shape: Сохраняет общую кривизну рта, позволяя сбрасываться движениям речи (язык, челюсть)

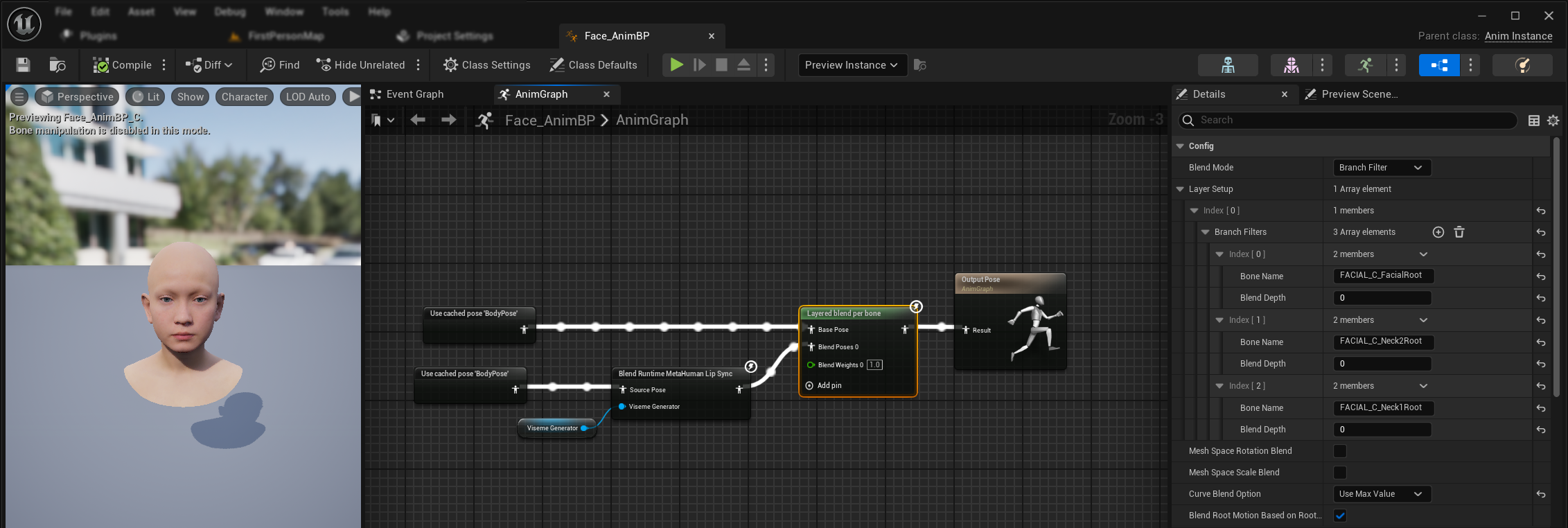

Комбинирование с существующими анимациями

Чтобы применять синхронизацию губ и смех вместе с существующими анимациями тела и пользовательскими мимическими анимациями без их перезаписи:

- Добавьте узел

Layered blend per boneмежду вашими анимациями тела и финальным выводом. Убедитесь, чтоUse Attached Parentустановлен в true. - Настройте слой:

- Добавьте 1 элемент в массив

Layer Setup - Добавьте 3 элемента в

Branch Filtersдля слоя, со следующими именами костей (Bone Name):FACIAL_C_FacialRootFACIAL_C_Neck2RootFACIAL_C_Neck1Root

- Добавьте 1 элемент в массив

- Важно для пользовательских мимических анимаций: В

Curve Blend Optionвыберите "Use Max Value". Это позволяет правильно накладывать пользовательские мимические анимации (выражения, эмоции и т.д.) поверх синхронизации губ. - Сделайте соединения:

- Существующие анимации (например,

BodyPose) → входBase Pose - Выход мимической анимации (от узлов синхронизации губ и/или смеха) → вход

Blend Poses 0 - Узел Layered blend → финальная поза

Result

- Существующие анимации (например,

Выбор набора морф-таргетов

- Standard Model

- Realistic Models

Стандартная модель использует ассеты поз, которые по своей сути поддерживают любое соглашение об именовании морф-таргетов через настройку пользовательского ассета поз. Дополнительная конфигурация не требуется.

Узел Blend Realistic MetaHuman Lip Sync включает свойство Morph Target Set, которое определяет, какое соглашение об именовании морф-таргетов использовать для мимической анимации:

| Morph Target Set | Описание | Варианты использования |

|---|---|---|

| MetaHuman (По умолчанию) | Стандартные имена морф-таргетов MetaHuman (например, CTRL_expressions_jawOpen) | Персонажи MetaHuman |

| ARKit | Имена, совместимые с Apple ARKit (например, JawOpen, MouthSmileLeft) | Персонажи на основе ARKit |

Тонкая настройка поведения синхронизации губ

Управление высовыванием языка

В стандартной модели синхронизации губ вы можете заметить чрезмерное выдвижение языка вперед во время определенных фонем. Чтобы контролировать высовывание языка:

- После вашего узла смешивания синхронизации губ добавьте узел

Modify Curve - Щелкните правой кнопкой мыши на узле

Modify Curveи выберите Add Curve Pin - Добавьте пин кривой с именем

CTRL_expressions_tongueOut - Установите свойство Apply Mode узла в Scale

- Отрегулируйте параметр Value, чтобы контролировать выдвижение языка (например, 0.8 для уменьшения высовывания на 20%)

Управление открытием челюсти

Реалистичная синхронизация губ может создавать чрезмерно отзывчивые движения челюсти в зависимости от вашего аудиоконтента и визуальных требований. Чтобы настроить интенсивность открытия челюсти:

- После вашего узла смешивания синхронизации губ добавьте узел

Modify Curve - Щелкните правой кнопкой мыши на узле

Modify Curveи выберите Add Curve Pin - Добавьте пин кривой с именем

CTRL_expressions_jawOpen - Установите свойство Apply Mode узла в Scale

- Отрегулируйте параметр Value, чтобы контролировать диапазон открытия челюсти (например, 0.9 для уменьшения движения челюсти на 10%)

Тонкая настройка для конкретного настроения

Для моделей с поддержкой настроения вы можете точно настроить определенные эмоциональные выражения:

Управление бровями:

CTRL_expressions_browRaiseInL/CTRL_expressions_browRaiseInR- Поднятие внутренней части бровиCTRL_expressions_browRaiseOuterL/CTRL_expressions_browRaiseOuterR- Поднятие внешней части бровиCTRL_expressions_browDownL/CTRL_expressions_browDownR- Опускание брови

Управление выражением глаз:

CTRL_expressions_eyeSquintInnerL/CTRL_expressions_eyeSquintInnerR- Прищуривание глазCTRL_expressions_eyeCheekRaiseL/CTRL_expressions_eyeCheekRaiseR- Поднятие щеки

Сравнение и выбор модели

Выбор между моделями

При принятии решения о том, какую модель синхронизации губ использовать для вашего проекта, учитывайте следующие факторы:

| Критерий | Стандартная модель | Реалистичная модель | Реалистичная модель с поддержкой настроения |

|---|---|---|---|

| Совместимость с персонажами | MetaHumans и все типы пользовательских персонажей | Персонажи MetaHumans (и ARKit) | Персонажи MetaHumans (и ARKit) |

| Визуальное качество | Хорошая синхронизация губ с эффективной производительностью | Улучшенный реализм с более естественными движениями рта | Улучшенный реализм с эмоциональными выражениями |

| Производительность | Оптимизирована для всех платформ, включая мобильные/VR | Более высокие требования к ресурсам | Более высокие требования к ресурсам |

| Функции | 14 висем, обнаружение смеха | 81 мимический контрол, 3 уровня оптимизации | 81 мимический контрол, 12 настроений, настраиваемый вывод |

| Поддержка платформ | Windows, Android, Quest | Windows, Mac, iOS, Linux, Android, Quest | Windows, Mac, iOS, Linux, Android, Quest |

| Варианты использования | Общие приложения, игры, VR/AR, мобильные | Кинематографические впечатления, взаимодействия крупным планом | Эмоциональное повествование, продвинутое взаимодействие с персонажами |

Совместимость с версиями движка

Если вы используете Unreal Engine 5.2, Реалистичные модели могут работать некорректно из-за ошибки в библиотеке ресемплинга UE. Пользователям UE 5.2, которым требуется надежная функциональность синхронизации губ, рекомендуется использовать Стандартную модель.

Эта проблема специфична для UE 5.2 и не затрагивает другие версии движка.

Рекомендации по производительности

- Для большинства проектов Стандартная модель обеспечивает отличный баланс качества и производительности

- Используйте Реалистичную модель, когда вам нужна максимальная визуальная точность для персонажей MetaHuman

- Используйте Реалистичную модель с поддержкой настроения, когда контроль эмоциональных выражений важен для вашего приложения

- Учитывайте возможности производительности целевой платформы при выборе между моделями

- Тестируйте разные уровни оптимизации, чтобы найти наилучший баланс для вашего конкретного случая использования

Устранение неполадок

Распространенные проблемы

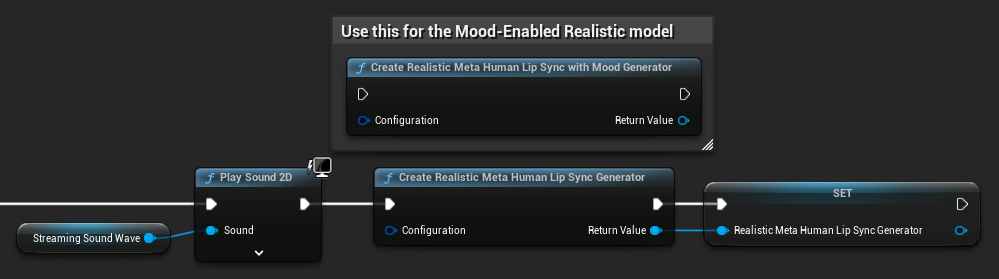

Пересоздание генератора для Реалистичных моделей: Для надежной и стабильной работы с Реалистичными моделями рекомендуется пересоздавать генератор каждый раз, когда вы хотите подать новые аудиоданные после периода бездействия. Это связано с поведением среды выполнения ONNX, которое может привести к прекращению работы синхронизации губ при повторном использовании генераторов после периодов тишины.

Например, вы можете пересоздавать генератор синхронизации губ при каждом начале воспроизведения, например, всякий раз, когда вы вызываете Play Sound 2D или используете любой другой метод для запуска воспроизведения звуковой волны и синхронизации губ:

Расположение плагина для интеграции с Runtime Text To Speech: При использовании Runtime MetaHuman Lip Sync вместе с Runtime Text To Speech (оба плагина используют ONNX Runtime) у вас могут возникнуть проблемы в собранных сборках, если плагины установлены в папке Marketplace движка. Чтобы исправить это:

- Найдите оба плагина в папке установки UE в

\Engine\Plugins\Marketplace(например,C:\Program Files\Epic Games\UE_5.6\Engine\Plugins\Marketplace) - Переместите обе папки

RuntimeMetaHumanLipSyncиRuntimeTextToSpeechв папкуPluginsвашего проекта - Если в вашем проекте нет папки

Plugins, создайте ее в том же каталоге, что и файл.uproject - Перезапустите Unreal Editor

Это решает проблемы совместимости, которые могут возникнуть при загрузке нескольких плагинов на основе ONNX Runtime из каталога Marketplace движка.

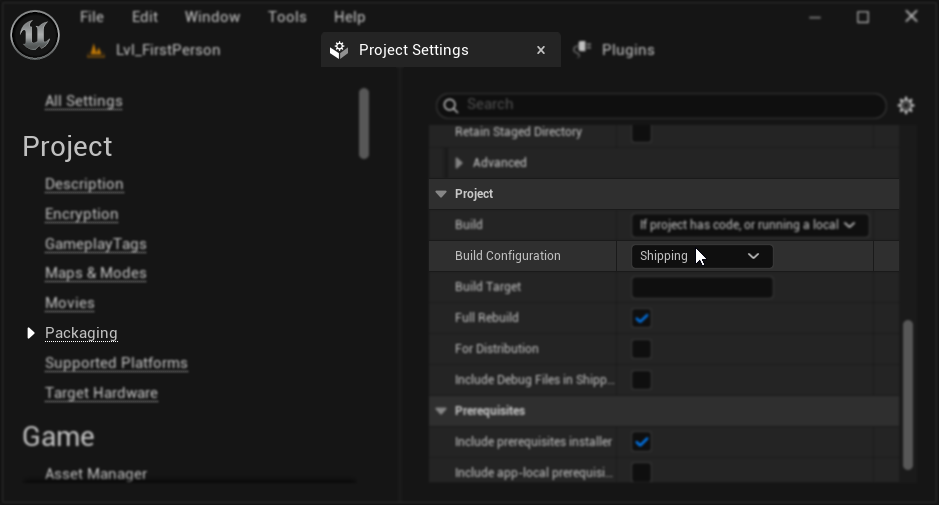

Конфигурация сборки (Windows): Если синхронизация губ не работает корректно в вашем собранном проекте на Windows, убедитесь, что вы используете конфигурацию сборки Shipping вместо Development. Конфигурация Development может вызывать проблемы со средой выполнения ONNX реалистичных моделей в собранных сборках.

Чтобы исправить это:

- В настройках вашего проекта (Project Settings) → Packaging установите Build Configuration в Shipping

- Пересоберите ваш проект

В некоторых проектах только на Blueprint Unreal Engine все еще может собирать в конфигурации Development, даже когда выбран Shipping. Если это произойдет, преобразуйте ваш проект в проект C++, добавив хотя бы один класс C++ (он может быть пустым). Для этого перейдите в меню редактора UE Tools → New C++ Class и создайте пустой класс. Это заставит проект собираться правильно в конфигурации Shipping. Ваш проект может оставаться функционально только на Blueprint, класс C++ нужен только для правильной конфигурации сборки.

Снижение отзывчивости синхронизации губ: Если вы столкнулись с тем, что синхронизация губ становится менее отзывчивой со временем при использовании Streaming Sound Wave или Capturable Sound Wave, это может быть вызвано накоплением памяти. По умолчанию память перераспределяется каждый раз, когда добавляется новое аудио. Чтобы предотвратить эту проблему, периодически вызывайте функцию ReleaseMemory, чтобы освободить накопленную память, например, каждые 30 секунд или около того.

Оптимизация производительности:

- Настройте Processing Chunk Size для Реалистичных моделей в соответствии с вашими требованиями к производительности

- Используйте соответствующее количество потоков для вашего целевого оборудования

- Рассмотрите возможность использования типа вывода Mouth Only для моделей с поддержкой настроения, когда полная мимическая анимация не требуется