Çeviri Sağlayıcıları

AI Localization Automator, her biri benzersiz güçlü yönlere ve yapılandırma seçeneklerine sahip beş farklı AI sağlayıcısını destekler. Projenizin ihtiyaçlarına, bütçesine ve kalite gereksinimlerine en uygun sağlayıcıyı seçin.

Ollama (Yerel AI)

En iyi olduğu alan: Gizlilik hassasiyeti yüksek projeler, çevrimdışı çeviri, sınırsız kullanım

Ollama, AI modellerini makinenizde yerel olarak çalıştırır, API maliyeti veya internet gereksinimi olmadan tam gizlilik ve kontrol sağlar.

Popüler Modeller

- translategemma:12b (Gemma 3 tabanlı özel çeviri modeli)

- llama3.2 (Önerilen genel amaçlı model)

- mistral (Verimli alternatif)

- codellama (Kod farkındalıklı çeviriler)

- Ve daha birçok topluluk modeli

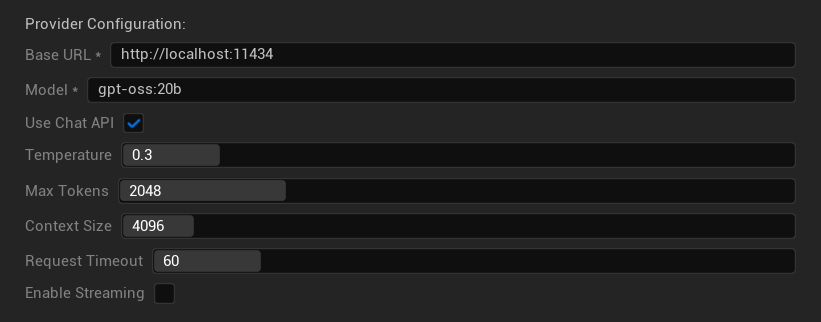

Yapılandırma Seçenekleri

- Temel URL: Yerel Ollama sunucusu (varsayılan:

http://localhost:11434) - Model: Yerel olarak yüklenmiş modelin adı (gerekli)

- Sohbet API'sini Kullan: Daha iyi konuşma işleme için etkinleştir

- Sıcaklık: 0.0-2.0 (0.3 önerilir)

- Maksimum Token: 1-8,192 token

- Bağlam Boyutu: 512-32,768 token

- İstek Zaman Aşımı: 10-300 saniye (yerel modeller daha yavaş olabilir)

- Akışı Etkinleştir: Gerçek zamanlı yanıt işleme için

Güçlü Yönler

- ✅ Tam gizlilik (veriler makinenizden ayrılmaz)

- ✅ API maliyeti veya kullanım limiti yok

- ✅ Çevrimdışı çalışır

- ✅ Model parametreleri üzerinde tam kontrol

- ✅ Geniş topluluk modeli çeşitliliği

- ✅ Tedarikçi kilidi yok

Dikkat Edilmesi Gerekenler

- 💻 Yerel kurulum ve yetenekli donanım gerektirir

- ⚡ Genellikle bulut sağlayıcılardan daha yavaştır

- 🔧 Daha teknik bir kurulum gerektirir

- 📊 Çeviri kalitesi modele göre önemli ölçüde değişir (bazıları bulut sağlayıcıları aşabilir)

- 💾 Modeller için büyük depolama gereksinimleri

Ollama'yı Kurma

- Ollama'yı Yükleyin: ollama.ai adresinden indirin ve sisteminize kurun

- Modelleri İndirin: Seçtiğiniz modeli indirmek için

ollama pull translategemma:12bkomutunu kullanın - Sunucuyu Başlatın: Ollama otomatik olarak çalışır veya

ollama serveile başlatın - Eklentiyi Yapılandırın: Eklenti ayarlarında temel URL ve model adını ayarlayın

- Bağlantıyı Test Edin: Eklenti, yapılandırmayı uyguladığınızda bağlantıyı doğrulayacaktır

OpenAI

En iyi olduğu alan: En yüksek genel çeviri kalitesi, kapsamlı model seçimi

OpenAI, en son GPT modelleri, akıl yürütme modelleri ve web araması etkin modeller de dahil olmak üzere, sektör lideri dil modellerini Sohbet Tamamlama API'si aracılığıyla sağlar.

Mevcut Modeller

GPT-5 Ailesi (Bayrak taşıyan modeller)

- gpt-5, gpt-5-mini, gpt-5-nano

- gpt-5.1, gpt-5.2, gpt-5.3-chat-latest

- gpt-5.4, gpt-5.4-mini, gpt-5.4-nano

GPT-4.1 Ailesi (Yüksek performans)

- gpt-4.1, gpt-4.1-mini, gpt-4.1-nano

GPT-4o Ailesi (Çoklu ortam)

- gpt-4o, gpt-4o-mini, chatgpt-4o-latest

O-Serisi (Akıl yürütme modelleri — sıcaklık/top_p desteklenmez)

- o1, o1-pro, o3, o3-mini, o4-mini

Web Arama Modelleri (Sıcaklık/top_p desteklenmez)

- gpt-5-search-api, gpt-4o-search-preview, gpt-4o-mini-search-preview

Eski / Önizleme

- gpt-4.5-preview, gpt-4, gpt-4-32k, gpt-4-turbo, gpt-3.5-turbo, gpt-3.5-turbo-16k

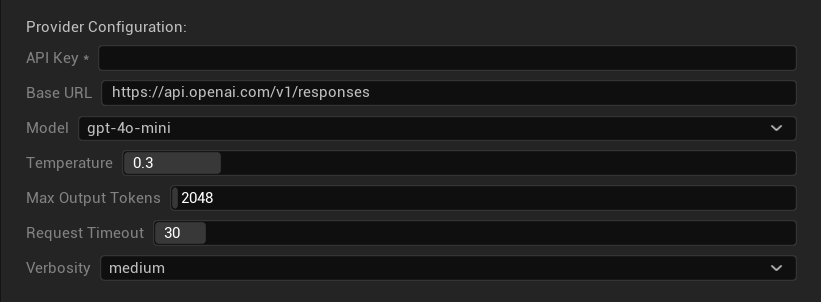

Yapılandırma Seçenekleri

- API Anahtarı: OpenAI API anahtarınız (gerekli)

- Temel URL: API uç noktası (varsayılan:

https://api.openai.com/v1/chat/completions) - Model: Yukarıda listelenen mevcut modellerden seçin

- Sıcaklık Kullan: Sıcaklık parametresini aç/kapat (o-serisi akıl yürütme ve web arama modelleri için otomatik olarak yok sayılır)

- Sıcaklık: 0.0–2.0 (çeviri tutarlılığı için 0.3 önerilir)

- Top P: 0.0–1.0 çekirdek örnekleme parametresi (o-serisi akıl yürütme ve web arama modelleri için yok sayılır)

- Maksimum Tamamlama Token: 1–128,000 token (hem çıktıyı hem de akıl yürütme token'larını içerir)

- İstek Zaman Aşımı: 5–300 saniye

Güçlü Yönler

- ✅ Tutarlı yüksek kaliteli çeviriler

- ✅ Mükemmel bağlam anlama

- ✅ Güçlü format koruma

- ✅ Geniş dil desteği

- ✅ Güvenilir API çalışma süresi

Dikkat Edilmesi Gerekenler

- 💰 İstek başına daha yüksek maliyet

- 🌐 İnternet bağlantısı gerektirir

- ⏱️ Kademeye göre kullanım limitleri

Anthropic Claude

En iyi olduğu alan: Nüanslı çeviriler, yaratıcı içerik, güvenlik odaklı uygulamalar

Claude modelleri bağlamı ve nüansları anlamada üstündür, bu da onları anlatım ağırlıklı oyunlar ve karmaşık yerelleştirme senaryoları için ideal kılar.

Mevcut Modeller

Claude 4.6 Ailesi (En son)

- claude-opus-4-6, claude-sonnet-4-6

Claude 4.5 Ailesi

- claude-haiku-4-5 (Hızlı ve verimli)

- claude-sonnet-4-5, claude-opus-4-5

Claude 4.x Ailesi

- claude-sonnet-4-0, claude-opus-4-1, claude-opus-4-0

Claude 3.x Ailesi (Eski)

- claude-3-7-sonnet-latest, claude-3-5-haiku-latest, claude-3-opus-latest

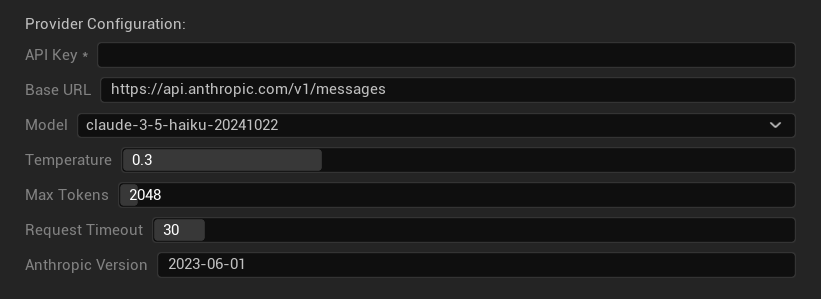

Yapılandırma Seçenekleri

- API Anahtarı: Anthropic API anahtarınız (gerekli)

- Temel URL: Claude API uç noktası

- Model: Claude model ailesinden seçin

- Sıcaklık: 0.0–1.0 (0.3 önerilir)

- Top K: Top-K örnekleme parametresi (0 = ayarlanmamış)

- Maksimum Token: 1–64,000 token

- İstek Zaman Aşımı: 5–300 saniye

- Anthropic Sürümü: API sürüm başlığı

Güçlü Yönler

- ✅ Olağanüstü bağlam farkındalığı

- ✅ Yaratıcı/anlatımsal içerik için harika

- ✅ Güçlü güvenlik özellikleri

- ✅ Detaylı akıl yürütme yetenekleri (3.7+ modellerde genişletilmiş düşünme)

- ✅ Mükemmel talimat takibi

Dikkat Edilmesi Gerekenler

- 💰 Premium fiyatlandırma modeli

- 🌐 İnternet bağlantısı gerektirir

- 📏 Token limitleri modele göre değişir

DeepSeek

En iyi olduğu alan: Maliyet etkin çeviri, yüksek iş hacmi, bütçe odaklı projeler

DeepSeek, diğer sağlayıcıların maliyetinin çok küçük bir kıyısına rekabetçi çeviri kalitesi sunar, bu da onu büyük ölçekli yerelleştirme projeleri için ideal kılar.

Mevcut Modeller

- deepseek-chat (Genel amaçlı, önerilir)

- deepseek-reasoner (Gelişmiş akıl yürütme yetenekleri)

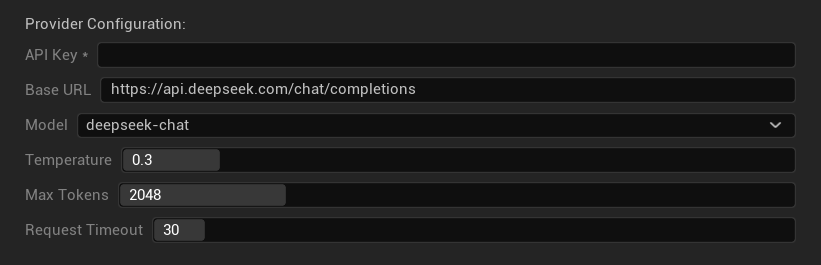

Yapılandırma Seçenekleri

- API Anahtarı: DeepSeek API anahtarınız (gerekli)

- Temel URL: DeepSeek API uç noktası

- Model: Sohbet ve akıl yürütücü modeller arasında seçim yapın

- Sıcaklık: 0.0-2.0 (0.3 önerilir)

- Maksimum Token: 1-8,192 token

- İstek Zaman Aşımı: 5-300 saniye

Güçlü Yönler

- ✅ Çok maliyet etkin

- ✅ İyi çeviri kalitesi

- ✅ Hızlı yanıt süreleri

- ✅ Basit yapılandırma

- ✅ Yüksek oran limitleri

Dikkat Edilmesi Gerekenler

- 📏 Daha düşük token limitleri

- 🆕 Daha yeni sağlayıcı (daha az geçmiş)

- 🌐 İnternet bağlantısı gerektirir

Google Gemini

En iyi olduğu alan: Çok dilli projeler, maliyet etkin çeviri, Google ekosistemi entegrasyonu

Gemini modelleri, rekabetçi fiyatlandırma ve gelişmiş akıl yürütme için düşünme modu gibi benzersiz özelliklerle güçlü çok dilli yetenekler sunar.

Mevcut Modeller

Gemini 3.x Ailesi (Önizleme)

- gemini-3.1-pro-preview, gemini-3-pro-preview, gemini-3-flash-preview

Gemini 2.5 Ailesi (Düşünme desteği ile)

- gemini-2.5-pro (Düşünme özellikli bayrak taşıyan model)

- gemini-2.5-flash (Hızlı, düşünme desteği ile)

- gemini-2.5-flash-lite (Hafif sürüm)

Gemini 2.0 Ailesi

- gemini-2.0-flash, gemini-2.0-flash-lite

En Son Takma Adlar

- gemini-flash-latest, gemini-flash-lite-latest

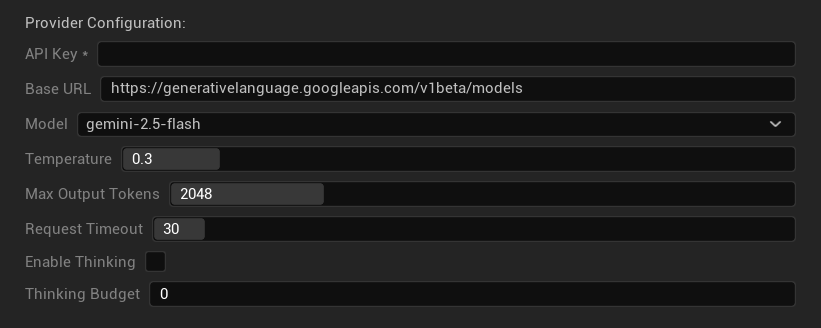

Yapılandırma Seçenekleri

- API Anahtarı: Google AI API anahtarınız (gerekli)

- Temel URL: Gemini API uç noktası

- Model: Gemini model ailesinden seçin

- Sıcaklık: 0.0–2.0 (0.3 önerilir)

- Maksimum Çıktı Token: 1–8,192 token

- İstek Zaman Aşımı: 5–300 saniye

- Düşünmeyi Etkinleştir: 2.5+ modeller için gelişmiş akıl yürütmeyi etkinleştir

- Düşünme Bütçesi: Düşünme token tahsisini kontrol edin (0 = düşünme yok)

Güçlü Yönler

- ✅ Güçlü çok dilli destek

- ✅ Rekabetçi fiyatlandırma

- ✅ Gelişmiş akıl yürütme (düşünme modu)

- ✅ Google ekosistemi entegrasyonu

- ✅ En yeni modellere önizleme erişimi ile düzenli model güncellemeleri

Dikkat Edilmesi Gerekenler

- 🧠 Düşünme modu token kullanımını artırır

- 📏 Modele göre değişken token limitleri

- 🌐 İnternet bağlantısı gerektirir

Doğru Sağlayıcıyı Seçme

| Sağlayıcı | En İyi Olduğu Alan | Kalite | Maliyet | Kurulum | Gizlilik |

|---|---|---|---|---|---|

| Ollama | Gizlilik/çevrimdışı | Değişken* | Ücretsiz | Gelişmiş | Yerel |

| OpenAI | En yüksek kalite | ⭐⭐⭐⭐⭐ | 💰💰💰 | Kolay | Bulut |

| Claude | Yaratıcı içerik | ⭐⭐⭐⭐⭐ | 💰💰💰💰 | Kolay | Bulut |

| DeepSeek | Bütçe projeleri | ⭐⭐⭐⭐ | 💰 | Kolay | Bulut |

| Gemini | Çok dilli | ⭐⭐⭐⭐ | 💰 | Kolay | Bulut |

*Ollama için kalite, kullanılan yerel modele göre önemli ölçüde değişir - bazı modern yerel modeller bulut sağlayıcılarıyla eşleşebilir veya aşabilir.

Sağlayıcı Yapılandırma İpuçları

Tüm Bulut Sağlayıcıları İçin:

- API anahtarlarını güvenli bir şekilde saklayın ve sürüm kontrolüne eklemeyin

- Tutarlı çeviriler için muhafazakar sıcaklık ayarlarıyla başlayın (0.3)

- API kullanımınızı ve maliyetlerinizi izleyin

- Büyük çeviri çalıştırmalarından önce küçük gruplarla test edin

Ollama İçin:

- Yeterli RAM olduğundan emin olun (daha büyük modeller için 8GB+ önerilir)

- Daha iyi model yükleme performansı için SSD depolama kullanın

- Daha hızlı çıkarım için GPU hızlandırmayı düşünün

- Üretim çevirileri için güvenmeden önce yerel olarak test edin