Çıkarım Parametreleri

LLM Inference Parameters yapısı modelin nasıl yüklendiğini ve metin oluşturduğunu kontrol eder. Bu parametreleri bir model yüklerken iletirsiniz. Bu sayfa her bir parametreyi ve etkisini açıklar.

Parametre Referansı

| Parametre | Tür | Varsayılan | Aralık | Açıklama |

|---|---|---|---|---|

| Maksimum Token | int32 | 512 | 1–8192 | Tek bir yanıtta oluşturulacak maksimum token sayısı |

| Sıcaklık | float | 0.7 | 0.0–2.0 | Rastgeleliği kontrol eder. 0.0 = deterministik. Daha yüksek değerler = daha yaratıcı çıktı |

| Üst P | float | 0.9 | 0.0–1.0 | Nucleus örnekleme. Yalnızca kümülatif olasılığı bu değeri aşan tokenlar dikkate alınır |

| Üst K | int32 | 40 | 0–200 | Seçimi en olası ilk K tokene sınırlar. 0 = devre dışı |

| Tekrar Cezası | float | 1.1 | 0.0–3.0 | Çıktıda zaten görünen tokenları cezalandırır. 1.0 = ceza yok |

| GPU Katman Sayısı | int32 | -1 | -1–200 | GPU'ya yüklenecek model katmanları. -1 = otomatik. 0 = yalnızca CPU |

| Bağlam Boyutu | int32 | 2048 | 128–131072 | Token cinsinden maksimum bağlam penceresi. Daha büyük değerler daha fazla bellek kullanır |

| Sistem Komutu | FString | "You are a helpful assistant." | — | Modelin davranışını şekillendiren sistem talimatı |

| Tohum | int32 | -1 | -1+ | Tekrarlanabilir çıktı için rastgele tohum. -1 = rastgele |

| İş Parçacığı Sayısı | int32 | 0 | 0–128 | Üretim için CPU iş parçacıkları. 0 = otomatik |

Kullanım

- Blueprint

- C++

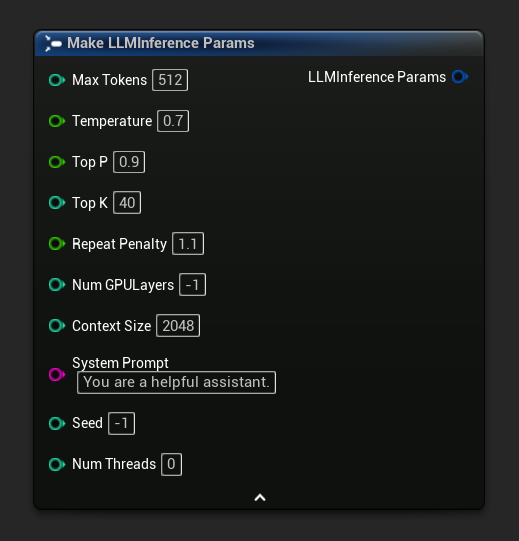

Çıkarım parametreleri, yükleme ve asenkron düğümlerinde bir yapı pini olarak görünür. Tek tek değerleri ayarlamak için yapıyı kırın:

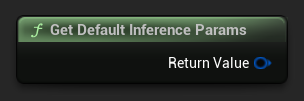

Başlangıç noktası olarak varsayılan bir parametre seti elde etmek için Get Default Inference Params kullanın:

// Creative writing

FLLMInferenceParams CreativeParams;

CreativeParams.MaxTokens = 1024;

CreativeParams.Temperature = 1.2f;

CreativeParams.TopP = 0.95f;

CreativeParams.TopK = 80;

CreativeParams.RepeatPenalty = 1.2f;

CreativeParams.SystemPrompt = TEXT("You are a creative storyteller.");

// Factual / deterministic

FLLMInferenceParams FactualParams;

FactualParams.MaxTokens = 256;

FactualParams.Temperature = 0.1f;

FactualParams.TopP = 0.5f;

FactualParams.TopK = 10;

FactualParams.SystemPrompt = TEXT("Answer questions concisely and accurately.");

// Mobile-optimized

FLLMInferenceParams MobileParams;

MobileParams.MaxTokens = 128;

MobileParams.ContextSize = 1024;

MobileParams.NumGPULayers = 0;

MobileParams.NumThreads = 4;

MobileParams.SystemPrompt = TEXT("You are a helpful assistant. Keep responses brief.");

// Get defaults programmatically

FLLMInferenceParams DefaultParams = URuntimeLocalLLM::GetDefaultInferenceParams();

Platform Önerileri

Mobil / VR (Android, iOS, Meta Quest)

- Bağlam Boyutu: 1024–2048

- GPU Katmanı Sayısı: 0 (yalnızca CPU) cihazda GPU hesaplama desteği olduğu doğrulanmadıkça

- Maksimum Token: Duyarlı etkileşimler için 256'nın altında

- İş Parçacığı Sayısı: 2–4 cihaza bağlı olarak

Masaüstü (Windows, Mac, Linux)

- Bağlam Boyutu: 2048–8192 çoğu konuşma için

- GPU Katmanı Sayısı: -1 (otomatik) mevcut olduğunda GPU hızlandırmasından yararlanmak için

- İş Parçacığı Sayısı: 0 (otomatik)

- Maksimum Token: 512–2048 daha uzun yanıtlar için