Ses İşleme Kılavuzu

Bu kılavuz, dudak senkronizasyonu jeneratörlerinize ses verisi beslemek için farklı ses giriş yöntemlerini nasıl kuracağınızı kapsar. Devam etmeden önce Kurulum Kılavuzu'nu tamamladığınızdan emin olun.

Ses Girişi İşleme

Ses girişini işlemek için bir yöntem kurmanız gerekiyor. Ses kaynağınıza bağlı olarak bunu yapmanın birkaç yolu vardır.

- Mikrofon (Gerçek zamanlı)

- Mikrofon (Oynatma)

- Metinden Sese (Yerel)

- Metinden Sese (Harici API'ler)

- Ses Dosyası/Arabelleğinden

- Akış Ses Arabelleği

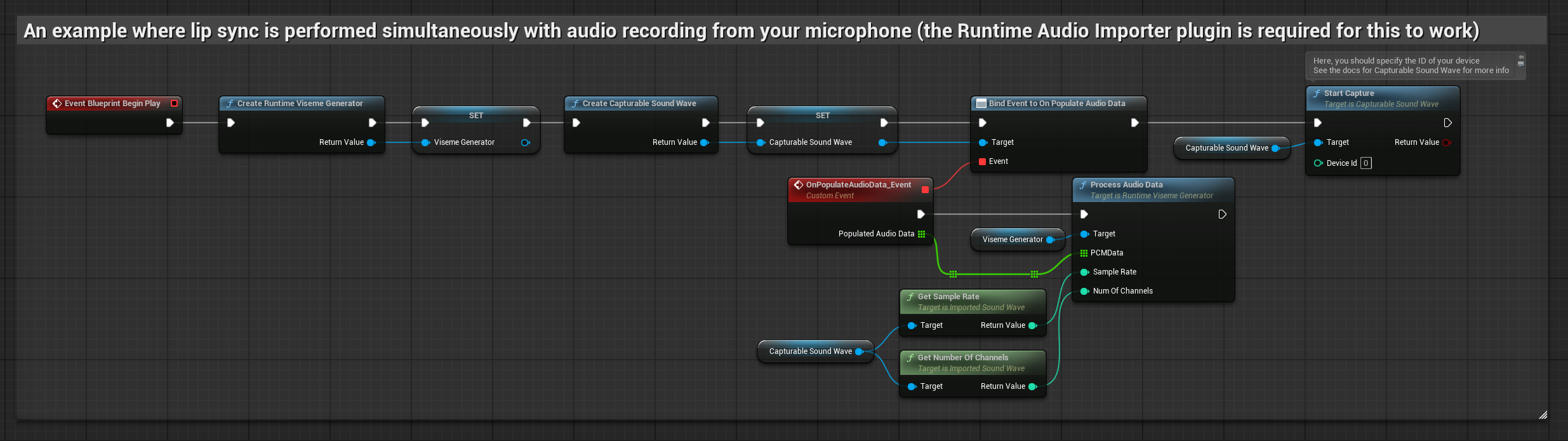

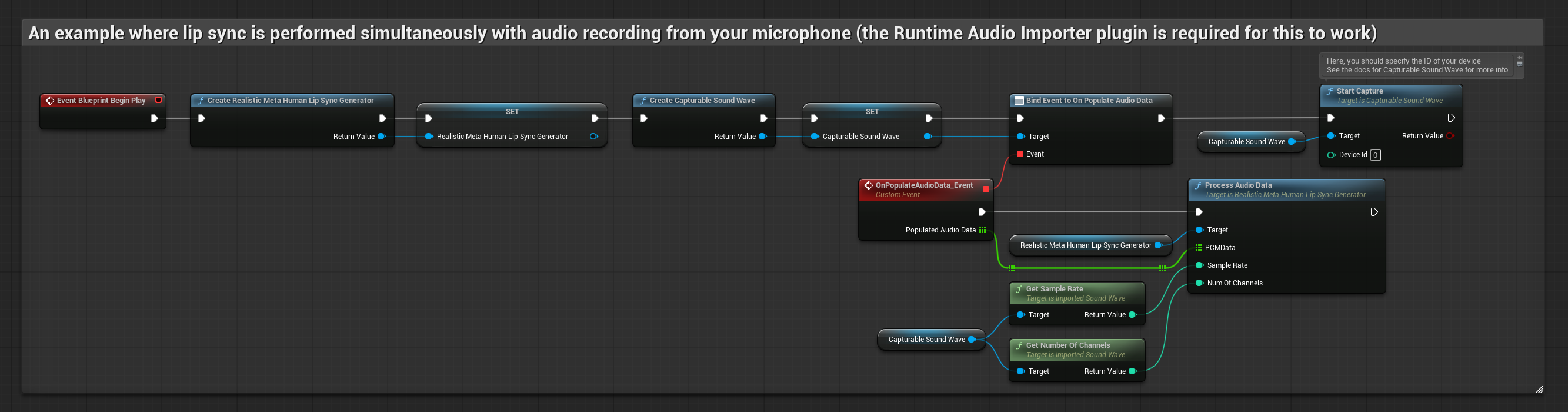

Bu yaklaşım, mikrofonla konuşurken dudak senkronizasyonunu gerçek zamanlı olarak gerçekleştirir:

- Standart Model

- Gerçekçi Model

- Ruh Hali Etkin Gerçekçi Model

- Runtime Audio Importer kullanarak bir Capturable Sound Wave oluşturun

- Pixel Streaming ile Linux için, bunun yerine Pixel Streaming Capturable Sound Wave kullanın

- Ses yakalamaya başlamadan önce,

OnPopulateAudioDatadelegesine bağlanın - Bağlanan fonksiyonda, Runtime Viseme Generator'ınızdan

ProcessAudioData'yı çağırın - Mikrofondan ses yakalamaya başlayın

Gerçekçi Model, Standart Model ile aynı ses işleme iş akışını kullanır, ancak VisemeGenerator yerine RealisticLipSyncGenerator değişkeni ile.

Ruh Hali Etkin Model, aynı ses işleme iş akışını kullanır, ancak MoodMetaHumanLipSyncGenerator değişkeni ve ek ruh hali yapılandırma yetenekleri ile.

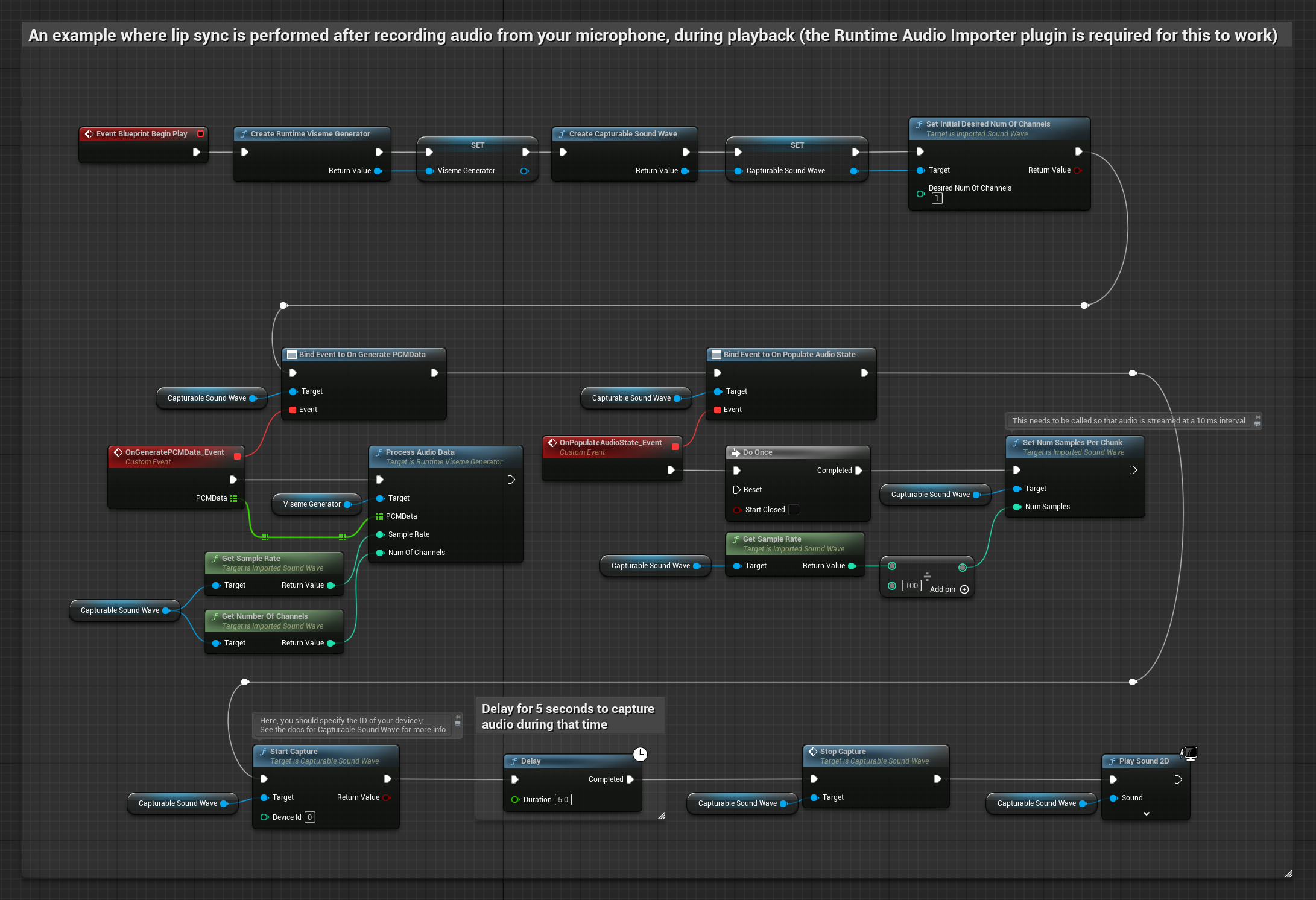

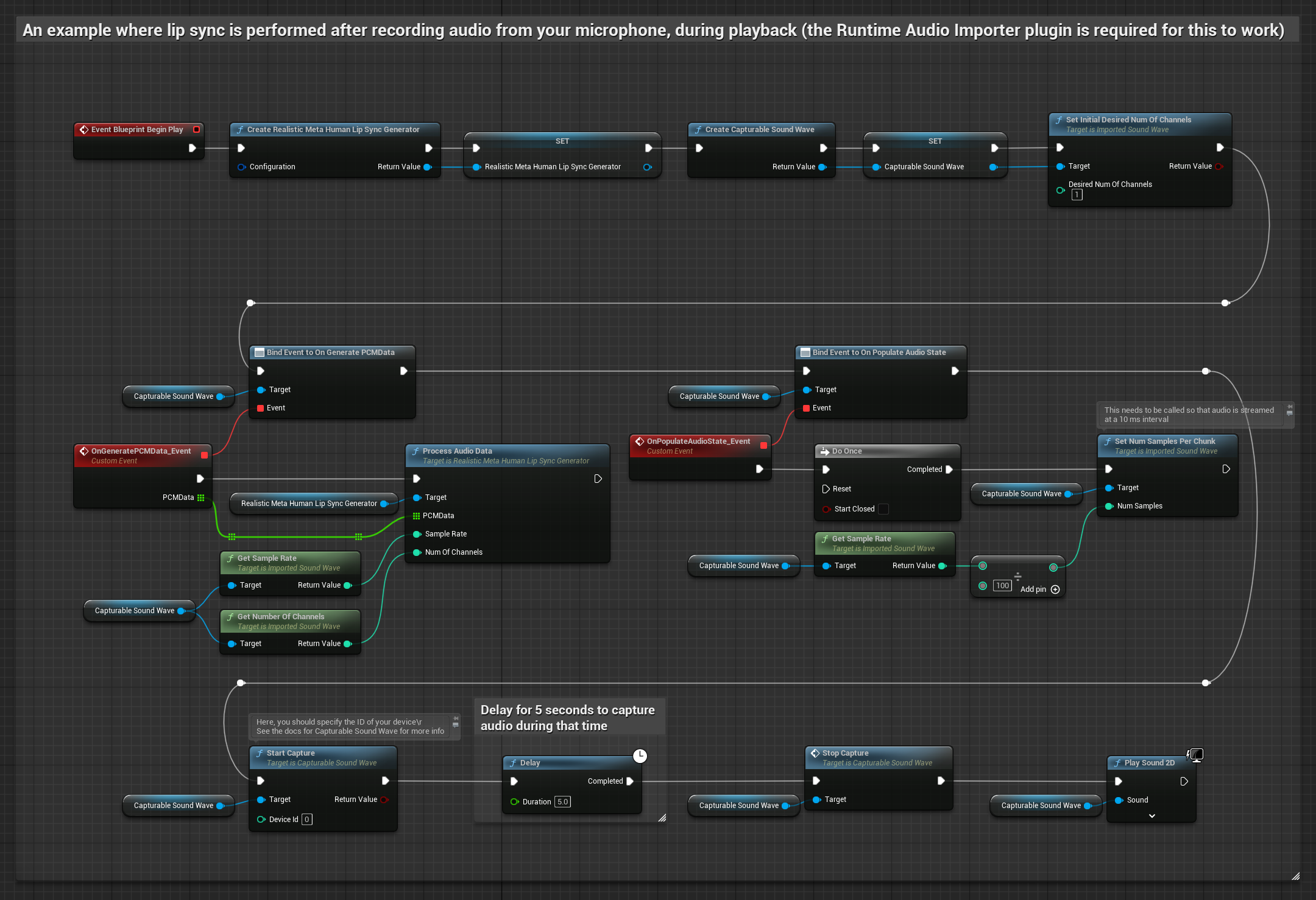

Bu yaklaşım, bir mikrofondan ses yakalar, ardından dudak senkronizasyonu ile oynatır:

- Standart Model

- Gerçekçi Model

- Ruh Hali Etkin Gerçekçi Model

- Runtime Audio Importer kullanarak bir Capturable Sound Wave oluşturun

- Pixel Streaming ile Linux için, bunun yerine Pixel Streaming Capturable Sound Wave kullanın

- Mikrofondan ses yakalamaya başlayın

- Yakalanabilir ses dalgasını oynatmadan önce,

OnGeneratePCMDatadelegesine bağlanın - Bağlanan fonksiyonda, Runtime Viseme Generator'ınızdan

ProcessAudioData'yı çağırın

Gerçekçi Model, Standart Model ile aynı ses işleme iş akışını kullanır, ancak VisemeGenerator yerine RealisticLipSyncGenerator değişkeni ile.

Ruh Hali Etkin Model, aynı ses işleme iş akışını kullanır, ancak MoodMetaHumanLipSyncGenerator değişkeni ve ek ruh hali yapılandırma yetenekleri ile.

- Düzenli

- Akış

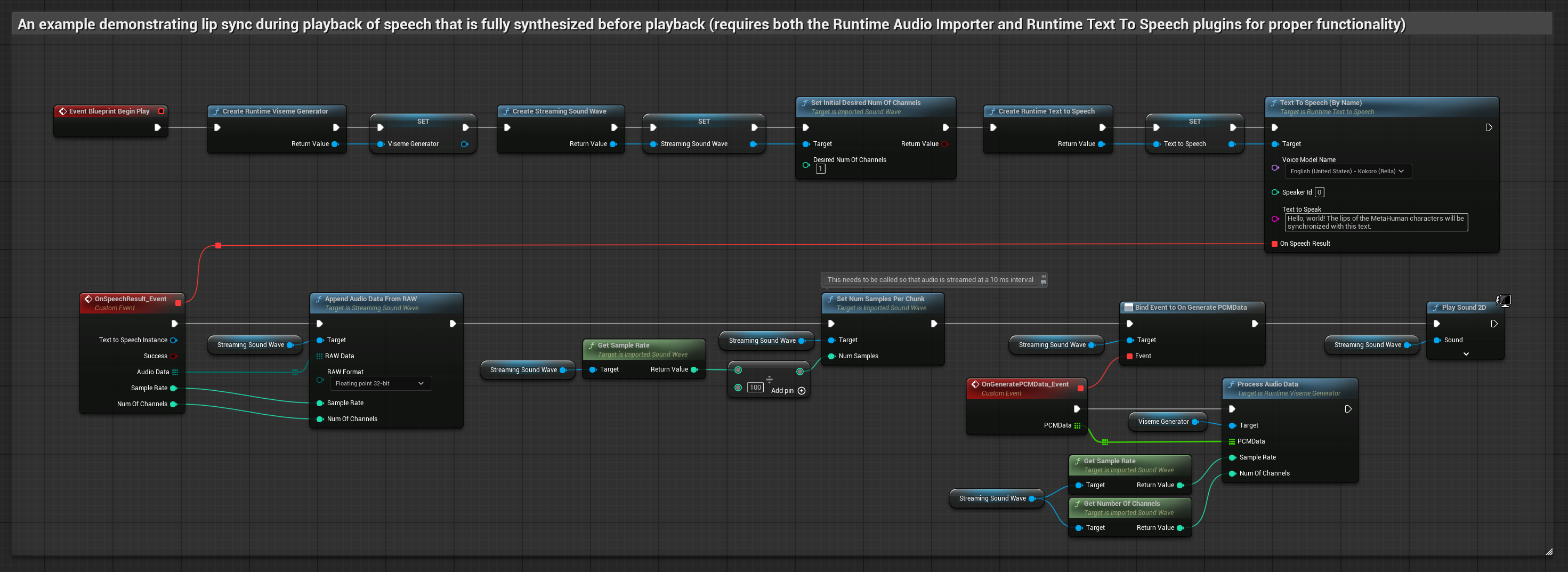

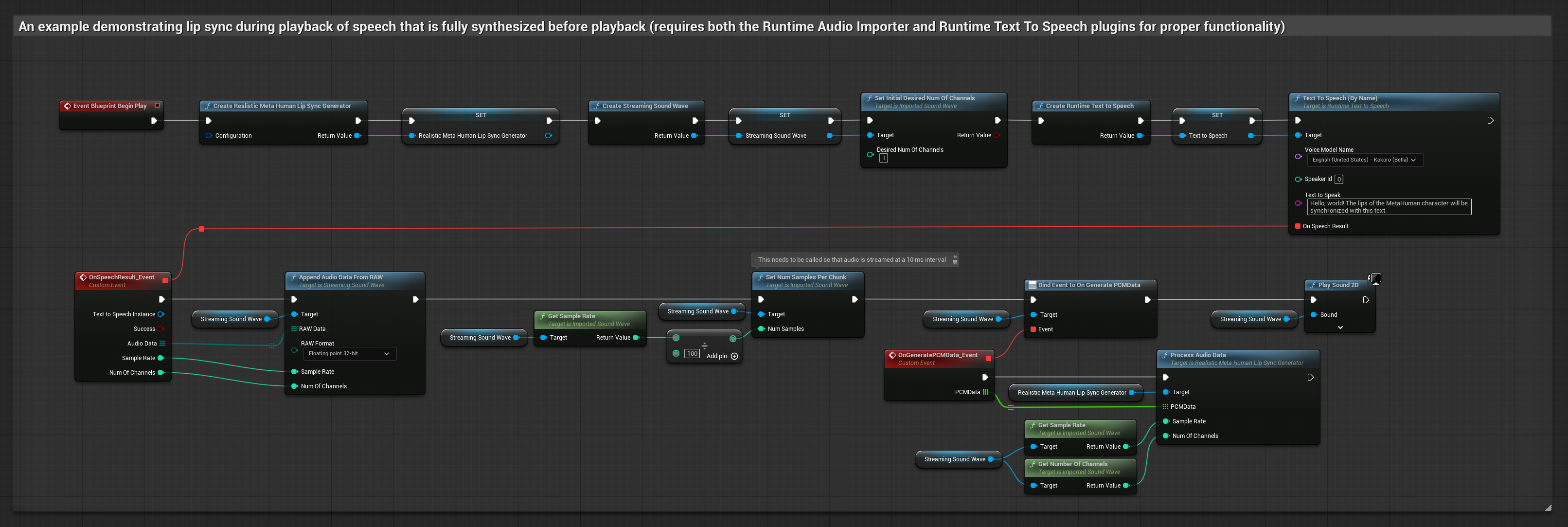

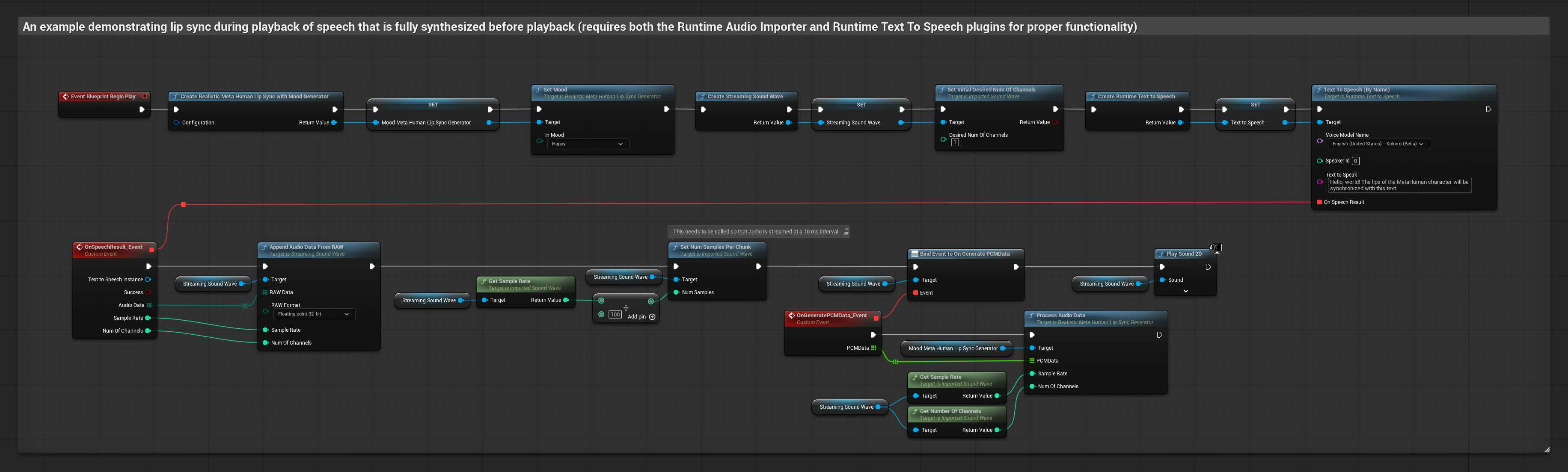

Bu yaklaşım, yerel TTS kullanarak metinden konuşma sentezler ve dudak senkronizasyonu gerçekleştirir:

- Standart Model

- Gerçekçi Model

- Ruh Hali Etkin Gerçekçi Model

- Metinden konuşma oluşturmak için Runtime Text To Speech kullanın

- Sentezlenen sesi içe aktarmak için Runtime Audio Importer kullanın

- İçe aktarılan ses dalgasını oynatmadan önce,

OnGeneratePCMDatadelegesine bağlanın - Bağlanan fonksiyonda, Runtime Viseme Generator'ınızdan

ProcessAudioData'yı çağırın

Gerçekçi Model, Standart Model ile aynı ses işleme iş akışını kullanır, ancak VisemeGenerator yerine RealisticLipSyncGenerator değişkeni ile.

Ruh Hali Etkin Model, aynı ses işleme iş akışını kullanır, ancak MoodMetaHumanLipSyncGenerator değişkeni ve ek ruh hali yapılandırma yetenekleri ile.

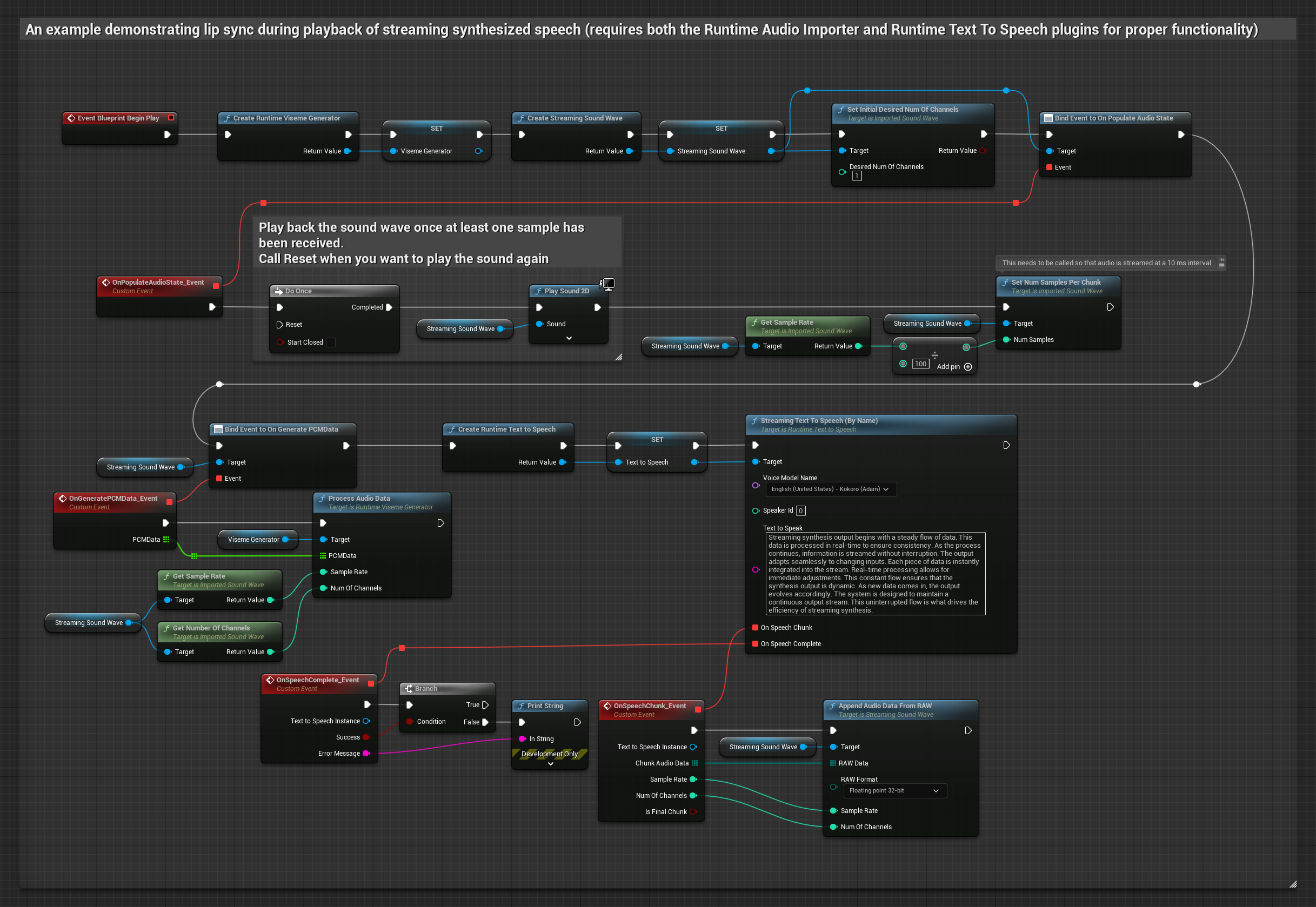

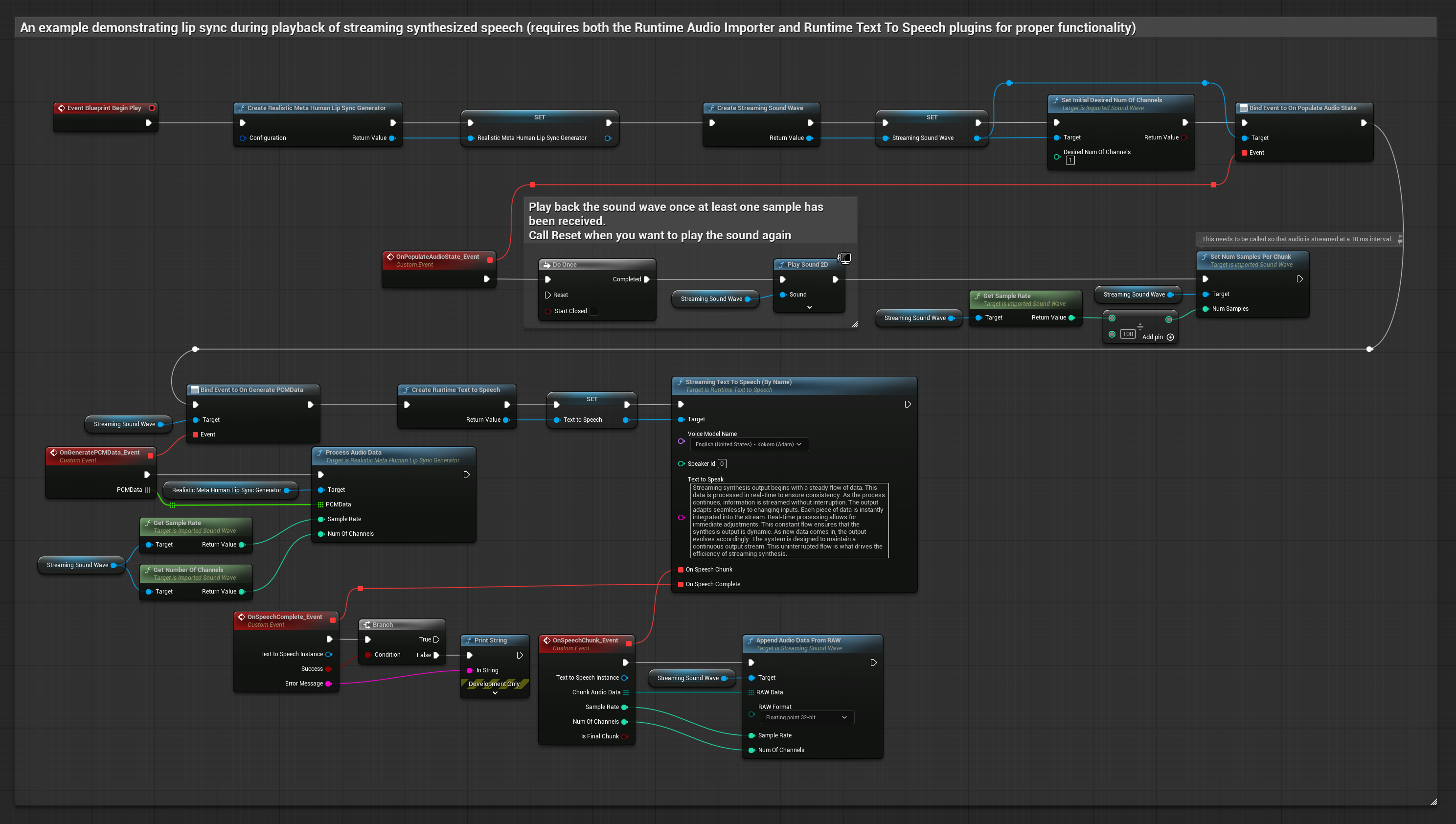

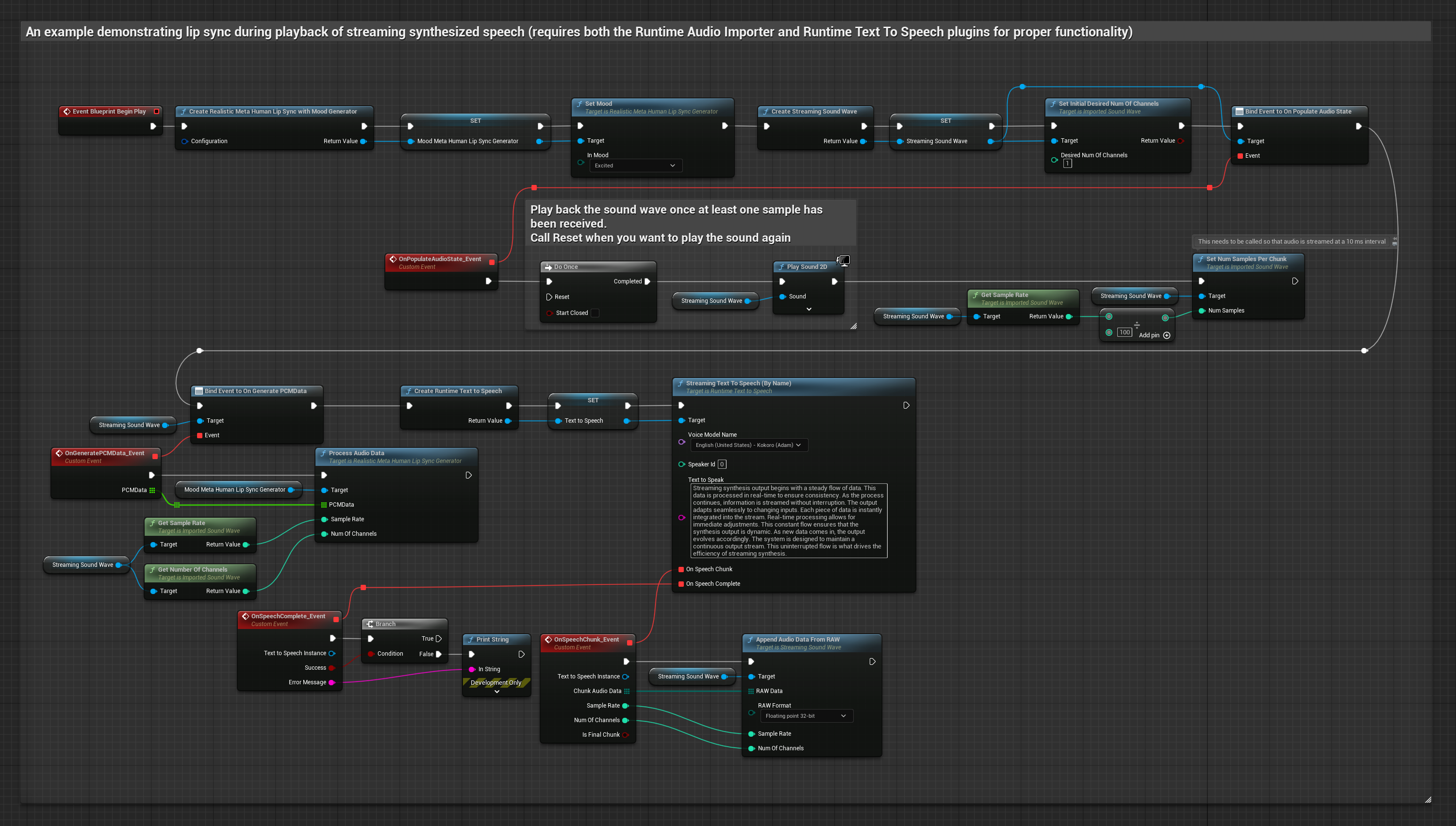

Bu yaklaşım, gerçek zamanlı dudak senkronizasyonu ile akış metinden sese sentezleme kullanır:

- Standart Model

- Gerçekçi Model

- Ruh Hali Etkin Gerçekçi Model

- Metinden akış konuşması oluşturmak için Runtime Text To Speech kullanın

- Sentezlenen sesi içe aktarmak için Runtime Audio Importer kullanın

- Akış ses dalgasını oynatmadan önce,

OnGeneratePCMDatadelegesine bağlanın - Bağlanan fonksiyonda, Runtime Viseme Generator'ınızdan

ProcessAudioData'yı çağırın

Gerçekçi Model, Standart Model ile aynı ses işleme iş akışını kullanır, ancak VisemeGenerator yerine RealisticLipSyncGenerator değişkeni ile.

Ruh Hali Etkin Model, aynı ses işleme iş akışını kullanır, ancak MoodMetaHumanLipSyncGenerator değişkeni ve ek ruh hali yapılandırma yetenekleri ile.

- Düzenli

- Akış

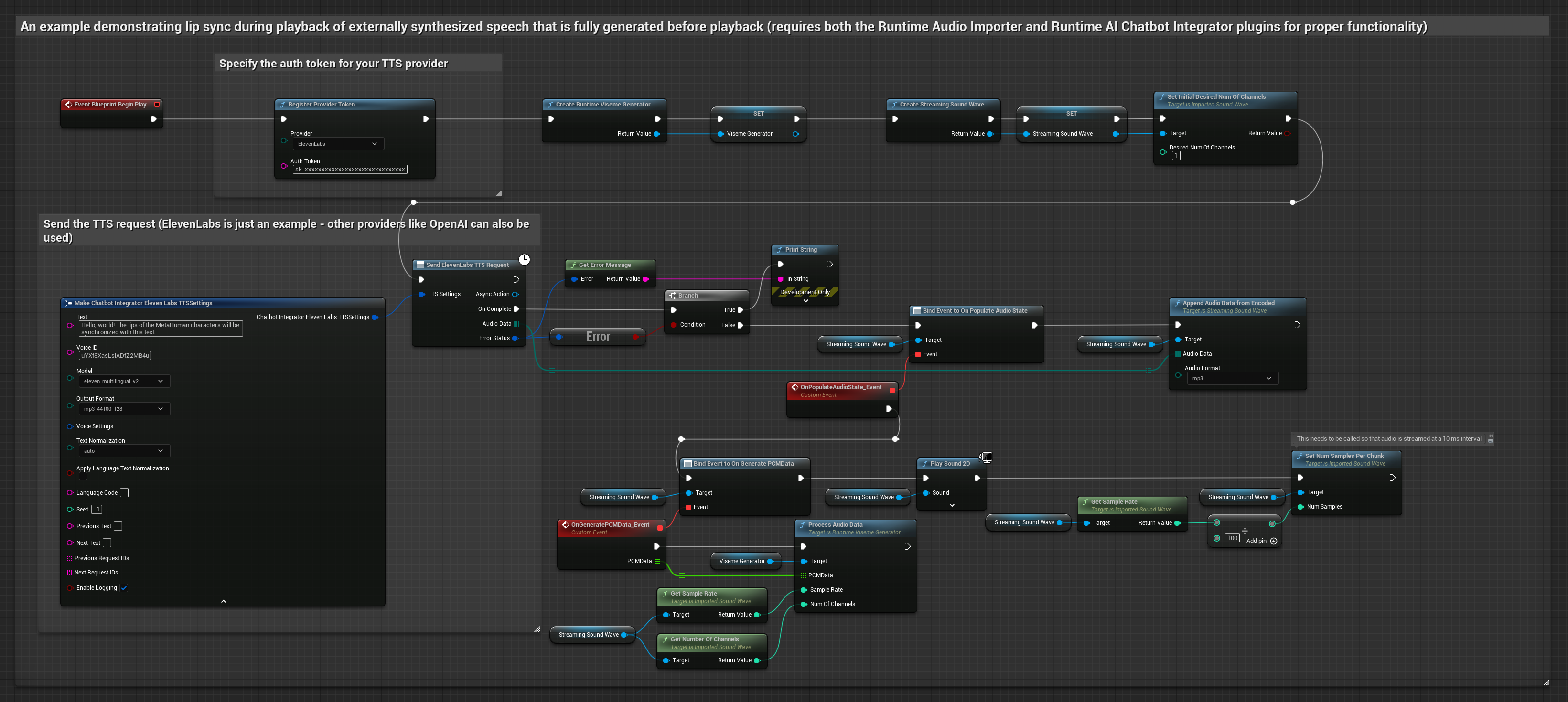

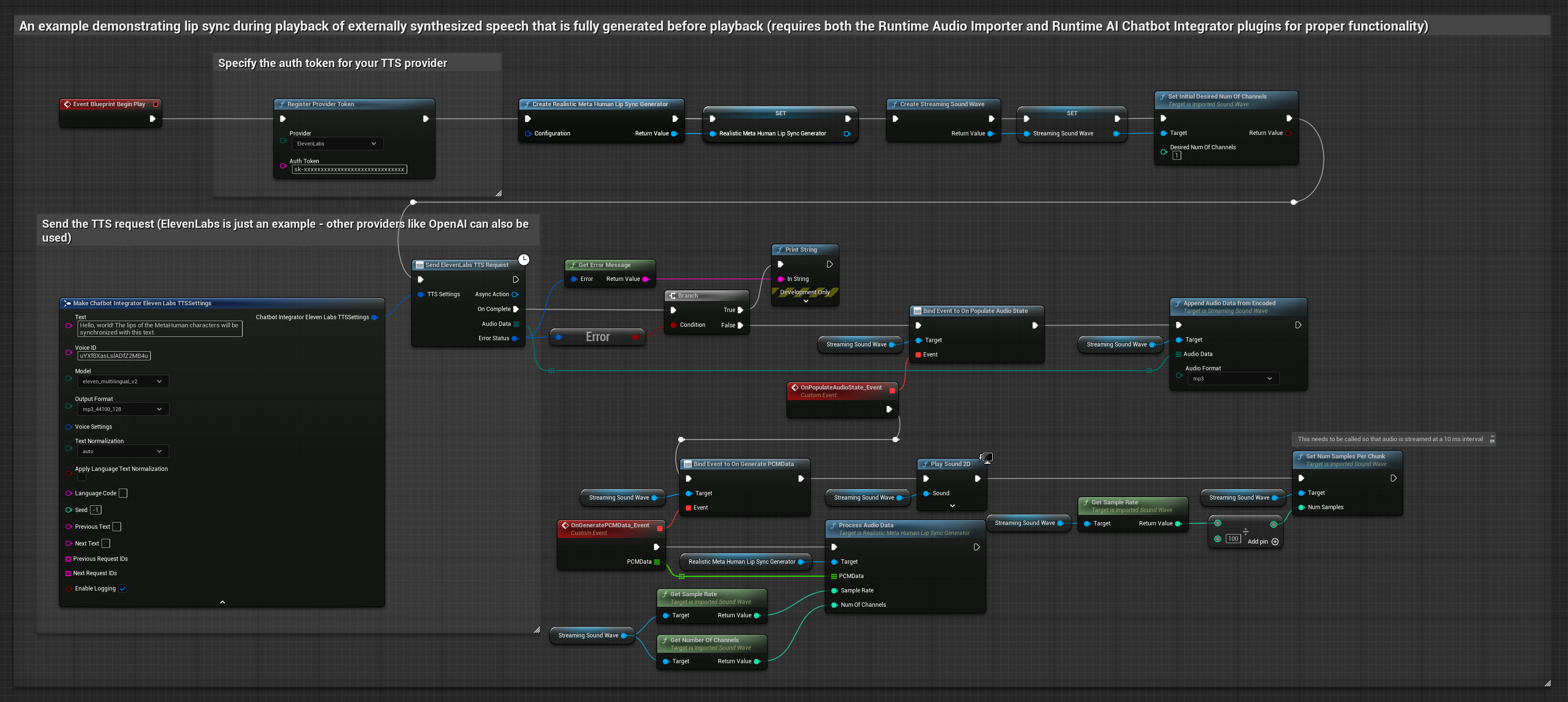

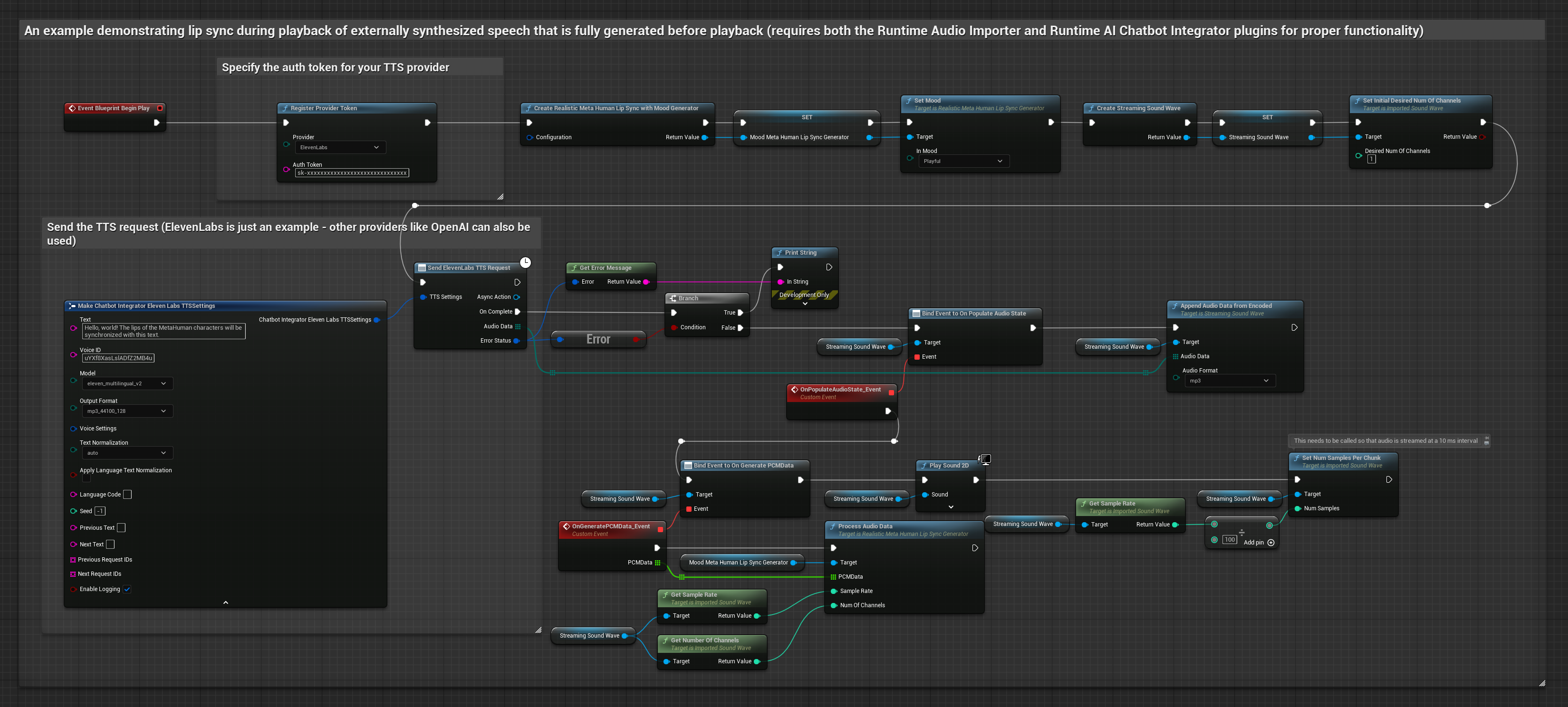

Bu yaklaşım, AI hizmetlerinden (OpenAI veya ElevenLabs) sentezlenen konuşma oluşturmak ve dudak senkronizasyonu gerçekleştirmek için Runtime AI Chatbot Integrator eklentisini kullanır:

- Standart Model

- Gerçekçi Model

- Ruh Hali Etkin Gerçekçi Model

- Harici API'ler (OpenAI, ElevenLabs, vb.) kullanarak metinden konuşma oluşturmak için Runtime AI Chatbot Integrator kullanın

- Sentezlenen ses verilerini içe aktarmak için Runtime Audio Importer kullanın

- İçe aktarılan ses dalgasını oynatmadan önce,

OnGeneratePCMDatadelegesine bağlanın - Bağlanan fonksiyonda, Runtime Viseme Generator'ınızdan

ProcessAudioData'yı çağırın

Gerçekçi Model, Standart Model ile aynı ses işleme iş akışını kullanır, ancak VisemeGenerator yerine RealisticLipSyncGenerator değişkeni ile.

Ruh Hali Etkin Model, aynı ses işleme iş akışını kullanır, ancak MoodMetaHumanLipSyncGenerator değişkeni ve ek ruh hali yapılandırma yetenekleri ile.

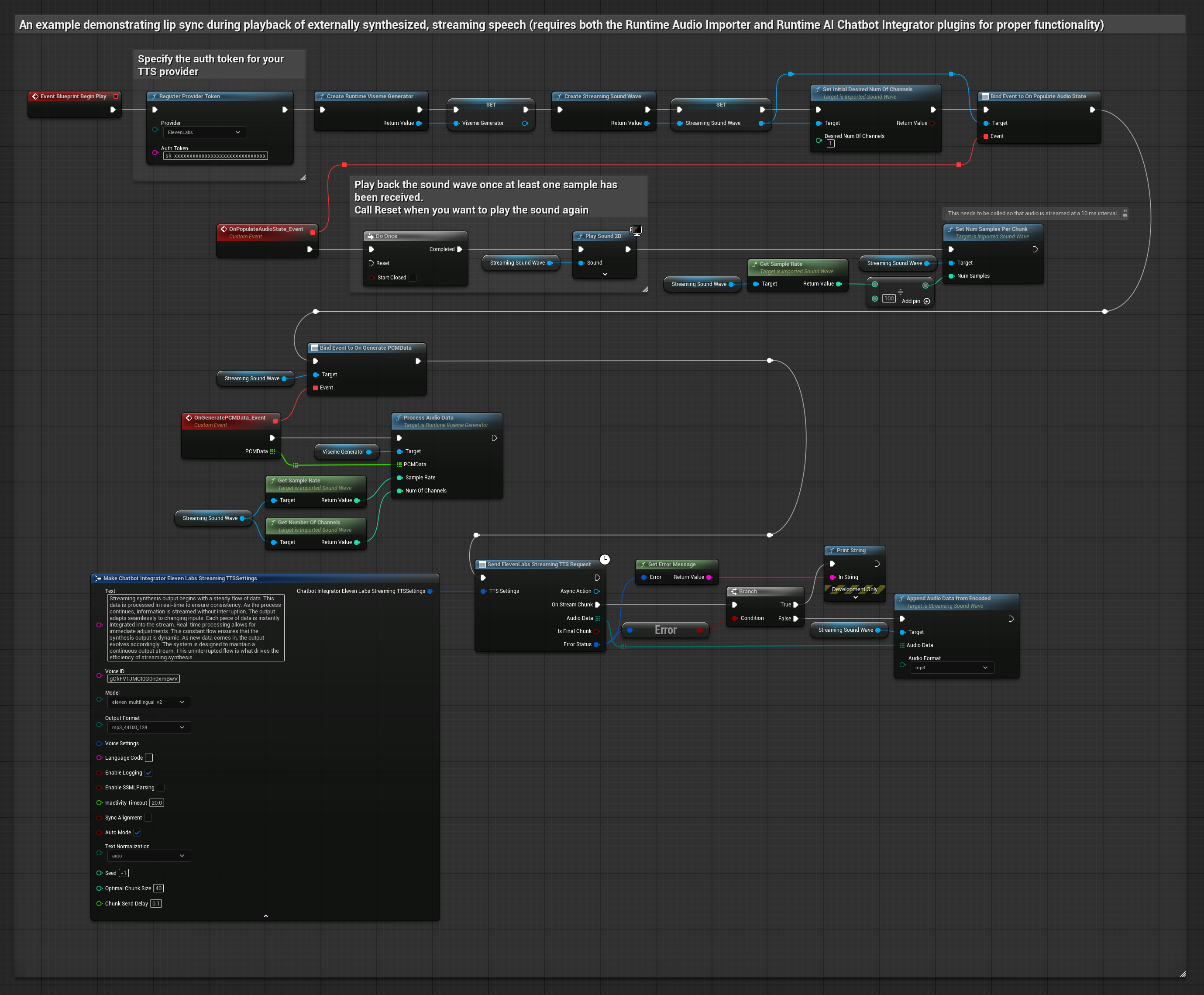

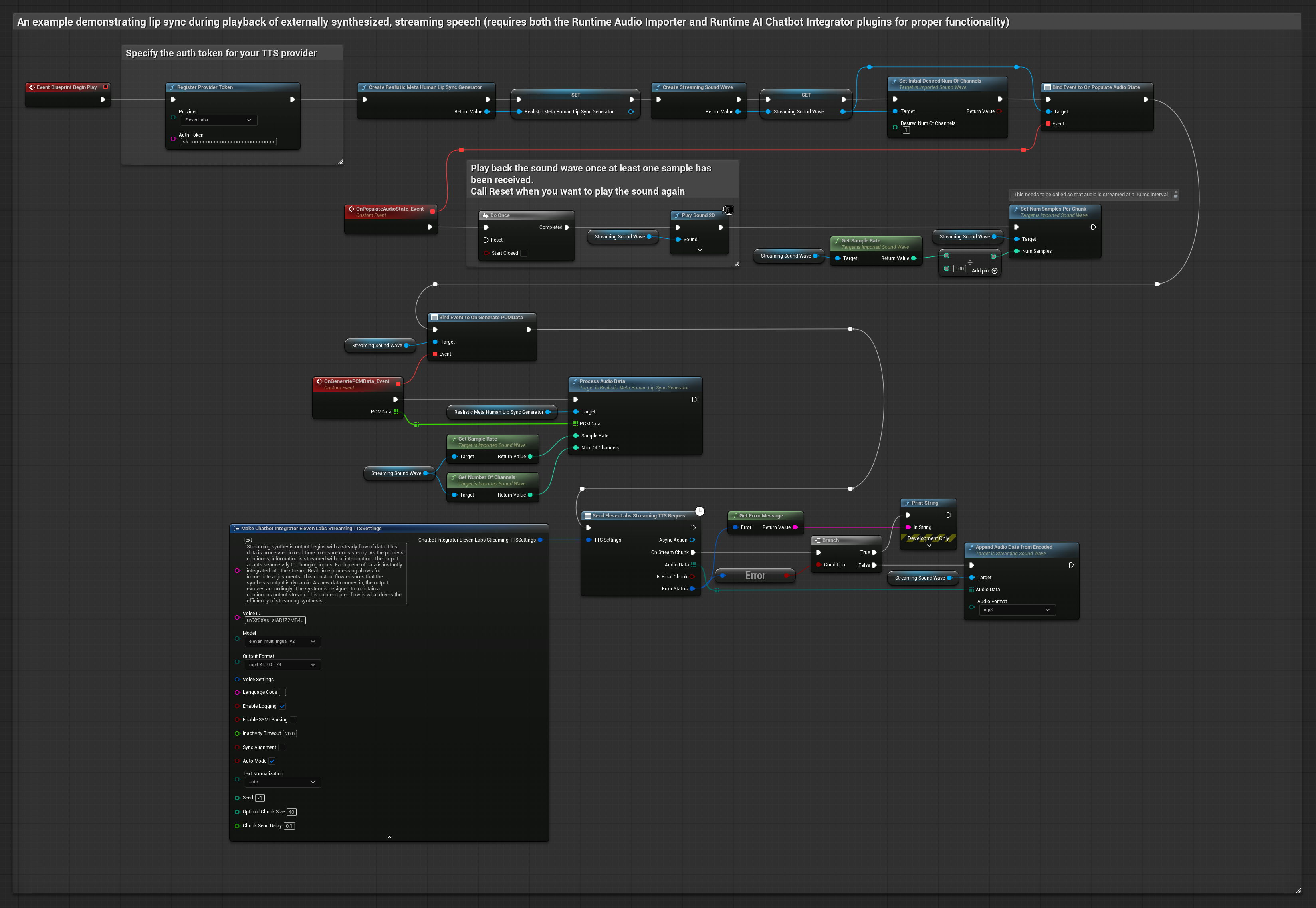

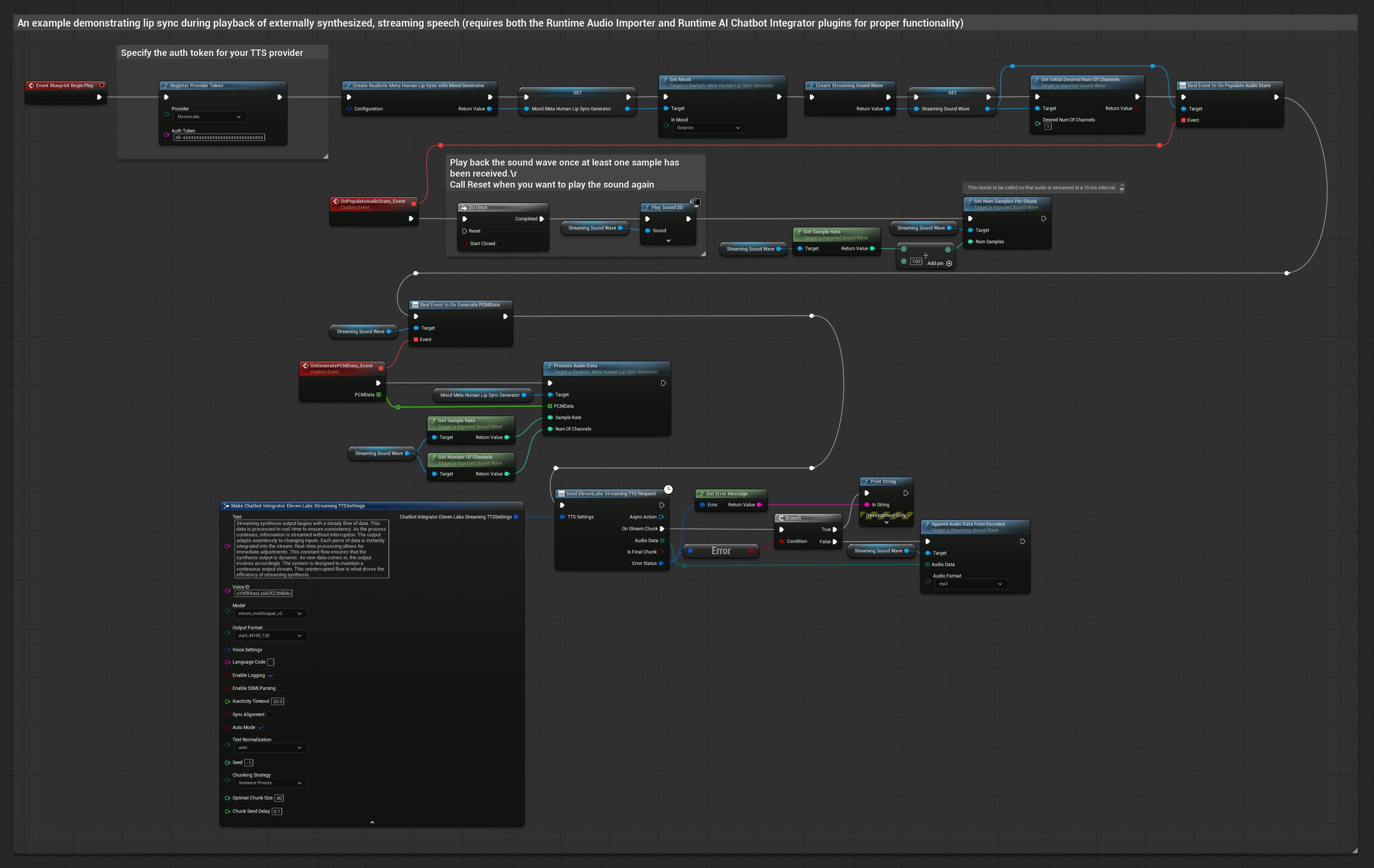

Bu yaklaşım, AI hizmetlerinden (OpenAI veya ElevenLabs) sentezlenen akış konuşması oluşturmak ve dudak senkronizasyonu gerçekleştirmek için Runtime AI Chatbot Integrator eklentisini kullanır:

- Standart Model

- Gerçekçi Model

- Ruh Hali Etkin Gerçekçi Model

- Akış TTS API'lerine (ElevenLabs Streaming API gibi) bağlanmak için Runtime AI Chatbot Integrator kullanın

- Sentezlenen ses verilerini içe aktarmak için Runtime Audio Importer kullanın

- Akış ses dalgasını oynatmadan önce,

OnGeneratePCMDatadelegesine bağlanın - Bağlanan fonksiyonda, Runtime Viseme Generator'ınızdan

ProcessAudioData'yı çağırın

Gerçekçi Model, Standart Model ile aynı ses işleme iş akışını kullanır, ancak VisemeGenerator yerine RealisticLipSyncGenerator değişkeni ile.

Ruh Hali Etkin Model, aynı ses işleme iş akışını kullanır, ancak MoodMetaHumanLipSyncGenerator değişkeni ve ek ruh hali yapılandırma yetenekleri ile.

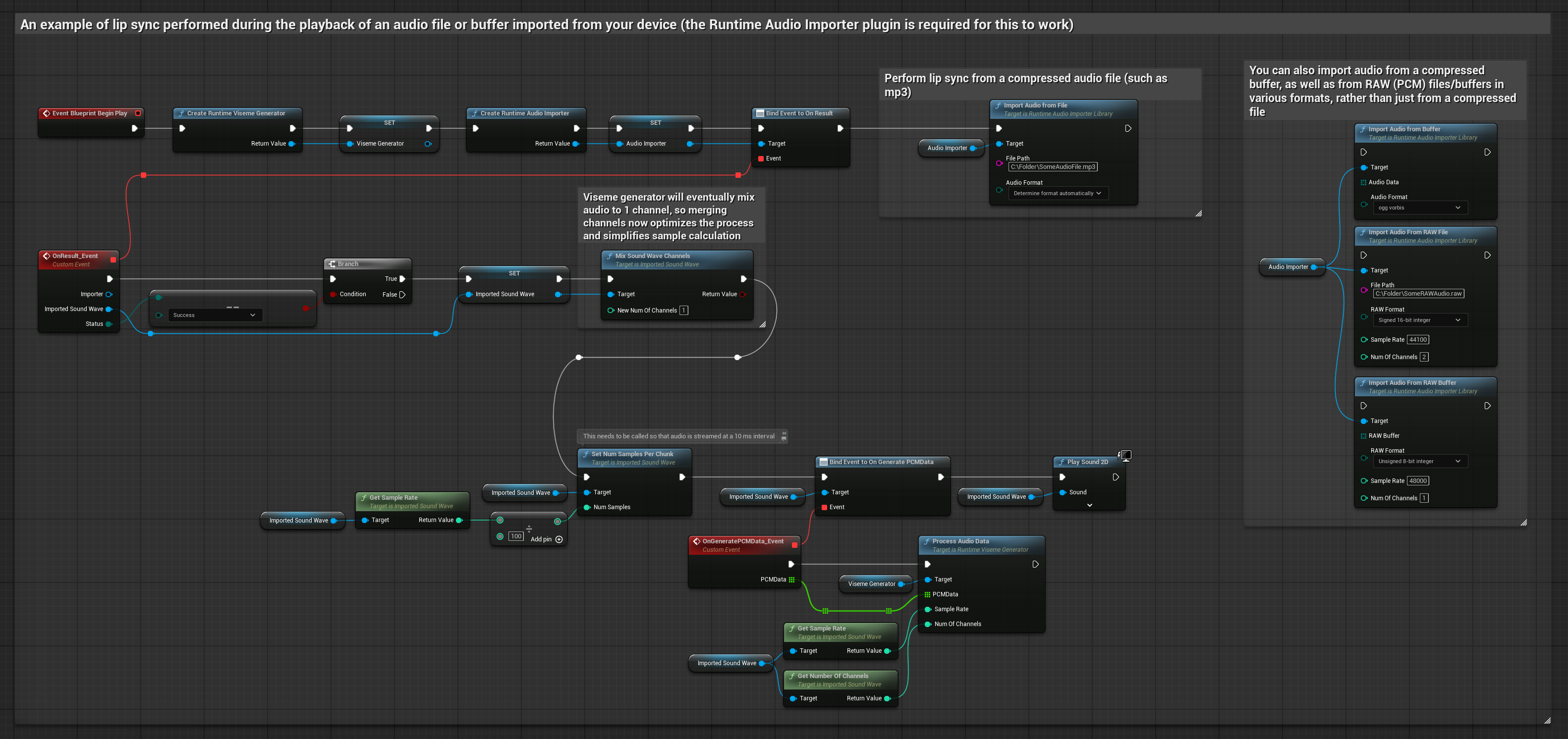

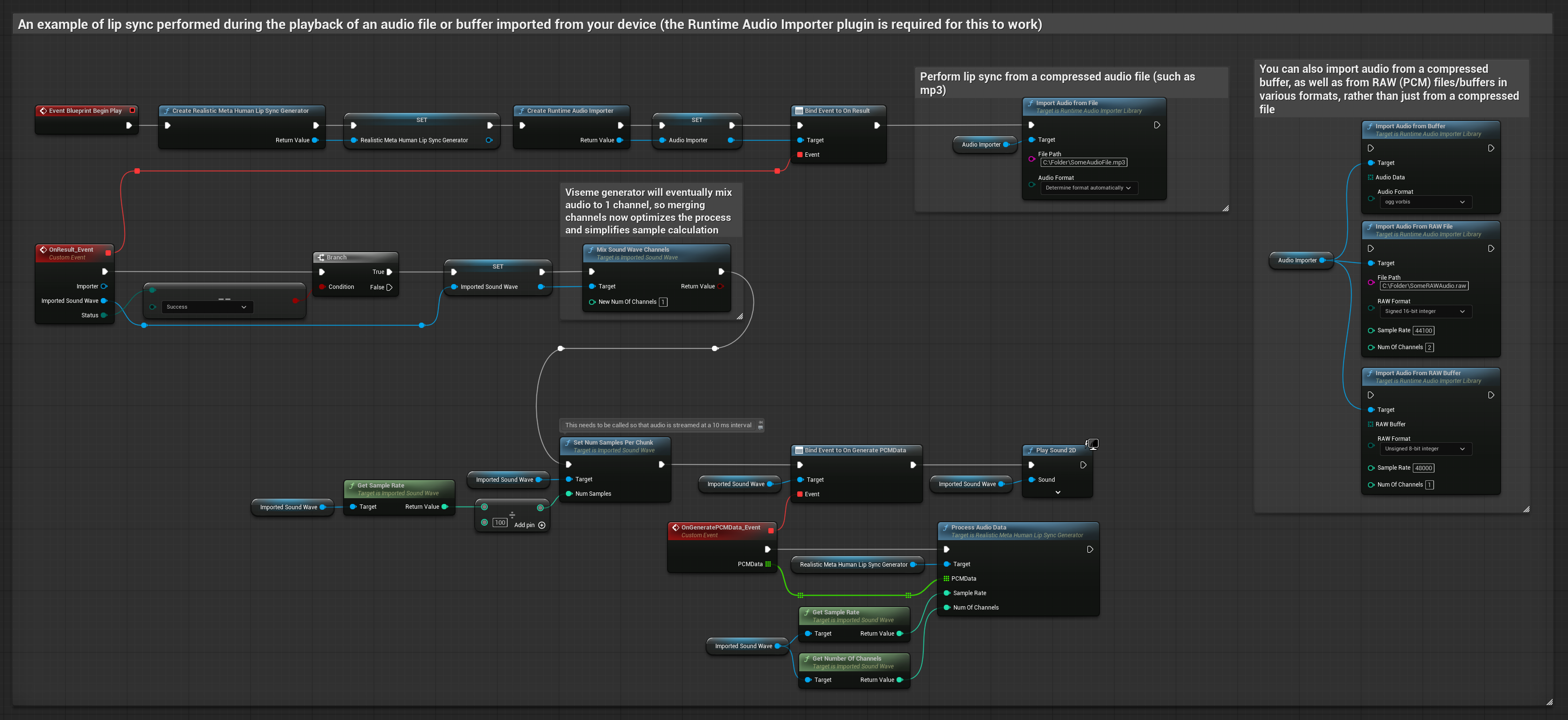

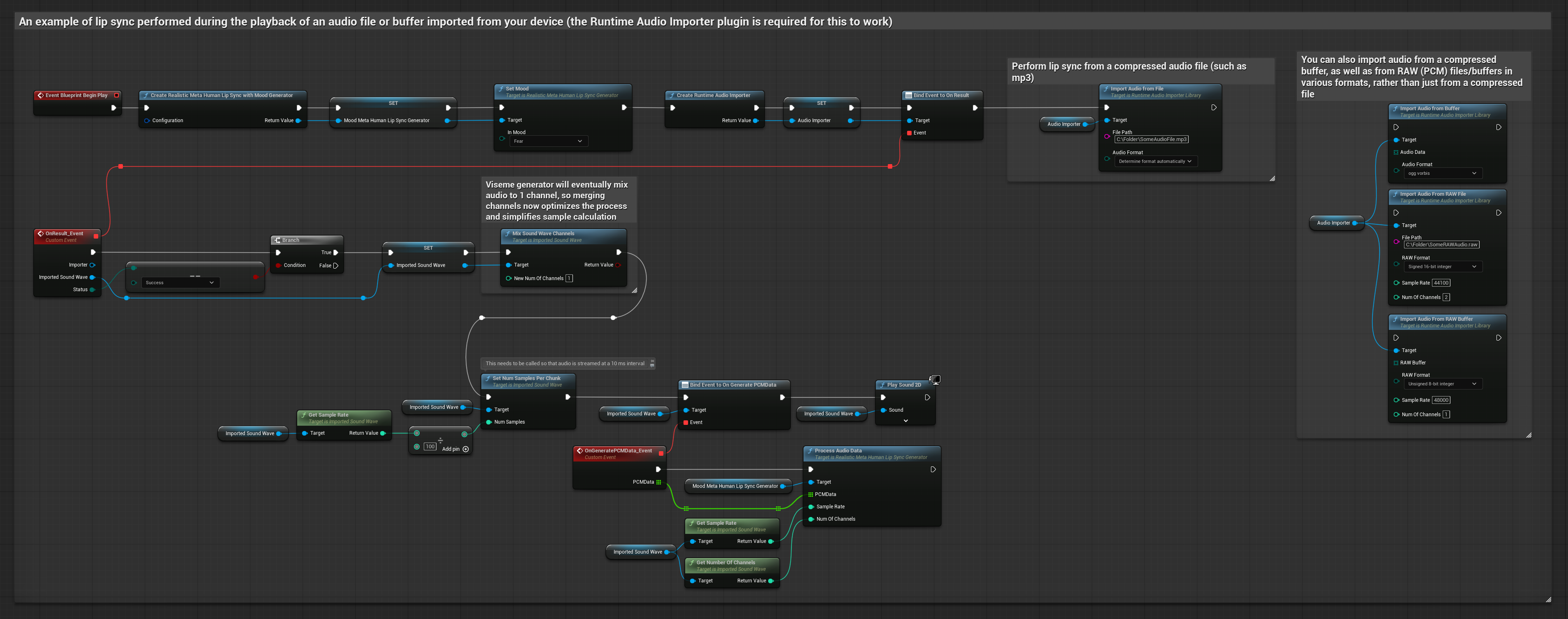

Bu yaklaşım, dudak senkronizasyonu için önceden kaydedilmiş ses dosyalarını veya ses arabelleklerini kullanır:

- Standart Model

- Gerçekçi Model

- Ruh Hali Etkin Gerçekçi Model

- Diskten veya bellekten bir ses dosyasını içe aktarmak için Runtime Audio Importer kullanın

- İçe aktarılan ses dalgasını oynatmadan önce,

OnGeneratePCMDatadelegesine bağlanın - Bağlanan fonksiyonda, Runtime Viseme Generator'ınızdan

ProcessAudioData'yı çağırın - İçe aktarılan ses dalgasını oynatın ve dudak senkronizasyonu animasyonunu gözlemleyin

Gerçekçi Model, Standart Model ile aynı ses işleme iş akışını kullanır, ancak VisemeGenerator yerine RealisticLipSyncGenerator değişkeni ile.

Ruh Hali Etkin Model, aynı ses işleme iş akışını kullanır, ancak MoodMetaHumanLipSyncGenerator değişkeni ve ek ruh hali yapılandırma yetenekleri ile.

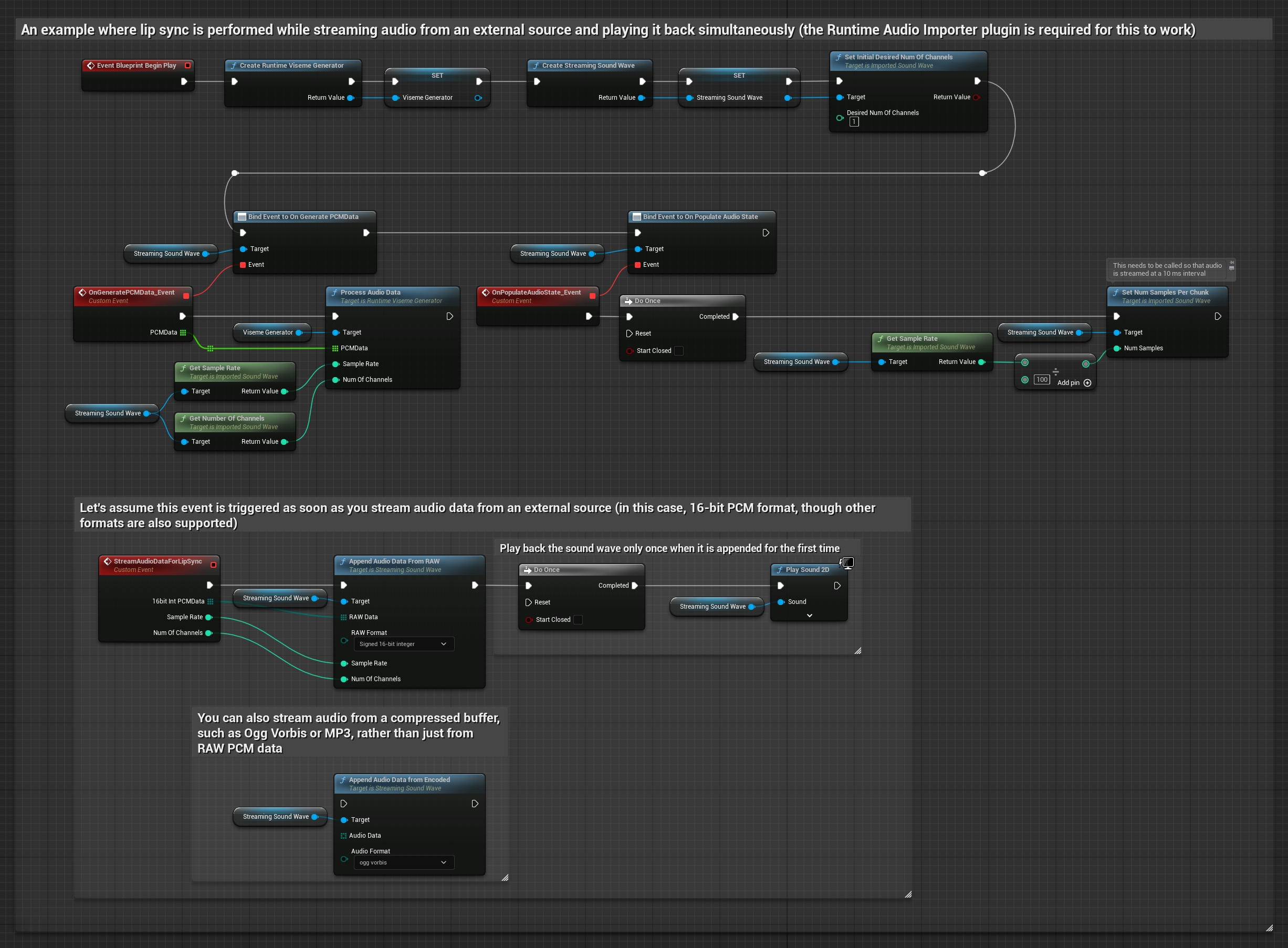

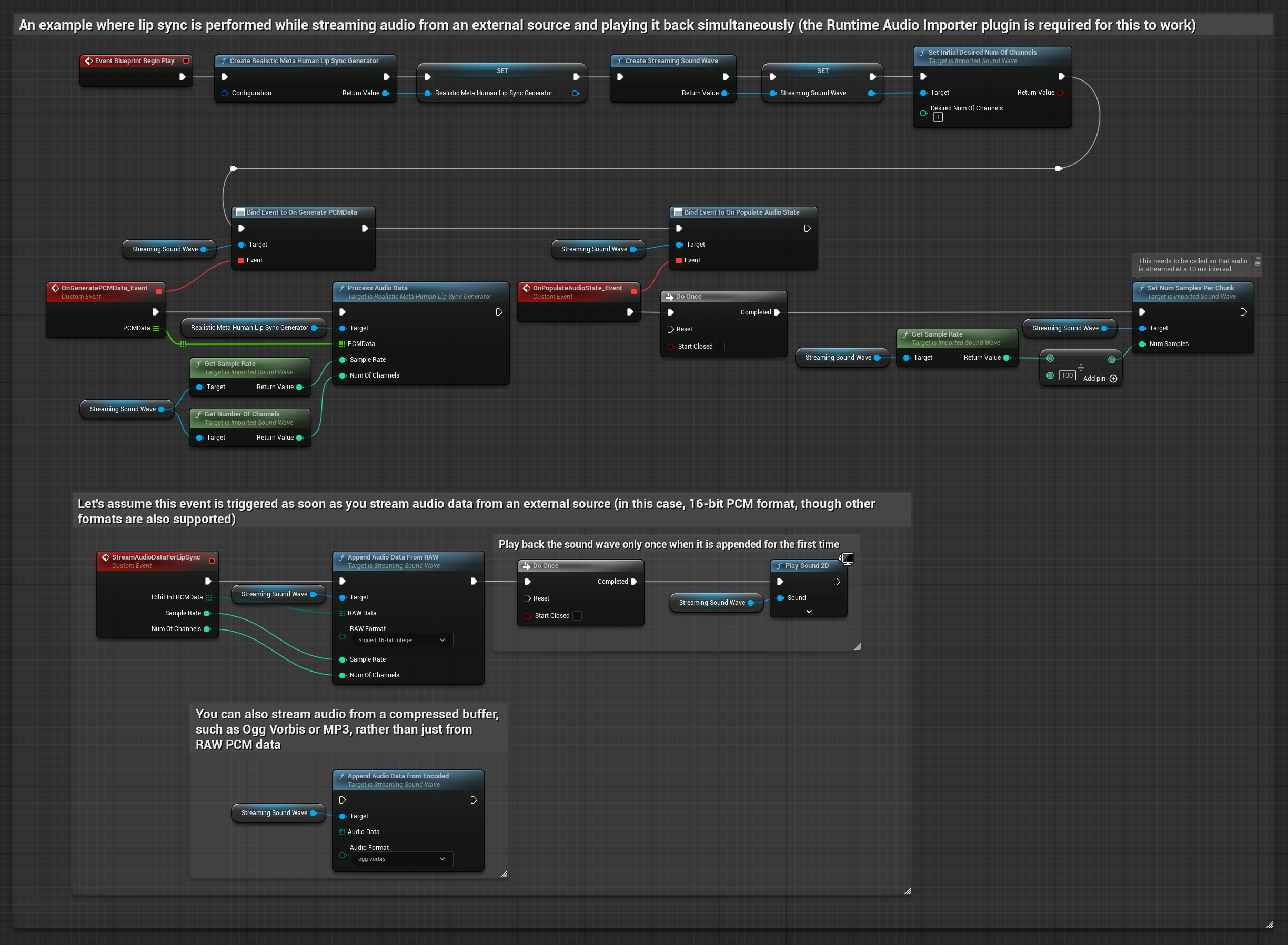

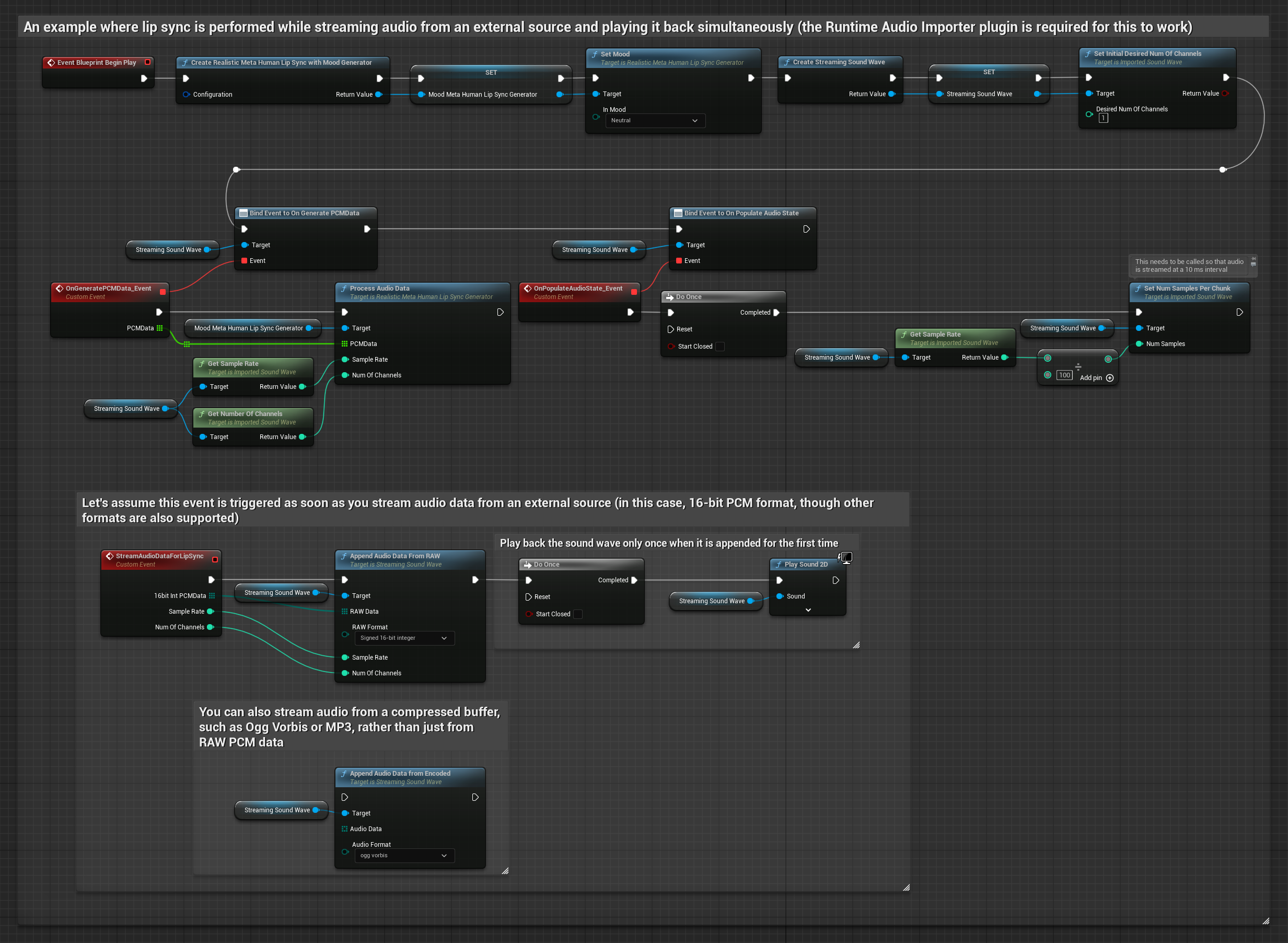

Bir arabellekten akış ses verisi için şunlara ihtiyacınız var:

- Standart Model

- Gerçekçi Model

- Ruh Hali Etkin Gerçekçi Model

- Akış kaynağınızdan kullanılabilir float PCM formatında ses verisi (kayan noktalı örneklerden oluşan bir dizi) (veya daha fazla formatı desteklemek için Runtime Audio Importer kullanın)

- Örnekleme hızı ve kanal sayısı

- Ses parçaları kullanılabilir oldukça, Runtime Viseme Generator'ınızdan

ProcessAudioData'yı bu parametrelerle çağırın

Gerçekçi Model, Standart Model ile aynı ses işleme iş akışını kullanır, ancak VisemeGenerator yerine RealisticLipSyncGenerator değişkeni ile.

Ruh Hali Etkin Model, aynı ses işleme iş akışını kullanır, ancak MoodMetaHumanLipSyncGenerator değişkeni ve ek ruh hali yapılandırma yetenekleri ile.

Not: Akış ses kaynakları kullanırken, bozuk oynatmayı önlemek için ses oynatma zamanlamasını uygun şekilde yönettiğinizden emin olun. Daha fazla bilgi için Streaming Sound Wave belgelerine bakın.

İşleme Performans İpuçları

-

Parça Boyutu:

ProcessingChunkSizeyapılandırma seçeneğini artırmak (örneğin 320, 480 veya 640 örneğe) kalite veya yanıt verme süresi üzerinde minimal etki ile gecikmeyi fark edilir şekilde iyileştirebilir. -

Model Türü: Gerçekçi modeller kullanırken, Yüksek Optimize Edilmiş model türüne geçmek (varsayılan olarak seçilidir) performansı artırabilir. Orijinal modelin, özellikle gürültülü seslerde biraz daha iyi kalite üretebileceğini unutmayın.

-

Arabellek Yönetimi: Ruh hali etkin model, sesi 320-örnek karelerde (16kHz'de 20ms) işler. Optimum performans için ses giriş zamanlamanızın buna uyumlu olduğundan emin olun.

-

Jeneratör Yeniden Oluşturma: Gerçekçi modellerle güvenilir çalışma için, bir süre hareketsizlikten sonra yeni ses verisi beslemek istediğinizde jeneratörü her seferinde yeniden oluşturun.

Sonraki Adımlar

Ses işlemeyi kurduktan sonra şunları yapmak isteyebilirsiniz:

- Dudak senkronizasyonu davranışınızı ince ayarlamak için Yapılandırma seçenekleri hakkında bilgi edinin

- Gelişmiş ifade için kahkaha animasyonu ekleyin

- Dudak senkronizasyonunu, Yapılandırma kılavuzunda açıklanan katmanlama tekniklerini kullanarak mevcut yüz animasyonlarıyla birleştirin