Demo Projeleri

Runtime MetaHuman Lip Sync ile hızlıca başlamanıza yardımcı olmak için, iki kullanıma hazır demo projesi bulunmaktadır. Her ikisi de Unreal Engine 5.6+ ile oluşturulmuş, Blueprint-only olarak geliştirilmiş ve Windows, Mac, Linux, iOS, Android ile Android tabanlı platformlarda ( Meta Quest dahil ) çapraz platformda çalışır.

Kullanılabilir Demo Projeleri

- AI Konuşmalı NPC / Etkileşimli Avatar

- Temel Dudak Senkronizasyonu Demosu

Konuşma tanıma, bir AI sohbet robotu (LLM), metin-ses sentezi ve gerçek zamanlı dudak senkronizasyonu ile ses oynatmayı birleştiren tam bir AI konuşmalı avatar iş akışı — hepsi tek bir projede birlikte çalışır. Oyunlar, etkileşimli kiosklar, sanal prodüksiyon, müze kurulumları, dijital asistanlar ve eğitim simülasyonları gibi geniş bir kullanım alanı yelpazesi için uygundur.

İş Akışına Genel Bakış

🎤 Microphone → Speech Recognition → 💬 LLM Chatbot → 🔊 Text-to-Speech → 👄 Lip Sync + Playback

Videolar

Hızlı Önizleme (~30 sn)

Demonun kısa bir gösterimi.

Tam İzlence

Kurulumu, yapılandırmayı ve tüm konuşma işlem hattını kapsayan ayrıntılı bir izlence.

İndirmeler

Gerekli ve İsteğe Bağlı Eklentiler

Demo projesi modülerdir - yalnızca kullanmak istediğiniz sağlayıcılar için eklentilere ihtiyacınız vardır.

| Eklenti | Amaç | Gerekli mi? |

|---|---|---|

| Runtime MetaHuman Lip Sync | Dudak senkronizasyonu animasyonu | ✅ Her Zaman |

| Runtime Audio Importer | Ses yakalama ve işleme | ✅ Her Zaman |

| Runtime Speech Recognizer | Çevrimdışı konuşma tanıma (whisper.cpp) | ✅ Her Zaman |

| Runtime AI Chatbot Integrator | Harici LLM'ler (OpenAI, Claude, DeepSeek, Gemini, Grok, Ollama) ve/veya Harici TTS (OpenAI, ElevenLabs) | 🔶 İsteğe Bağlı |

| Runtime Local LLM | llama.cpp aracılığıyla yerel LLM çıkarımı (Llama, Mistral, Gemma, vb., GGUF modelleri) | 🔶 İsteğe Bağlı |

| Runtime Text To Speech | Piper ve Kokoro aracılığıyla yerel TTS | 🔶 İsteğe Bağlı |

Yukarıdaki her eklenti kendi başına isteğe bağlı olsa da, demonun çalışması için en az bir LLM sağlayıcısına ve en az bir TTS sağlayıcısına ihtiyacınız var. İstediğiniz gibi birleştirin (ör. local LLM + ElevenLabs TTS veya OpenAI LLM + local TTS).

Modüler Mimari

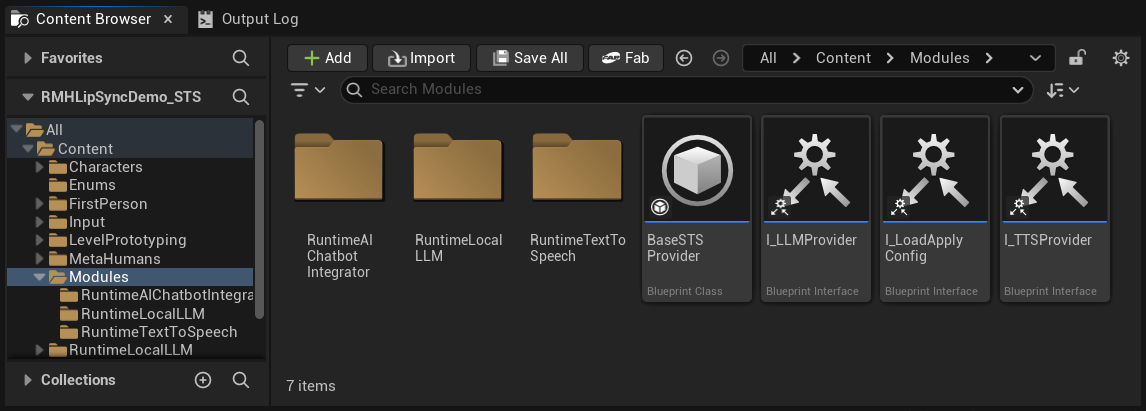

Content klasöründe, üç alt klasör içeren bir Modules klasörü bulacaksınız:

Content/

└── Modules/

├── RuntimeAIChatbotIntegrator/ ← External LLMs and/or external TTS

├── RuntimeLocalLLM/ ← Local LLM via llama.cpp

└── RuntimeTextToSpeech/ ← Local TTS via Piper/Kokoro

İsteğe bağlı eklentilerden birini (veya birkaçını) edinmediyseniz, ilgili klasör(ler)i silin. Demo projesinin temel varlıkları (oyun örneği, widget'lar vb.) bu modüllere doğrudan başvurmaz, bu yüzden bunları silmek varlık başvuru hatalarına neden olmaz. Yapılandırma arayüzü, klasörü eksik olan herhangi bir sağlayıcıyı otomatik olarak gizler.

Bu modülerlik yalnızca LLM ve TTS sağlayıcıları için geçerlidir. Konuşma Tanıma (Runtime Speech Recognizer) ve Dudak Senkronizasyonu (Runtime MetaHuman Lip Sync) temel demo projesinin bir parçasıdır ve her zaman gereklidir.

İlk başlatmada Unreal, eksik isteğe bağlı eklentileri devre dışı bırakmak isteyip istemediğinizi sorabilir - Evet'e tıklayın. İlgili Content/Modules/ klasörünü de sildiğinizden emin olun (yukarıya bakın).

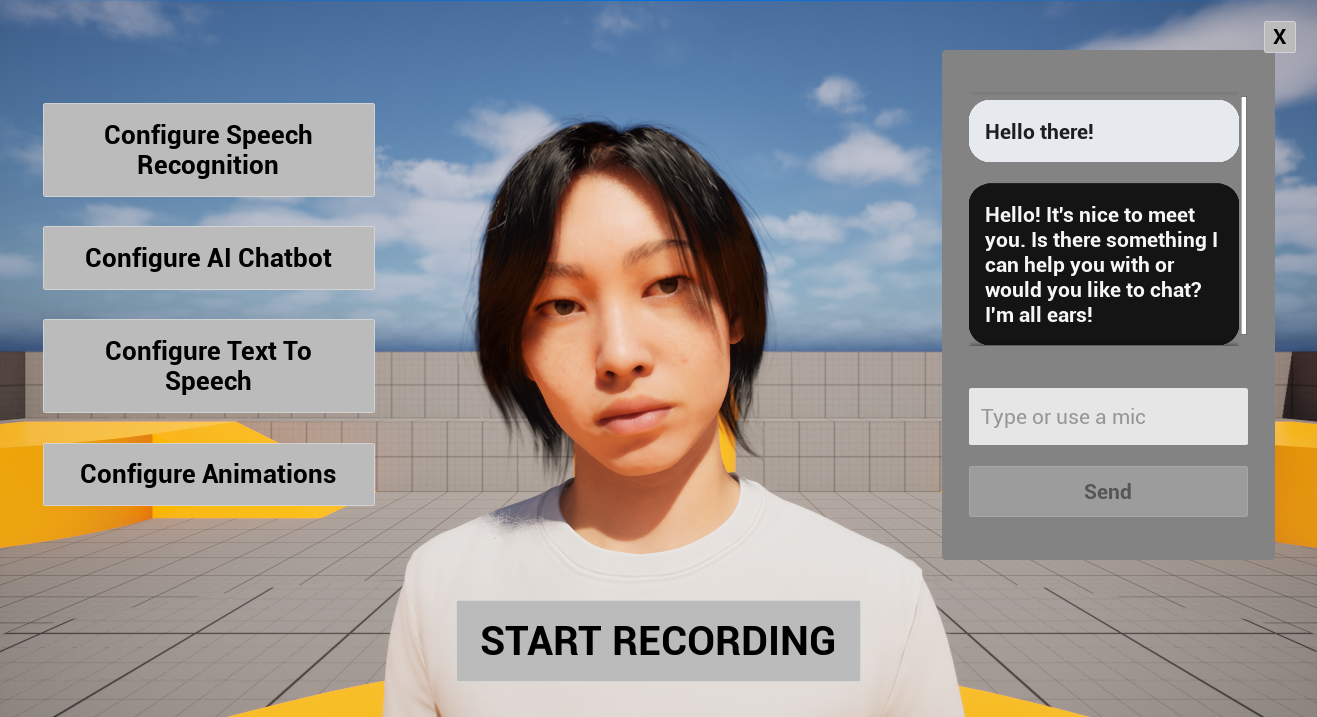

Demo Projesi Düzeni

Aşağıda gösterilen kullanıcı arayüzü tamamen UMG (Unreal Motion Graphics) ile oluşturulmuştur ve yalnızca işlem hattını göstermek içindir - konuşma tanıma → LLM → TTS → dudak senkronizasyonu. Projenizin görsel tasarımına, kontrol şemasına veya platformuna (VR/AR, mobil, konsol, kiosk vb.) uyacak şekilde yeniden biçimlendirmek veya değiştirmek serbestsiniz. Kullanım durumunuzda bazı widget'lara ihtiyaç duyulmuyorsa, onları basitçe gizleyebilirsiniz (ör. görünürlüklerini Daraltılmış veya Gizli olarak ayarlayarak).

| Alan | Ne var |

|---|---|

| Orta | MetaHuman karakteri. |

| Sol taraf | Dört yapılandırma düğmesi (Konuşma Tanıma, Yapay Zeka Sohbet Botu, Metinden Konuşmaya, Animasyonlar), aşağıda ayrıntılı olarak açıklanmıştır. |

| Orta alt | Bir Kaydı Başlat düğmesi. Bir sesli sohbet başlatmak için tıklayın: mikrofonunuz yakalanır, yazıya dökülür, LLM'ye gönderilir, yanıt TTS ile sentezlenir ve dudak senkronizasyonu ile oynatılır, tamamen eller serbest. |

| Sağ orta | Sizinle yapay zeka arasındaki tüm karşılıklı konuşmayı gösteren bir konuşma geçmişi widget'ı (hem kullanıcı hem de asistan mesajları). Ayrıca bir metin giriş alanı içerir, böylece konuşma tanıma kullanmadan doğrudan mesaj yazabilirsiniz; test etmek, erişilebilirlik veya bir mikrofon mevcut olmadığında kullanışlıdır. |

Aynı oturumda her iki giriş modunu serbestçe karıştırabilirsiniz - bazı mesajları konuşabilir, bazılarını yazabilirsiniz.

Yapılandırma Düğmeleri

Soldaki dört yapılandırma düğmesi, işlem hattının her bir bölümü için özel paneller açar:

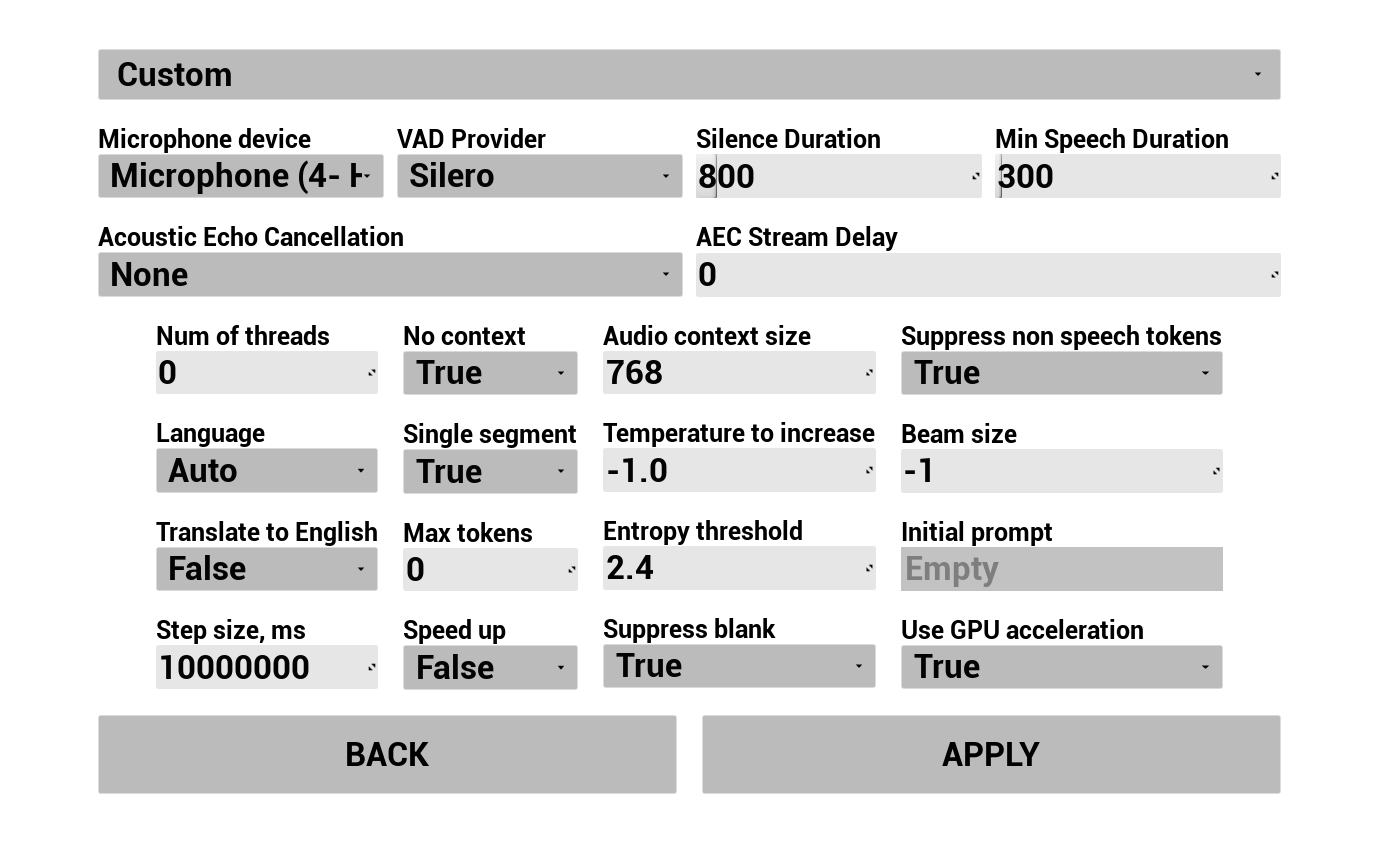

1. Konuşma Tanımayı Yapılandır

Kullanıcının sesinin nasıl yakalanıp yazıya döküleceğini yapılandırın:

- Dil seçin

- Konuşma tanıma parametrelerini (Whisper model ayarları) ayarlayın

- AEC (Akustik Eko İptali) yapılandırın

- VAD (Ses Etkinliği Algılama) yapılandırın

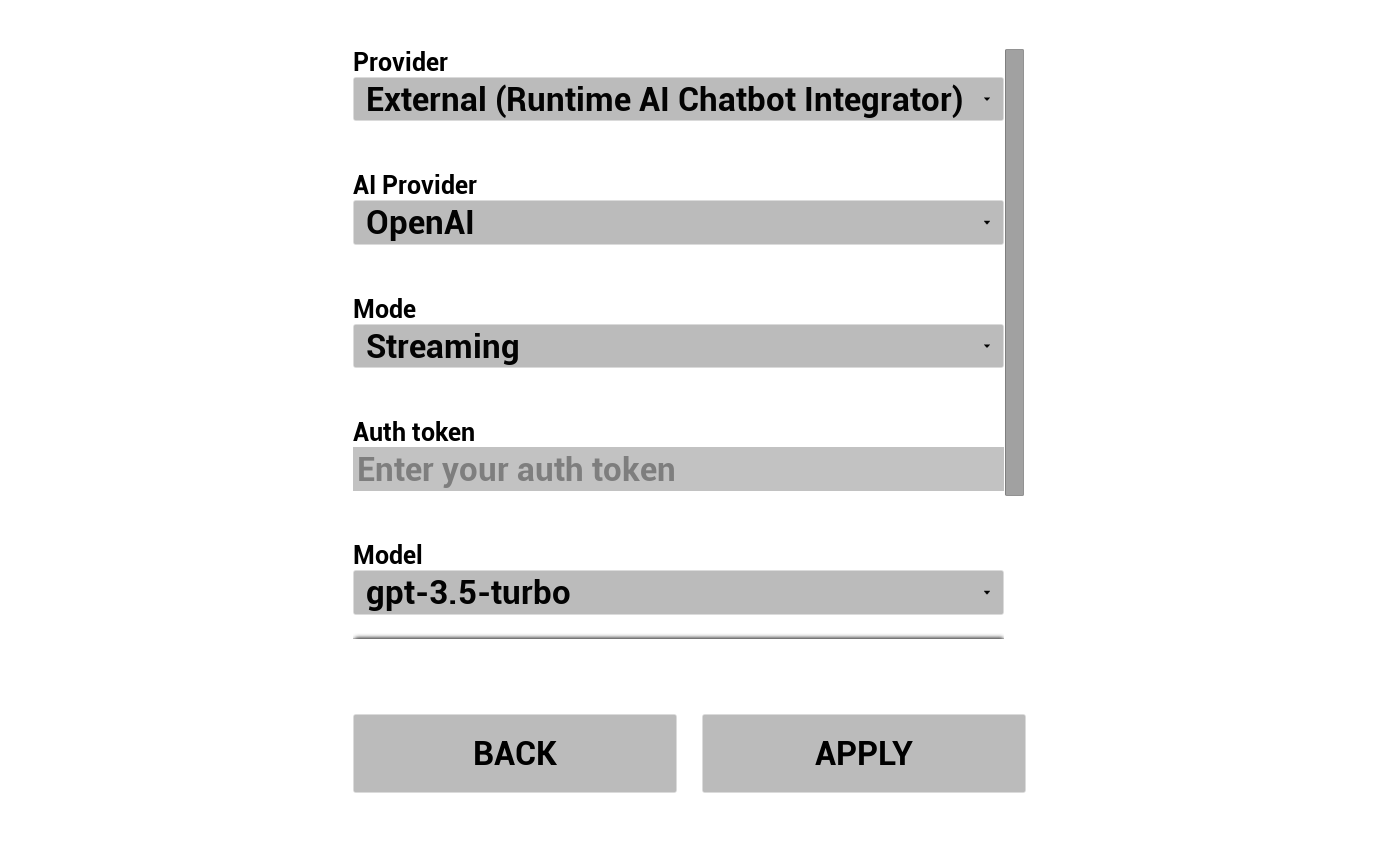

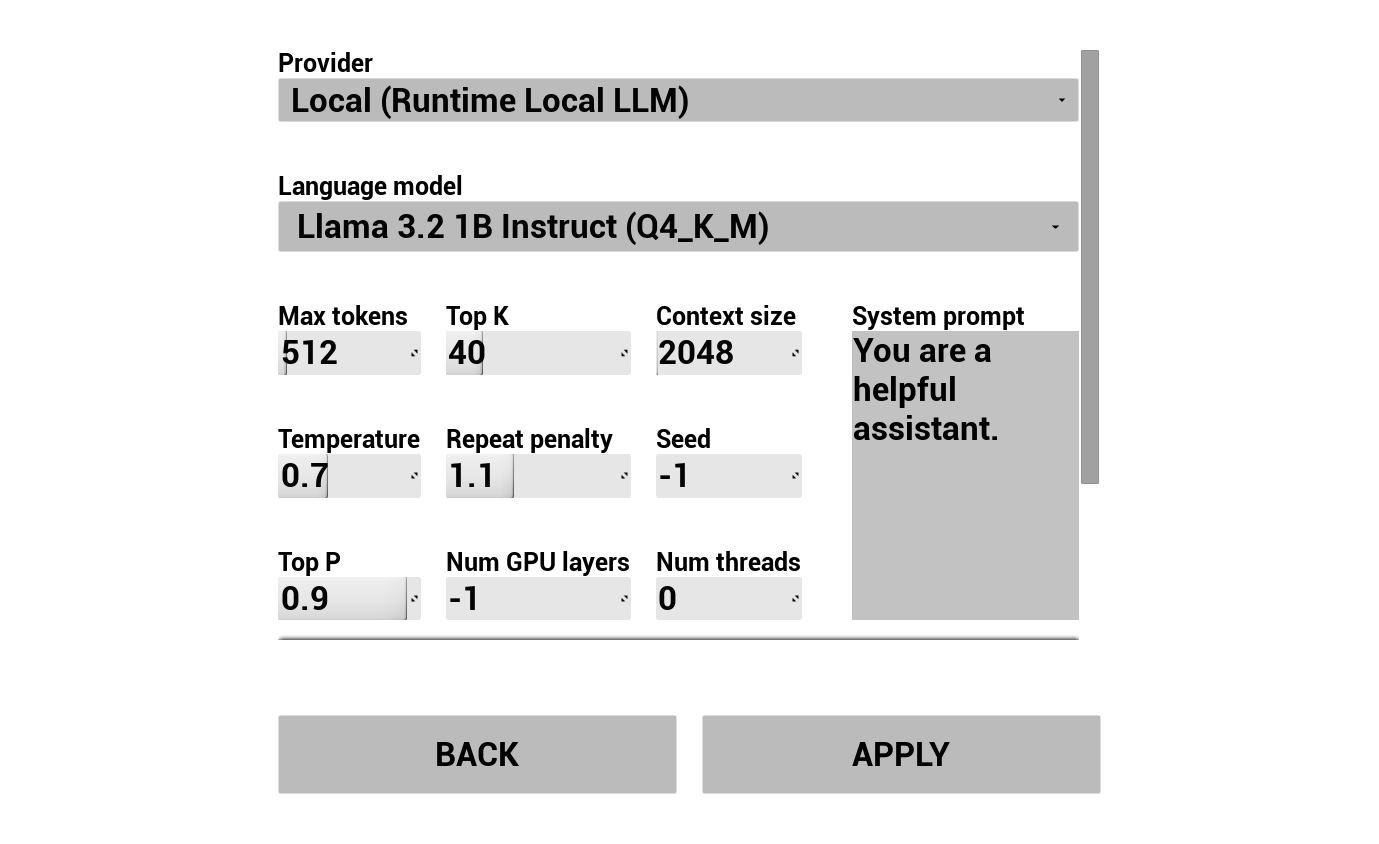

2. Yapay Zeka Sohbet Botunu Yapılandır

LLM sağlayıcınızı seçin ve yapılandırın:

- Sağlayıcı seçin (Runtime AI Chatbot Integrator veya Runtime Local LLM)

- Harici sağlayıcılar için: yetkilendirme anahtarı, model adı vb.

- Yerel LLM için: bir GGUF modeli seçin, bağlam boyutu ve diğer çıkarım parametrelerini ayarlayın. Ayrıca doğrudan demo üzerinden kendi GGUF modelinizi çalışma zamanında indirebilir (ör. URL ile) ve projeyi yeniden oluşturmadan hemen kullanabilirsiniz.

Sağlayıcı açılan kutusu yalnızca Content/Modules/ içinde eklenti modül klasörü bulunan sağlayıcıları gösterir.

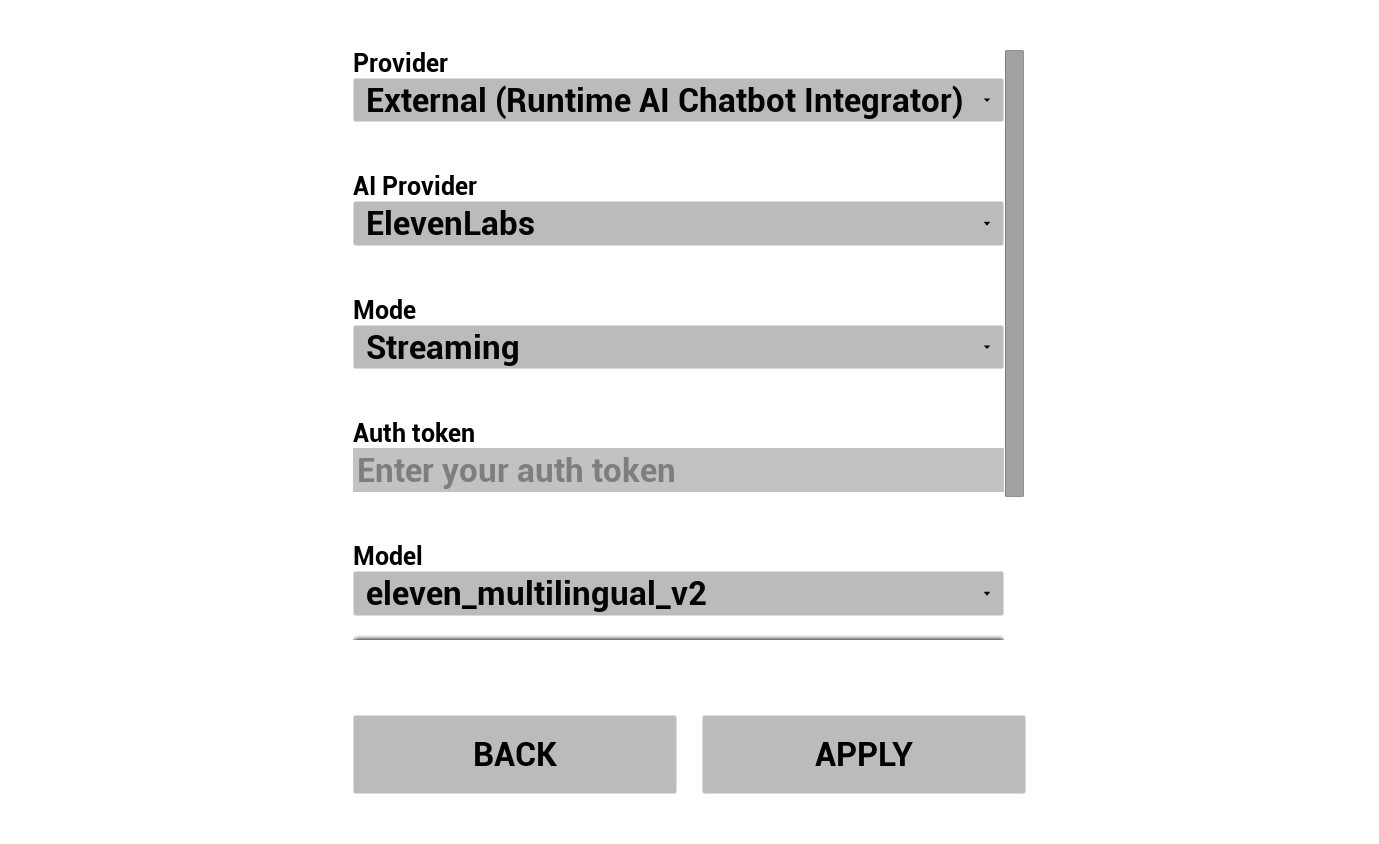

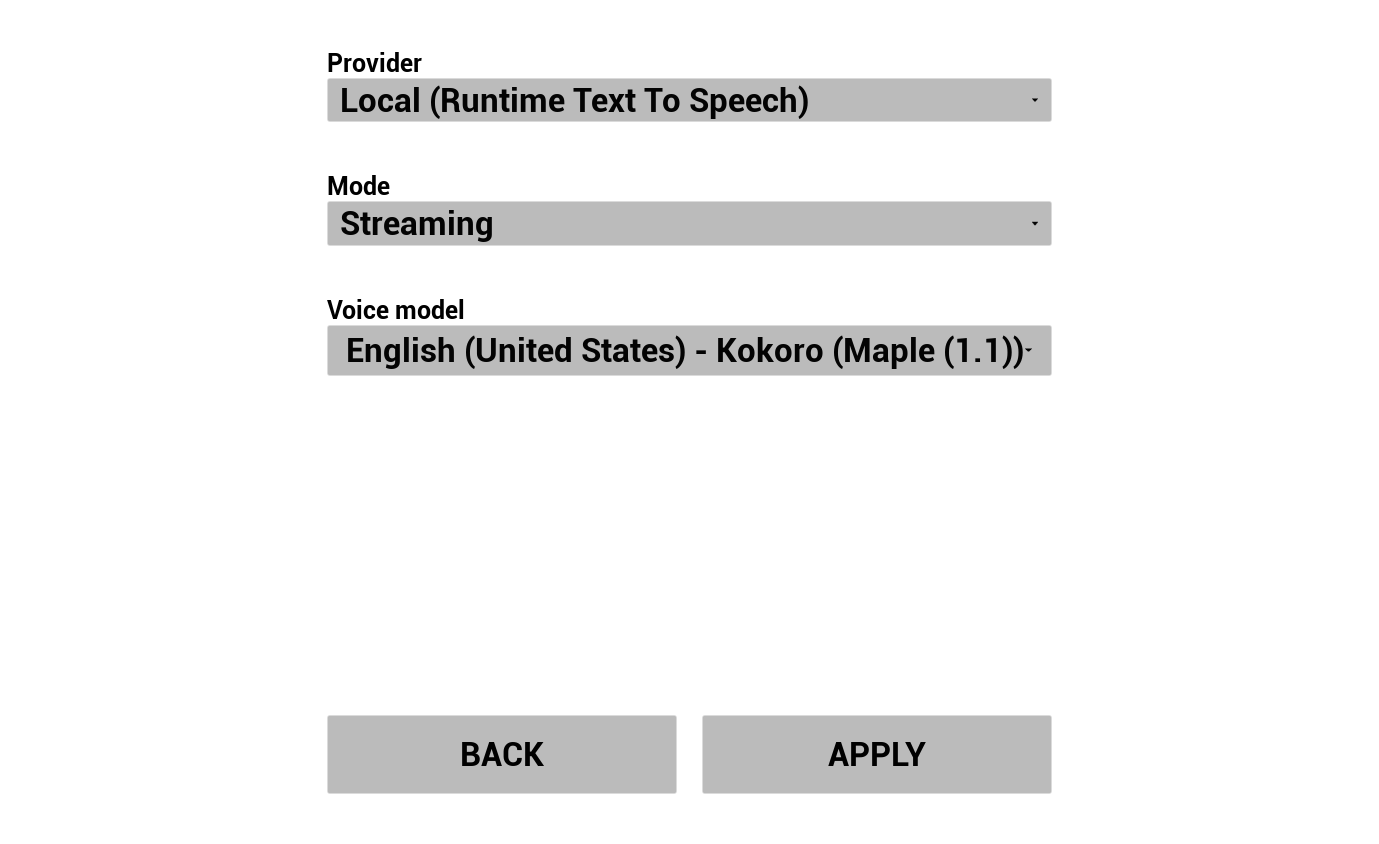

3. Metinden Konuşmayı Yapılandır

TTS sağlayıcınızı seçin ve sesleri/modelleri yapılandırın:

- Sağlayıcı seçin (OpenAI/ElevenLabs için Runtime AI Chatbot Integrator veya yerel Piper/Kokoro için Runtime Text To Speech)

- Ses/Model seçin

- Sağlayıcıya özel parametreleri ayarlayın

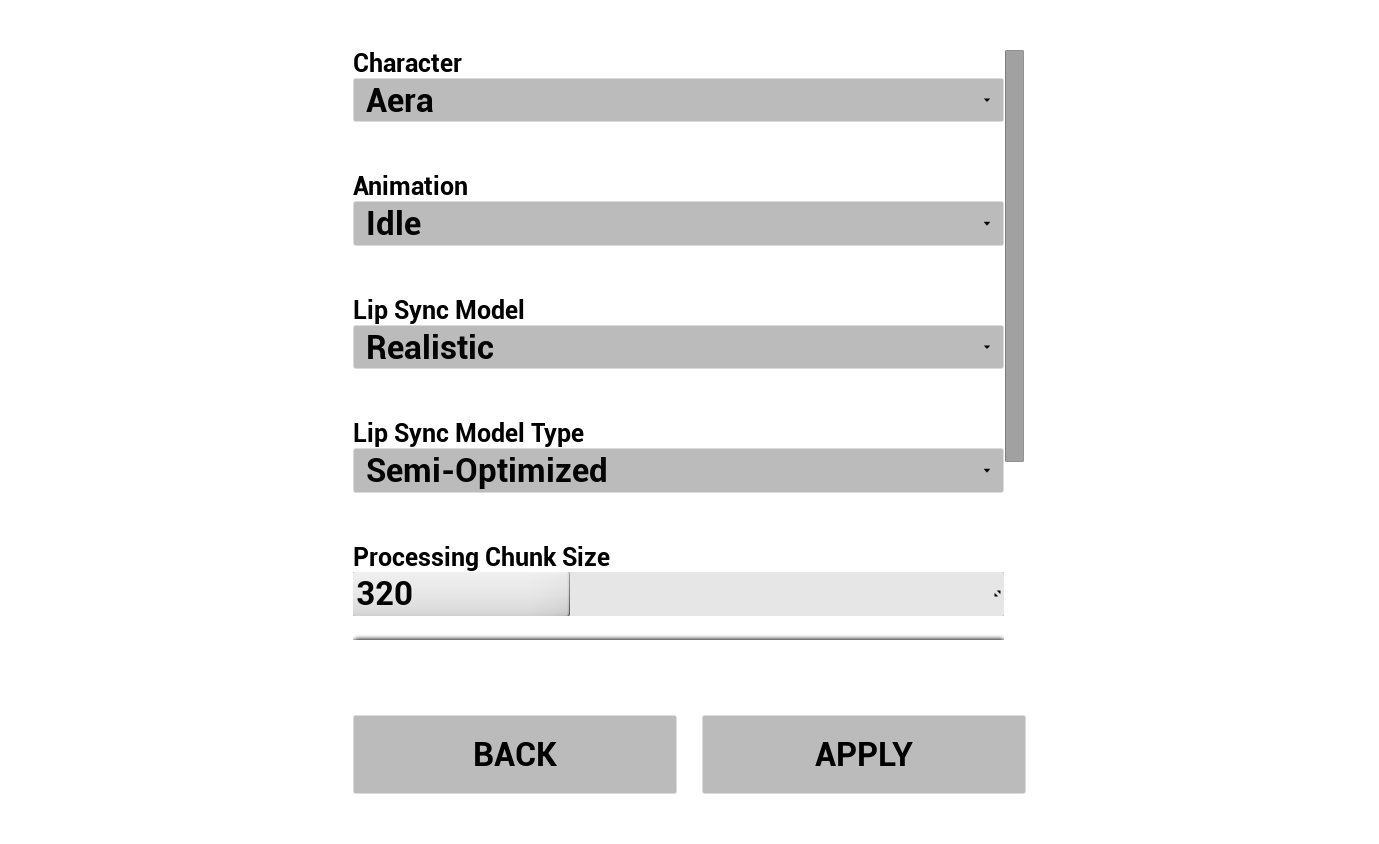

4. Animasyonları Yapılandır

Yapay zeka avatarınızın görsellerini kontrol edin:

- 3 önceden indirilmiş MetaHuman karakteri arasından seçim yapın (Aera, Ada, Orlando)

- Dudak senkronizasyon modeli seçin (Standard veya Realistic)

- Dudak senkronizasyon model türü seçin - Yüksek Düzeyde Optimize Edilmiş, Yarı Optimize Edilmiş veya Orijinal (bkz. Model Türü)

- İşlem Yığın Boyutunu ayarlayın - dudak senkronizasyonu çıkarımının ne sıklıkta çalışacağını kontrol eder (bkz. İşlem Yığın Boyutu)

- Konuşma sırasında MetaHuman'da oynatılacak bir boşta animasyon seçin

Demo'yu Editörde Önceden Yapılandırma

Kaynak sürüm ile çalışırken, değerlerin her çalıştırmada yeniden girilmesine gerek kalmaması için varsayılanları doğrudan editörde önceden doldurabilirsiniz:

| Ne | Nerede |

|---|---|

| Genel ayarlar (dudak senkronizasyon modeli, boşta animasyon, karakter sınıfı, konuşma tanıma vb.) | Content/LipSyncSTSGameInstance |

| Harici LLM / Harici TTS ayarları (Runtime AI Chatbot Integrator) | Content/Modules/RuntimeAIChatbotIntegrator/RuntimeAIChatbotIntegrator_Provider |

| Yerel LLM ayarları (Runtime Local LLM) | Content/Modules/RuntimeLocalLLM/RuntimeLocalLLM_Provider |

| Yerel TTS ayarları (Runtime Text To Speech) | Content/Modules/RuntimeTextToSpeech/RuntimeTextToSpeech_Provider |

Çapraz Platform Notları

Demo tarafından kullanılan tüm eklentiler Windows, Mac, Linux, iOS, Android ve Android tabanlı platformları (Meta Quest dahil) destekler, dolayısıyla demo projesi de tüm bu platformlarda çalışır. Bu, masaüstü kiosklarından ve tarayıcı tabanlı deneyimlerden mobil uygulamalara, bağımsız VR başlıklarına ve set içi sanal prodüksiyon kurulumlarına kadar çok çeşitli ortamlara dağıtım için uygundur.

Daha zayıf cihazlar için (mobil, bağımsız VR), şunları yapmak isteyebilirsiniz:

- Realistic yerine Standard dudak senkronizasyon modelini kullanın - Model karşılaştırmasına bakın

- Yüksek Düzeyde Optimize Edilmiş model türüne geçin

- CPU yükünü azaltmak için İşlem Yığın Boyutunu artırın

- Daha küçük LLM / TTS modelleri seçin

Android, iOS, Mac ve Linux'ta ek kurulum adımları için Platforma Özel Yapılandırma sayfasına bakın.

Kendi Karakterinizi Getirme

Demo projesi üç örnek MetaHuman karakteri (Aera, Ada, Orlando) ile birlikte gelir, ancak kendi MetaHuman'ınızı içe aktarabilir ve demo içinde kullanabilirsiniz.

📺 Video eğitimi: Demo Projesine Özel Bir MetaHuman Karakteri Ekleme

Runtime MetaHuman Lip Sync eklentisi, MetaHuman'ların ötesinde birçok karakter sistemini destekler (ARKit tabanlı karakterler, Daz Genesis 8/9, Reallusion CC3/CC4, Mixamo, ReadyPlayerMe vb. - Özel Karakter Kurulum Kılavuzu sayfasına bakın). İster bir oyun NPC'si, ister sanal bir sunucu, bir kiosk görevlisi veya sanal prodüksiyon için dijital bir insan inşa ediyor olun, eklenti karakter işlem hattınıza uyum sağlar.

Tam AI konuşma iş akışı olmadan, yalnızca dudak senkronizasyonu özelliğine odaklanan daha basit bir demo projesi. Dudak senkronizasyonunu çeşitli ses kaynaklarıyla eylemde görmek istiyorsanız uygundur.

Tanıtım Videosu

İndirmeler

Neler İçerir

Bu demo, temel dudak senkronizasyonu iş akışlarını gösterir:

- Mikrofon girişi - canlı sesten gerçek zamanlı dudak senkronizasyonu

- Ses dosyası oynatma - içe aktarılmış ses dosyalarından dudak senkronizasyonu

- Metinden Konuşmaya - sentezlenmiş konuşma ile sürülen dudak senkronizasyonu

Gerekli ve İsteğe Bağlı Eklentiler

| Eklenti | Amaç | Gerekli? |

|---|---|---|

| Runtime MetaHuman Lip Sync | Dudak senkronizasyon animasyonu | ✅ Gerekli |

| Runtime Audio Importer | Ses içe aktarma ve yakalama | ✅ Gerekli |

| Runtime Text To Speech | TTS demo sahnesi için yerel TTS | 🔶 İsteğe bağlı |

| Runtime AI Chatbot Integrator | Harici TTS sağlayıcıları (OpenAI, ElevenLabs) | 🔶 İsteğe bağlı |

Standart Dudak Senkronizasyonu Modeli İçin Notlar

Her iki demo projesinde de Standard Modeli (Realistic yerine) kullanmayı planlıyorsanız, Standard Lip Sync Extension eklentisini yüklemeniz gerekecektir. Kurulum talimatları için Standard Model Extension sayfasına bakın.

Yardıma mı İhtiyacınız Var?

Demo projelerini kurarken veya çalıştırırken herhangi bir sorunla karşılaşırsanız, çekinmeden ulaşın:

Özel geliştirme talepleri için (örn. demoyu kendi mantığınızla genişletmek, belirli bir platform veya karakter iş akışına uyarlamak), [email protected] adresinden iletişime geçin.