推理参数

LLM 推理参数结构控制模型的加载和生成文本的方式。在加载模型时传递这些参数。本页描述每个参数及其效果。

参数参考

| 参数 | 类型 | 默认值 | 范围 | 描述 |

|---|---|---|---|---|

| Max Tokens | int32 | 512 | 1–8192 | 单次响应中生成的最大 token 数 |

| Temperature | float | 0.7 | 0.0–2.0 | 控制随机性。0.0 表示确定性。值越高,输出越具有创造性 |

| Top P | float | 0.9 | 0.0–1.0 | 核采样。只有累积概率超过此值的 token 才会被考虑 |

| Top K | int32 | 40 | 0–200 | 将选择限制为最可能的 K 个 token。0 表示禁用 |

| Repeat Penalty | float | 1.1 | 0.0–3.0 | 对已经出现在输出中的 token 进行惩罚。1.0 表示无惩罚 |

| Num GPU Layers | int32 | -1 | -1–200 | 卸载到 GPU 的模型层数。-1 表示自动。0 表示仅使用 CPU |

| Context Size | int32 | 2048 | 128–131072 | 最大上下文窗口,以 token 计。较大的值会使用更多内存 |

| System Prompt | FString | "You are a helpful assistant." | — | 塑造模型行为的系统指令 |

| Seed | int32 | -1 | -1+ | 用于可重现输出的随机种子。-1 表示随机 |

| Num Threads | int32 | 0 | 0–128 | 用于生成的 CPU 线程数。0 表示自动 |

用法

- Blueprint

- C++

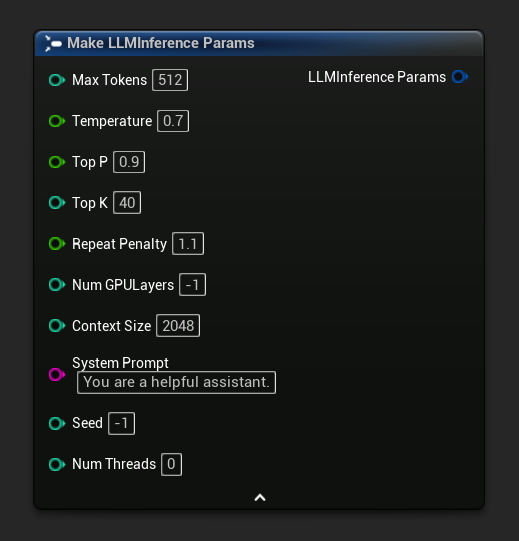

推理参数在加载和异步节点上显示为一个结构体引脚。分解结构体来设置各个值:

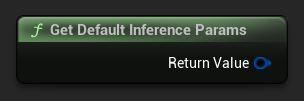

要获取一组默认参数作为起点,请使用 Get Default Inference Params:

// Creative writing

FLLMInferenceParams CreativeParams;

CreativeParams.MaxTokens = 1024;

CreativeParams.Temperature = 1.2f;

CreativeParams.TopP = 0.95f;

CreativeParams.TopK = 80;

CreativeParams.RepeatPenalty = 1.2f;

CreativeParams.SystemPrompt = TEXT("You are a creative storyteller.");

// Factual / deterministic

FLLMInferenceParams FactualParams;

FactualParams.MaxTokens = 256;

FactualParams.Temperature = 0.1f;

FactualParams.TopP = 0.5f;

FactualParams.TopK = 10;

FactualParams.SystemPrompt = TEXT("Answer questions concisely and accurately.");

// Mobile-optimized

FLLMInferenceParams MobileParams;

MobileParams.MaxTokens = 128;

MobileParams.ContextSize = 1024;

MobileParams.NumGPULayers = 0;

MobileParams.NumThreads = 4;

MobileParams.SystemPrompt = TEXT("You are a helpful assistant. Keep responses brief.");

// Get defaults programmatically

FLLMInferenceParams DefaultParams = URuntimeLocalLLM::GetDefaultInferenceParams();

平台推荐

移动端 / VR (Android, iOS, Meta Quest)

- 上下文大小: 1024–2048

- GPU 层数: 0 (仅 CPU) 除非设备确认支持 GPU 计算

- 最大令牌数: 低于 256 以实现响应式交互

- 线程数: 2–4 取决于设备

桌面端 (Windows, Mac, Linux)

- 上下文大小: 2048–8192 适用于多数对话

- GPU 层数: -1 (自动) 以在有可用时利用 GPU 加速

- 线程数: 0 (自动)

- 最大令牌数: 512–2048 用于更长的回复