演示项目

为了帮助您快速上手 Runtime MetaHuman Lip Sync,我们提供了两个即用型演示项目。两者均基于 Unreal Engine 5.6+ 构建,Blueprint-only,并可跨平台运行于 Windows、Mac、Linux、iOS、Android 以及基于 Android 的平台(包括 Meta Quest)。

可用的演示项目

- AI 对话 NPC / 交互式虚拟形象

- 基础口型同步演示

一个完整的 AI 对话虚拟形象工作流,结合了语音识别、AI 聊天机器人 (LLM)、文本转语音以及带有实时口型同步的音频播放 — 所有这些都在单个项目中一起运行。适用于广泛的用例 — 包括 交互式信息亭、虚拟制片、博物馆装置、数字助理、培训模拟 和游戏。

工作流概览

🎤 Microphone → Speech Recognition → 💬 LLM Chatbot → 🔊 Text-to-Speech → 👄 Lip Sync + Playback

视频

快速预览(约30秒)

一段简短的演示展示。

完整演示

一份详细演示,涵盖设置、配置和完整的对话流程。

下载

必需和可选插件

该演示项目是模块化的 - 您只需要您要使用的提供商的插件。

| 插件 | 用途 | 是否必需? |

|---|---|---|

| Runtime MetaHuman Lip Sync | 唇形同步动画 | ✅ 始终必需 |

| Runtime Audio Importer | 音频捕获和处理 | ✅ 始终必需 |

| Runtime Speech Recognizer | 离线语音识别 (whisper.cpp) | ✅ 始终必需 |

| Runtime AI Chatbot Integrator | 外部LLMs (OpenAI, Claude, DeepSeek, Gemini, Grok, Ollama) 和/或 外部TTS (OpenAI, ElevenLabs) | 🔶 可选 |

| Runtime Local LLM | 通过llama.cpp的本地LLM推理 (Llama, Mistral, Gemma 等, GGUF 模型) | 🔶 可选 |

| Runtime Text To Speech | 通过Piper和Kokoro的本地TTS | 🔶 可选 |

虽然上述每个插件都是单独可选的,但要使演示正常工作,您需要至少一个LLM提供商和至少一个TTS提供商。可以自由组合(例如,本地LLM + ElevenLabs TTS,或OpenAI LLM + 本地TTS)。

模块化架构

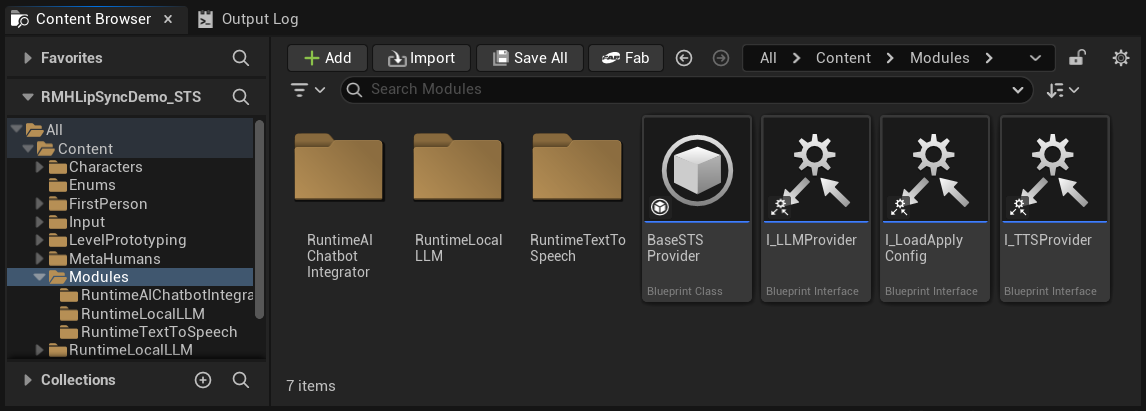

在 Content 文件夹中,您会找到一个 Modules 文件夹,其中包含三个子文件夹:

Content/

└── Modules/

├── RuntimeAIChatbotIntegrator/ ← External LLMs and/or external TTS

├── RuntimeLocalLLM/ ← Local LLM via llama.cpp

└── RuntimeTextToSpeech/ ← Local TTS via Piper/Kokoro

如果您未获取一个(或多个)可选插件,只需删除相应的文件夹。演示项目的基础资源(游戏实例、控件等)不直接引用这些模块,因此删除它们不会导致资源引用错误。配置 UI 将自动隐藏文件夹缺失的提供商。

此模块化仅适用于 LLM 和 TTS 提供商。语音识别(Runtime Speech Recognizer)和 口型同步(Runtime MetaHuman Lip Sync)是基演示项目的一部分,且始终必需。

首次启动时,Unreal 可能会询问是否禁用缺失的可选插件——点击 Yes。请确保也已删除对应的 Content/Modules/ 文件夹(见上文)。

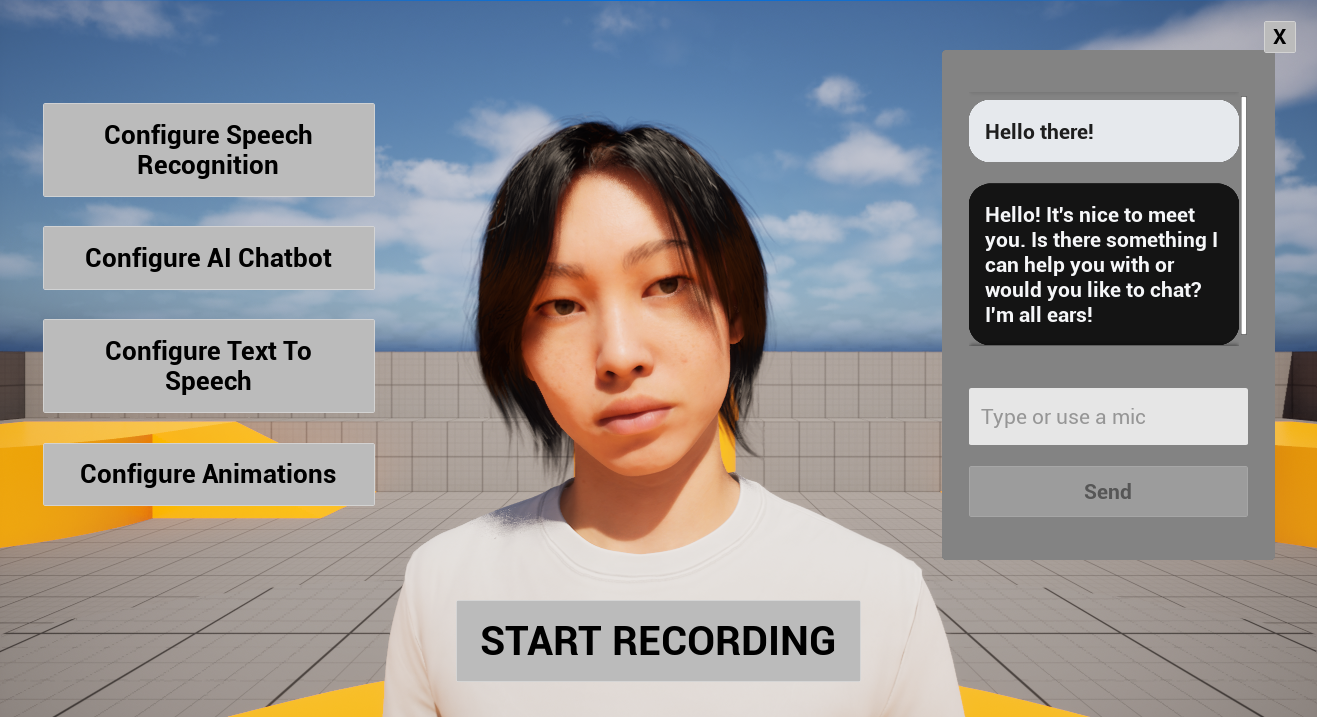

演示项目布局

下方显示的用户界面完全使用 UMG(Unreal Motion Graphics)构建,纯粹用于演示流水线——语音识别 → LLM → TTS → 口型同步。您可以自由地重新设计或替换它,以匹配您项目的视觉风格、控制方案或平台(VR/AR、移动设备、游戏主机、自助终端等)。如果某些控件在您的用例中不需要,您也可以直接隐藏它们(例如,将其可见性设置为 折叠 或 隐藏)。

| 区域 | 内容说明 |

|---|---|

| 中央 | MetaHuman 角色。 |

| 左侧 | 四个配置按钮(语音识别、AI 聊天机器人、文本转语音、动画),详情见下文。 |

| 中央底部 | 一个 开始录制 按钮。点击开始语音对话:麦克风捕捉声音,转录后发送至 LLM,TTS 合成响应,并通过口型同步播放,完全无需动手。 |

| 右侧中央 | 一个 对话历史小部件,显示您与 AI 之间的完整往来(包括用户消息和助手消息)。它还包含一个 文本输入框,因此您可以直接输入消息而无需使用语音识别,适用于测试、无障碍访问或麦克风不可用时。 |

您可以在同一会话中自由混合两种输入模式——有些消息用语音,有些用键盘输入。

配置按钮

左侧的四个配置按钮可打开管道各部分的专用面板:

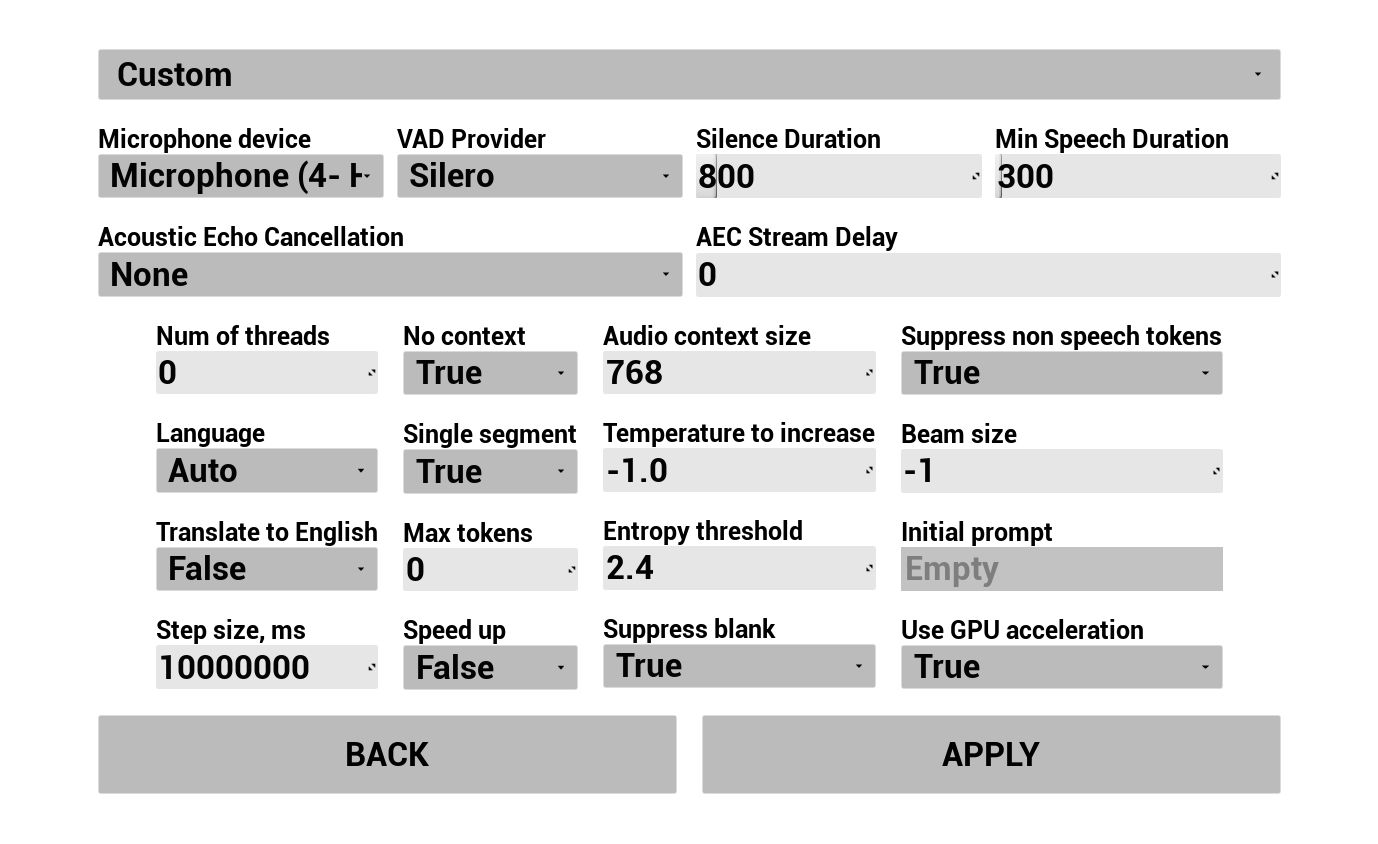

1. 配置语音识别

配置用户语音的捕获和转录方式:

- 选择语言

- 调整语音识别参数(Whisper 模型设置)

- 配置 AEC(声学回声消除)

- 配置 VAD(语音活动检测)

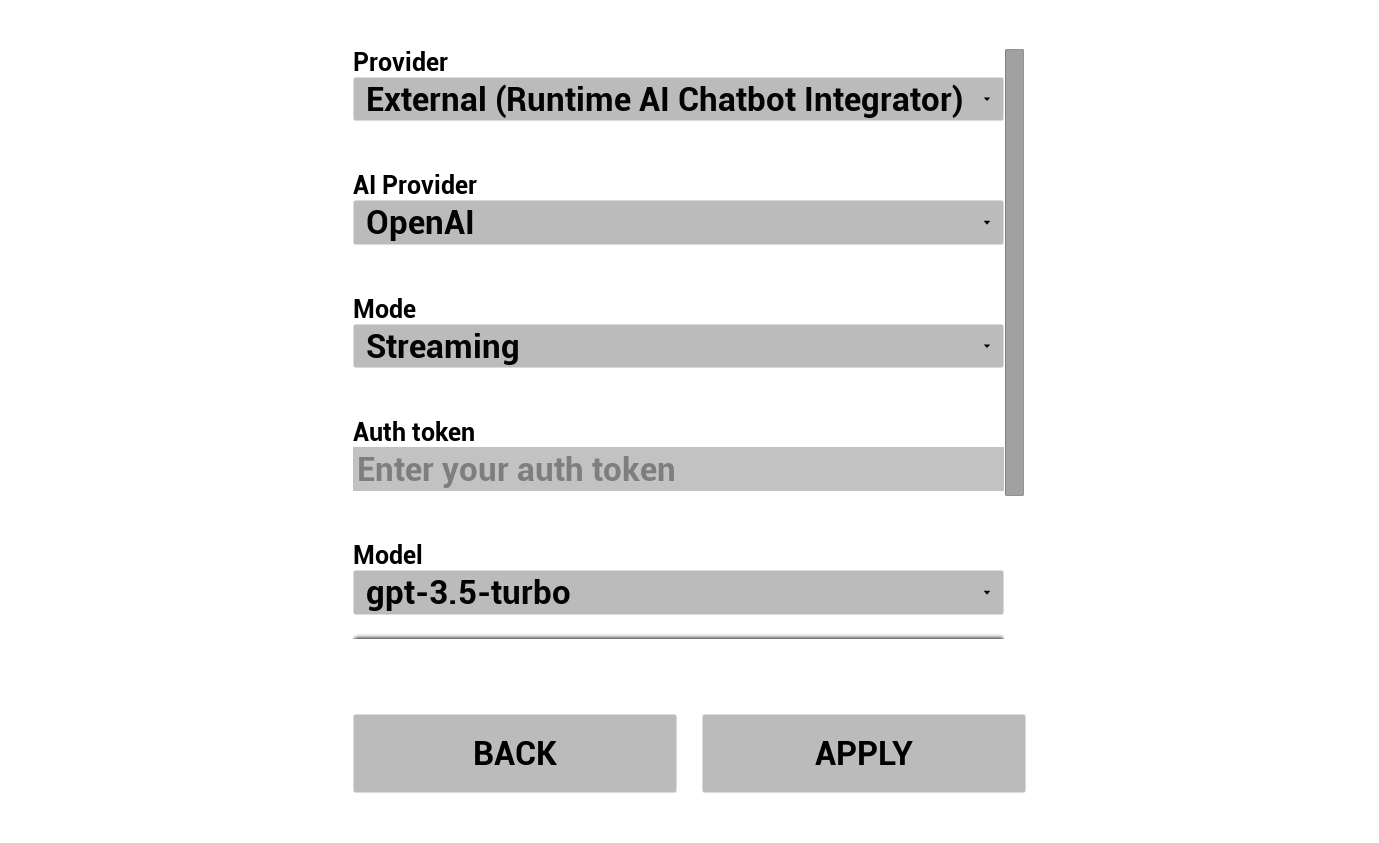

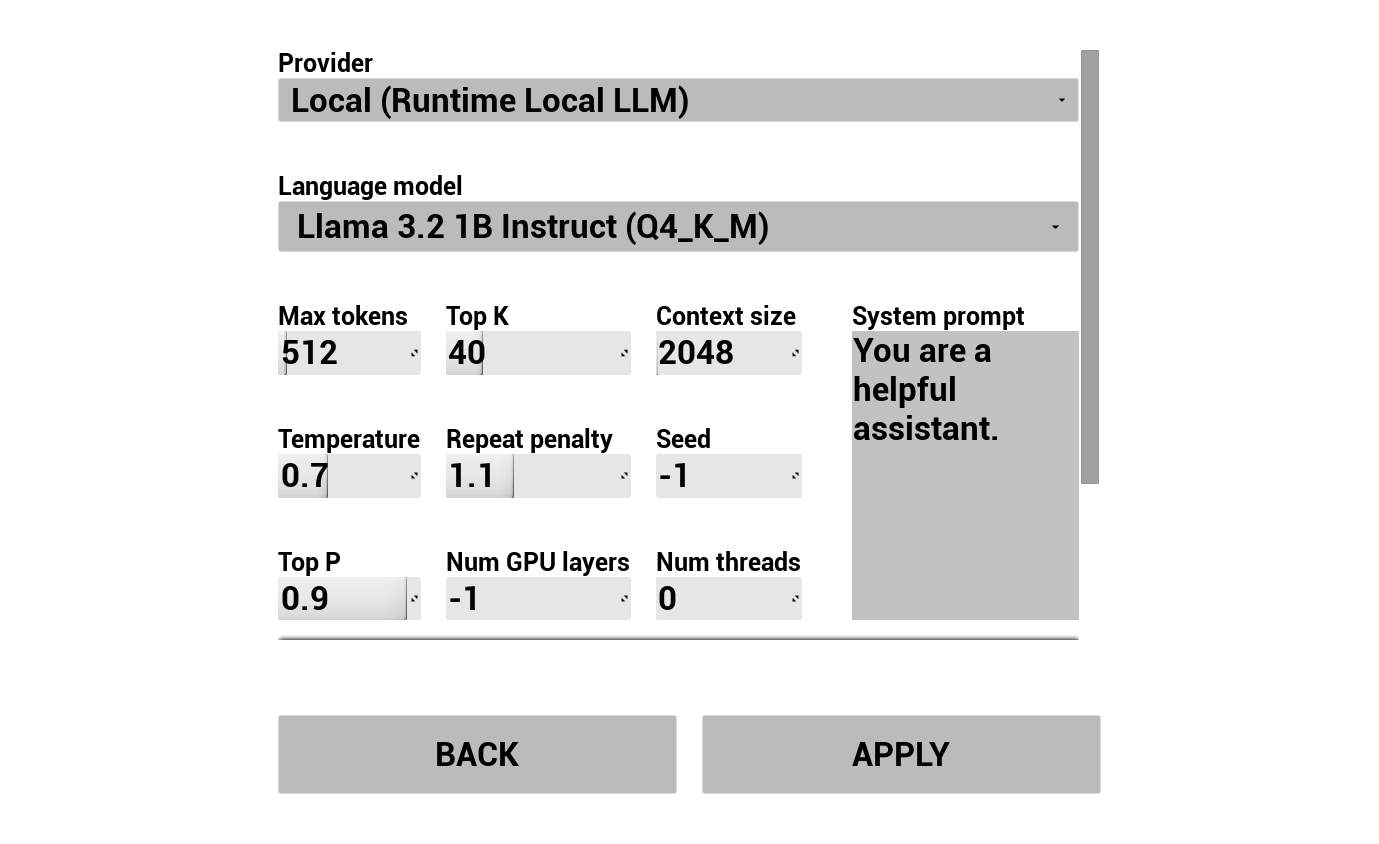

2. 配置 AI 聊天机器人

选择您的 LLM 提供商并进行配置:

- 选择提供商(Runtime AI Chatbot Integrator 或 Runtime Local LLM)

- 对于外部提供商:认证令牌、模型名称等。

- 对于本地 LLM:选择 GGUF 模型,设置上下文大小和其他推理参数。您还可以在运行时直接从演示中下载自己的 GGUF 模型(例如通过 URL),并立即使用,无需重新构建项目。

提供商的组合框仅显示其插件模块文件夹存在于 Content/Modules/ 中的提供商。

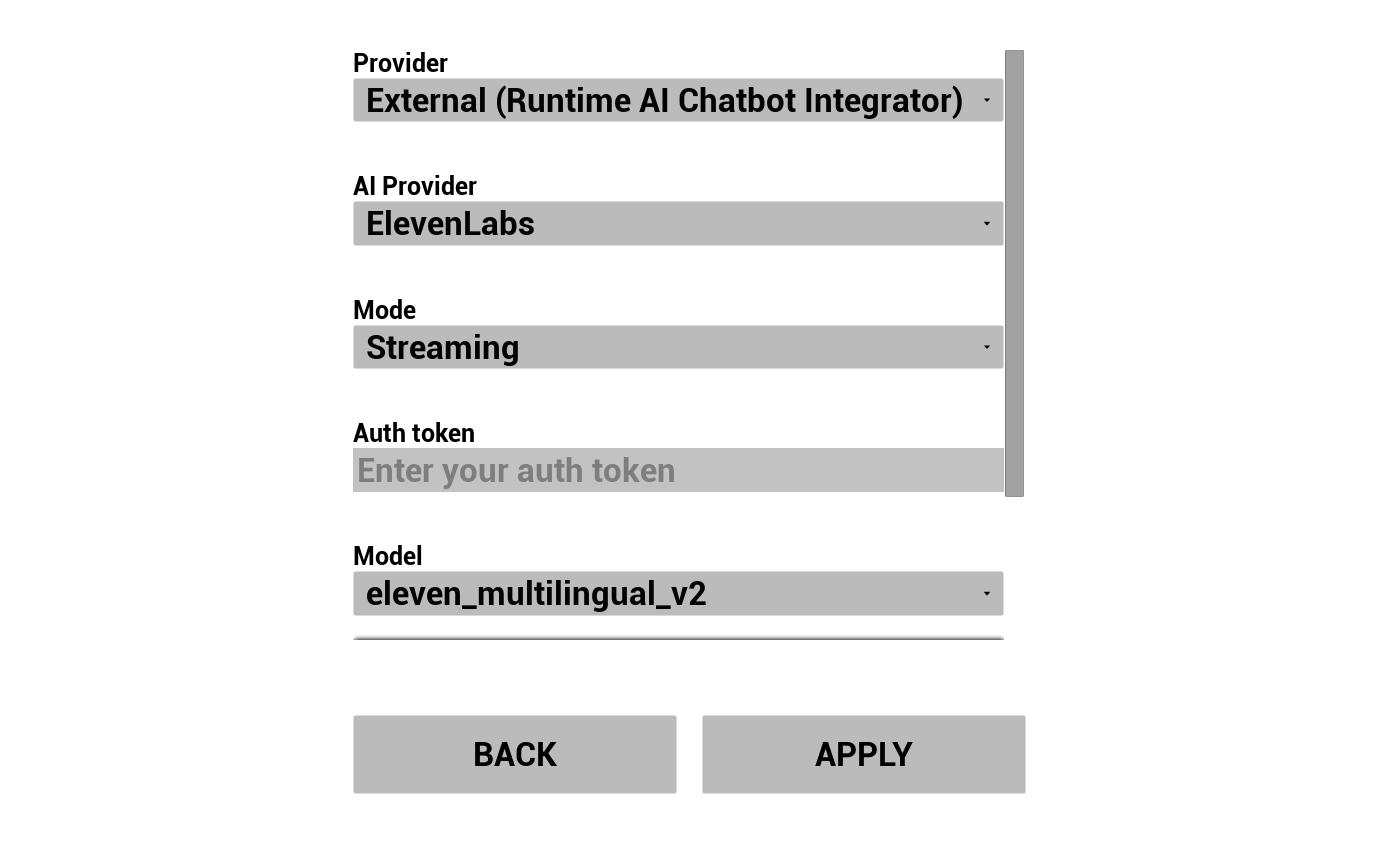

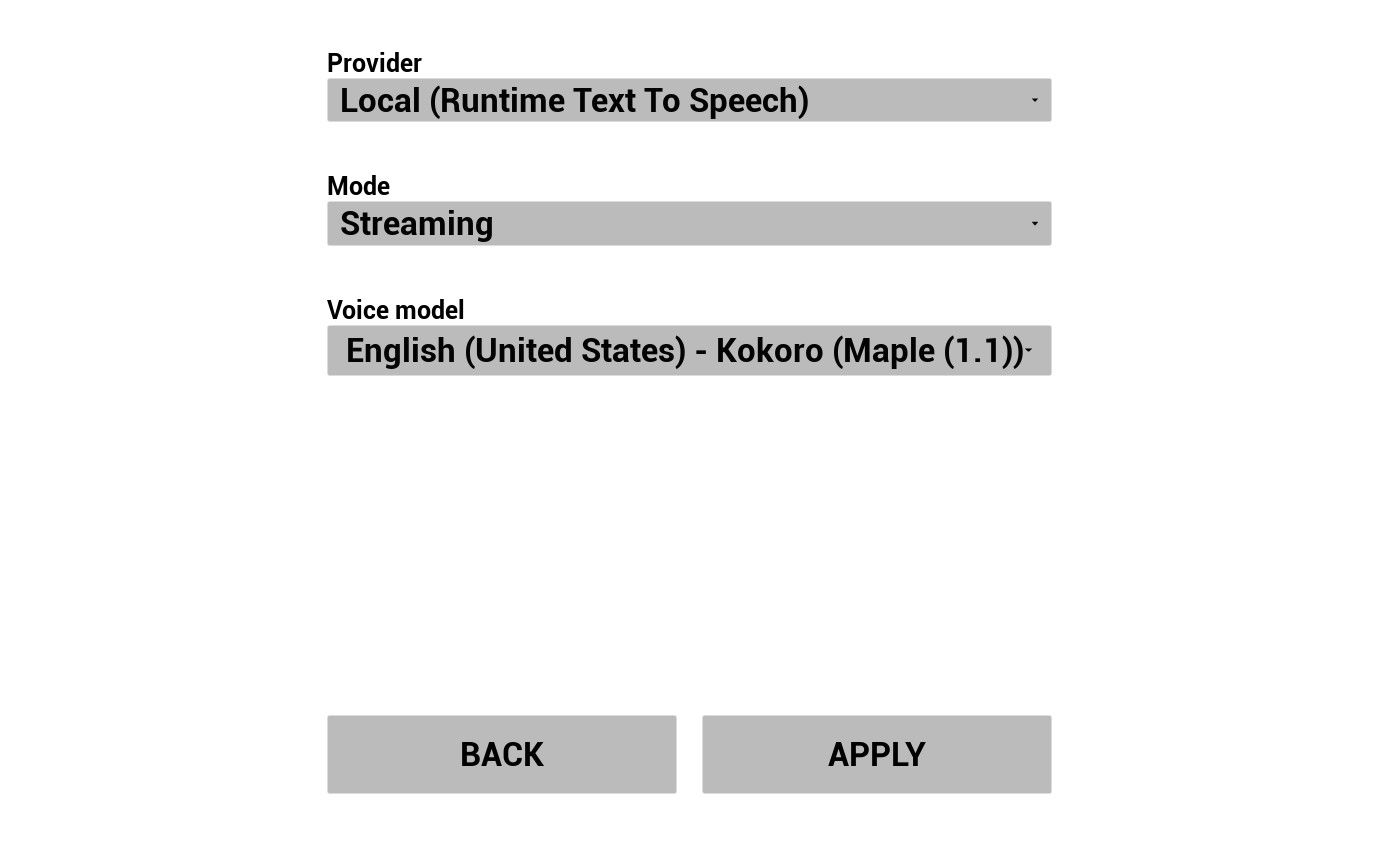

3. 配置文本转语音

选择您的 TTS 提供商并配置声音/模型:

- 选择提供商(Runtime AI Chatbot Integrator 用于 OpenAI/ElevenLabs,或 Runtime Text To Speech 用于本地 Piper/Kokoro)

- 选择声音/模型

- 调整提供商特定参数

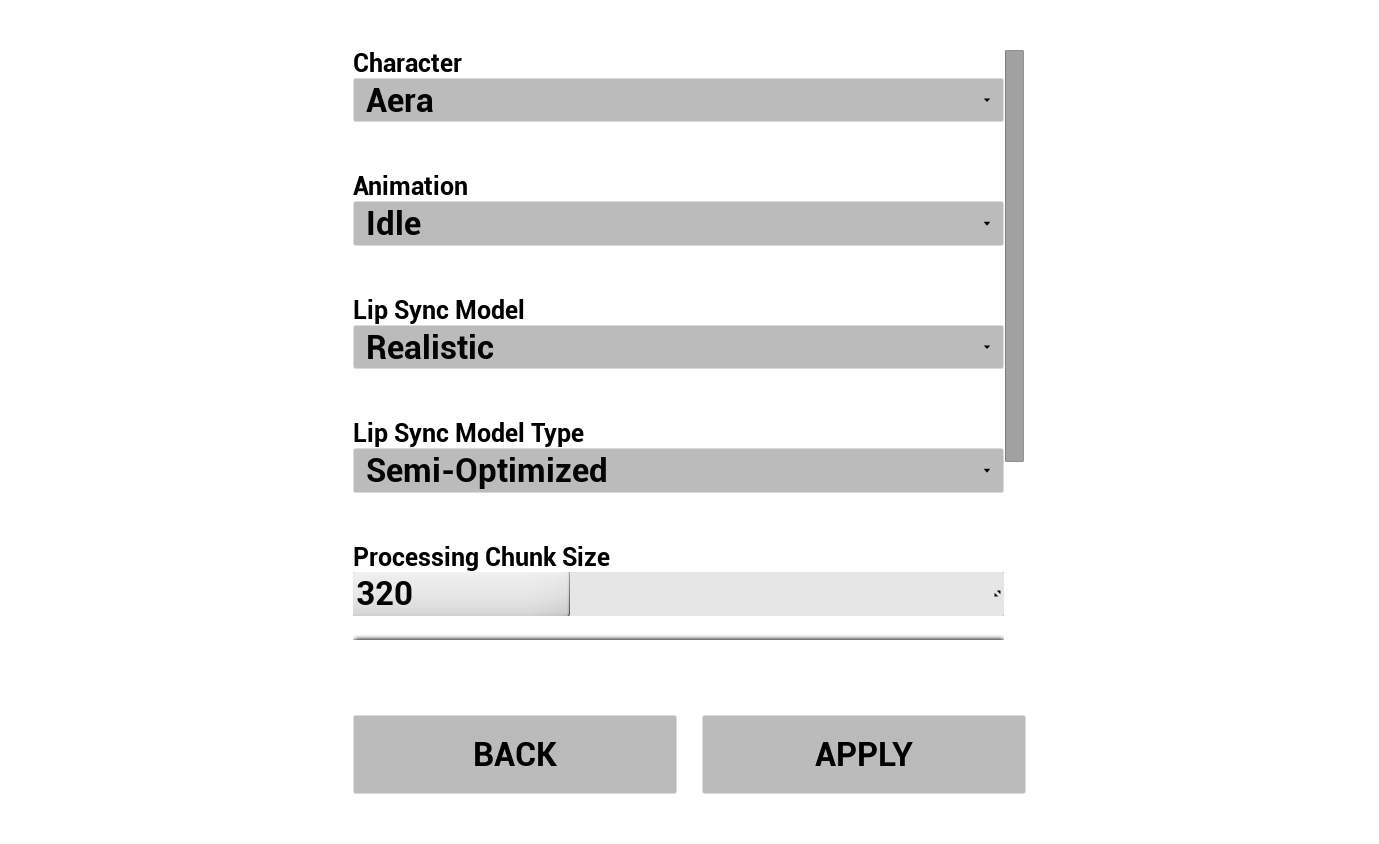

4. 配置动画

控制 AI 化身的外观:

- 在 3 个预下载的 MetaHuman 角色(Aera、Ada、Orlando)之间选择

- 选择口型同步模型(Standard 或 Realistic)

- 选择口型同步模型类型——高度优化、半优化或原始(参见模型类型)

- 调整处理块大小——控制口型同步推理的运行频率(参见处理块大小)

- 选择在对话期间在 MetaHuman 上播放的空闲动画

在编辑器中预配置演示项目

使用源代码版本时,您可以直接在编辑器中预填充默认值,这样每次运行时无需重新输入:

| 设置项 | 位置 |

|---|---|

| 常规设置(口型同步模型、空闲动画、角色类、语音识别等) | Content/LipSyncSTSGameInstance |

| 外部 LLM / 外部 TTS 设置(Runtime AI Chatbot Integrator) | Content/Modules/RuntimeAIChatbotIntegrator/RuntimeAIChatbotIntegrator_Provider |

| 本地 LLM 设置(Runtime Local LLM) | Content/Modules/RuntimeLocalLLM/RuntimeLocalLLM_Provider |

| 本地 TTS 设置(Runtime Text To Speech) | Content/Modules/RuntimeTextToSpeech/RuntimeTextToSpeech_Provider |

跨平台说明

演示项目使用的所有插件均支持 Windows、Mac、Linux、iOS、Android 以及基于 Android 的平台(包括 Meta Quest),因此该演示项目也可在所有这些平台上运行。这使其适合部署在各种环境中——从桌面自助终端和基于浏览器的体验到移动应用、独立 VR 头戴设备以及现场虚拟制作设置。

对于较弱的设备(移动设备、独立 VR),您可能希望:

- 使用 Standard 口型同步模型 而非 Realistic——参见模型对比

- 切换到高度优化模型类型

- 增大处理块大小以减少 CPU 负载

- 选择较小的 LLM / TTS 模型

有关 Android、iOS、Mac 和 Linux 的其他设置步骤,请参阅平台特定配置。

带来您自己的角色

演示项目附带三个示例 MetaHuman 角色(Aera、Ada、Orlando),但您可以导入自己的 MetaHuman 并在演示中使用。

📺 视频教程: 将自定义 MetaHuman 角色添加到演示项目

Runtime MetaHuman Lip Sync 插件本身支持 MetaHuman 之外的许多其他角色系统(基于 ARKit 的角色、Daz Genesis 8/9、Reallusion CC3/CC4、Mixamo、ReadyPlayerMe 等——参见自定义角色设置指南)。无论您是构建游戏 NPC、虚拟主持人、自助终端服务员还是用于虚拟制作的数字人,该插件都能适应您的角色管线。

一个更简单的演示项目,纯粹专注于口型同步功能本身,不含完整的 AI 对话工作流程。如果您只想看到口型同步在各种音频源下的实际效果,这很合适。

特色视频

下载

包含内容

此演示展示了基本的口型同步工作流程:

- 麦克风输入——来自实时音频的实时口型同步

- 音频文件播放——来自导入的音频文件的口型同步

- 文本转语音——由合成语音驱动的口型同步

必需和可选插件

| 插件 | 用途 | 是否必需? |

|---|---|---|

| Runtime MetaHuman Lip Sync | 口型同步动画 | ✅ 必需 |

| Runtime Audio Importer | 音频导入和捕获 | ✅ 必需 |

| Runtime Text To Speech | TTS 演示场景的本地 TTS | 🔶 可选 |

| Runtime AI Chatbot Integrator | 外部 TTS 提供商(OpenAI、ElevenLabs) | 🔶 可选 |

Standard Lip Sync Model 的备注

如果您计划在任一演示项目中使用 Standard Model(而非 Realistic),则需要安装 Standard Lip Sync Extension 插件。有关安装说明,请参阅 Standard Model Extension。

需要帮助?

如果您在设置或运行演示项目时遇到任何问题,请随时联系我们:

如需定制开发(例如使用自己的逻辑扩展演示、适配特定平台或角色管线),请联系 [email protected]。