Cómo usar el plugin con personajes personalizados

Esta guía te lleva a través del proceso de configurar Runtime MetaHuman Lip Sync para personajes que no son MetaHuman. Este proceso requiere familiaridad con conceptos de animación y rigging. Si necesitas ayuda para implementar esto para tu personaje específico, puedes solicitar soporte profesional en [email protected].

Nota importante sobre los modelos de sincronización labial

Los personajes personalizados solo son compatibles con el modelo Estándar (Más Rápido).

El modelo Realista (Mayor Calidad) está diseñado para personajes MetaHuman y ARKit y no puede usarse con otros personajes personalizados. A lo largo de esta guía, debes seguir las instrucciones del modelo Estándar de la guía de configuración principal cuando se haga referencia a ellas.

Plugin de Extensión Requerido: Para usar el Modelo Estándar con personajes personalizados, debes instalar el plugin de extensión Standard Lip Sync Extension como se describe en la sección de Prerrequisitos de la guía de configuración principal.

Esta extensión es requerida para todas las implementaciones de personajes personalizados descritas en esta guía.

Prerrequisitos

Antes de comenzar, asegúrate de que tu personaje cumpla con estos requisitos:

- Tiene un esqueleto válido

- Contiene morph targets (blend shapes) para expresiones faciales

- Idealmente tiene 10+ morph targets que definan visemas (más visemas = mejor calidad de sincronización labial)

El plugin requiere mapear los morph targets de tu personaje a los siguientes visemas estándar:

Sil -> Silence

PP -> Bilabial plosives (p, b, m)

FF -> Labiodental fricatives (f, v)

TH -> Dental fricatives (th)

DD -> Alveolar plosives (t, d)

KK -> Velar plosives (k, g)

CH -> Postalveolar affricates (ch, j)

SS -> Sibilants (s, z)

NN -> Nasal (n)

RR -> Approximant (r)

AA -> Open vowel (aa)

E -> Mid vowel (e)

IH -> Close front vowel (ih)

OH -> Close-mid back vowel (oh)

OU -> Close back vowel (ou)

Nota: Si tu personaje tiene un conjunto diferente de visemas (lo cual es probable), no necesitas coincidencias exactas para cada visema. Las aproximaciones a menudo son suficientes; por ejemplo, mapear el visema SH de tu personaje al visema CH del plugin funcionaría de manera efectiva, ya que son sonidos postalveolares estrechamente relacionados.

Viseme mapping reference

Aquí están los mapeos entre sistemas de visemas comunes y los visemas requeridos por el plugin:

- Apple ARKit

- FACS-Based Systems

- Preston Blair System

- 3ds Max Phoneme System

- Custom Characters (Daz Genesis 8/9, Reallusion CC3/CC4, Mixamo, ReadyPlayerMe)

ARKit proporciona un conjunto completo de blendshapes para animación facial, incluyendo varias formas de boca. Así es cómo mapearlos a los visemas de RuntimeMetaHumanLipSync:

| RuntimeMetaHumanLipSync Viseme | ARKit Equivalent | Notas |

|---|---|---|

| Sil | mouthClose | La posición neutral/de reposo |

| PP | mouthPressLeft + mouthPressRight | Para sonidos bilabiales, usa ambas formas de presión juntas |

| FF | lowerLipBiteLeft + lowerLipBiteRight (o mouthRollLower) | El labio inferior contacta con los dientes superiores, como en los sonidos "f" y "v" |

| TH | tongueOut | ARKit tiene control directo de la lengua |

| DD | jawOpen (suave) + tongueUp (si tienes un rig de lengua) | La lengua toca la cresta alveolar; ligera caída de la mandíbula |

| KK | mouthLeft o mouthRight (suave) | Un ligero tirón de la comisura de la boca aproxima los sonidos velares |

| CH | jawOpen (suave) + mouthFunnel (suave) | Combina para sonidos postalveolares |

| SS | mouthFrown | Usa un ligero ceño fruncido para sibilantes |

| NN | jawOpen (muy suave) + mouthClose | Boca casi cerrada con una ligera apertura de mandíbula |

| RR | mouthPucker (suave) | Redondeo sutil para sonidos de r |

| AA | jawOpen + mouthStretchLeft + mouthStretchRight (o jawOpen + mouthOpen) | Boca muy abierta para el sonido "ah" |

| E | jawOpen (suave) + mouthSmile | Posición medio abierta con una ligera sonrisa |

| IH | mouthSmile (suave) | Ligero ensanchamiento de los labios |

| OH | mouthFunnel | Forma redondeada y abierta |

| OU | mouthPucker | Labios fuertemente redondeados |

FACS (Sistema de Codificación de Acción Facial) utiliza Unidades de Acción (AUs) para describir movimientos faciales. Muchos sistemas de animación profesional utilizan enfoques basados en FACS:

| RuntimeMetaHumanLipSync Viseme | FACS Action Units | Notas |

|---|---|---|

| Sil | Neutral | Sin AUs activas |

| PP | AU23 + AU24 | Presionador de labios + tensador de labios |

| FF | AU22 + AU28 | Embudo de labios + succión de labios |

| TH | AU25 (suave) + AU27 | Labios separados + estiramiento de boca |

| DD | AU25 + AU16 | Labios separados + depresor del labio inferior |

| KK | AU26 + AU14 | Caída de mandíbula + formador de hoyuelos |

| CH | AU18 + AU25 | Fruncidor de labios + labios separados |

| SS | AU20 | Estirador de labios |

| NN | AU25 (muy suave) | Ligera separación de labios |

| RR | AU18 (suave) | Fruncido leve de labios |

| AA | AU27 + AU26 | Estiramiento de boca + caída de mandíbula |

| E | AU25 + AU12 | Labios separados + tirador de la comisura del labio |

| IH | AU12 + AU25 (suave) | Tirador de la comisura del labio + ligera separación de labios |

| OH | AU27 (suave) + AU18 | Estiramiento leve de boca + fruncido de labios |

| OU | AU18 + AU26 (suave) | Fruncido de labios + ligera caída de mandíbula |

El sistema Preston Blair es un estándar clásico de animación que utiliza nombres descriptivos para las formas de la boca:

| RuntimeMetaHumanLipSync Viseme | Preston Blair | Notas |

|---|---|---|

| Sil | Rest | Posición neutral de boca cerrada |

| PP | MBP | La forma de boca clásica "MBP" |

| FF | FV | La posición "FV" con los dientes en el labio inferior |

| TH | TH | Lengua tocando los dientes frontales |

| DD | D/T/N | Posición similar para estas consonantes |

| KK | CKG | Posición de consonante dura |

| CH | CH/J/SH | Ligero mohín para estos sonidos |

| SS | S/Z | Posición de dientes ligeramente abierta |

| NN | N/NG/L | Similar a D/T pero con diferente posición de la lengua |

| RR | R | Labios redondeados para el sonido R |

| AA | AI | Boca muy abierta |

| E | EH | Boca medio abierta |

| IH | EE | Labios extendidos |

| OH | OH | Apertura media redondeada |

| OU | OO | Labios fuertemente redondeados |

3ds Max utiliza un sistema basado en fonemas para su character studio:

| RuntimeMetaHumanLipSync Viseme | 3ds Max Phoneme | Notas |

|---|---|---|

| Sil | rest | Posición de boca por defecto |

| PP | p_b_m | Equivalente directo |

| FF | f_v | Equivalente directo |

| TH | th | Equivalente directo |

| DD | t_d | Equivalente directo |

| KK | k_g | Equivalente directo |

| CH | sh_zh_ch | Forma combinada |

| SS | s_z | Equivalente directo |

| NN | n_l | Combinado para estos sonidos |

| RR | r | Equivalente directo |

| AA | ah | Sonido de vocal abierta |

| E | eh | Vocal media |

| IH | ee | Vocal frontal cerrada |

| OH | oh | Vocal posterior redondeada |

| OU | oo | Vocal posterior cerrada |

Los personajes personalizados con visemas o blend shapes/morph targets de boca (Daz Genesis 8/9, Reallusion CC3/CC4, Mixamo, ReadyPlayerMe, etc.) generalmente pueden mapearse al sistema de visemas del plugin con aproximaciones razonables.

Creating a custom Pose Asset

Sigue estos pasos para crear un activo de pose personalizado para tu personaje que se utilizará con el nodo Blend Runtime MetaHuman Lip Sync:

1. Locate your character's Skeletal Mesh

Encuentra la malla esquelética que contiene los morph targets (blend shapes) que deseas usar para la animación de sincronización labial. Esto podría ser una malla de cuerpo completo o solo una malla facial, dependiendo del diseño de tu personaje.

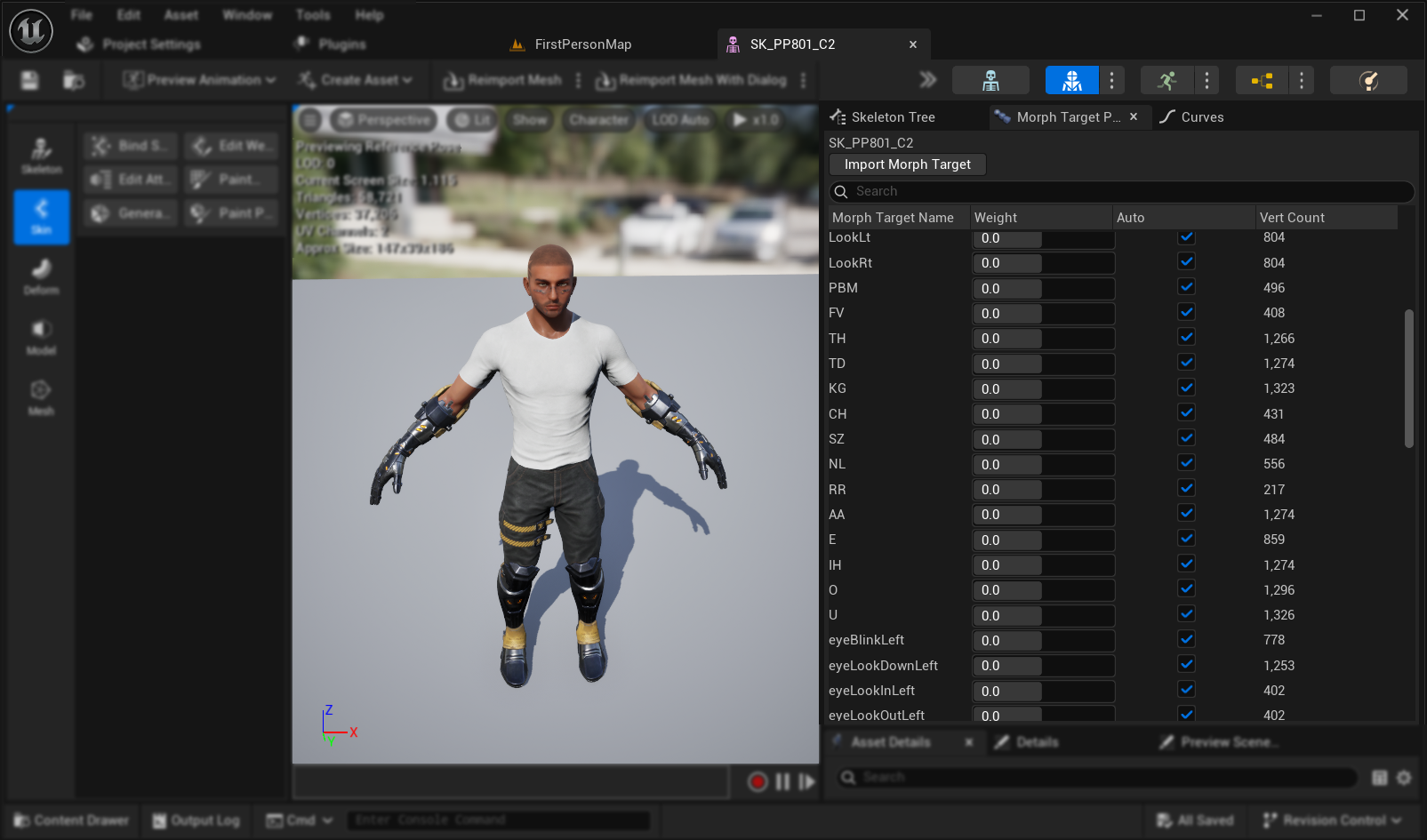

2. Verify Morph Targets and Curves

Antes de continuar, verifica que tu malla esquelética tenga morph targets apropiados y curvas correspondientes para la animación de sincronización labial.

Verificar Morph Targets: Verifica que tu malla esquelética contenga morph targets (blend shapes) que puedan usarse como visemas para la animación de sincronización labial. La mayoría de los personajes con soporte de animación facial deberían tener algunos morph targets de fonemas/visemas.

Importante: Verificar la pestaña Curves Este paso es especialmente crucial para personajes exportados desde Blender u otro software externo:

- Abre la pestaña Curves en el editor de Skeletal Mesh

- Comprueba si puedes ver curvas correspondientes a tus morph targets

- Si la pestaña Curves está vacía pero existen morph targets, agrega manualmente nuevas curvas usando exactamente los mismos nombres que tus morph targets

Nota: Este problema ocurre comúnmente con exportaciones de Blender donde los morph targets se importan con éxito pero las curvas de animación no se crean automáticamente. Sin curvas coincidentes, la animación no se completará correctamente después de hornearse en el Control Rig.

Solución Alternativa: Para evitar este problema durante la exportación desde Blender, intenta habilitar Custom Properties y Animation en la configuración de exportación de FBX, lo que puede ayudar a incluir curvas de animación junto con los morph targets.

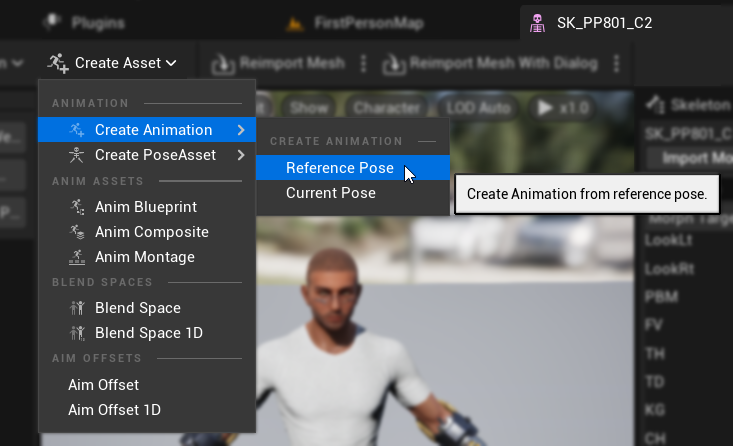

3. Create a Reference Pose Animation

- Ve a

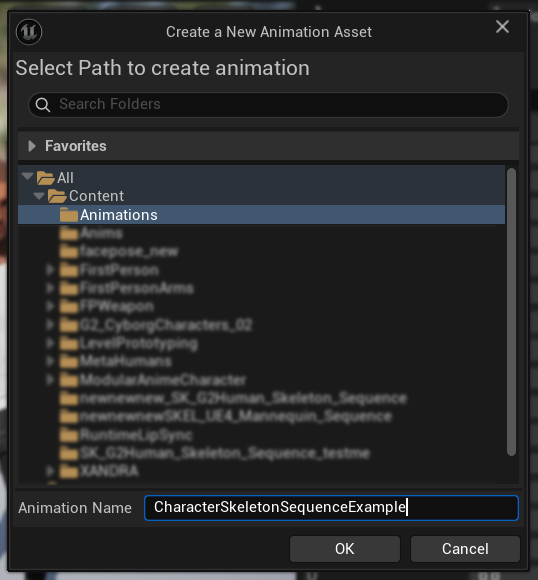

Create Asset -> Create Animation -> Reference Pose - Ingresa un nombre descriptivo para la secuencia de animación y guárdala en una ubicación apropiada

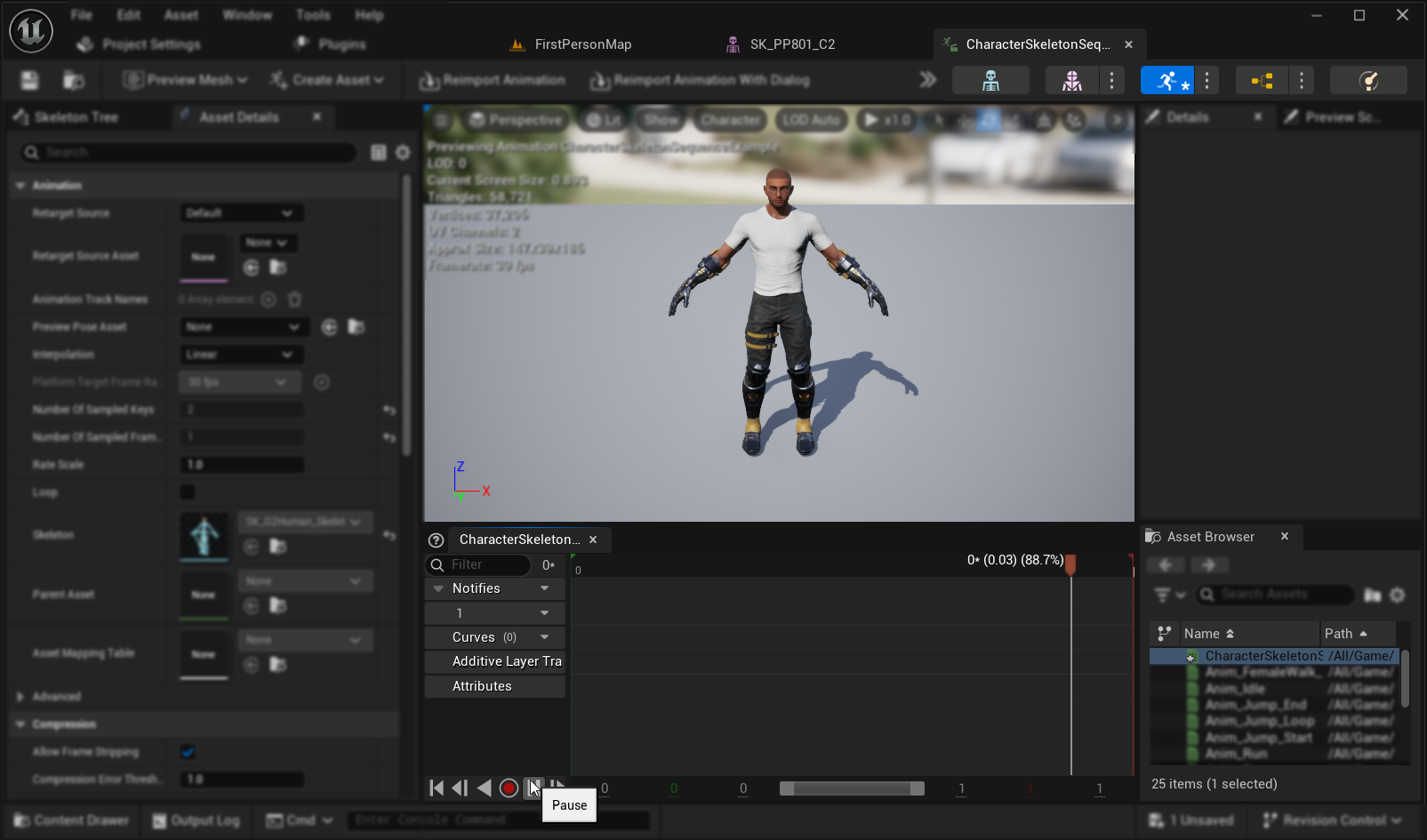

- La Animation Sequence creada se abrirá automáticamente, mostrando una animación vacía reproduciéndose en bucle

- Haz clic en el botón

Pausepara detener la reproducción de la animación para facilitar la edición

4. Edit the Animation Sequence

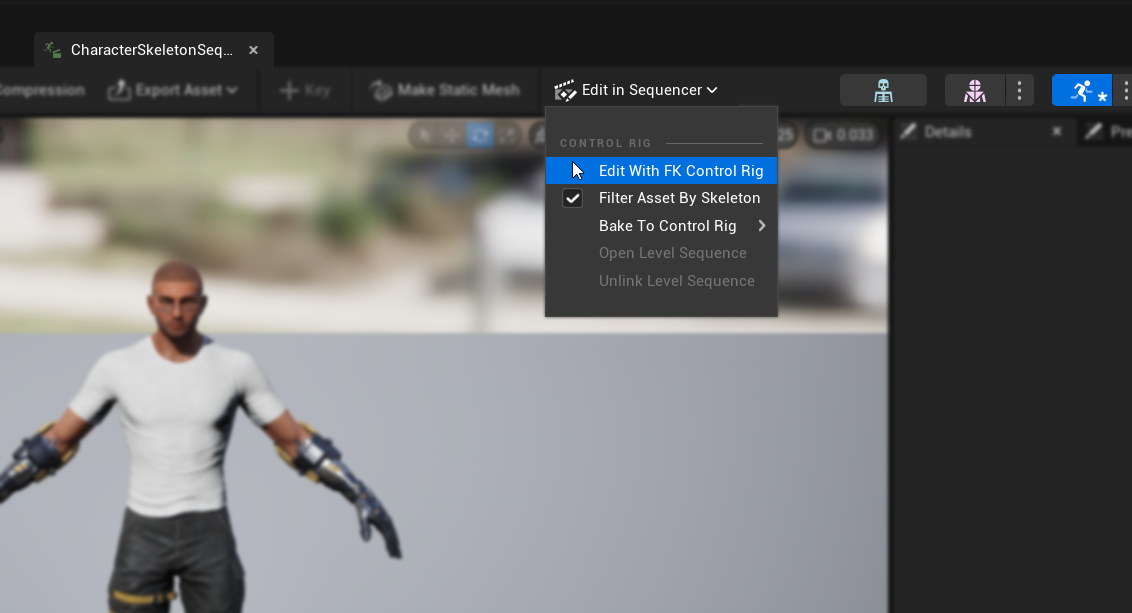

- Haz clic en

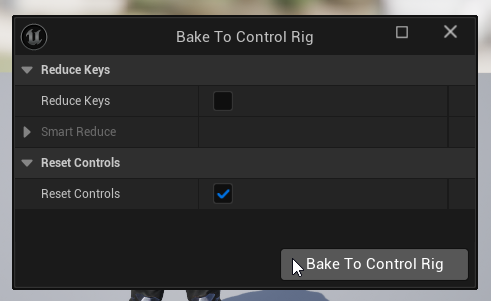

Edit in Sequencer->Edit with FK Control Rig - En el cuadro de diálogo

Bake to Control Rig, haz clic en el botónBake to Control Rigsin cambiar ninguna configuración

- El editor cambiará a

Animation Modecon la pestañaSequencerabierta - Establece el

View Range End Timeen 0016 (lo que establecerá automáticamenteWorking Range Enden 0016 también) - Arrastra el borde derecho del control deslizante hasta el extremo derecho de la ventana del secuenciador

5. Prepare the Animation Curves

- Regresa al recurso de Secuencia de Animación y localiza los morph targets en la lista

Curves(si no son visibles, cierra y vuelve a abrir el recurso de Secuencia de Animación) - Elimina cualquier morph target que no esté relacionado con visemas o movimientos de boca que quieras usar para la sincronización labial

6. Plan your viseme mapping

Crea un plan de mapeo para hacer coincidir los visemas de tu personaje con el conjunto requerido por el plugin. Por ejemplo:

Sil -> Sil

PP -> FV

FF -> FV

TH -> TH

DD -> TD

KK -> KG

CH -> CH

SS -> SZ

NN -> NL

RR -> RR

AA -> AA

E -> E

IH -> IH

OH -> O

OU -> U

Ten en cuenta que es aceptable tener mapeos repetidos cuando el conjunto de visemas de tu personaje no tiene coincidencias exactas para cada visema requerido.

7. Animate each viseme

- Para cada visema, anima las curvas de morph target relevantes de 0.0 a 1.0

- Inicia la animación de cada visema en un fotograma diferente

- Configura curvas adicionales según sea necesario (apertura de mandíbula/boca, posición de la lengua, etc.) para crear formas de visema de apariencia natural

8. Create a Pose Asset

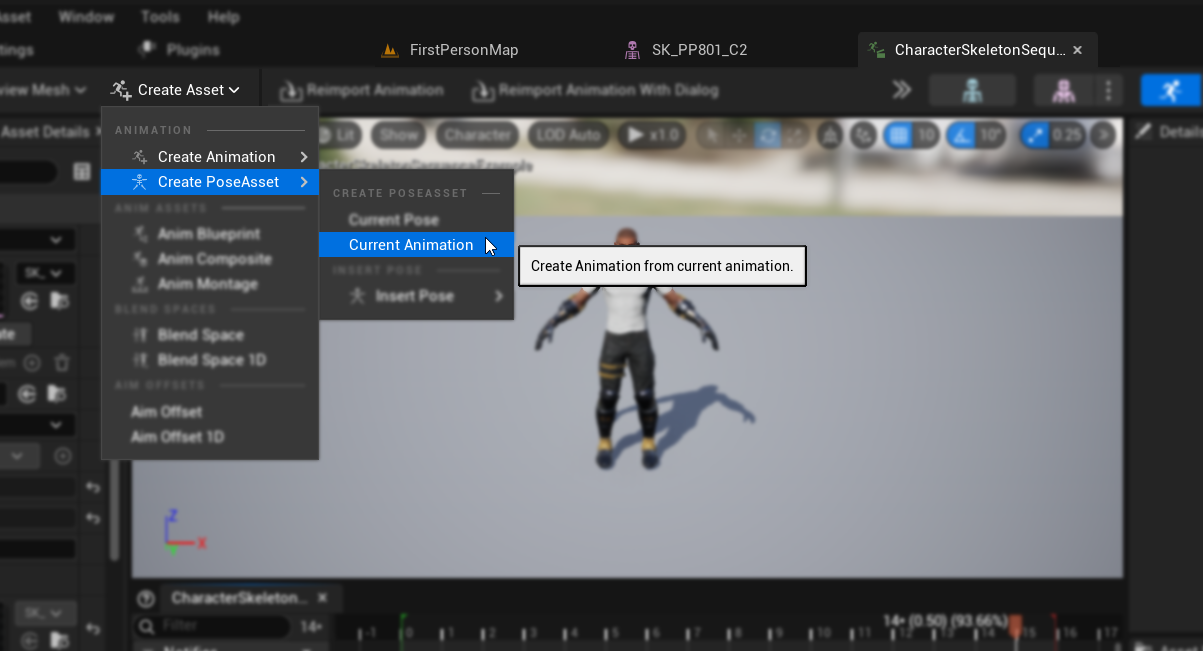

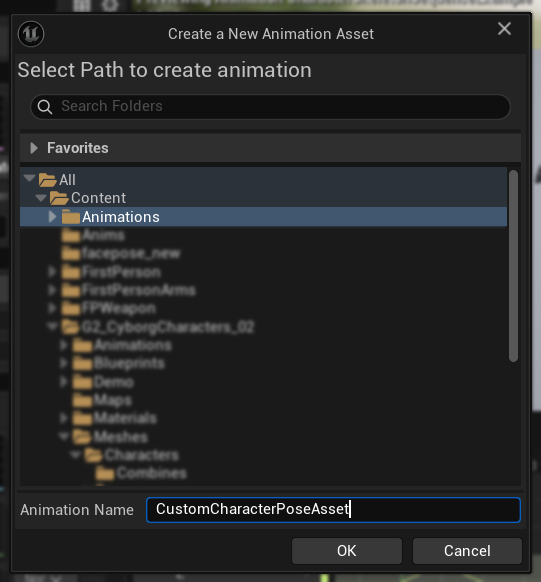

- Ve a

Create Asset->Pose Asset->Current Animation - Introduce un nombre descriptivo para el Pose Asset y guárdalo en una ubicación apropiada

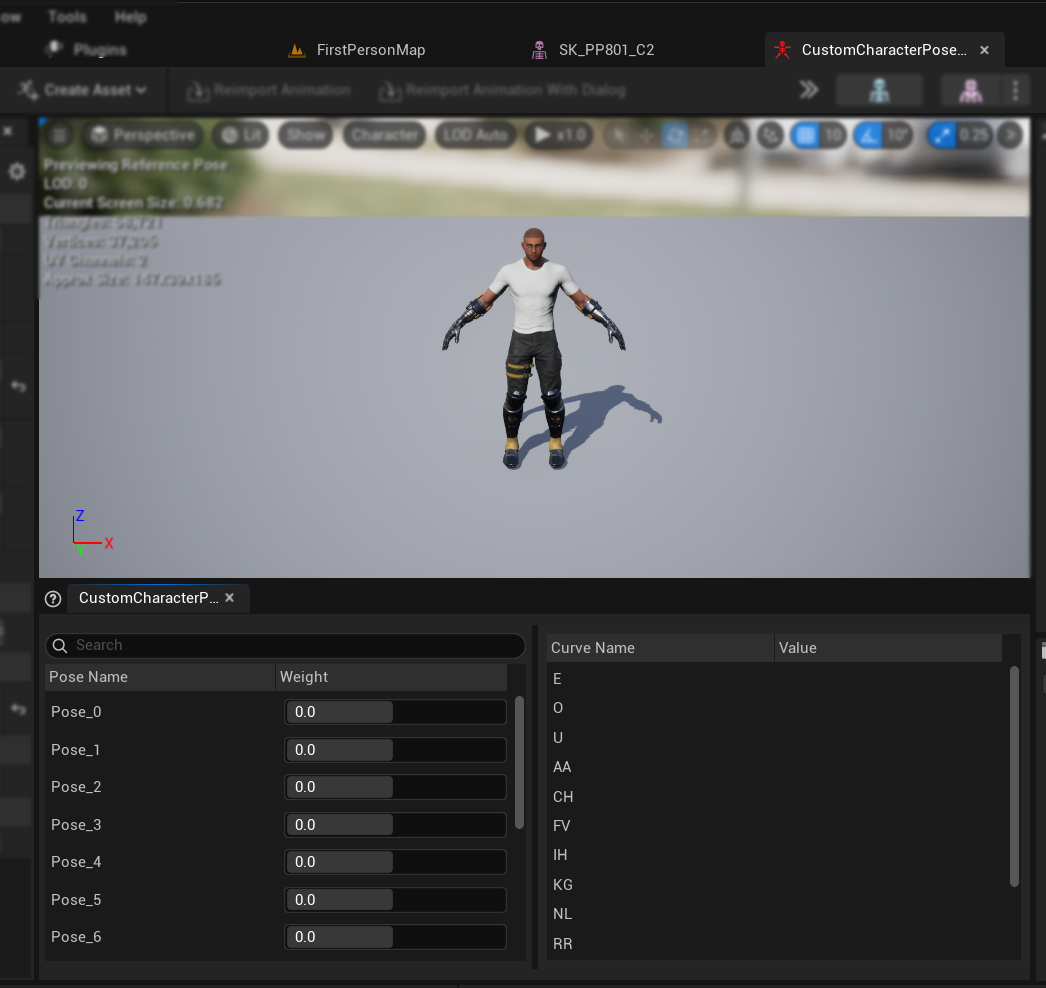

- El Pose Asset creado se abrirá automáticamente, mostrando poses como

Pose_0,Pose_1, etc., cada una correspondiente a un visema - Previsualiza los pesos de los visemas para asegurarte de que funcionan como se espera

9. Finalize the Pose Asset

- Renombra cada pose para que coincida con los nombres de los visemas de la sección Prerequisites

- Elimina cualquier pose no utilizada

Setting up audio handling and blending

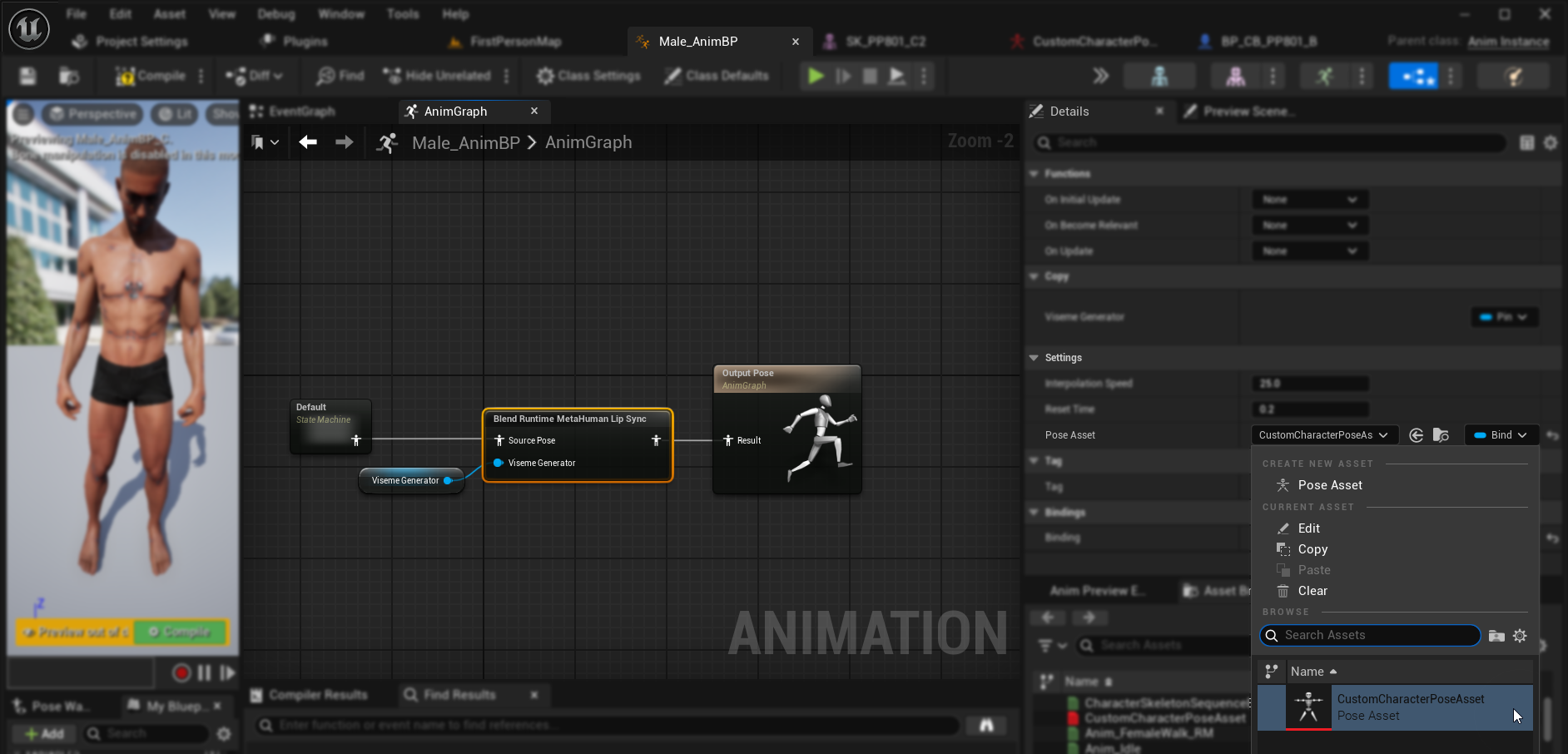

Una vez que tu activo de pose esté listo, necesitas configurar los nodos de manejo y mezcla de audio:

- Localiza o crea el Animation Blueprint de tu personaje

- Configura el manejo y mezcla de audio siguiendo los mismos pasos documentados en la guía de configuración estándar del plugin

- En el nodo

Blend Runtime MetaHuman Lip Sync, selecciona tu Pose Asset personalizado en lugar del activo de pose MetaHuman predeterminado

Combining with body animations

Si deseas realizar la sincronización labial junto con otras animaciones corporales:

- Sigue los mismos pasos documentados en la guía estándar del plugin

- Asegúrate de proporcionar los nombres de huesos correctos para el esqueleto del cuello de tu personaje en lugar de usar los nombres de huesos de MetaHuman

Resultados

Aquí hay ejemplos de personajes personalizados usando esta configuración:

La calidad de la sincronización labial depende en gran medida del personaje específico y de lo bien que estén configurados sus visemas. Los ejemplos anteriores demuestran el plugin funcionando con diferentes tipos de personajes personalizados con sistemas de visemas distintos.